突發(fā)!ImageNet 數(shù)據(jù)集中的人臉全都變模糊了

2012年,人工智能研究人員在計(jì)算機(jī)視覺方面取得了巨大進(jìn)步,被稱為ImageNet的數(shù)據(jù)集至今仍被用于成千上萬的人工智能研究項(xiàng)目和實(shí)驗(yàn)。但是上周ImageNet上的所有人臉都突然消失了,因?yàn)閿?shù)據(jù)集管理者為了保護(hù)隱私?jīng)Q定模糊處理它們。

ImageNet 數(shù)據(jù)集的管理者為如今深度學(xué)習(xí)的進(jìn)步鋪平了道路。現(xiàn)在,他們?cè)诒Wo(hù)人們的隱私方面又邁出了一大步:對(duì)數(shù)據(jù)集模糊處理。

2012年,人工智能研究人員在計(jì)算機(jī)視覺方面取得了巨大進(jìn)步,這很大程度歸功于一個(gè)異常龐大的圖像集。

這個(gè)數(shù)據(jù)集中有數(shù)以千計(jì)的日常物體、人物和圖片中的場景,這些圖片都是從網(wǎng)上搜集并用手工標(biāo)記的。

這些被稱為 ImageNet 的數(shù)據(jù)集至今仍被用于成千上萬的人工智能研究項(xiàng)目和實(shí)驗(yàn)。

但是上周 ImageNet 上的所有人臉都突然消失了,因?yàn)樨?fù)責(zé)管理數(shù)據(jù)集的研究人員決定模糊它們。

正如 ImageNet 幫助開創(chuàng)了人工智能的新時(shí)代,要修復(fù)它也面臨很多挑戰(zhàn),主要是對(duì)無數(shù)人工智能程序、數(shù)據(jù)集和產(chǎn)品的影響和挑戰(zhàn)。

普林斯頓大學(xué)的助理教授 Olga Russakovsky 是 ImageNet 的負(fù)責(zé)人之一,他說: 「我們擔(dān)心隱私問題。」

在2012年,計(jì)算機(jī)科學(xué)家一直致力于能開發(fā)能夠識(shí)別圖像中物體的算法,ImageNet 就是為此而創(chuàng)建的。

然后,一種叫做深度學(xué)習(xí)的技術(shù),通過給神經(jīng)網(wǎng)絡(luò)添加標(biāo)記的例子來「教」它,而且還被證明比以前的方法效果更好。

從那時(shí)起,深度學(xué)習(xí)推動(dòng)了人工智能的復(fù)興,同時(shí)也暴露了這個(gè)領(lǐng)域的缺陷。

例如,面部識(shí)別已經(jīng)被證明是深度學(xué)習(xí)的一個(gè)特別流行和有前景的應(yīng)用,但它也是有爭議的。

出于對(duì)侵犯公民隱私的擔(dān)憂,美國一些城市已經(jīng)禁止政府使用這項(xiàng)技術(shù),因?yàn)檫@些程序?qū)Ψ前兹四槻康淖R(shí)別精確度較低。

ImageNet 包含了150萬張圖片和大約1000個(gè)標(biāo)簽。它主要用于評(píng)估機(jī)器學(xué)習(xí)算法的性能,或者訓(xùn)練執(zhí)行特殊計(jì)算機(jī)視覺任務(wù)的算法。

如今,它對(duì)243198張照片進(jìn)行了模糊處理。

Russakovsky 說 ImageNet 團(tuán)隊(duì)想要確定是否有可能在不改變識(shí)別對(duì)象的能力的情況下模糊數(shù)據(jù)集中的人臉。

「人們?cè)跀?shù)據(jù)中是偶然出現(xiàn)的,因?yàn)樗麄兦『贸霈F(xiàn)在描述這些物體的網(wǎng)絡(luò)照片中,」她說。

換句話說,在一張顯示啤酒瓶的圖片中,即使喝啤酒的人的臉上有一個(gè)粉紅色的污點(diǎn),對(duì)啤酒瓶本身來說并無影響。

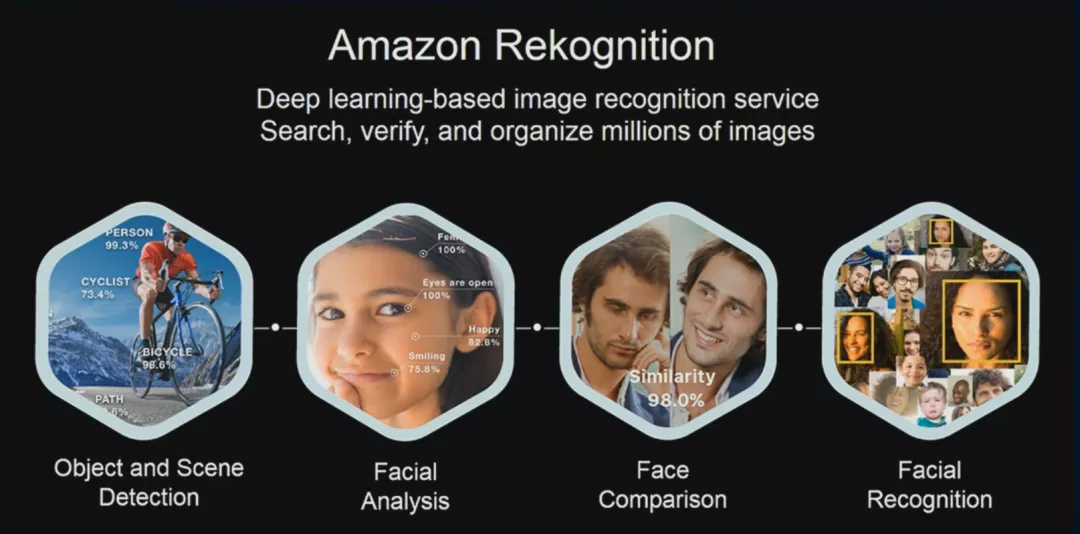

在 ImageNet 更新的同時(shí),發(fā)布了一篇研究論文,數(shù)據(jù)庫背后的團(tuán)隊(duì)解釋說,他們使用亞馬遜的人工智能服務(wù) Rekognition 模糊了面孔。

然后,他們付錢給 Mechanical Turk 的員工確認(rèn)并調(diào)整他們的選擇。

研究人員說,模糊臉部并不影響在 ImageNet 上訓(xùn)練的幾種物體識(shí)別算法的性能。

他們還表明,用這些物體識(shí)別算法構(gòu)建的其他算法也同樣不受影響。

「我們希望這種概念驗(yàn)證為該領(lǐng)域更多的隱私意識(shí)視覺數(shù)據(jù)收集實(shí)踐鋪平了道路,」魯薩科夫斯基說。

2019年12月,ImageNet 團(tuán)隊(duì)刪除了由人工標(biāo)簽引入的帶有偏見的貶義詞,因?yàn)橐粋€(gè)名為挖掘 AI 的項(xiàng)目引起了人們對(duì)這個(gè)問題的關(guān)注。

該研究表明他們可以在數(shù)據(jù)集中識(shí)別個(gè)人,包括計(jì)算機(jī)科學(xué)研究人員。他們還發(fā)現(xiàn)其中包含色情圖片。

普拉布說,模糊臉是好事,但令人失望的是 ImageNet 團(tuán)隊(duì)沒有承認(rèn)他和比爾哈恩的工作。Russakovsky 表示,論文的更新版本中將出現(xiàn)一條引文。

模糊人臉仍然可能會(huì)對(duì)基于 ImageNet 數(shù)據(jù)訓(xùn)練的算法產(chǎn)生意外后果。例如,算法可能學(xué)會(huì)在搜索特定對(duì)象時(shí)尋找模糊的面孔。

Russakovsky 說: 「需要考慮的一個(gè)重要問題是,當(dāng)你部署一個(gè)基于面部模糊數(shù)據(jù)集的模型時(shí),會(huì)發(fā)生什么情況。」

例如,在此數(shù)據(jù)集上訓(xùn)練的機(jī)器人可能會(huì)因?yàn)椴荒茏R(shí)別現(xiàn)實(shí)世界中的人臉而被拋棄。

麻省理工學(xué)院的研究科學(xué)家 Aleksander Madry 已經(jīng)發(fā)現(xiàn)了 ImageNet 的局限性。他認(rèn)為,一個(gè)人工智能模型在包含模糊人臉的數(shù)據(jù)集上訓(xùn)練,當(dāng)顯示包含人臉的圖像時(shí),可能會(huì)表現(xiàn)得很奇怪。

他說: 「數(shù)據(jù)中的偏差可能非常微妙,但同時(shí)可能會(huì)產(chǎn)生重大的后果。這就是為什么在機(jī)器學(xué)習(xí)的背景下考慮魯棒性和公平性如此棘手。」

不過最近國內(nèi)「315」也在提AI公司侵犯隱私權(quán)的問題,還是希望各位AI公司在發(fā)展技術(shù)的同時(shí),也能思考一下這些附帶來的問題。