Yann LeCun爆驚人言論:深度學習已死,可微分編程萬歲!

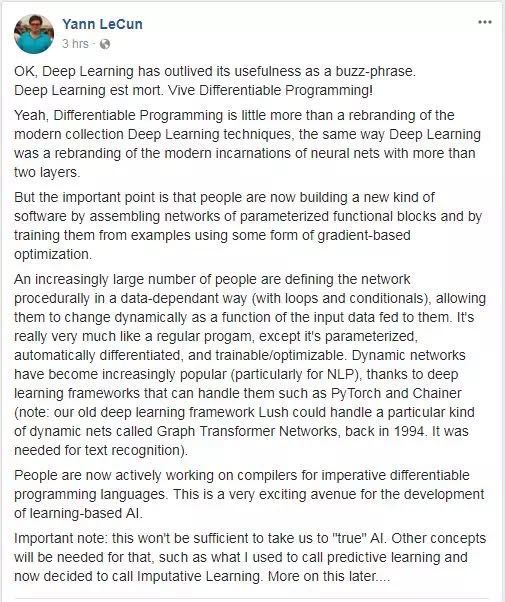

深度學習領域最知名的學者之一 Yann LeCun 今日在自己 facebook 上發(fā)表的一篇短文,瞬間引爆了國內人工智能關注者們的朋友圈。這條動態(tài)講的是什么呢?為何會引起如此軒然大波?

我們常常提到的深度學習是全部深度學習算法的總稱,卷積神經網絡是深度學習算法在圖像處理領域的一個應用。而 Yann LeCun 就是卷積神經網路的***,也被稱之為“卷積神經網絡之父”。卷積神經網絡的出現(xiàn)對人工智能發(fā)展的重要性不必多說。而這次 Yann LeCun 的推文傳播如此之快,是不是有比“卷積神經網絡”更重大的學術成果出來了?為了使國內讀者了解到 LeCun 推送的內容,雷鋒網編輯對推文進行了編譯。

首先開頭是一句***有標題黨風格的英法混合語:

Deep Learning est mort. Vive Differentiable Programming!

翻譯成中文就是:深度學習已死,可微分編程萬歲!

為何突出此言?深度學習算法是人工智能多個領域的底層框架,怎么就死了呢?接著往下看發(fā)現(xiàn) LeCun 說的是“深度學習”這個詞已死,該有新的名詞來替代它了。

LeCun 提到的新詞是可微分編程。

他在推文中解釋道“可微分編程”不過是把現(xiàn)代深度學習技術重新?lián)Q了個叫法,這就跟當年神經網絡還只有兩個以上隱藏層時就被稱之為“深度學習”差不多。對于現(xiàn)代深度學習技術,“深度學習”這個詞已經不夠用了。

他又寫道:

但重點的是,人們現(xiàn)在正通過組裝參數化功能模塊網絡,構建一種新軟件,并用某種基于梯度優(yōu)化的方法來訓練它們。

越來越多的人正在以一種依賴于數據的方式(循環(huán)和條件)來程序化定義網絡,讓它們隨著輸入數據的動態(tài)變化而變化。這與普通的程序非常類似,除了前者是參數化的、可以自動可微分,并且可訓練和優(yōu)化。動態(tài)網絡變得越來越流行(尤其是對于 NLP),這要歸功于 PyTorch 和 Chainer 等深度學習框架(注意:早在 1994 年,之前的深度學習框架 Lush,就能處理一種稱為 Graph Transformer Networks 的特殊動態(tài)網絡,用于文本識別)。

現(xiàn)在人們正在積極研究開發(fā)命令式可微分編程語言編譯器,這對開發(fā)基于學習的 AI(learning-based AI)來說是一條非常令人興奮的途徑。

***,LeCun 還特別強調將“深度學習”改名為”可微分編程”還不夠,其他的一些概念也需要改,比如“預測性學習”應該改為 “Imputative Learning”。他說稍后會談更多......(讀者們可以幫想想還有什么需要改名的,這句是雷鋒網加的)。讓我們一起來關注 LeCun 的***動態(tài)吧!

LeCun 的 Facebook 截圖: