陳丹琦團(tuán)隊(duì)新作:5%成本拿下SOTA,“羊駝剪毛”大法火了

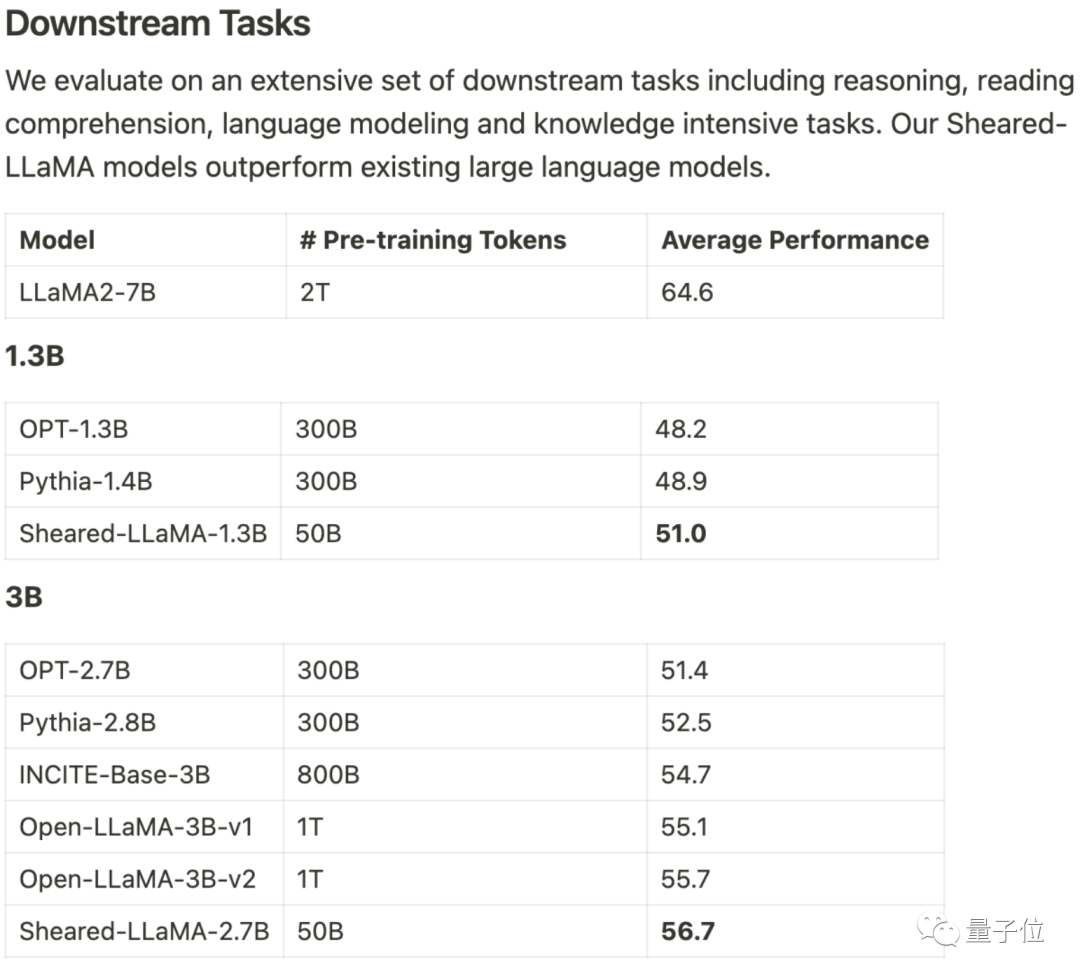

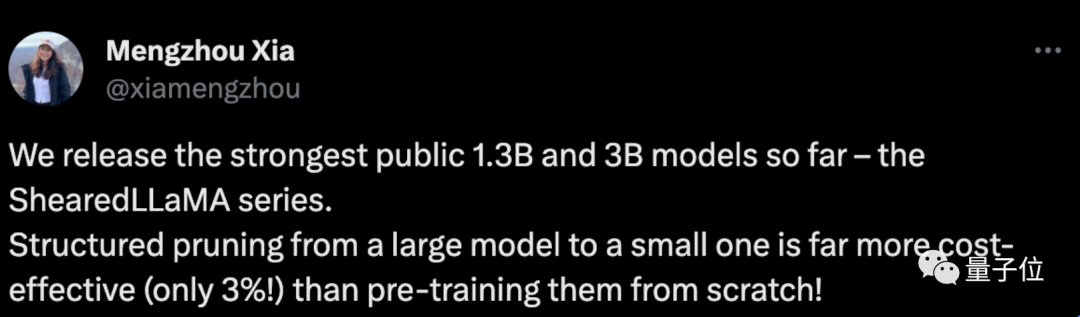

只用3%的計(jì)算量、5%的成本取得SOTA,統(tǒng)治了1B-3B規(guī)模的開源大模型。

這一成果來自普林斯頓陳丹琦團(tuán)隊(duì),名為LLM-Shearing大模型剪枝法。

以羊駝LLaMA 2 7B為基礎(chǔ),通過定向結(jié)構(gòu)化剪枝得到1.3B和3B剪枝后的Sheared-LLama模型。

分別在下游任務(wù)評(píng)估上超越之前的同等規(guī)模模型。

一作夏夢(mèng)舟表示,“比從頭開始預(yù)訓(xùn)練劃算很多”。

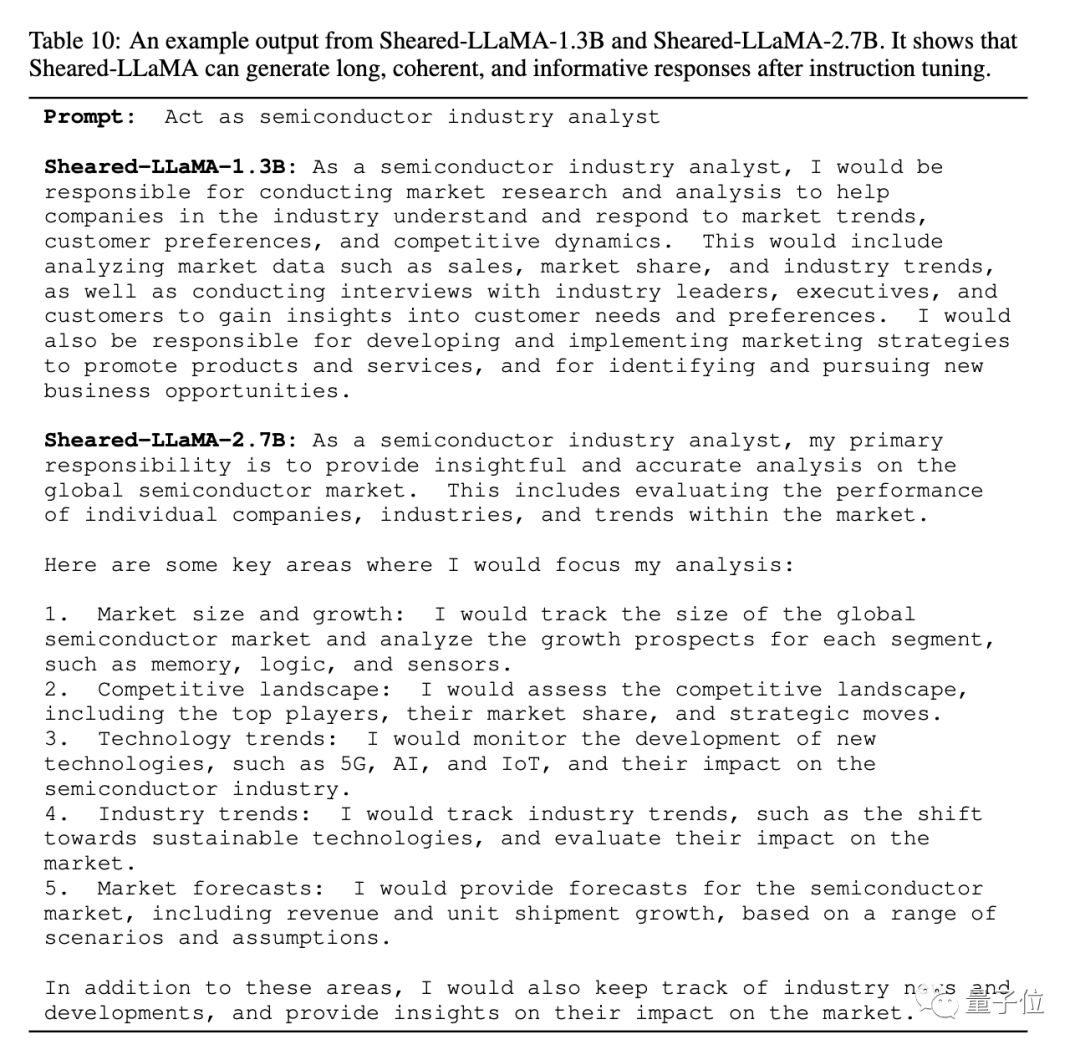

論文中也給出了剪枝后的Sheared-LLaMA輸出示例,表示盡管規(guī)模只有1.3B和2.7B,也已經(jīng)能生成連貫且內(nèi)容豐富的回復(fù)。

相同的“扮演一個(gè)半導(dǎo)體行業(yè)分析師”任務(wù),2.7B版本的回答結(jié)構(gòu)上還要更清晰一些。

團(tuán)隊(duì)表示雖然目前只用Llama 2 7B版做了剪枝實(shí)驗(yàn),但該方法可以擴(kuò)展到其他模型架構(gòu),也能擴(kuò)展到任意規(guī)模。

另外還有一個(gè)好處,剪枝后可自行選用優(yōu)質(zhì)的數(shù)據(jù)集繼續(xù)預(yù)訓(xùn)練。

有開發(fā)者表示,6個(gè)月前還幾乎所有人都認(rèn)為65B以下的模型沒有任何實(shí)際用處。

照這樣下去,我敢打賭1B-3B模型也能產(chǎn)生巨大價(jià)值,如果不是現(xiàn)在,也是不久以后。

把剪枝當(dāng)做約束優(yōu)化

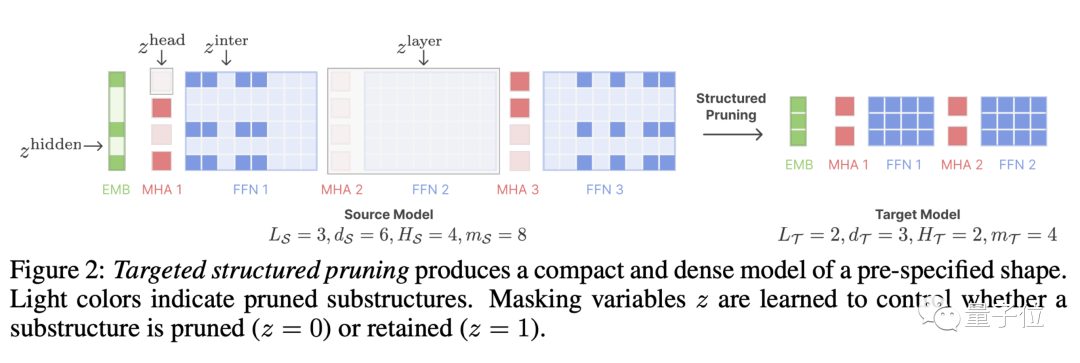

LLM-Shearing,具體來說是一種定向結(jié)構(gòu)化剪枝,將一個(gè)大模型剪枝到指定的目標(biāo)結(jié)構(gòu)。

之前的剪枝方法可能會(huì)導(dǎo)致模型性能下降,因?yàn)闀?huì)刪除一些結(jié)構(gòu),影響表達(dá)能力。

新方法將剪枝看成一種約束優(yōu)化問題,學(xué)習(xí)剪枝掩碼矩陣來搜索與指定結(jié)構(gòu)匹配的子網(wǎng)絡(luò),同時(shí)以最大化性能為目標(biāo)。

接下來對(duì)剪枝過的模型進(jìn)行繼續(xù)預(yù)訓(xùn)練,在一定程度上恢復(fù)剪枝造成的性能損失。

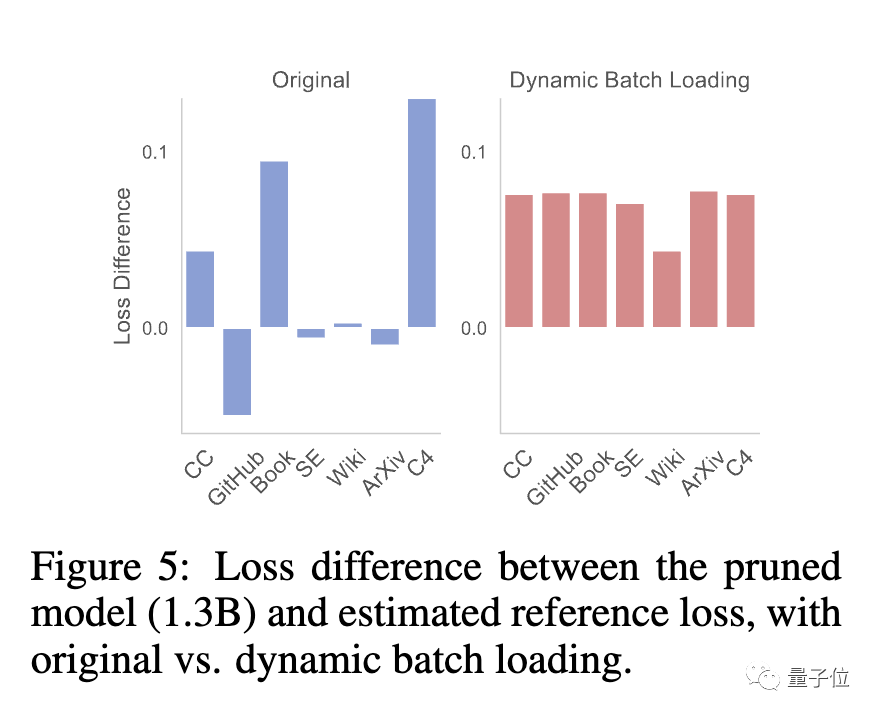

在這個(gè)階段,團(tuán)隊(duì)發(fā)現(xiàn)剪枝過的模型與從頭訓(xùn)練的模型對(duì)不同數(shù)據(jù)集的損失下降速率不一樣,產(chǎn)生數(shù)據(jù)使用效率低下的問題。

為此團(tuán)隊(duì)提出了動(dòng)態(tài)批量加載(Dynamic Batch Loading),根據(jù)模型在不同域數(shù)據(jù)上的損失下降速率動(dòng)態(tài)調(diào)整每個(gè)域的數(shù)據(jù)所占比例,提高數(shù)據(jù)使用效率。

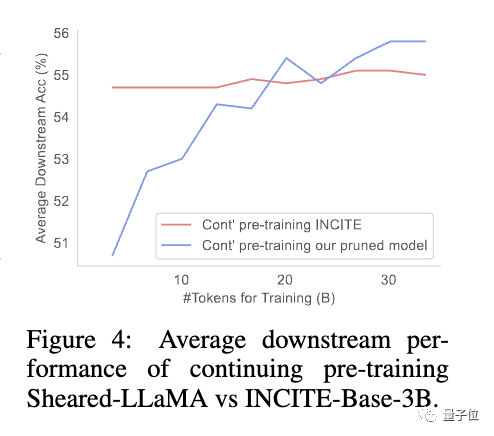

實(shí)驗(yàn)發(fā)現(xiàn),雖然剪枝模型與從頭訓(xùn)練的同等規(guī)模模型相比,雖然一開始表現(xiàn)差得多,但繼續(xù)預(yù)訓(xùn)練可以迅速提高,最終超越。

這表明從強(qiáng)大的基礎(chǔ)模型中剪枝,可以為繼續(xù)預(yù)訓(xùn)練提供更好的初始化條件。

將持續(xù)更新,來一個(gè)剪一個(gè)

論文作者分別為普林斯頓博士生夏夢(mèng)舟、高天宇,清華Zhiyuan Zeng,普林斯頓助理教授陳丹琦。

夏夢(mèng)舟,本科畢業(yè)于復(fù)旦,碩士畢業(yè)于CMU。

高天宇,本科畢業(yè)于清華,是2019年清華特獎(jiǎng)得主。

兩人都是陳丹琦的學(xué)生,陳丹琦現(xiàn)在為普林斯頓助理教授,普林斯頓 NLP小組的共同領(lǐng)導(dǎo)者。

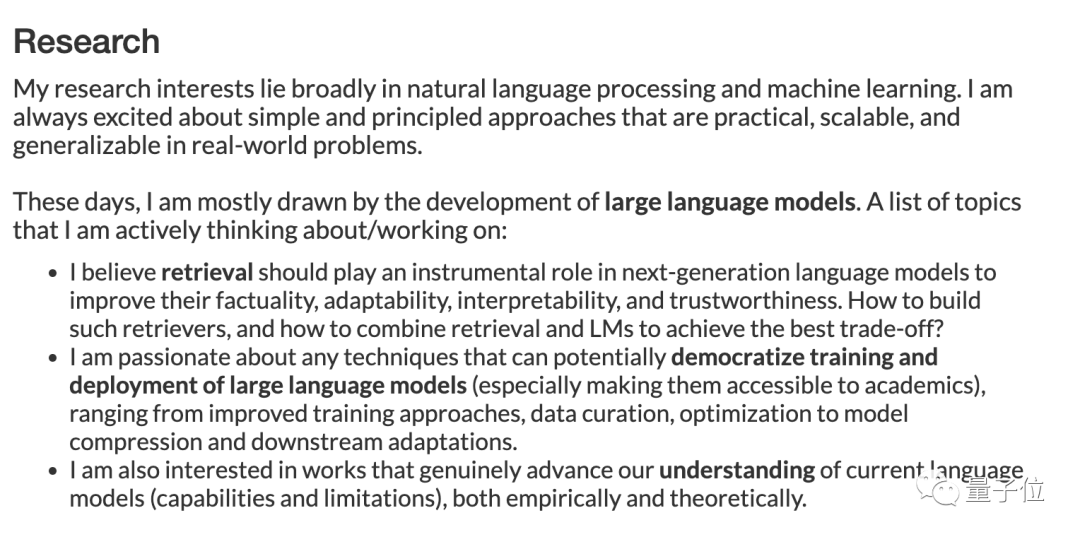

最近在個(gè)人主頁中,陳丹琦更新了她的研究方向。

“這些日子主要被開發(fā)大模型吸引”,正在研究的主題包括:

- 檢索如何在下一代模型中發(fā)揮重要作用,提高真實(shí)性、適應(yīng)性、可解釋性和可信度。

- 大模型的低成本訓(xùn)練和部署,改進(jìn)訓(xùn)練方法、數(shù)據(jù)管理、模型壓縮和下游任務(wù)適應(yīng)優(yōu)化。

- 還對(duì)真正增進(jìn)對(duì)當(dāng)前大模型功能和局限性理解的工作感興趣,無論在經(jīng)驗(yàn)上還是理論上。

目前Sheared-Llama已在Hugging Face上提供。

團(tuán)隊(duì)表示,開源庫還會(huì)保持更新。

更多大模型發(fā)布時(shí),來一個(gè)剪一個(gè),持續(xù)發(fā)布高性能的小模型。

One More Thing

不得不說,現(xiàn)在大模型實(shí)在是太卷了。

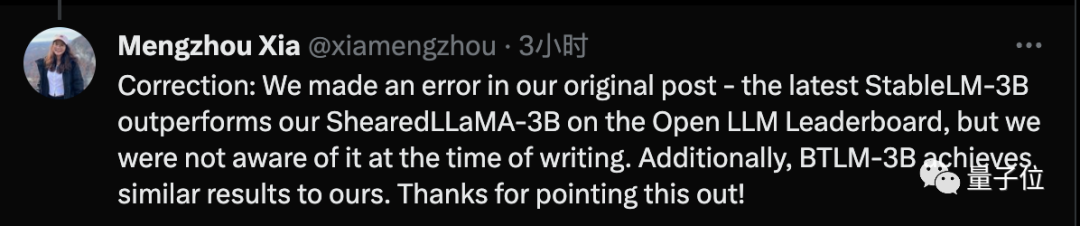

一作Mengzhou Xia剛剛發(fā)布一條更正,表示寫論文時(shí)還是SOTA,論文寫好就已經(jīng)被最新的Stable-LM-3B超越了。

論文地址:https://arxiv.org/abs/2310.06694

Hugging Face:https://huggingface.co/princeton-nlp

項(xiàng)目主頁:https://xiamengzhou.github.io/sheared-llama/