模型合并就進化,直接拿下SOTA!Transformer作者創(chuàng)業(yè)新成果火了

把Huggingface上的現(xiàn)成模型拿來“攢一攢”——

直接就能組合出新的強大模型?!

日本大模型公司sakana.ai腦洞大開(正是“Transformer八子”之一所創(chuàng)辦的公司),想出了這么一個進化合并模型的妙招。

該方法不僅能自動生成新的基礎模型,而且性能絕不賴:

他們得到的一個70億參數(shù)的日語數(shù)學大模型,直接在相關基準測試上取得了SOTA,打敗了700億參數(shù)的Llama-2等前輩。

最重要的是,得出這樣的模型不需要任何梯度訓練,因此需要的計算資源大大減少。

英偉達科學家Jim Fan看完大贊:

這是我最近讀過的最有想象力的論文之一。

合并進化,自動生成新基礎模型

從開源大模型排行榜上表現(xiàn)最好的模型,大多不再是LLaMA或Mistral這種“原始”模型,而是一些微調或合并模型之后,我們就能看出:

一種新的趨勢出現(xiàn)了。

Sakana.ai介紹,開源基礎模型很容易在數(shù)百個不同的方向上進行擴展和微調,然后產生在新的領域表現(xiàn)出色的新模型。

而在這之中,模型合并顯現(xiàn)出了巨大前景。

但,它可能是一種“黑魔法”,嚴重依賴直覺和專業(yè)知識。

因此,我們需要更為系統(tǒng)性的方法。

受自然界的自然選擇啟發(fā),Sakana.ai盯上了進化算法,引入“進化模型合并”(Evolutionary Model Merge)的概念,提出一種可以發(fā)現(xiàn)最佳模型組合的通用方法。

該方法結合了兩種不同的思路:

(1)合并數(shù)據流空間(層)中的模型,以及(2)合并參數(shù)空間(權重)中的模型。

具體而言,第一種數(shù)據流空間方法是通過進化來發(fā)現(xiàn)不同模型層的最佳組合,以此形成新模型。

在社區(qū)以往的做法中,都是靠直覺來確定如何以及模型哪些層可以與另一個模型的層結合。

但其實,Sakana.ai介紹,這個問題有一個組合數(shù)量巨大的搜索空間,最適合由優(yōu)化算法如進化算法來搜索。

其操作示例如下:

至于第二個參數(shù)空間方法則混合多個模型權重來形成新模型。

這種方法其實很無數(shù)種實現(xiàn),再加上混合的每一層原則上可以使用不同的混合比例,就更多了。

而這,利用進化方法就可以有效地找出更為新穎的混合策略。

以下是將兩個不同模型的權重進行混合得到新模型的操作示例:

將以上這兩種方法合并,就是這樣的:

作者介紹,他們希望在相距較遠的領域,例如數(shù)學和非英語語言、視覺和非英語語言,來組成之前大家不曾探索過的新興組合。

結果,還真有點讓人驚喜。

新模型輕松拿下SOTA

用以上進化合并方法,團隊得到了3個基礎模型:

- 大語言模型EvoLLM-JP

由日語大模型Shisa-Gamma和數(shù)學大模型WizardMath/Abel合并而成,擅長解決日語數(shù)學問題,進化了100-150代。

- 視覺語言模型EvoVLM-JP

日語大模型Shisa Gamma 7B v1+LLaVa-1.6-Mistral-7B,是具有日語能力的VLM。

- 圖像生成模型EvoSDXL-JP

支持日語的SDXL擴散模型。

前兩個已在Hugging Face和GitHub上發(fā)布,最后一個也即將推出。

具體來看。

1、EvoLLM-JP

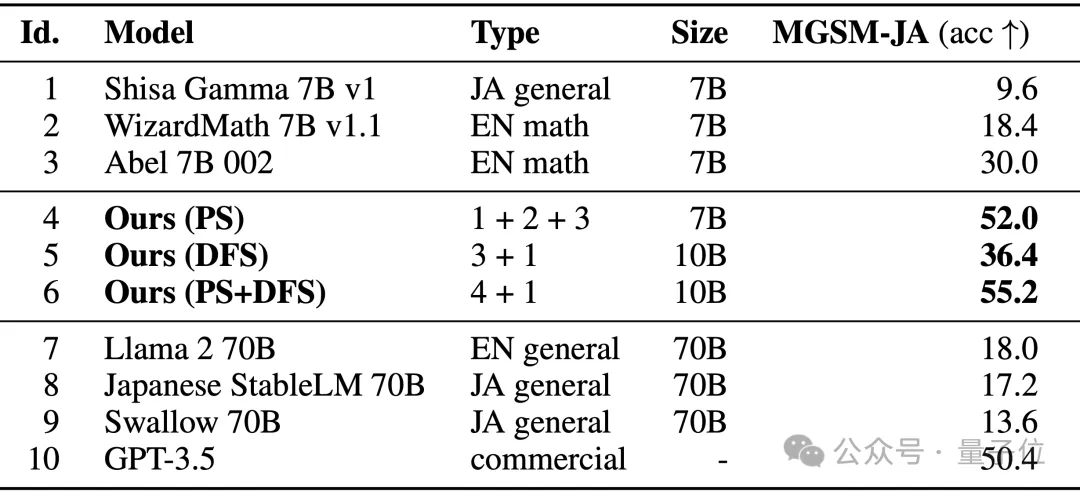

它在GSM8K數(shù)據集的多語言版本——MGSM的日語評估集上取得成績如下:

可以看到,EvoLLM-JP用日語解決數(shù)學問題的表現(xiàn)超過了它們的原始模型,也超過了Llama-2、GPT-3.5等高性能模型。

其中模型4是僅在參數(shù)空間進行了優(yōu)化,模型6是使用模型4在數(shù)據流空間中進一步優(yōu)化的結果。

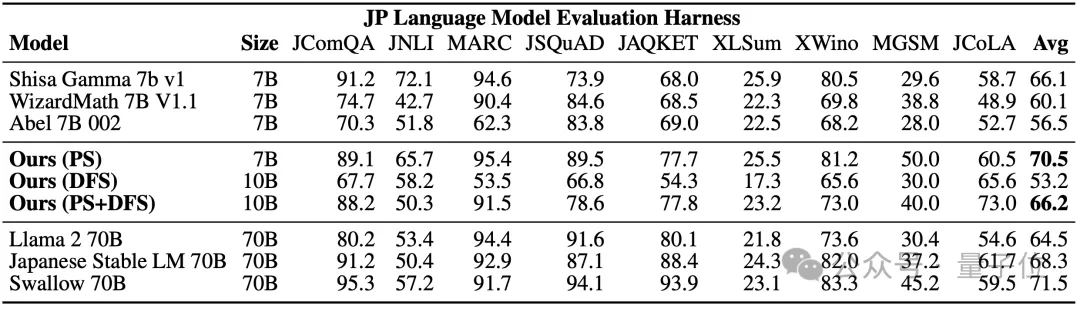

在既評估數(shù)據能力也評估一般日語能力的日語lm-evaluation-harness基準上,EvoLLM-JP則在9個任務上的平均得分最高達到了70.5——只用70億參數(shù),它就打敗了700億的Llama-2等模型。

團隊表示,EvoLLM-JP已經足夠優(yōu)秀,可以作為通用日語大模型,并解決一些有趣的例子:

比如需要特定日本文化知識的數(shù)學問題,或者用關西方言講日本笑話。

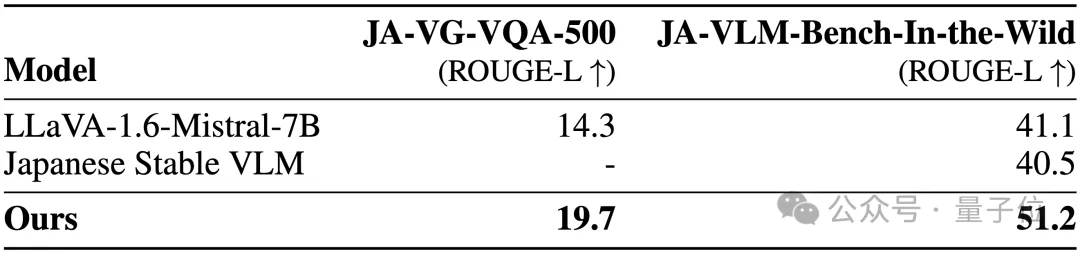

2、EvoVLM-JP

在以下兩個圖像問答的基準數(shù)據集上,分數(shù)越高,代表模型用日語回答的描述越準確。

結果,它不僅比其所基于的英語VLM LLaVa-1.6-Mistral-7B更出色,也比現(xiàn)有的日語VLM更厲害。

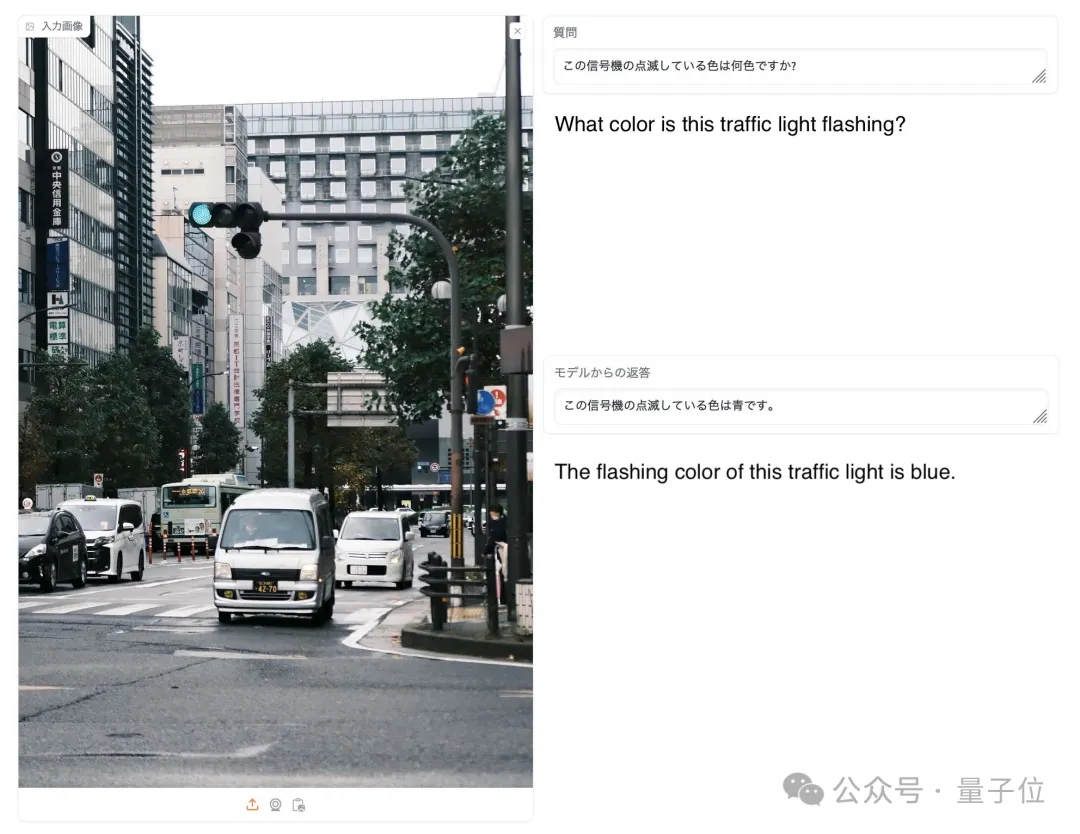

如下圖所示,在回答圖中的信號燈為什么顏色之時,只有EvoVLM-JP答對:藍色。

3、EvoSDXL-JP

這個支持日語的SDXL模型只需4個擴散模型即可執(zhí)行推理,生成速度相當快。

具體跑分還沒出來,但團隊透露也是“相當有希望的”。

可以欣賞一些示例:

提示詞包括:味噌ラーメン、最高品質の浮世絵、葛飾北斎、江戸時代。

對于以上3個新模型,團隊指出:

原則上,我們可以采用基于梯度的反向傳播來進一步提高以上這些模型的性能。

但我們不用,因為現(xiàn)在的目的就是表明,即使沒有反向傳播,我們仍然可以得到足夠先進的基礎模型,挑戰(zhàn)當前的“昂貴范式”。

對此,網友們紛紛點贊。

Jim Fan也補充:

在基礎模型領域,目前社區(qū)幾乎完全專注于讓模型去學習,而不太重視搜索,但后者在訓練(也就是本文提出的進化算法)和推理階段其實都有巨大的潛力。

△馬斯克點贊

所以,如網友所說:

我們現(xiàn)在已經處于模型的寒武紀大爆發(fā)時代了嗎?

論文地址:https://arxiv.org/abs/2403.13187