AtomoVideo:AIGC賦能下的電商視頻動效生成

1. 概述

當今電商領域,內容營銷的形式正日趨多樣化,視頻內容以其生動鮮明的視覺體驗和迅捷高效的信息傳播能力,為商家創造了新的機遇。消費者對視頻內容的偏好驅動了視頻創意供給的持續增長,視覺內容作為連接消費者和商品的橋梁,在廣告系統中正變得日益重要。

然而,與傳統的圖文內容相比,視頻內容的制作難度和成本都要高得多。制作一個高質量的視頻需要專業的技能、設備以及時間,這使得成品的質量層次不齊,且難以批量化生產。隨著人工智能和生成式內容創造(AIGC)技術的進步,使得通過智能化手段批量制作優質視頻創意成為可能,并且能夠為客戶帶來顯著價值。

近日,OpenAI Sora 的發布讓人們看到了視頻智能創作的曙光,如今各大團隊也紛紛開始了“國產版 Sora”的探索之路,在 Sora 出現之前,阿里媽媽智能創作與AI應用團隊在視頻 AIGC 領域已有近一年的研究和探索,與業務相結合,我們孵化出了?? ??尺寸魔方??、商品視頻動效生成等基于擴散模型的視頻生成和編輯工具。本文將聚焦于商品視頻動效生成,介紹我們在視頻 AIGC 應用于視頻創意上的探索與實踐。

借助自研的AtomoVideo 視頻生成技術(中文:阿瞳木視頻,項目地址:https://atomo-video.github.io/),我們探索出了一種自動化地將電商平臺上現有的圖片素材轉換為高質量的視頻動效的方法,并在萬相實驗室、廣告投放平臺等場景進行了落地和上線,服務于廣大阿里媽媽廣告客戶。

|

|

|

|

2. 核心技術

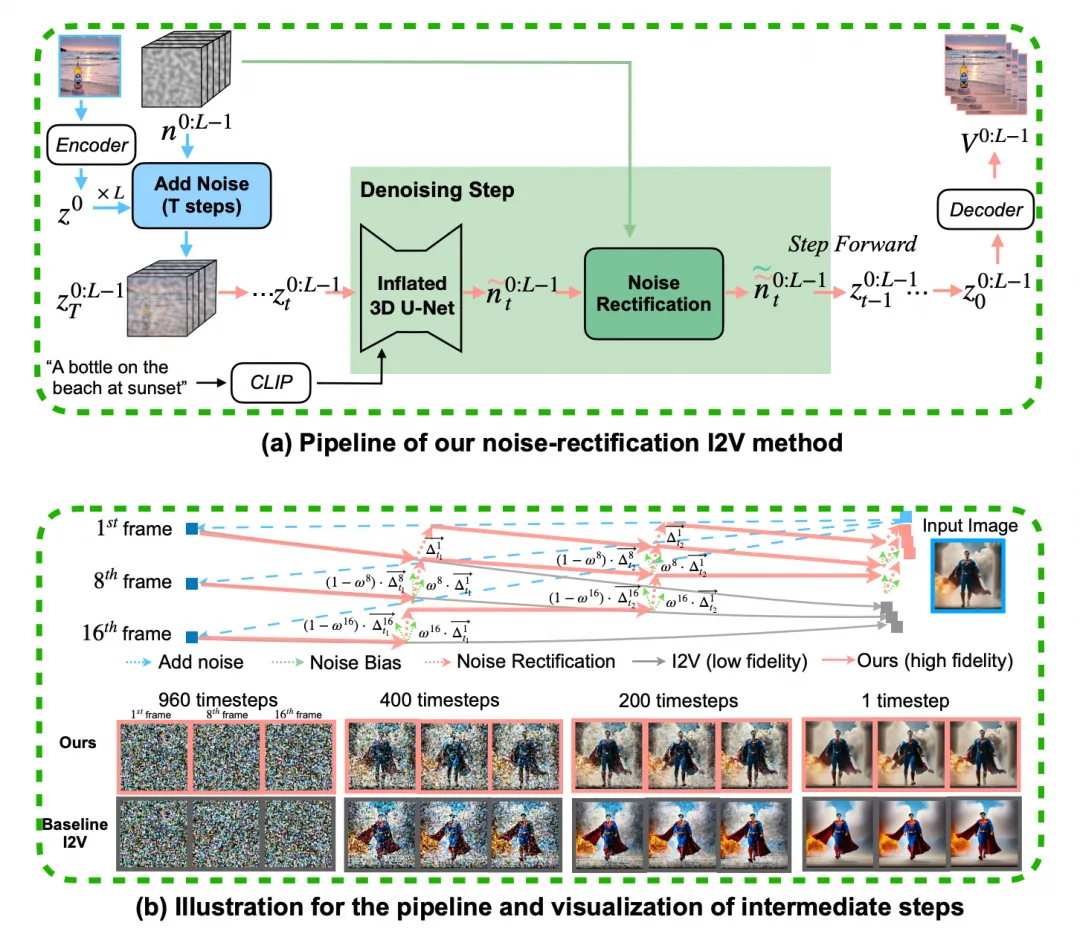

整個商品視頻動效的生成過程面臨諸多挑戰,尤其是在電商場景下,商品主體的細節是不允許被改變的,也是商家非常在意的基本準則。因此,如何在保持商品外觀準確性的同時進行更加合理的動效視頻生成,是非常值得探索的問題。我們在現有T2V模型的基礎上,提出使用 Noise Rectification(無需訓練的噪聲矯正器)來實現圖像到視頻的生成,為了進一步提升視頻連貫性和保真度,進而提出 AtomoVideo(阿瞳木視頻生成技術) 將基礎模型進行升級,賦能電商視頻動效生成。

2.1 Noise Rectification: 無需訓練的噪聲矯正器

文本到圖像生成(T2I)在過去一年取得了飛速的發展,諸多設計行業從業者、科技愛好者利用 Stable Diffusion WebUI、ComfyUI 等開源工具已經可以生成攝影級圖像和實現商業級落地應用。相比之下,受限于訓練機器資源和數據集收集困難等挑戰,視頻生成遠沒有圖像生成領域發展迅速,近半年,隨著 Pika、Gen-2 等視頻編輯工具的出現,社區中也涌現了許多文本到視頻生成(T2V)的工作,為了將此類 T2V 的工作遷移至我們的商品動效生成中,我們提出了一種無需訓練的噪聲矯正器(Noise Rectification),可以自然地實現 T2V 到 I2V 的轉變。

具體來說,我們對給定圖片添加一定步數的噪聲,以此來模擬訓練過程中的加噪過程,這樣我們便獲得了含有輸入圖像信息的噪聲先驗,在此基礎上進行降噪即可保留一定輸入圖片的風格等信息。然而,這種“墊圖”式 T2V 生成方式在電商領域對給定圖片做動效生成時,會丟失大量原圖像中的細節信息,嚴重破壞原有圖片的美觀度。為此,我們專門設計了一個與“墊圖”生成可以完美配合的噪聲矯正器(Noise Rectification),噪聲矯正器流程圖如下所示:

Noise Rectification示意圖

考慮到模型訓練無法達到完美損失,即模型預測噪聲總會存在偏差,從而導致視頻保真度的降低。為了緩解模型在 DDIM 去噪過程中的誤差累積(指實際添加的噪聲與每一步中模型預測的噪聲的差異),對于每一步模型預測的噪聲,我們利用初始采樣的噪聲,對其進行“噪聲矯正”,即 通過計算預測噪聲和真實噪聲之間的差異,采樣加權的計算方式對預測的噪聲進行適當調整。通過這種設計,我們的方案可以消除第一幀的噪聲誤差,使得第一幀達到完美保真,同時其余幀也會和第一幀保持時序內容上的一致。本方案提出的“墊圖+噪聲矯正”策略,不需要引入額外的訓練,直接作用于動效模型的推理階段,即可提高圖生視頻的保真度。更多技術細節請參見我們的論文:

- Title:Tuning-Free Noise Rectification for High Fidelity Image-to-Video Generation

- 鏈接:??https://arxiv.org/abs/2403.02827??

- 項目主頁:??https://noise-rectification.github.io/???

使用該方案后的前后對比效果如下,能夠明顯看到動效視頻與給定圖像一致性的提升,結合可控生成技術,我們可以完美還原商品細節。但這種針對 T2V 模型的噪聲校正策略在更多通用場景下會存在動效幅度較小的缺點,關于這一點的解決,我們將在下一章節進行介紹我們的改進。

輸入圖像 | 生成動效(直接墊圖生成) | 生成動效(使用Noise Rectification生成) |

|

|

|

|

|

|

2.2 AtomoVideo:高保真度的I2V模型升級

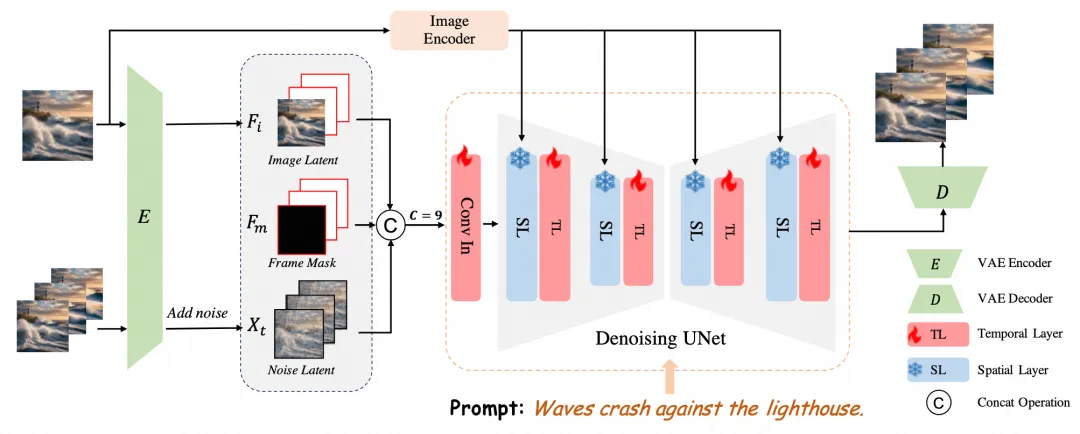

在商品信息注入和噪聲矯正器的加持下,商品動效生成已經具備了不錯的生成效果,我們也基于以上改進在萬相實驗室上線了動效生成模塊的第一版,但由于所使用的基礎模型為 T2V 模型,并非適用于本任務的 I2V 模型,且生成時長僅有2s,在淘內場景下使用受限。為此,我們專門研發了更適用于本任務的 I2V 基礎模型,稱為 AtomoVideo(中文:阿瞳木視頻),該模型對視頻的時序一致性和圖像保真度提升顯著,模型結構框架圖如圖所示:

AtomoVideo 模型結構圖

我們對模型做了如下幾個改進,包括優質數據集構建、多粒度圖像注入、漸進性動作強度訓練等。

1) 優質數據集構建:收集內部千萬規模的“文本-視頻”數據對,利用美觀度、文本視覺相關性、主體檢測(過濾人物視頻)、動效強度檢測等方式,清洗得到優質視頻數據子集,用于視頻生成模型訓練。同時我們與設計師合作構建了一個更加優質的數據集,匯集了大量在美觀度和動效質量上均表現出色的高清視頻。

2) 多粒度圖像注入:為增強 I2V 生成的圖像保真度和時序一致性,我們使用了多粒度的圖像注入方法,在擴散模型輸入側將圖像的low-level和high-level語義進行輸入,在我們實驗中,這可以在完美還原給定圖像保真度的同時,增加生成視頻的時序一致性。

3) 訓練方法:我們觀察到大多數其他工作(如Pika、Gen2等)很難生成動作幅度大的視頻,還有一些工作在生成動作幅度較大的視頻時,穩定性較差。為了克服這一點,我們使用了漸進性動作強度增加的多階段訓練方式,由低動效視頻數據集開始,逐步增加至高動效數據集進行訓練,我們發現這可以幫助模型在生成較大動作幅度視頻的同時,依然能夠維持較好的時序穩定性。

經過如上的改進和大規模訓練,我們將基礎模型升級為可產生4s,720P的視頻生成模型。更多相關細節可以閱讀我們的技術報告:

- Title:AtomoVideo: High Fidelity Image-to-Video Generation

- 鏈接:??http://arxiv.org/abs/2403.01800??

- 項目主頁:??https://atomo-video.github.io??

部分生成示例如下,更多示例可前往項目主頁瀏覽:

輸入圖片 | 輸入文本 | 輸出視頻 |

| Muppet walking down the street in a red shirt, cinematic. |

|

| Flying through an intense battle between pirate ships in a stormy ocean. |

|

| a singer of a music band |

|

此外,我們將I2V基礎模型的原始T2I模型部分進行了參數固定,而僅對新增的時序建模層和輸入層進行訓練,因此,我們可以將社區廣泛使用的圖像 ControlNet 與 AtomoVideo 進行結合,這也是我們相比于 SVD 等視頻開源模型的優勢。結合 T2I 領域預訓練好的 ControlNet,可以實現局部控制生成,以盡量還原商品細節,當前我們上線版本已全部切換為該模型。

2.3 動效場景模板適配

由于輸入商品圖像的質量一定程度會影響動效生成的效果,有較多圖片中并未包含任何動態元素,這種情況下,進行圖像到視頻的轉換顯得比較困難,容易產出“偏靜態”的視頻。因此,基于以上考量,我們與設計師共建了視頻動效場景模板,并針對每個不同的場景描述定制化了特殊的動態描述。其中視頻動效場景列表包含了諸如“山間云海”、“海底世界”等動態場景,同時在大促節日時,會專門設計一批用于節日宣傳的動態模板進行投放(如下圖是在38大促期間設計的兩個動效模板)。

場景模板名稱 | AIGC圖片 | 動效視頻 |

粉色煙花 |

|

|

粉色世界 |

|

|

3. 業務應用

當前,電商視頻動效生成已經在阿里媽媽-萬相實驗室(https://agi.taobao.com)和廣告投放平臺進行上線,支持廣告主在線生成視頻動效。以下是生成的一些樣例:

輸入圖片 | 動效視頻 |

|

|

|

|

|

|

|

|

|

|

|

|

4. 總結與展望

近半年,AIGC 視頻生成技術取得了令人矚目的飛躍發展。隨著 GEN-2、PIKA 1.0、Sora 等視頻創作工具和模型的出現,影視制作和多媒體設計等行業正迎來一場創造力的革新風暴,這些技術正在推動視頻內容制作向著更高的逼真度和更強的可控性邁進。本文介紹了我們團隊在視頻 AIGC 賦能視頻廣告創意的探索和實踐,通過基于擴散模型的視頻生成技術,結合可控生成技術,使得靜態電商圖片栩栩如生地“動”了起來,實現了在電商領域的視頻 AIGC 應用落地。

然而,目前的技術實現還遠未觸及視頻生成的真正潛力,在視頻畫面的穩定性、內容創造的可控性以及視頻時長等關鍵要素上,仍有很大的進步空間值得我們探索。Sora 的出現也讓我們看到了未來視頻創作工具大規模應用的曙光,Diffusion Transformer、Scaling Up 等關鍵技術給了我們很多啟發,在未來,希望不斷提升基礎模型生成效果的同時,用視頻 AIGC 技術賦能更多業務場景。

本文轉載自?? 阿里媽媽技術??,作者:智能創作與AI應用