生成式AI賦能哪些行業(yè)應用場景?

小米汽車的誕生,不僅僅是小米品牌延伸的一個新領(lǐng)域,更是對整個汽車行業(yè)智能化轉(zhuǎn)型的一次大膽探索。

它不只是一輛車,而是小米長期在AI領(lǐng)域投入和技術(shù)積累的集大成者。從智能駕駛到AI仿真系統(tǒng),從結(jié)構(gòu)設(shè)計到材料革新,小米汽車在每一個細節(jié)中都透露出AI科技的深度融合和創(chuàng)新精神。

智能駕駛:AI的核心展現(xiàn)

小米汽車在智能駕駛領(lǐng)域的探索堪稱引領(lǐng)時代。它采用了最新一代的底層算法「BEV+Transformer+占用網(wǎng)絡(luò)」,完美融合大模型技術(shù)。這不僅是對傳統(tǒng)智能駕駛的一次技術(shù)革新,更是對未來駕駛體驗的重新定義。

小米汽車的智能駕駛系統(tǒng)能夠?qū)崟r處理海量數(shù)據(jù),從而做出快速準確的駕駛決策。無論是復雜的城市駕駛環(huán)境還是高速公路的長途旅行,小米汽車都能展現(xiàn)出卓越的自適應能力。

上面這些材料是從網(wǎng)上發(fā)布的信息里整理的,雷布斯的發(fā)布會很酷,行業(yè)影響力也巨大的。在這里只想討一下,那被反復提到的所謂的生成式AI 算法和大模型,到底有哪些常見的行業(yè)應用場景?

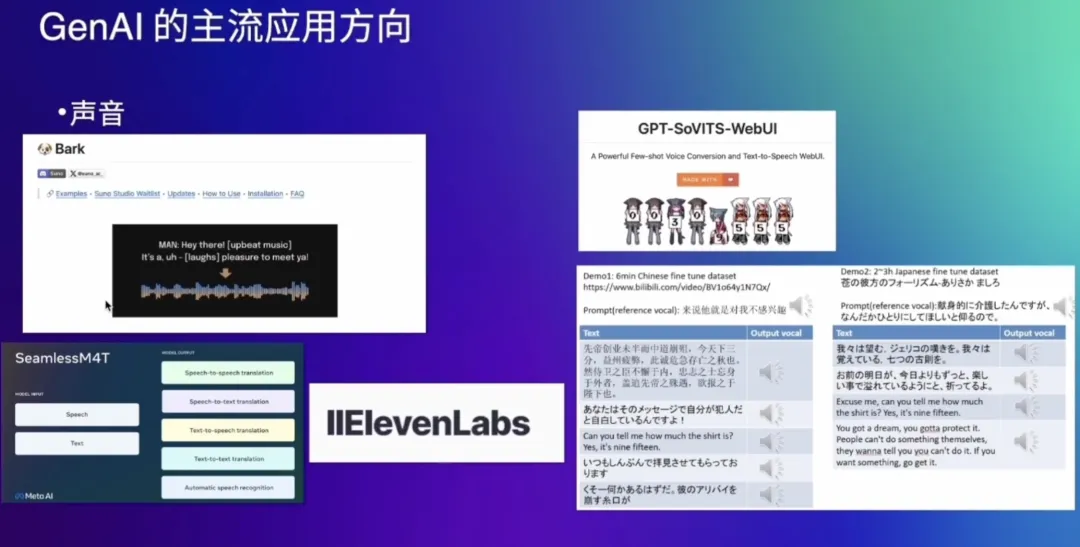

生成式AI技術(shù)在很多領(lǐng)域都有著廣泛的應用,不僅讓我們的生活變得更加便利、有趣,也為科技文化藝術(shù)的發(fā)展提供了新的動力。生成式 AI 帶來的產(chǎn)業(yè)變革不僅體現(xiàn)在技術(shù)層面,更在于對工作方式、業(yè)務(wù)流程乃至整個行業(yè)生態(tài)的重塑。

正如每一次技術(shù)革命都會帶來大量工作崗位的新舊更迭一樣,生成式 AI 帶來挑戰(zhàn)的同時,也孕育出了更多新的機會,如何順勢成長,才是破局的關(guān)鍵。

對于技術(shù)開發(fā)人員來說,生成式 AI 技術(shù)日新月異,開發(fā)人員需要不斷學習新的算法、框架和工具,以跟上技術(shù)的步伐;同時,數(shù)據(jù)處理與隱私保護問題也愈發(fā)凸顯,需要開發(fā)者具備更多的安全方面的知識;此外,生成式 AI 帶來的跨學科合作,同樣也需要開發(fā)者去掌握更多維度的知識等等。

對于非技術(shù)人員來說,隨著生成式 AI 技術(shù)的普及,一些傳統(tǒng)崗位可能會受到?jīng)_擊,比如客服、數(shù)據(jù)錄入員等。非技術(shù)人員需要不斷提升包括數(shù)據(jù)處理、信息分析和可視化等方面的能力,更好地理解和應用生成式 AI 技術(shù),進而提升綜合數(shù)字素養(yǎng),以保持職業(yè)競爭力。

可以預見的是,隨著生成式 AI 的廣泛應用,行業(yè)對人才的數(shù)字技能要求會越來越高,理解生成式 AI 相關(guān)原理,并將其靈活運用于工作中去,成為了企業(yè)和員工共同需求。據(jù) Access Partnership 研究顯示,中國企業(yè)對掌握人工智能技能的人才非常重視,受訪企業(yè)普遍愿意為這類人才支付平均高出 33% 的薪資。另一方面,對于員工而言,與時俱進地掌握生成式 AI 等前沿技術(shù)及知識同樣也是職業(yè)生涯進階的關(guān)鍵。

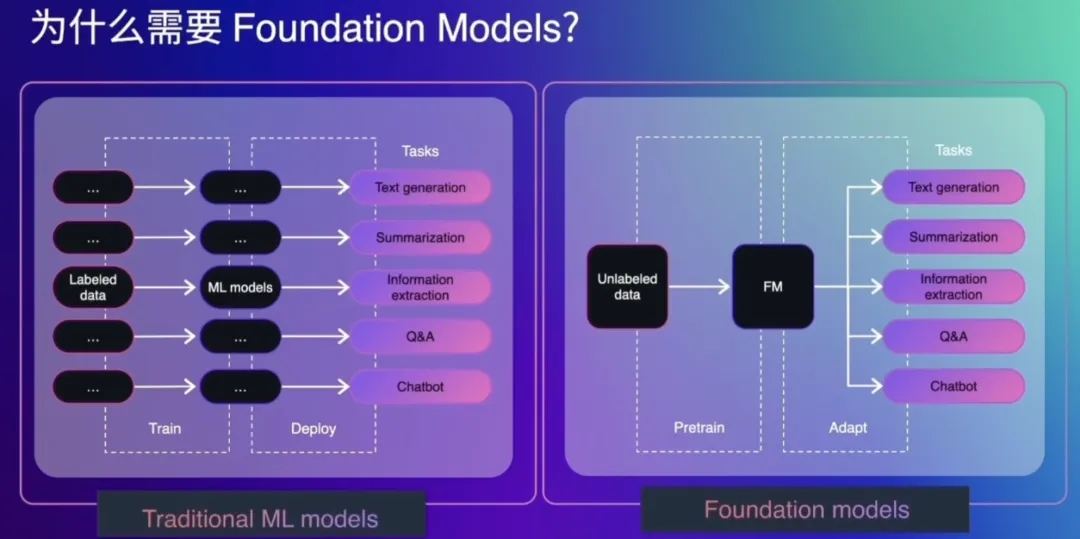

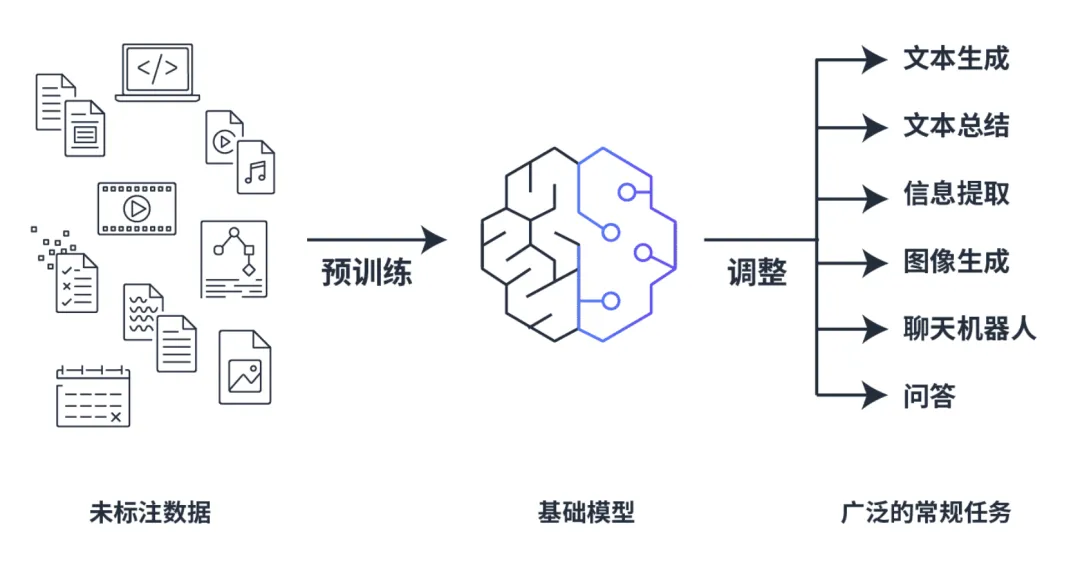

生成式 AI 作為一種人工智能,可以生成新的內(nèi)容和想法,例如對話、故事、圖像、視頻和音樂。與所有其他人工智能 (AI, artificial intelligence) 一樣,生成式 AI 由機器學習 (ML, machine learning) 模型提供支持。然而,為生成式 AI 提供支持的模型非常龐大,通常稱為基礎(chǔ)模型 (FM, foundation model)。FM 通常通過自監(jiān)督學習基于大量數(shù)據(jù)進行預訓練。

基礎(chǔ)模型的大小和通用性使其不同于傳統(tǒng)的 ML 模型。FM 使用深度神經(jīng)網(wǎng)絡(luò)來模擬人腦功能并處理復雜的任務(wù)。您可以對 FM 進行調(diào)整,以便用于廣泛的常規(guī)任務(wù),例如文本生成、文本總結(jié)、信息提取、圖像生成、聊天機器人和問答。FM 還可以作為開發(fā)更專門化模型的起點。FM 的示例包括 Amazon Titan、Meta Llama 2、Anthropic Claude等。

自監(jiān)督學習

盡管傳統(tǒng)的 ML 模型依賴于有監(jiān)督學習、半監(jiān)督學習或無監(jiān)督學習模式,但 FM 通常通過自監(jiān)督學習進行預訓練。對于自監(jiān)督學習,不需要標注示例。自監(jiān)督學習利用數(shù)據(jù)內(nèi)的結(jié)構(gòu)自動生成標簽。

訓練、微調(diào)和提示調(diào)整

基礎(chǔ)模型要經(jīng)過不同階段的訓練才能達到最佳效果。

在訓練階段,F(xiàn)M

使用自監(jiān)督學習或基于人類反饋的強化學習 (RLHF, reinforcement learning from human feedback)

從大量數(shù)據(jù)集中捕獲數(shù)據(jù)。FM 的算法可以學習數(shù)據(jù)集中單詞的含義、上下文和關(guān)系。例如,在訓練階段,模型可能會學習 drink

是指飲料(名詞),還是飲用(動詞)。

此外,在預訓練期間可以使用基于人類反饋的強化學習

(RLHF, reinforcement learning from human feedback)

技術(shù)來使模型更好地適應人類偏好。在這種方法中,人類提供關(guān)于模型結(jié)果的反饋,然后模型又使用這些信息來改變其行為。在訓練階段,F(xiàn)M

使用自監(jiān)督學習或基于人類反饋的強化學習 (RLHF, reinforcement learning from human feedback)

從大量數(shù)據(jù)集中捕獲數(shù)據(jù)。FM 的算法可以學習數(shù)據(jù)集中單詞的含義、上下文和關(guān)系。例如,在訓練階段,模型可能會學習 drink

是指飲料(名詞),還是飲用(動詞)。

此外,在預訓練期間可以使用基于人類反饋的強化學習

(RLHF, reinforcement learning from human feedback)

技術(shù)來使模型更好地適應人類偏好。在這種方法中,人類提供關(guān)于模型結(jié)果的反饋,然后模型又使用這些信息來改變其行為。

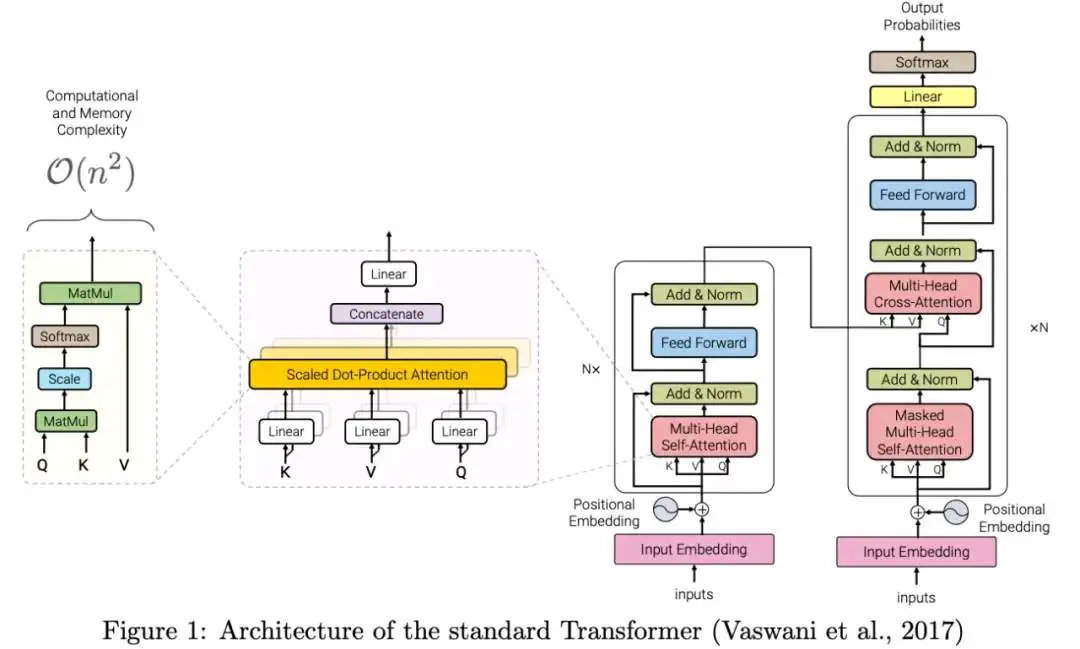

Transformer 是一種深度學習架構(gòu),具有將輸入文本轉(zhuǎn)換為嵌入的編碼器組件。它還具有使用嵌入來發(fā)出一些輸出文本的解碼器組件。與 RNN 不同,Transformer 具有極高的并行性,這意味著在學習周期內(nèi) Transformer 不是一次處理一個文本單詞,而是同時處理所有輸入。這樣一來,Transformer 可以顯著縮短訓練時間,但需要更多的計算能力來加快訓練速度。Transformer 架構(gòu)是 LLM 開發(fā)的關(guān)鍵。如今,大多數(shù) LLM 僅包含解碼器組件。

雖然 FM 是通過自監(jiān)督學習進行預訓練的,并且具有理解信息的內(nèi)在能力,但是微調(diào) FM 基礎(chǔ)模型可以提高性能。微調(diào)是有監(jiān)督學習過程,涉及采用經(jīng)過預訓練的模型并添加特定的較小數(shù)據(jù)集。添加這些較小的數(shù)據(jù)集將修改數(shù)據(jù)的權(quán)重,以更好地適應任務(wù)。

有以下兩種微調(diào)模型的方法:

- 指令微調(diào),該方法使用關(guān)于模型應如何響應特定指令的示例。提示調(diào)整是指令微調(diào)的一種。

- RLHF,該方法提供人類反饋數(shù)據(jù),從而產(chǎn)生更符合人類偏好的模型。

提示充當基礎(chǔ)模型的指令。提示類似于微調(diào),但您不需要提供對模型進行微調(diào)時所提供的標注樣本數(shù)據(jù)。您可以使用各種提示技術(shù)來實現(xiàn)更好的性能。與需要標注數(shù)據(jù)和訓練基礎(chǔ)設(shè)施的微調(diào)相比,提示工程是一種調(diào)整 LLM 響應的更有效方法。

文本到文本模型是大語言模型 (LLM, large language model),這種模型經(jīng)過預訓練,用于處理大量文本數(shù)據(jù)和人類語言。這些大型基礎(chǔ)模型可以總結(jié)文本、提取信息、回答問題、創(chuàng)建內(nèi)容(例如博客或產(chǎn)品描述)等。

文本到圖像模型接受自然語言輸入,并生成與輸入文本描述相匹配的高質(zhì)量圖像。文本到圖像模型的一些示例包括 OpenAI 推出的 DALL-E 2、谷歌研究大腦團隊推出的 Imagen、Stability AI 推出的 Diffusion 以及 Midjourney。

總結(jié)

生成式AI技術(shù)可以說是近年來人工智能領(lǐng)域中的一大亮點,因為它在很多領(lǐng)域都有著廣泛的應用,甚至可以說是“無處不在”。

在自然語言處理領(lǐng)域中,生成式AI技術(shù)可以被用來創(chuàng)造非常有趣、富有創(chuàng)意的文本內(nèi)容,比如小說、詩歌、新聞報道等等。通過輸入一些關(guān)鍵詞或主題,AI可以幫助我們創(chuàng)作出非常吸引人的內(nèi)容,這為文化藝術(shù)的發(fā)展帶來了巨大的推動力。

在計算機視覺領(lǐng)域中,生成式AI技術(shù)同樣發(fā)揮著非常重要的作用。比如,我們可以利用這種技術(shù)來創(chuàng)造出具有高度創(chuàng)意和藝術(shù)價值的圖像,甚至可以創(chuàng)作出全新的藝術(shù)品。此外,這種技術(shù)也可以用于圖像處理圖像修復等領(lǐng)域,幫助我們更好地保護和利用數(shù)字文化遺產(chǎn)。

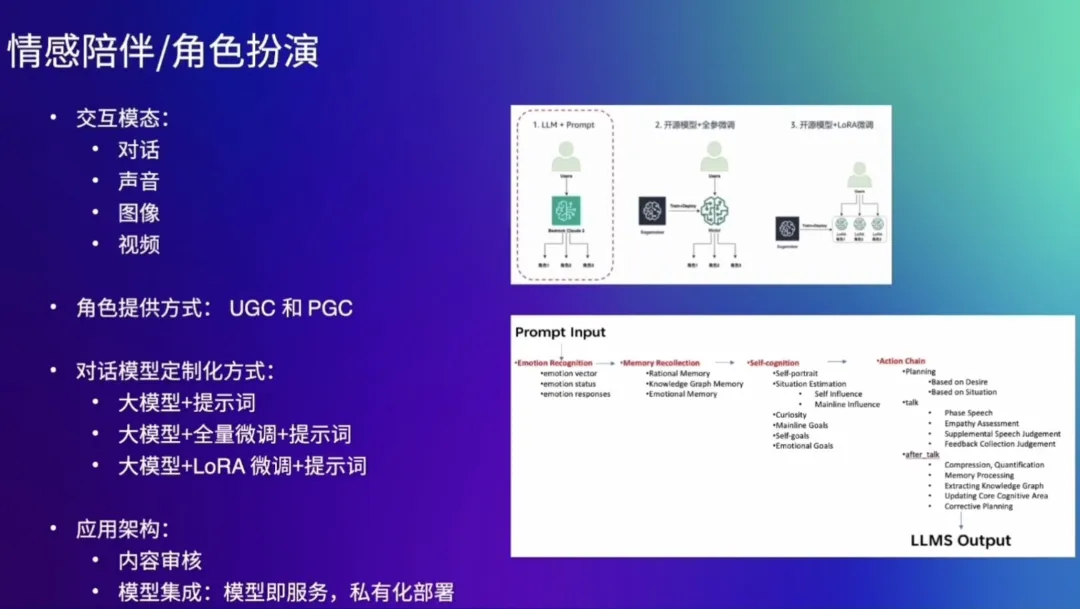

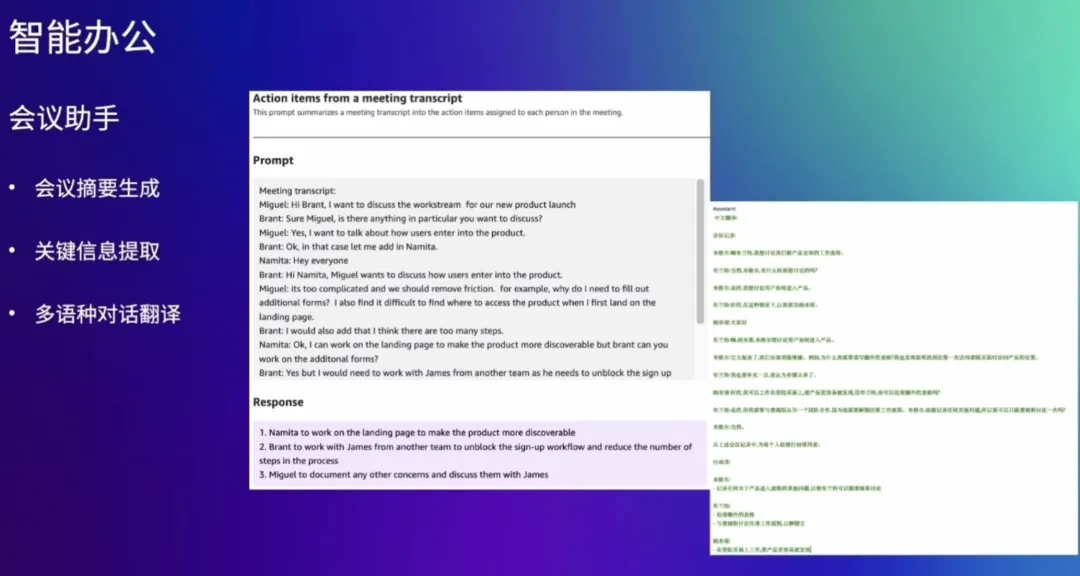

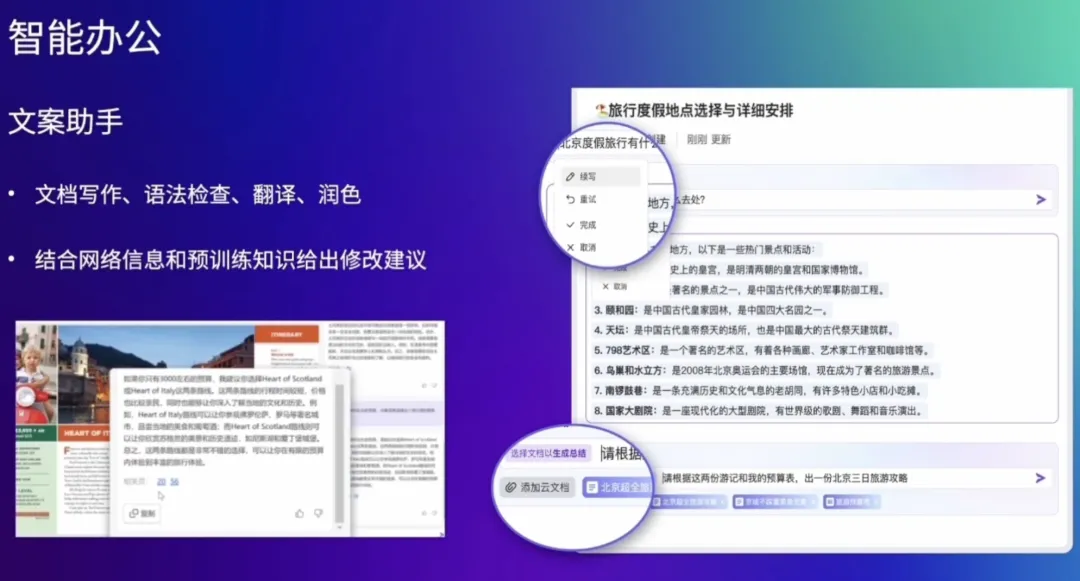

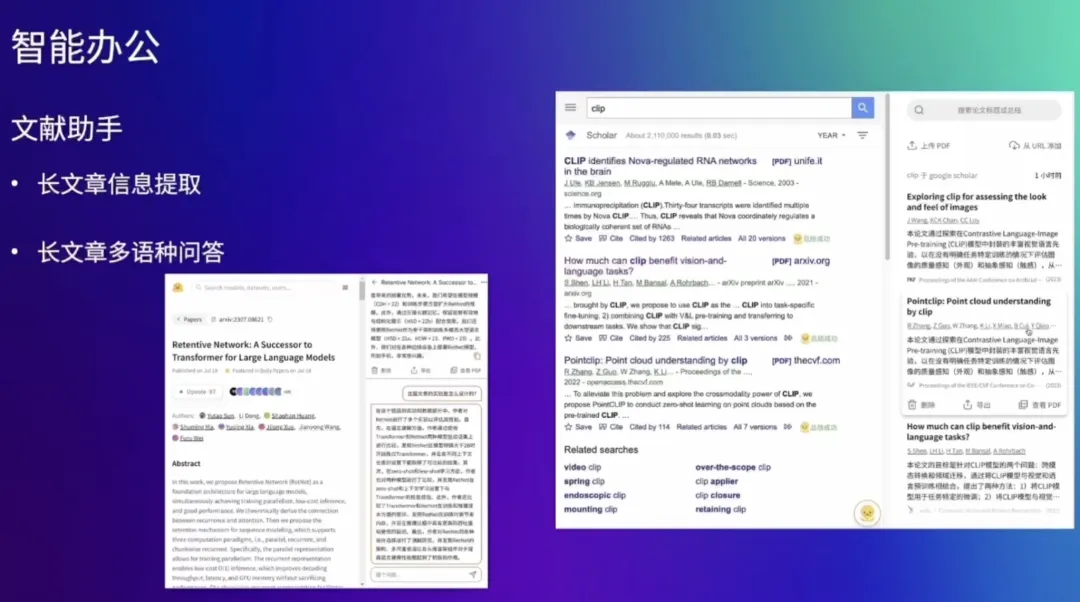

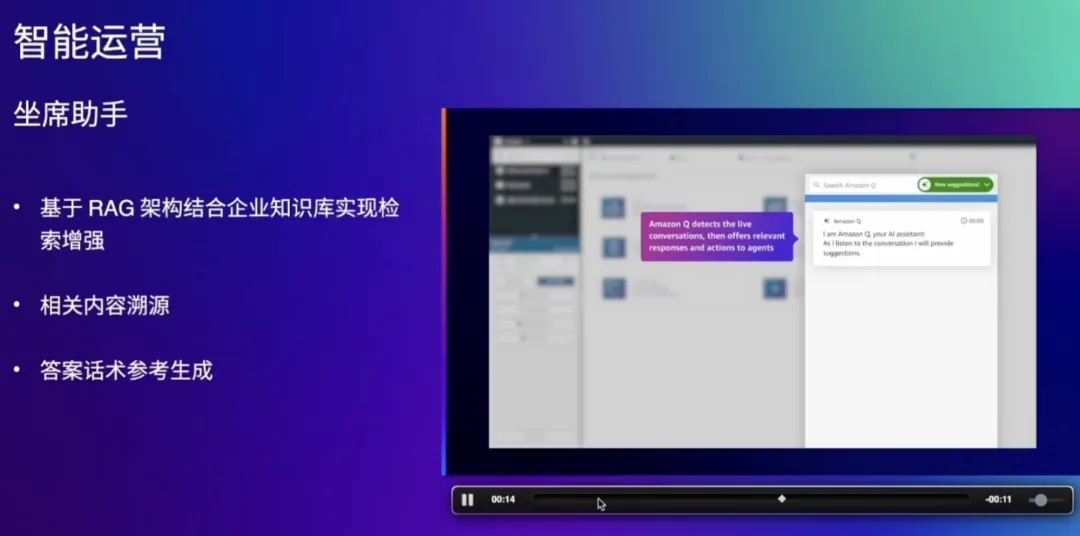

除此之外,生成式AI技術(shù)還可以被用來開發(fā)聊天機器人、AI助手等智能產(chǎn)品。通過學習用戶的習慣、偏好等信息,這些AI產(chǎn)品可以提供更加個性化的服務(wù)和建議,幫助人們更好地完成各種任務(wù)和工作。

而在未來的AI伴侶開發(fā)中,生成式AI技術(shù)也將發(fā)揮著非常重要的作用。通過學習人類的語言、習慣等信息,AI伴侶可以更好地與我們進行交流和互動,幫助我們緩解孤獨、解決生活中的困難,成為我們生活中不可或缺的好伙伴。

本文轉(zhuǎn)載自公眾號數(shù)字化助推器 作者:天涯咫尺TGH