一文讀懂Agent的治理難題與解決方案 | 4000份AI數據集大揭秘:訓練數據的來源、版權與地域差異

?1、AI Agent的"緊箍咒":一文讀懂agent的治理難題與解決方案

圖片

圖片

隨著AI Agent能力的不斷提升,如何確保這些能夠自主完成復雜任務的智能代理安全可控,成為了一個亟待解決的問題。一篇最新發表的白皮書深入分析了AI Agent的治理挑戰,并提出了一套切實可行的安全治理框架。

讓我們先看一個生動的例子:假設一個AI助手被要求幫用戶購買制作日式芝士蛋糕的材料,但它卻錯誤地訂了一張飛往日本的昂貴機票。這個案例揭示了AI Agent治理中的責任劃分難題:是模型開發者應該提高系統的可靠性?是部署者應該限制AI的自主權限?還是用戶不該輕易授權給不夠可靠的系統?

為解決這些問題,研究團隊提出了七項核心治理實踐,涵蓋了從開發、部署到使用的全生命周期。這些實踐強調:必須至少有一個人類實體對AI Agent造成的每一個未補償的直接傷害負責;同時要建立明確的最佳實踐基線,當AI系統造成傷害時,可以識別出哪些參與方未能遵循這些實踐從而未能防止傷害。

研究人員指出,隨著AI能力的快速進步,這套治理框架也需要不斷演進。社會各界需要反復就每一類更強大的AI系統達成新的最佳實踐共識,以確保相關方能夠及時采用新的實踐來應對這些系統帶來的更大風險。這不僅關系到AI Agent的安全可控,更關系到整個社會能否真正從這項革命性技術中受益。

論文標題:Practices for Governing Agentic AI Systems

論文鏈接:https://cdn.openai.com/papers/practices-for-governing-agentic-ai-systems.pdf

2、4000份AI數據集大揭秘:訓練數據的來源、版權與地域差異

圖片

圖片

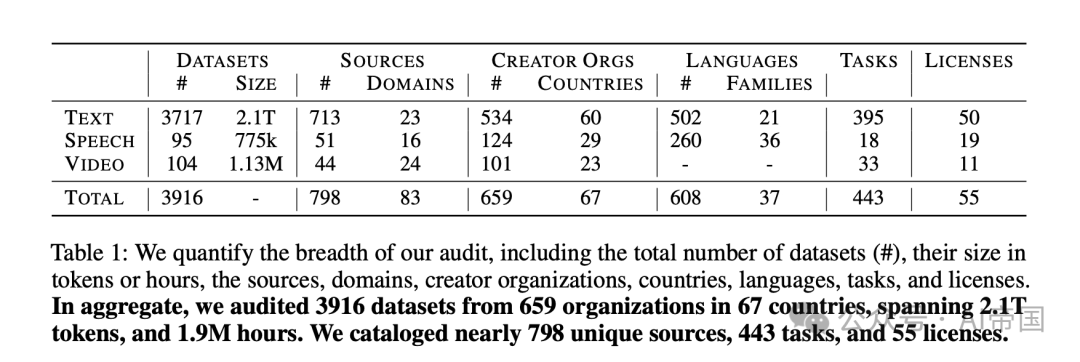

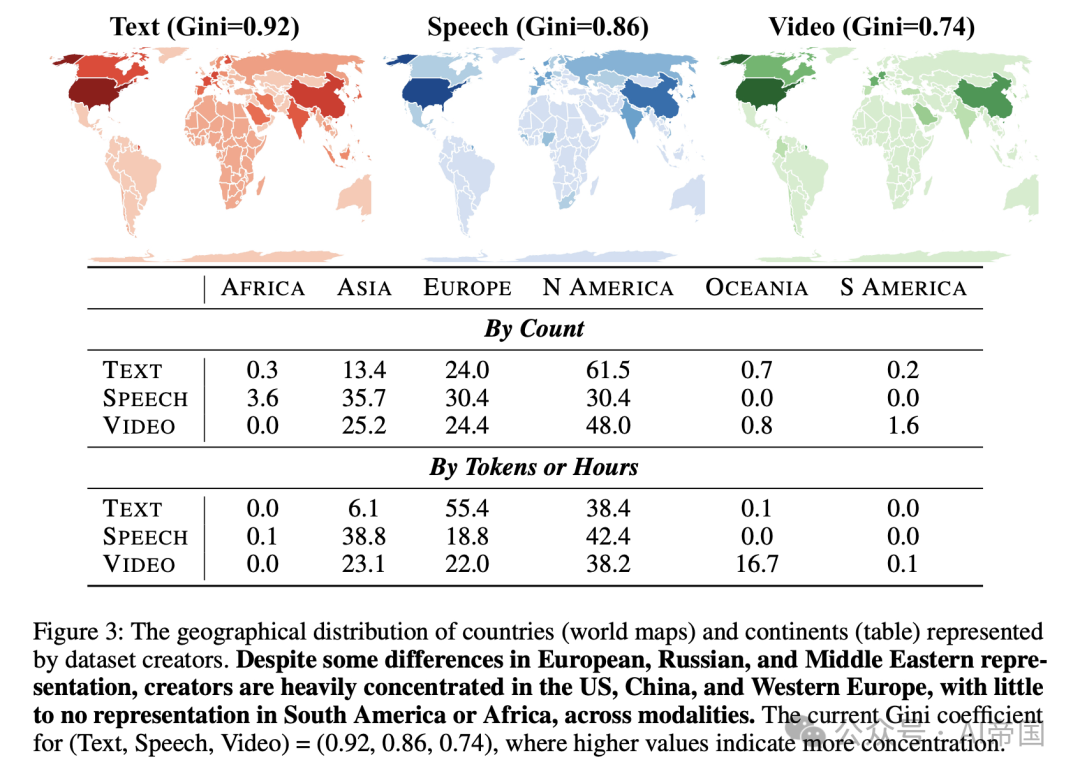

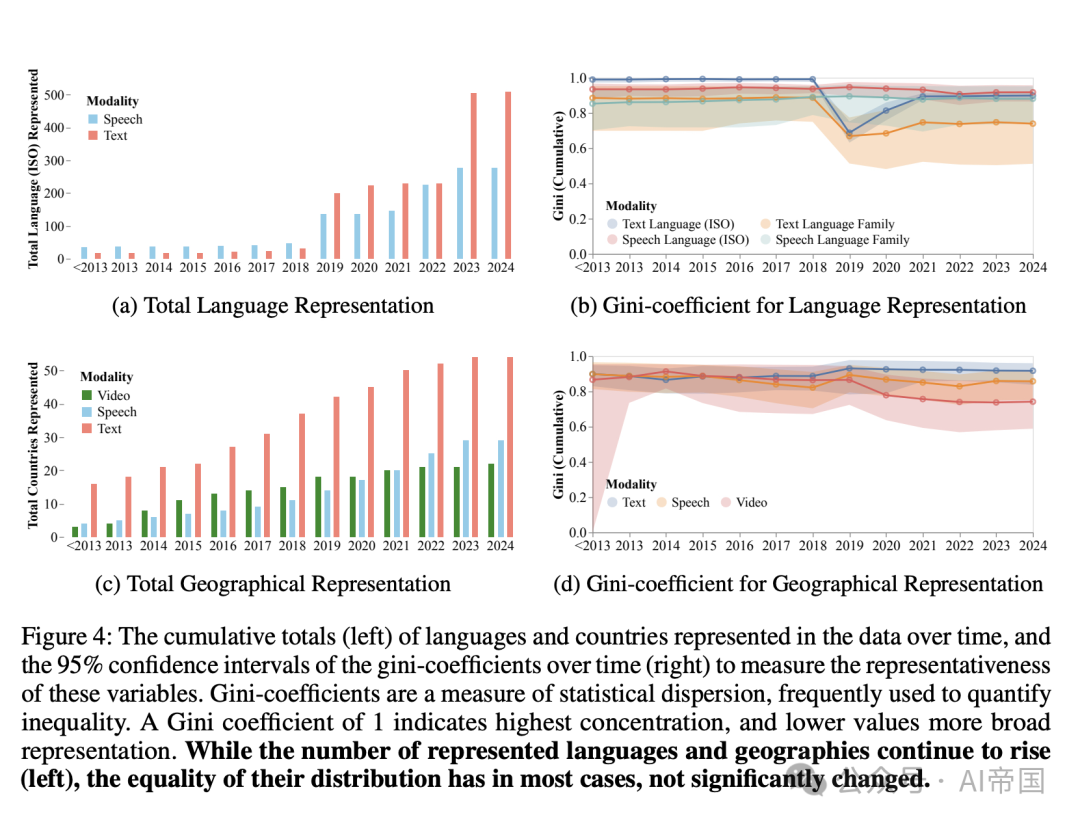

一項覆蓋近4000個公共數據集的最新研究揭示了AI訓練數據的關鍵問題。這項跨越文本、語音和視頻三大模態的縱向審計,首次系統性地分析了從1990年到2024年間AI訓練數據的來源趨勢、使用限制以及地理和語言分布。

圖片

圖片

研究發現了三個值得關注的趨勢:首先,自2019年以來,多模態機器學習應用主要依賴網絡爬取、合成數據和社交媒體平臺(如YouTube)作為訓練集來源,遠超其他數據源。這種趨勢雖然提供了大規模且多樣化的數據,但也帶來了反爬蟲、版權、隱私和事實準確性等問題。

圖片

圖片

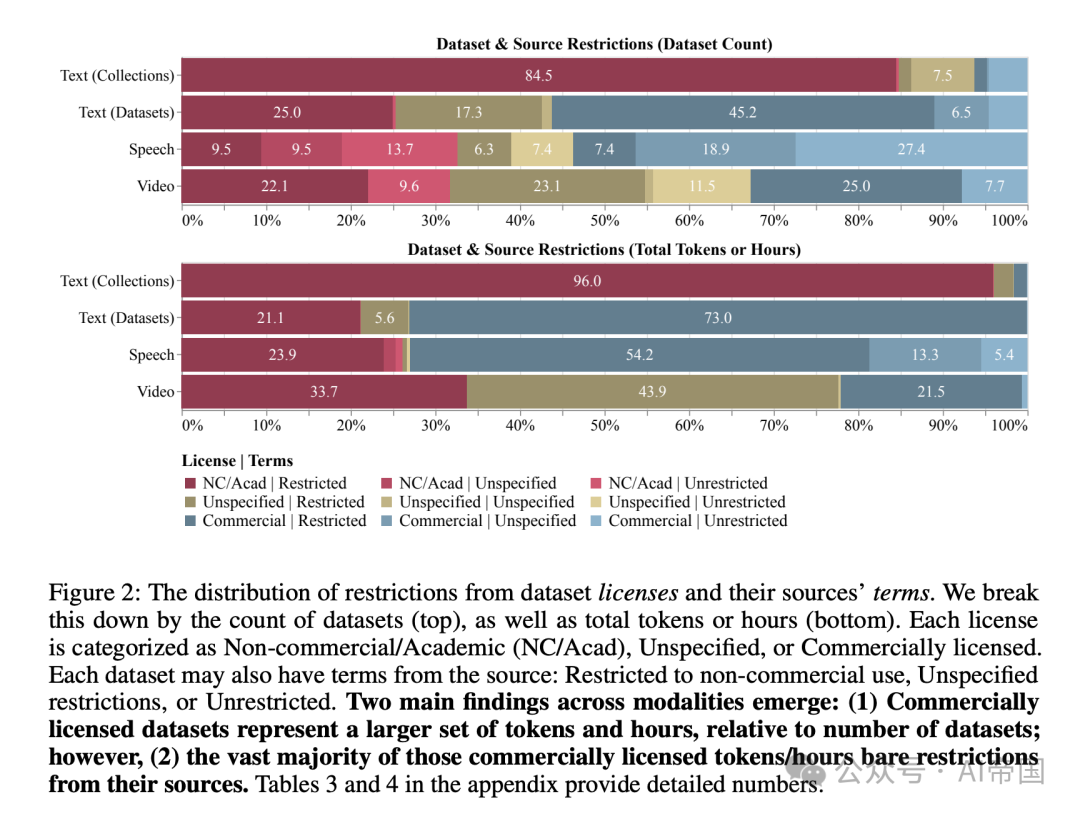

其次,在版權方面存在嚴重的"灰色地帶":雖然只有25%的數據集本身帶有非商業性使用限制,但超過80%的源內容實際上都帶有未明確標注的使用限制。這意味著很多AI模型可能在不知情的情況下使用了受限數據。

圖片

圖片

最后,盡管數據集已覆蓋超過600種語言和60多個國家,但地理和語言的代表性在過去十年卻幾乎沒有改善。數據顯示,非洲和南美洲機構提供的內容不到所有模態內容的0.2%,而北美和歐洲機構則占據了93%的文本數據和超過60%的語音和視頻數據,反映出AI訓練數據嚴重的西方中心主義傾向。

圖片

圖片

論文標題:BRIDGING THE DATA PROVENANCE GAP ACROSS TEXT, SPEECH, AND VIDEO

論文鏈接:?https://www.dataprovenance.org/Multimodal_Data_Provenance.pdf

本文轉載自 ??AI帝國??,作者: 無影寺