為什么Transformer難以學會搜索?一項新研究揭示關鍵原因 | 從優勢到局限:大型語言模型的潛力與邊界

大模型領域的發展日新月異,每天都有許多有趣的論文值得深入品讀。下面是本期的論文:

1、為什么Transformer難以學會搜索?一項新研究揭示關鍵原因

圖片

圖片

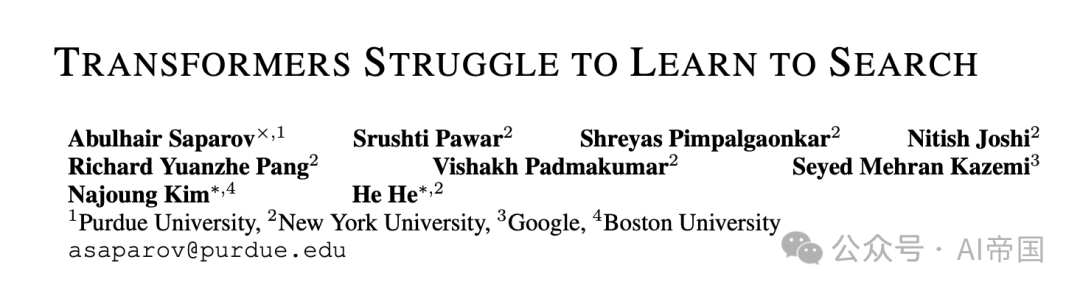

搜索是許多重要任務(如推理、規劃和導航)的核心能力,但最新研究表明,Transformer架構的大模型在搜索任務上表現不佳。那么,這是數據不足、模型參數不夠,還是Transformer架構本身的限制?為探究這一問題,研究者采用了一個基礎的圖連通性問題作為測試平臺,深入分析Transformer的搜索能力。

圖片

圖片

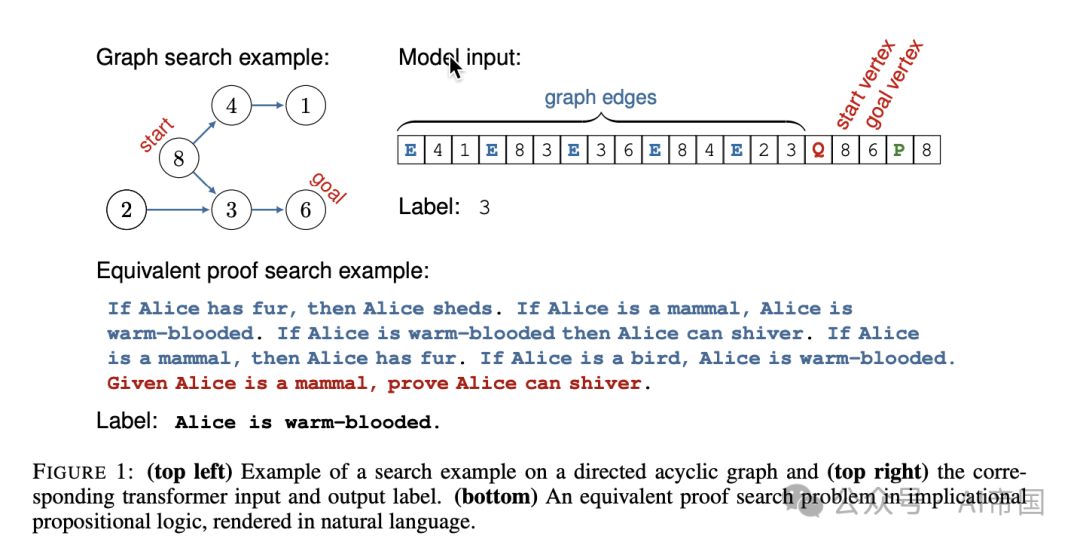

首先,這項研究設計了一個實驗框架,通過生成無窮多高覆蓋率的數據來訓練小型Transformer模型,模擬搜索任務。這些任務基于有向無環圖(DAG),要求模型從起點到目標點找到路徑上的下一節點。研究發現,Transformer在特定的訓練數據分布下能夠學會搜索,并能通過層層遞歸擴展可達節點集,實現指數級的搜索能力。然而,當圖的規模擴大時,Transformer的學習能力迅速下降,即便增加模型參數規模也無濟于事。這表明,單純依靠模型的擴展并不足以提升其搜索能力。

圖片

圖片

圖片

圖片

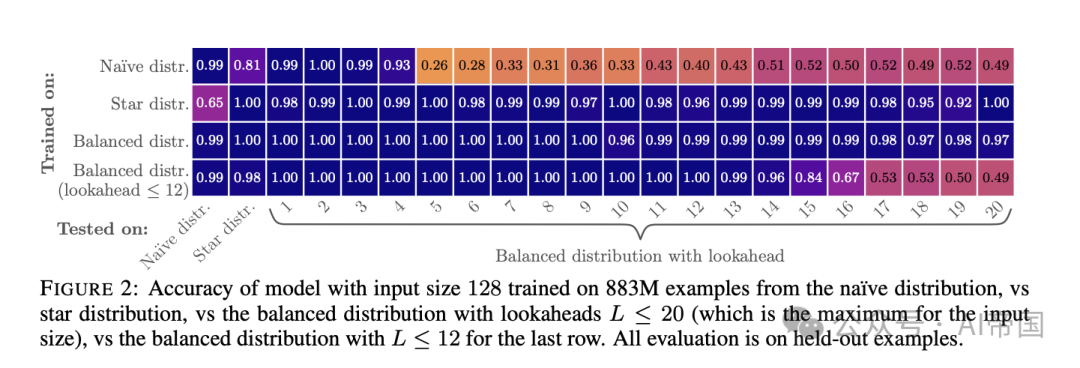

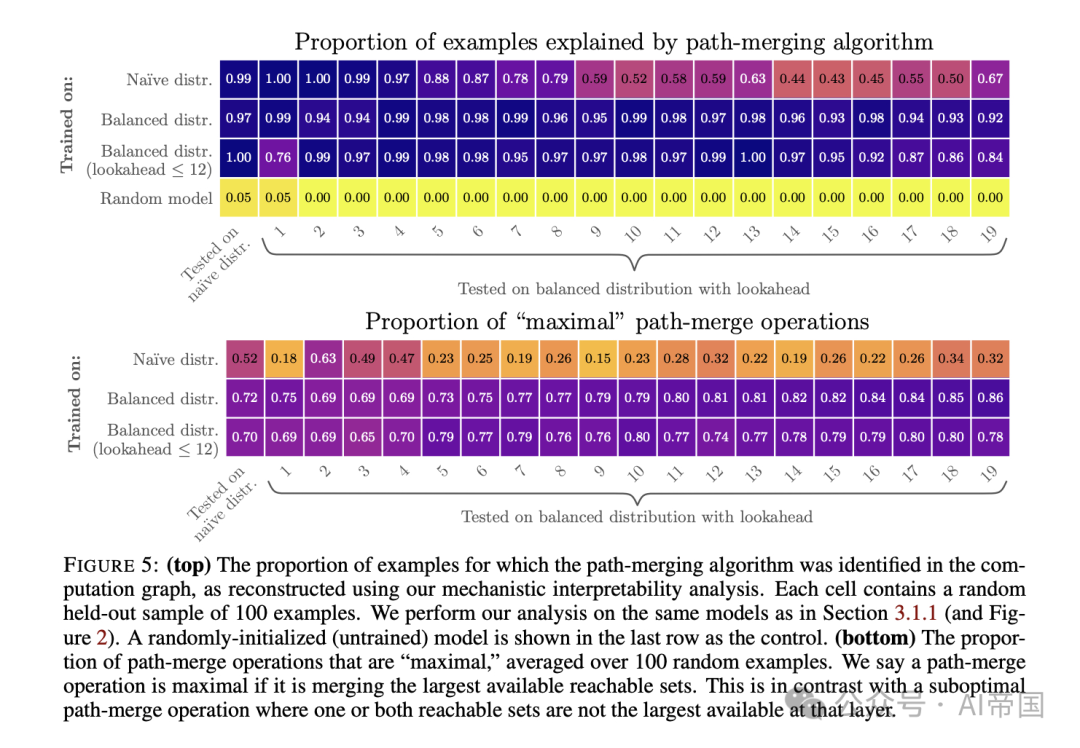

更進一步,研究開發了一種全新的可解釋性分析方法,能夠提取模型學習到的算法。分析發現,Transformer通過一種路徑合并算法完成搜索,每個頂點的表示存儲了從該頂點可達的頂點集。盡管這一方法適用于小規模圖,但在面對更復雜的搜索任務時,模型依然表現出明顯的局限性。即使使用鏈式思維提示(Chain-of-Thought)等技術,模型在大規模圖上的表現仍然不盡如人意。

圖片

圖片

這項研究揭示了Transformer在搜索任務上的局限性,提出僅靠規模擴展無法解決問題,未來或許需要探索更有效的訓練方法(如課程學習)或替代架構(如循環式Transformer)。此外,研究中開發的可解釋性工具還有望應用于其他推理任務,幫助揭示Transformer在解決復雜任務時學到的底層算法。

這篇論文提醒我們,Transformer雖然強大,但在特定任務中可能需要更多創新性方法才能突破現有的性能瓶頸。

論文標題:Transformers Struggle to Learn to Search

論文鏈接:https://arxiv.org/abs/2412.04703

2、從優勢到局限:大型語言模型的潛力與邊界

圖片

圖片

大型語言模型能做什么?

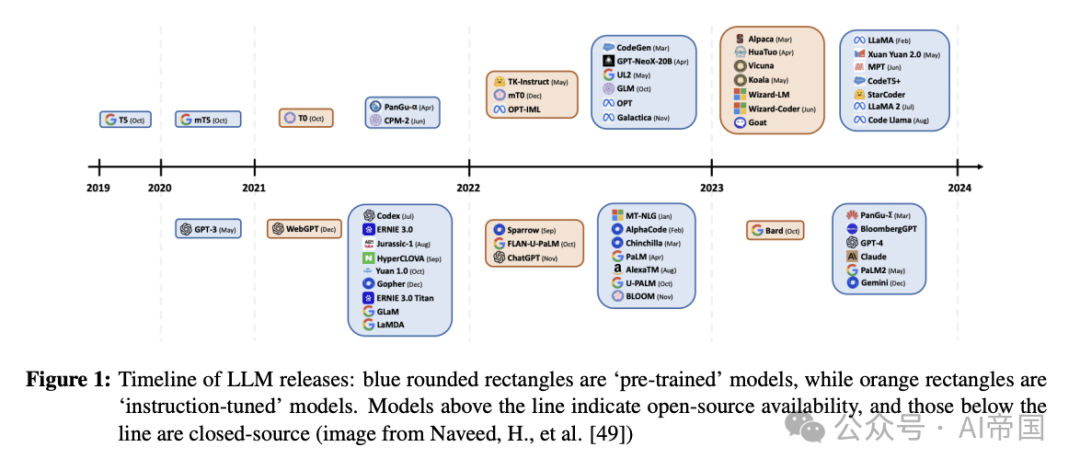

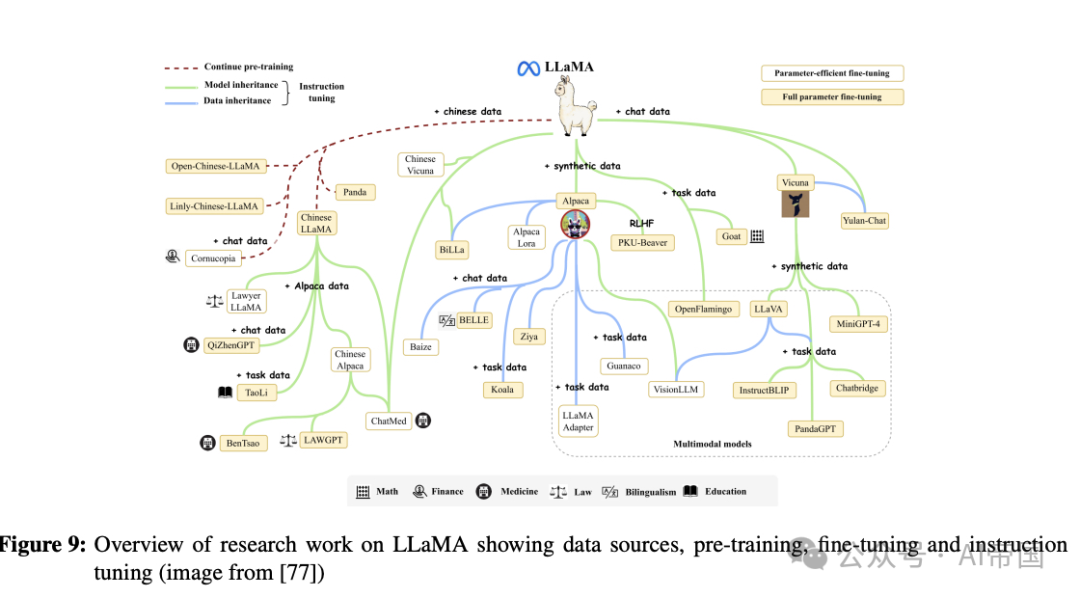

人工智能技術正全面融入我們的生活與工作,其中大型語言模型(LLMs)尤為引人注目。它們不僅能生成流暢自然的文本,還能在復雜場景中表現出令人印象深刻的推理能力。例如,通過理論測試(Theory of Mind)和圖靈測試,LLMs展示了接近人類認知的能力。然而,它們的應用也伴隨爭議——既有對潛在創造力的期待,也有對錯誤和偏見的擔憂。這些模型的獨特之處在于,它們既可以“開箱即用”,也可以通過與傳統技術結合,定制化解決實際問題。

圖片

圖片

局限與挑戰:AI并非完美的答案

盡管LLMs在許多領域表現卓越,但它們并非萬能。例如,這些模型缺乏真正的“自我意識”和對環境的實時更新能力,僅能模擬語言模式。此外,模型訓練數據中可能包含偏見或不適當內容,這些問題可能在生成結果中被放大。論文還詳細討論了“越獄攻擊”(Jailbreak Attacks),即通過巧妙提示繞過模型內置的安全限制,從而生成不當或違法內容的風險。

圖片

圖片

如何應對局限?

為了應對上述問題,研究者提出了多種方法:一方面通過構建挑戰數據集(如CrowSPairs)評估模型中的偏見,另一方面開發新型技術,如液態神經網絡(Liquid Neural Networks)和優化硬件(如Groq語言處理單元),以提升模型的效率、適應性和安全性。這些進展不僅讓技術更加靈活,還將其推廣到更廣泛的日常場景中。

技術發展的未來:機遇與警示并存

LLMs的快速發展讓人興奮,也提醒我們要時刻關注其局限性與潛在風險。未來,持續評估模型表現、優化訓練方法和硬件架構,是保障技術穩定性和適用性的關鍵。論文還預測,這些技術將逐步變得更加高效、經濟,甚至可能在普通設備上普及,為社會帶來更便捷的應用體驗。

論文標題:A Primer on Large Language Models and their Limitations

論文鏈接:?https://arxiv.org/abs/2412.04503

本文轉載自 AI帝國,作者: 無影寺