信我,有你想要的!最大化DeepSeek潛能:動態注意力機制

deepseek原理+應用+實踐,和大家分享:

- 小眾的,deepseek核心技術原理;

- 大眾的,提示詞要怎么寫;

今天和大家聊聊,deepseek的核心技術之一的動態注意力機制。

要搞懂這個,先得知道什么是注意力機制?

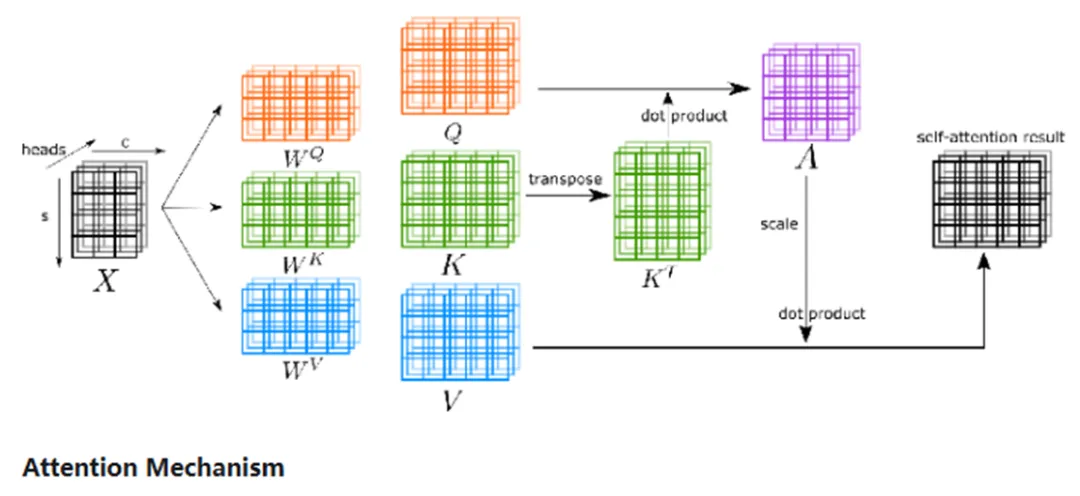

這是一種通過計算…查詢向量(Query)…鍵向量(Key)…值向量(Value)…,最終得到...的技術。

畫外音:額,不折磨大家了。

注意力機制,Attention Mechanism,是如今AI最核心的技術(之一)。通俗地說,它允許模型在處理信息時,專注于最關鍵的部分,弱化甚至忽略不相關的信息,從而提高處理效率與回復的質量。它通過注意力分數,來量化描述某一部分信息被關注的程度,以反映相關信息在全局中的重要性。

舉個例子,用戶輸入提示詞:

哎喲媽呀,我跟你說,那啥,我今天早上出門,這天兒可夠冷的,那風嗖嗖的,吹得我臉都僵了,我尋思著,咋這么冷呢,是不是把厚棉襖穿少了,你說這天兒咋就那么邪乎呢,反正我這心里尋思著,哪兒能去買個暖寶寶貼貼。

這個提示詞中包含大量日常交流習慣中的鋪墊與情感表達,屬于無效信息。注意力機制會讓模型將注意力專注在:今天早上很冷,我穿少了,哪兒能買暖寶寶?

注意力機制是什么來的?

注意力機制最符合人的真實思維。

再舉個例子:

第一眼看到一張圖片,你的注意力在哪兒,每個像素的權重是一樣的嗎?是不是一眼就會看到框中的耳環,根本不會注意到其他部位。

這!就是神奇的注意力機制。

那什么是動態注意力機制?

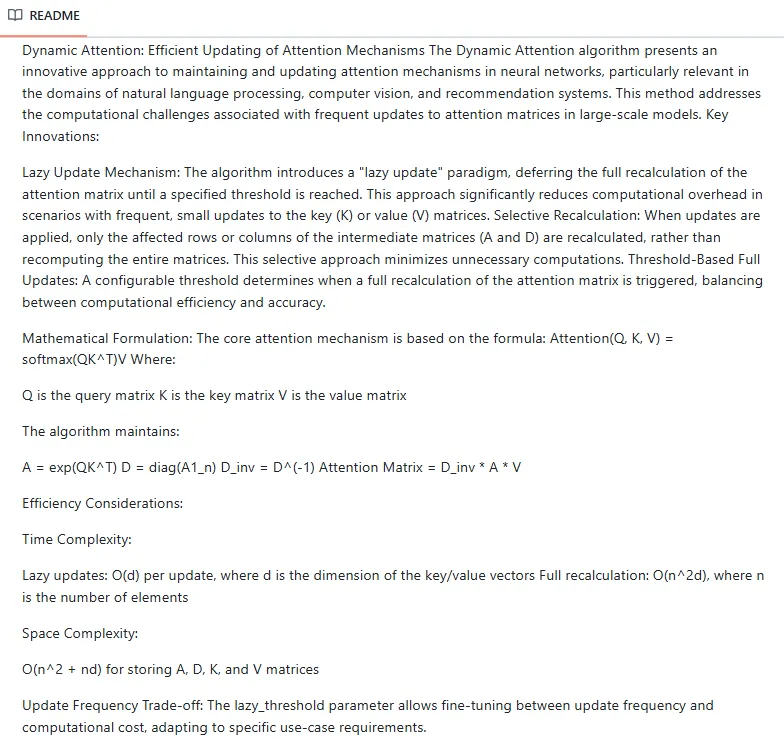

Dynamic Attention,要比注意力機制更進一步,它不僅能夠學習到不同部分的相關性,還能在處理過程中自適應的調整注意力的分配,把資源聚焦于當下最重要的部分,使得模型更加智能(例如:文本,代碼,圖表在計算過程中權重會動態變化)。

技術人應該很容易理解這個所謂的“動態”:

- 負載均衡 -> 根據歷史數據學習訓練好參數,3臺機器的流量分配權重配置好1:2:3。

- 動態負載均衡 -> 在系統運行過程中,根據3臺機器處理能力,動態變化流量分配權重。

動態注意力機制,對我們寫提示詞,獲取更佳的回答質量有什么啟示呢?

我們可以在提示詞中:

1. 顯性的標注關鍵信息,例如:

- 角色

- 技能

- 限制

- 步驟

2. 顯示設置約束條件,例如:

- 優先考慮方案的分區容忍性與高可用

- 先不考慮內網延時對方案的影響

3. 采用分層分步描述,讓deepseek清楚每一步的注意力重點,例如:

- 第一步… 第二步… 第三步…

- 先設計框架,再填充細節

- 給出3組方案量化分析與優缺點后,經過我確認選擇哪一組方案再繼續

優化了提示詞,deepseek動態注意力機制能更有效發揮:

- 有限深度思考時間,專注主要矛盾,增加分析維度,回復質量極大提升;

- 相同質量的回復,動態分配權重,極大降低計算消耗;

總結

- 動態注意力機制是deepseek的核心技術(之一);

- 注意力機制最符合人的真實思維;

- 所謂“動態”,是指在運行過程中的注意力變化;

- 通過顯性標注關鍵信息,顯性設置約束條件,顯性分層分步描述,能夠最大化發揮deepseek動態注意力機制的潛力;

一切的一切,提示詞只有適配了AI的認知模式,才能最高效的發揮最大的作用。

知其然,知其所以然。

思路比結論更重要。

補充閱讀材料:

《Attention Is All You Need》:https://arxiv.org/pdf/1706.03762

PDF,可下載。

《動態注意力機制》:https://github.com/davidangularme/DynamicAttention

含源碼,Python。