Github熱門機器學習筆記:「從零構建大型語言模型」

作者:AIGC Studio

這份筆記完美展示了從零構建LLM的技術路線圖,既有理論深度,又包含實踐要點。

本文經AIGC Studio公眾號授權轉載,轉載請聯系出處。

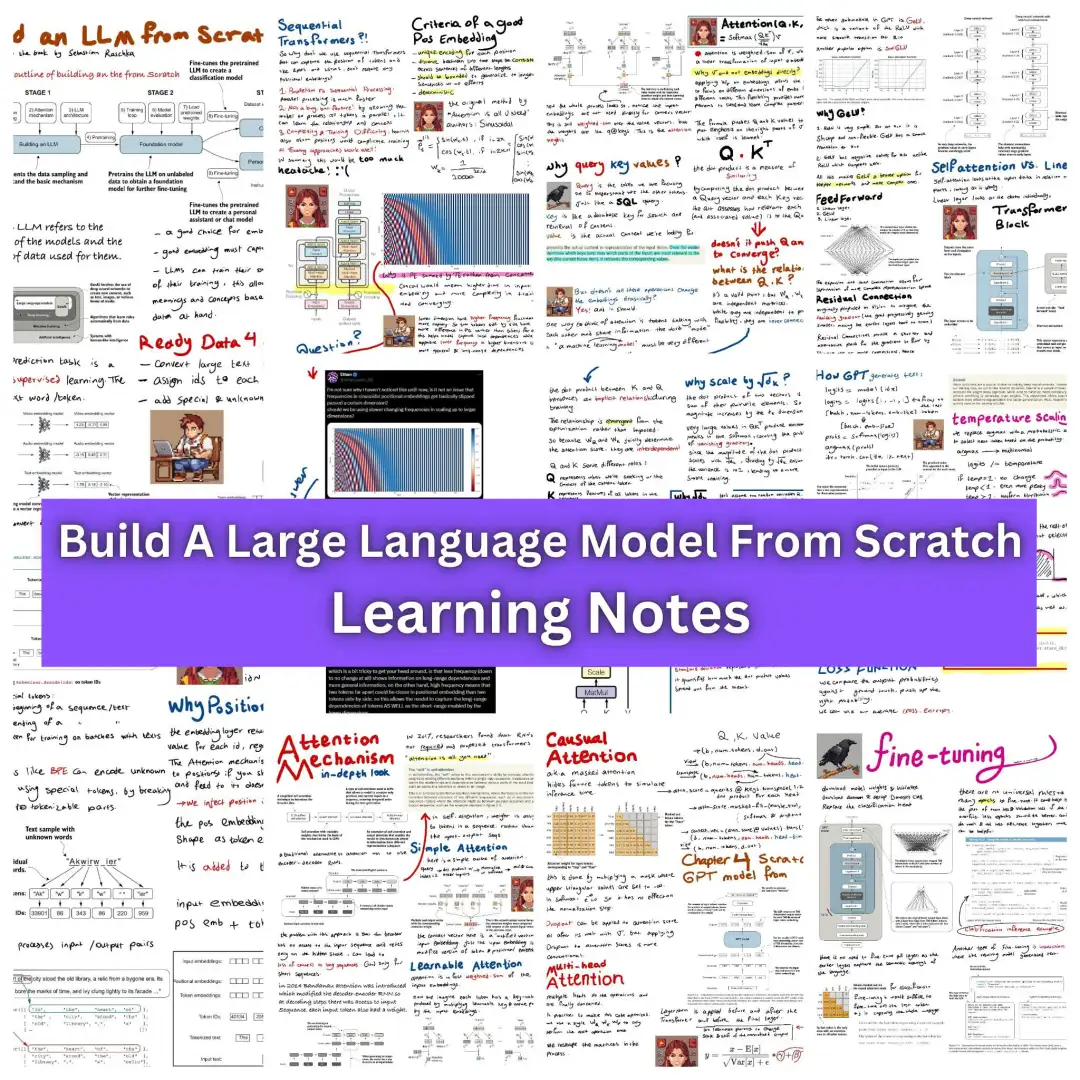

今天給大家推薦一份GitHub上很火的機器學習學習筆記《從零構建大型語言模型》,目前已經收獲1.4K stars,,這份筆記完美展示了從零構建LLM的技術路線圖,既有理論深度,又包含實踐要點。每個核心概念都配有清晰的示意圖,便于理解和實踐。建議先掌握基礎概念,再逐步深入理解高級特性,這樣能形成更系統的知識體系。

第一部分:基礎架構

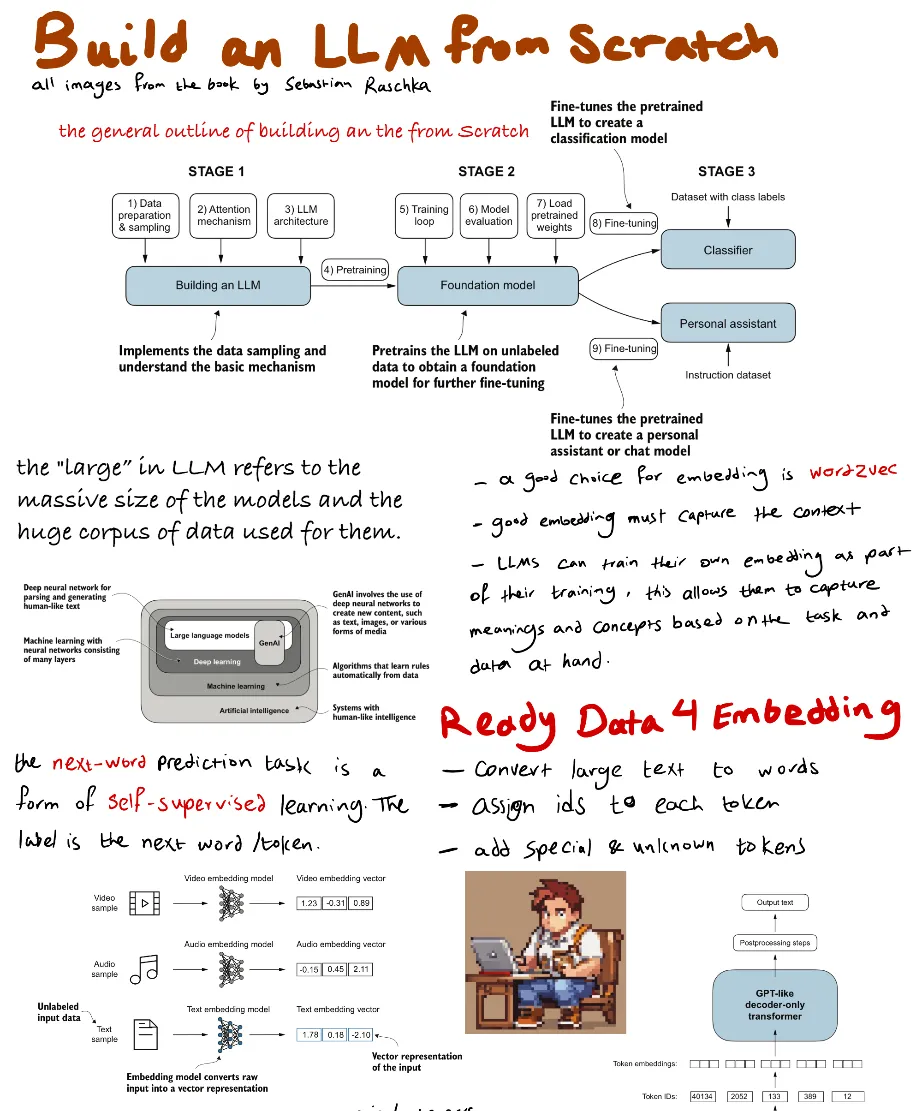

- LLM的核心是對模型結構和訓練數據的深入理解

- 從數據采樣和預處理開始,逐步構建基礎模型

- 需要特別關注詞元化(Tokenization)處理,這是模型理解文本的基礎

第二部分:關鍵技術點

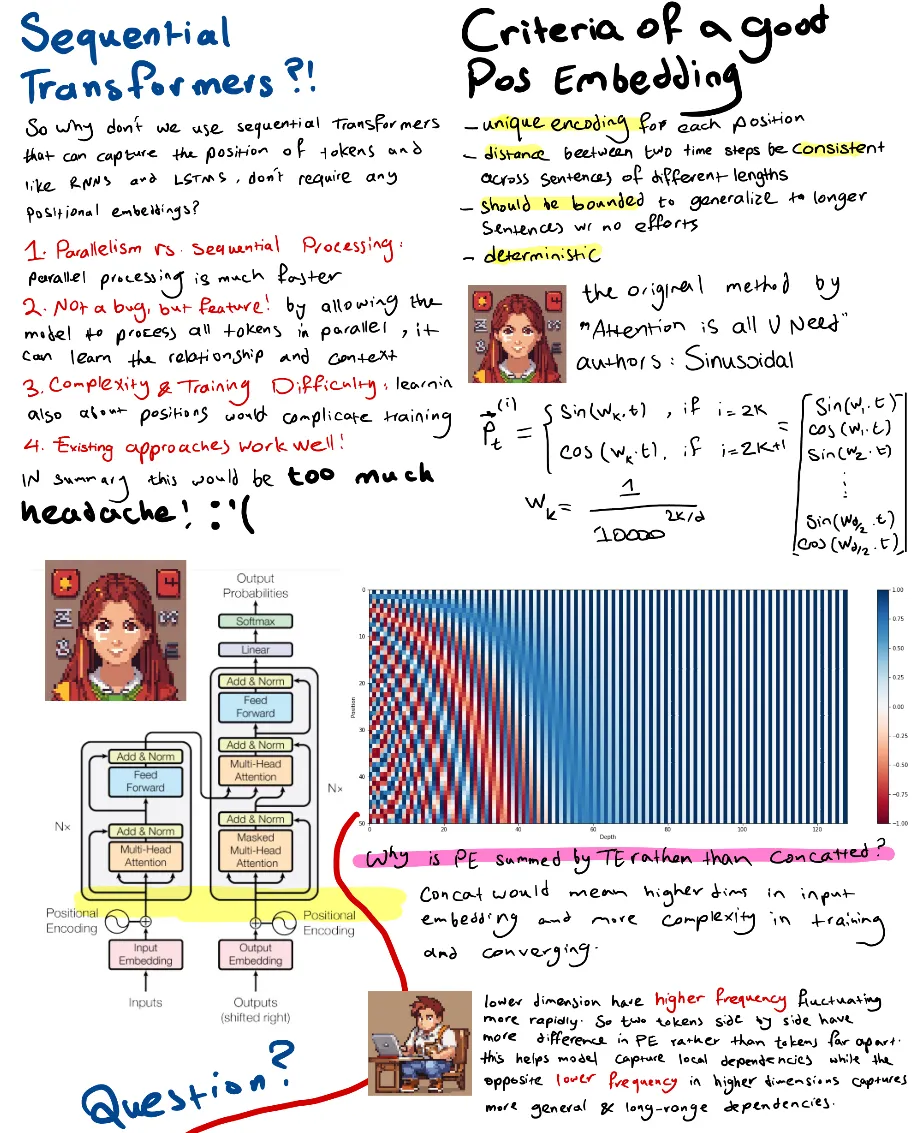

- 位置編碼(Positional Encoding)

- 幫助模型理解文本序列中的位置信息

- 通過數學編碼方式賦予每個標記相對位置

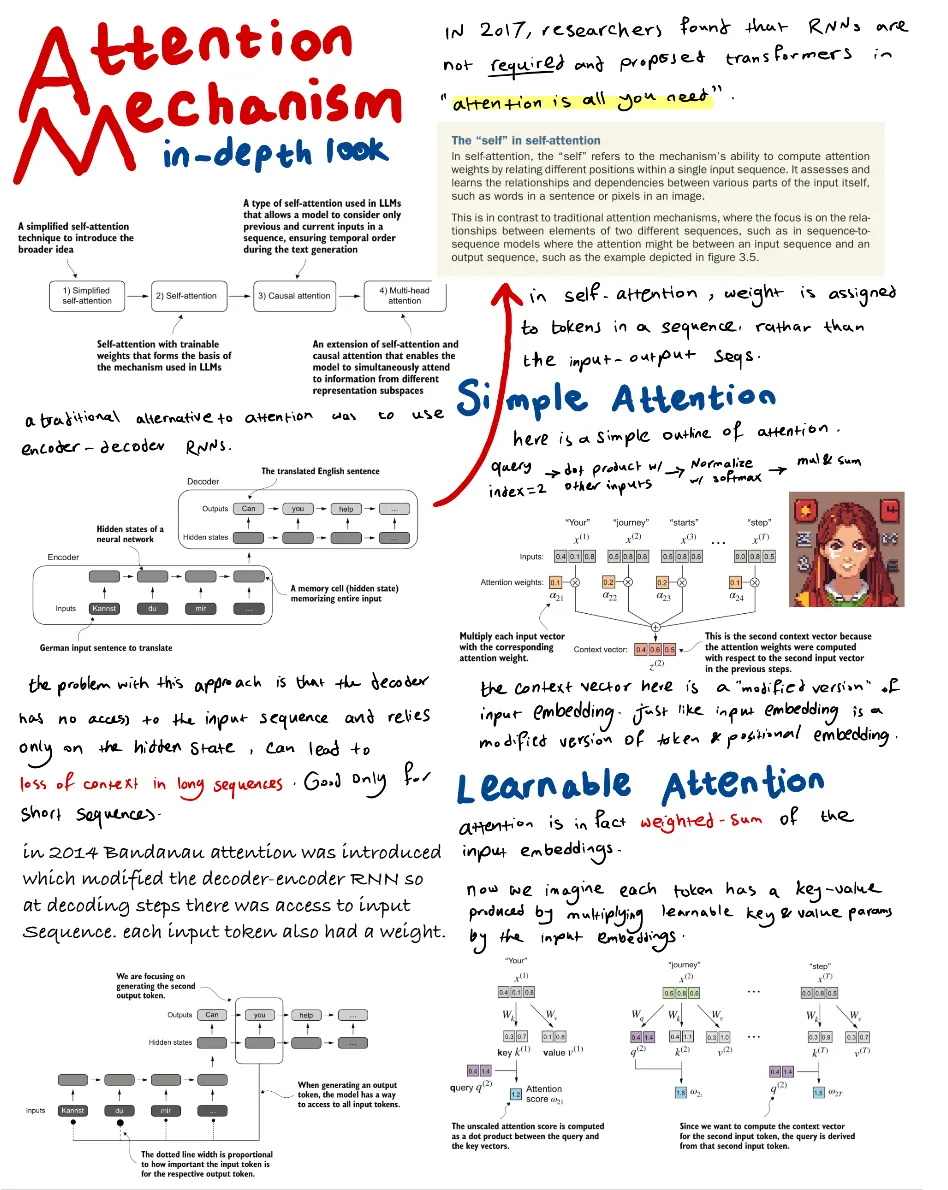

- 注意力機制(Attention Mechanism)

- 包含自注意力和因果注意力兩種形式

- Q、K、V三個關鍵參數的協同作用

- 進行尺度縮放以穩定訓練

- Transformer結構

- 編碼器-解碼器架構設計

- 多頭注意力機制的實現

- 前饋網絡和歸一化層的配置

第三部分:優化策略

- 微調(Fine-tuning)技術要點

- 損失函數的選擇與調整

- 溫度系數(Temperature)對輸出的影響

學習鏈接

- GitHub:github.com/hesamsheikh/ml-retreat/blob/main/assets/LLM-from-scratch-notes.pdf

責任編輯:張燕妮

來源:

AIGC Studio