Sora之后,蘋果發布視頻生成大模型STIV,87億參數一統T2V、TI2V任務

Apple MM1Team 再發新作,這次是蘋果視頻生成大模型,關于模型架構、訓練和數據的全面報告,87 億參數、支持多模態條件、VBench 超 PIKA,KLING,GEN-3。

- 論文地址: https://arxiv.org/abs/2412.07730

- Hugging Face link: https://huggingface.co/papers/2412.07730

OpenAI 的 Sora 公布了一天之后,在一篇由多位作者署名的論文《STIV: Scalable Text and Image Conditioned Video Generation》中,蘋果正式公布自家的多模態大模型研究成果 —— 這是一個具有高達 8.7B 參數的支持文本、圖像條件的視頻生成模型。

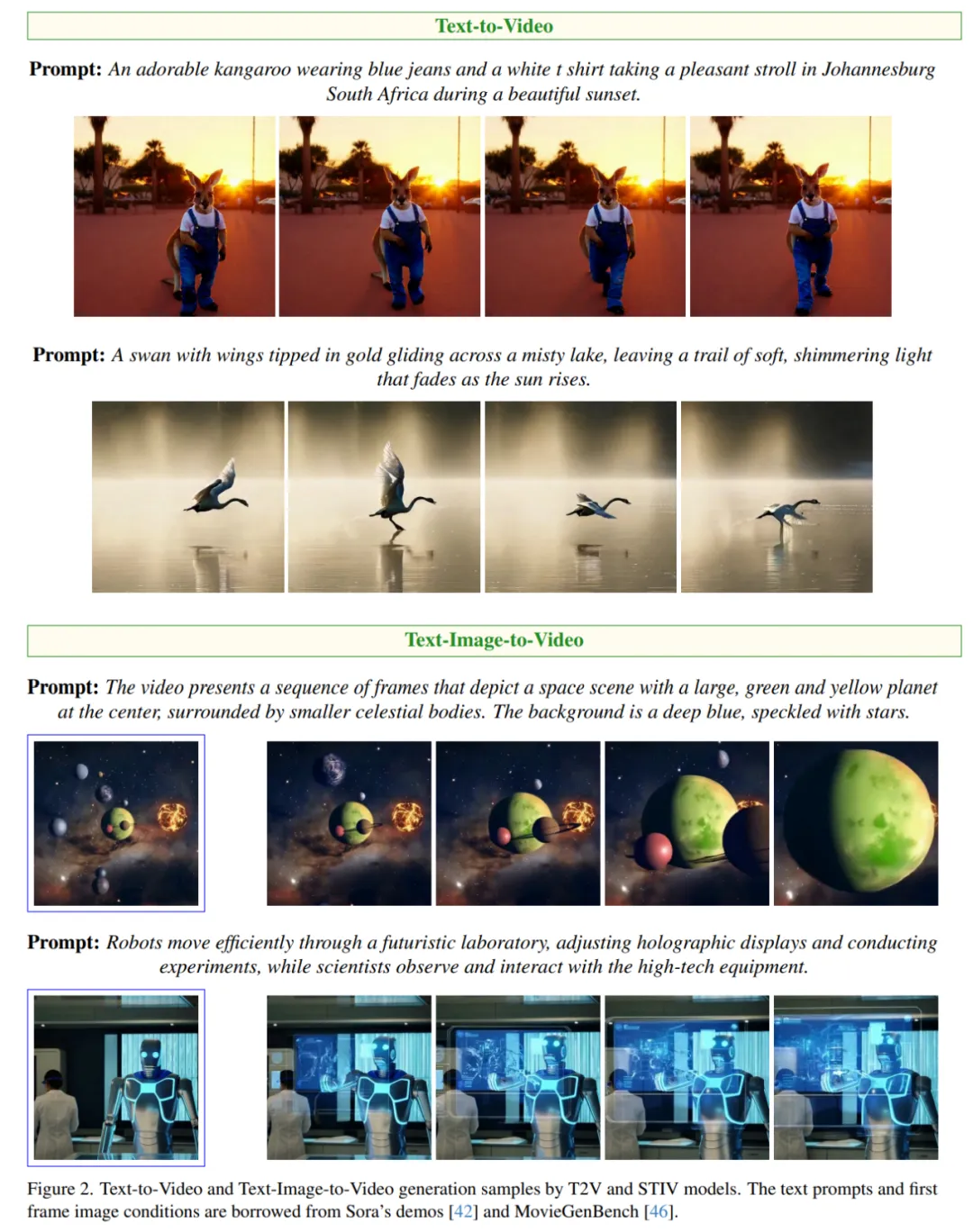

近年來,視頻生成領域取得了顯著進展,尤其是基于 Diffusion Transformer (DiT) 架構的視頻生成模型 Sora 的推出。盡管研究者已在如何將文本及其他條件融入 DiT 架構方面進行了廣泛探索,如 PixArt-Alpha 使用跨注意力機制,SD3 將文本與噪聲塊拼接并通過 MMDiT 模塊應用自注意力等,但純文本驅動的視頻生成(T2V)在生成連貫、真實視頻方面仍面臨挑戰。為此,文本 - 圖像到視頻(TI2V)任務被提出,通過加入初始圖像幀作為參考,提供了更具約束性的生成基礎。

當前主要挑戰在于如何將圖像條件高效地融入 DiT 架構,同時在模型穩定性和大規模訓練效率方面仍需創新。為解決這些問題,我們提出了一個全面、透明的白皮書,涵蓋了模型結構,訓練策略,數據和下游應用,統一了T2V和TI2V任務。

基于以上問題,該工作的貢獻與亮點主要集中在:

- 提出 STIV 模型,實現 T2V 和 TI2V 任務的統一處理,并通過 JIT-CFG 顯著提升生成質量;

- 系統性研究包括 T2I、T2V 和 TI2V 模型的架構設計、高效穩定的訓練技術,以及漸進式訓練策略;

- 模型易于訓練且適配性強,可擴展至視頻預測、幀插值和長視頻生成等任務;

- 實驗結果展示了 STIV 在 VBench 基準數據集上的優勢,包括詳細的消融實驗和對比分析。

該研究不僅提升了視頻生成質量,還為視頻生成模型在未來多種應用場景中的推廣奠定了堅實基礎。

構建 STIV 的配方解析

基礎模型架構

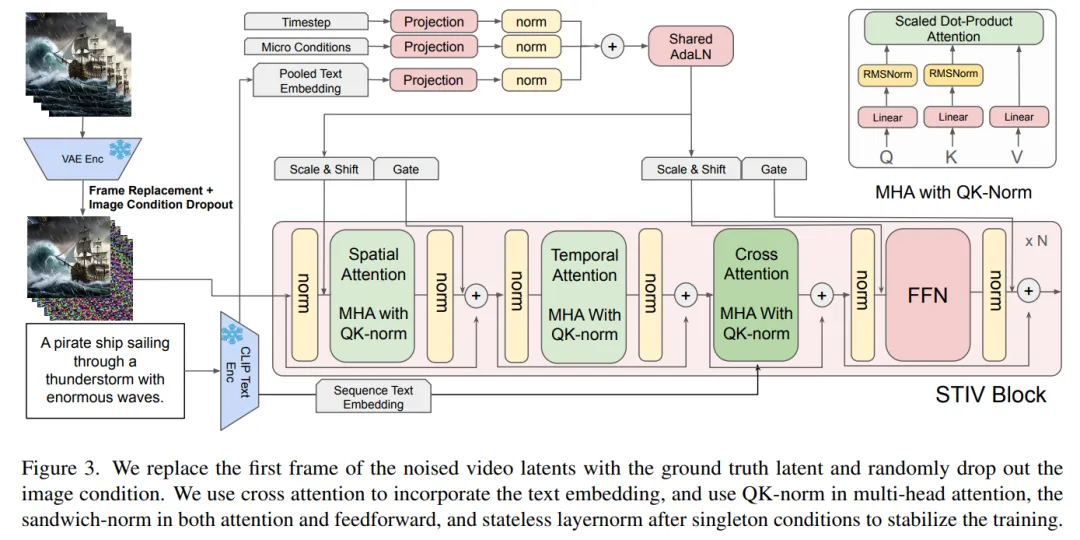

STIV 基于 PixArt-Alpha 架構,通過凍結的變分自編碼器(VAE)將輸入幀轉換為時空潛變量,并使用可學習的 DiT 塊進行處理。文本輸入由 T5 分詞器和內部訓練的 CLIP 文本編碼器處理。此外,該研究還對架構進行了以下優化:

- 時空注意力分解:采用分解的時空注意力機制,分別處理空間和時間維度的特征,這使得模型能夠復用 T2I 模型的權重,同時降低了計算復雜度。

- 條件嵌入:通過對圖像分辨率、裁剪坐標、采樣間隔和幀數等元信息進行嵌入,并結合擴散步長和文本嵌入,生成一個統一的條件向量,應用于注意力層和前饋網絡。

- 旋轉位置編碼(RoPE):利用 RoPE 提升模型處理時空相對關系的能力,適配不同分辨率的生成任務。

- 流匹配目標:采用流匹配(Flow Matching)訓練目標,以更優的條件最優傳輸策略替代傳統擴散損失,提升生成質量。

模型擴展與訓練優化

- 穩定訓練策略:通過在注意力機制中應用 QK-Norm 和 sandwich-norm,以及對每層的多頭注意力(MHA)和前饋網絡(FFN)進行歸一化,顯著提升了模型訓練穩定性。

- 高效訓練改進:借鑒 MaskDiT 方法,對 50% 的空間 token 進行隨機掩碼處理以減少計算量,并切換優化器至 AdaFactor,同時使用梯度檢查點技術顯著降低內存需求,支持更大規模模型的訓練。

融合圖像條件的方法

簡單的幀替換方法

在訓練過程中,我們將第一個幀的噪聲潛變量替換為圖像條件的無噪聲潛變量,然后將這些潛變量傳遞到 STIV 模塊中,并屏蔽掉被替換幀的損失。在推理階段,我們在每次 擴散步驟中使用原始圖像條件的無噪聲潛變量作為第一個幀的潛變量。

幀替換策略為 STIV 的多種應用擴展提供了靈活性。例如,當 c_I (condition of image)=? 時,模型默認執行文本到視頻(T2V)生成。而當 c_I 為初始幀時,模型則轉換為典型的文本-圖像到視頻(TI2V)生成。此外,如果提供多個幀作為 c_I,即使沒有 c_T (condition of text),也可以用于視頻預測。同時,如果將首尾幀作為 c_I提供,模型可以學習幀插值,并生成首尾幀之間的中間幀。進一步結合 T2V 和幀插值,還可以生成長時視頻:T2V 用于生成關鍵幀,而幀插值則填補每對連續關鍵幀之間的中間幀。最終,通過隨機選擇適當的條件策略,可以訓練出一個能夠執行所有任務的統一模型。

圖像條件隨機丟棄

如前所述,幀替換策略為訓練不同類型的模型提供了高度靈活性。我們在此展示其具體應用,即同時訓練模型以執行文本到視頻(T2V)和文本 - 圖像到視頻(TI2V)任務。在訓練過程中,我們隨機丟棄圖像條件 cI 和文本條件 cT,類似于 T2V 模型中僅對文本條件隨機丟棄的方式。

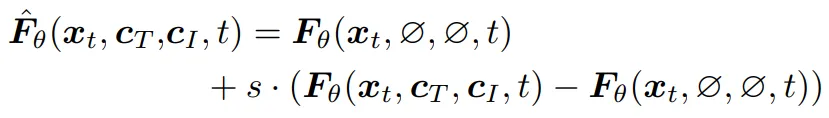

聯合圖像 - 文本無分類器引導(JIT-CFG)

無分類器引導(Classifier-Free Guidance, CFG)在文本到圖像生成中表現出色,可以通過將概率質量引導到高似然區域來顯著提升生成質量。在此基礎上,我們提出了聯合圖像 - 文本無分類器引導(JIT-CFG),同時利用文本和圖像條件進行引導,其速度估計公式為:

其中 s 為引導比例。當 c_I=? 時,該方法退化為標準的 T2V 無分類器引導。盡管可以像 InstructPix2Pix 所述引入兩個獨立的引導比例,以平衡圖像和文本條件的強度,我們發現兩步推理方法已經能夠取得優異效果。此外,使用兩個引導比例會增加一次前向傳遞,從而提高推理成本。

實驗證明圖像條件隨機丟棄結合 JIT-CFG 不僅能自然地實現多任務訓練,還有效解決了高分辨率視頻生成模型訓練的 “靜止” 問題。我們推測,圖像條件隨機丟棄可以防止模型過度依賴圖像條件,從而更好地捕捉視頻訓練數據中的運動信息。

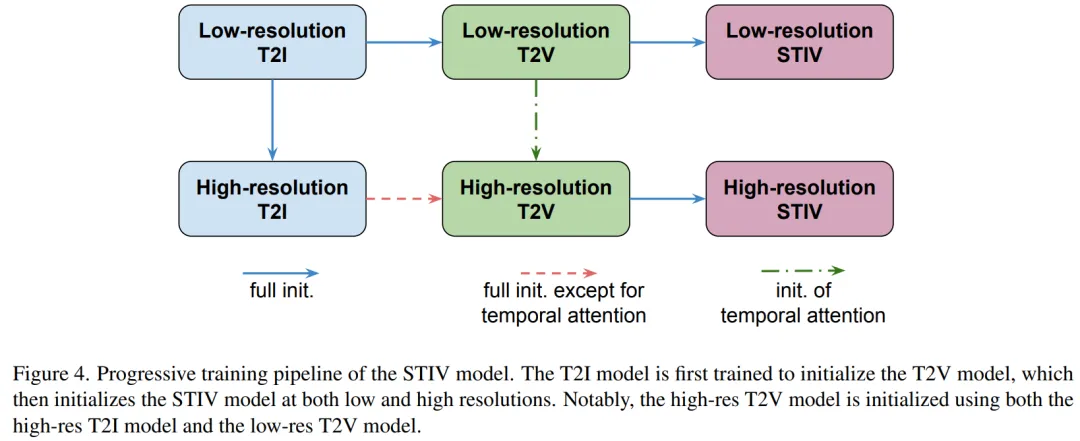

漸進式訓練策略

我們采用漸進式訓練策略,其流程如圖 4 所示。首先訓練一個文本到圖像(T2I)模型,用以初始化文本到視頻(T2V)模型;隨后,T2V 模型用于初始化 STIV 模型。為快速適應高分辨率和長時訓練,我們在空間和時間維度中加入了插值的 RoPE 嵌入,并利用低分辨率、短時長模型的權重進行初始化。值得注意的是,高分辨率 T2V 模型同時結合了高分辨率 T2I 模型和低分辨率 T2V 模型的權重進行初始化。

數據

視頻預處理和特征提取細節

為了確保高質量的輸入數據,我們首先解決了原始視頻中不一致的動作以及諸如切換和漸變之類的不必要過渡問題。利用 PySceneDetect,我們對視頻幀進行分析,識別并分割出包含突兀過渡或漸變的場景。這一過程剔除了不一致的片段,確保視頻片段在視覺上保持一致性,從而減少偽影并提升整體質量。隨后,我們提取了一系列初始特征用于后續篩選,包括運動分數、美學分數、文本區域、幀高度、幀寬度、清晰度分數、時間一致性以及視頻方向等。

視頻字幕生成與分類細節

視頻 - 文本對在訓練文本到視頻生成模型中起著至關重要的作用。然而,許多視頻數據集缺乏高質量的對齊字幕,并且通常包含噪聲或不相關內容。為此,我們在數據處理流程中引入了一個額外的視頻字幕生成模塊,用于生成全面的文本描述。

我們主要探索了兩種方向:(1) 抽樣少量幀,應用圖像字幕生成器生成字幕后,再使用大型語言模型(LLM)對生成的字幕進行總結;(2) 直接使用視頻專用的 LLM 生成字幕。

在初步嘗試了第一種方法后,我們發現兩個主要局限性:一是圖像字幕生成器只能捕捉單幀的視覺細節,導致缺乏對視頻動作的描述;二是 LLM 在基于多幀字幕生成密集描述時可能會出現虛構現象(hallucination)。

近期研究使用 GPT 家族模型創建微調數據集并訓練視頻 LLM。為了在大規模字幕生成中平衡質量和成本,我們選擇了一種高效的視頻字幕生成器。隨后,我們使用 LLM 對生成的字幕進行分類,并統計視頻的類別分布。

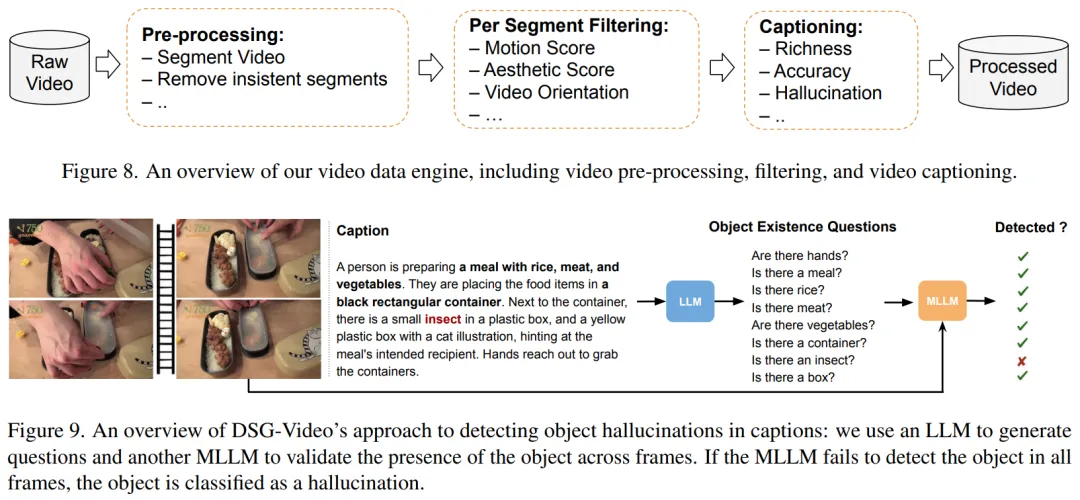

DSG-Video: 虛構檢測評估

為了比較不同字幕生成技術,我們開發了一個評估模塊,用于評估字幕的豐富度和準確性。

我們通過測量字幕中提及的唯一對象的多樣性來量化字幕的豐富度,并通過檢測虛構對象來評估準確性。

受文本到圖像評估方法的啟發,我們提出了 DSG-Video,用于驗證字幕中提到的對象是否真實出現在視頻內容中。

1. 首先,我們利用 LLM 自動生成針對字幕關鍵細節的問題,例如對象的身份、動作和上下文。

舉例來說,給定一段提到 “沙發上坐著一只貓” 的字幕,LLM 會生成問題,比如 “視頻中是否有一只貓?” 以及 “貓是否在沙發上?”

2. 然后,我們使用多模態 LLM 回答這些對象驗證問題,通過評估視頻中多個均勻采樣幀的每個參考對象的存在情況。

對于每個生成的問題(例如,“該幀中是否有貓?”),多模態 LLM 檢查每個采樣幀并提供響應。如果對于某個問題,所有幀的響應都表明對象不存在,則我們將其分類為虛構對象。

這一方法確保了對視頻中每個對象的逐幀驗證。基于此,我們定義了兩個評估指標:

- DSG-Video_i:虛構對象實例的比例(即提到的所有對象中被檢測為虛構的比例);

- DSG-Video_s:包含虛構對象的句子的比例(即所有句子中含虛構對象的比例)。

結果

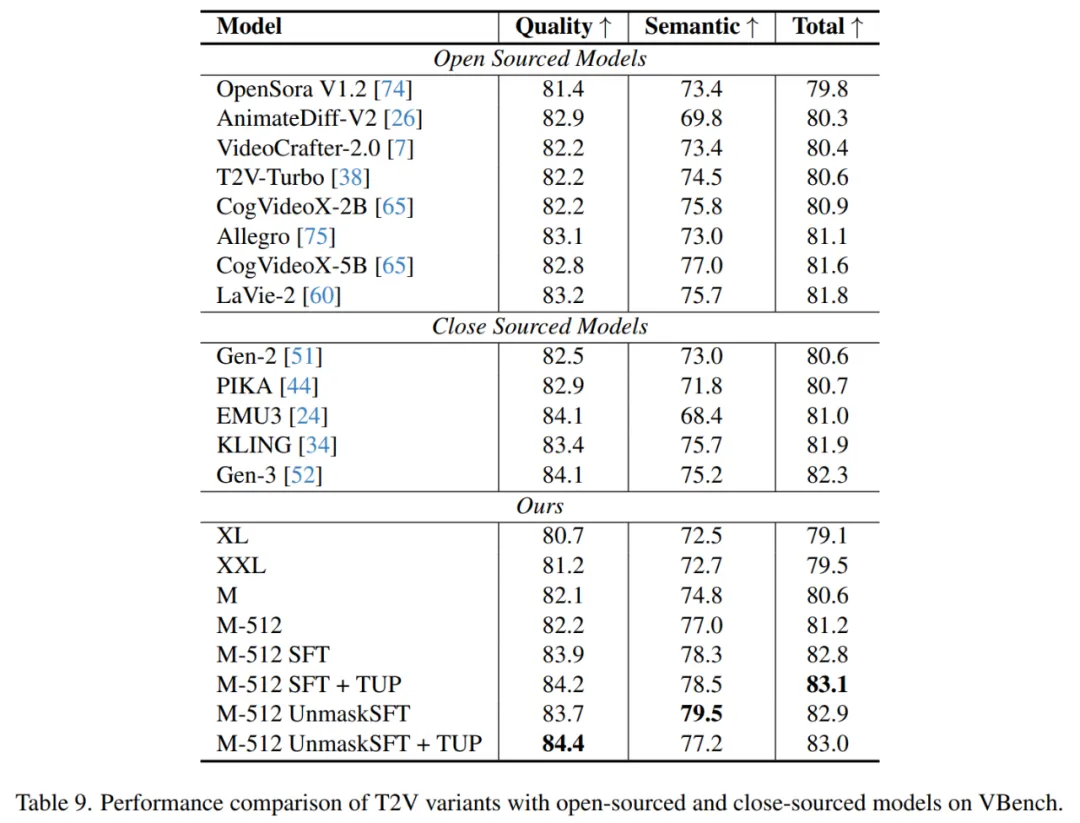

基于上述研究,我們將 T2V 和 STIV 模型從 600M 參數擴展到 8.7B。

主要結果展示在表格中,與最新的開源和閉源模型對比后,證明了我們方法的有效性。具體而言,我們基于 Panda-70M 數據集中的 20,000 條經過篩選的視頻,使用預訓練的視頻生成模型進行了微調(SFT)。在預訓練階段采用了 MaskDiT 技術后,我們嘗試對模型進行無掩碼方式的微調(UnmaskSFT)。此外,我們還對 STIV 模型進行了時間插值微調,以提升生成視頻的運動平滑度(+TUP)。

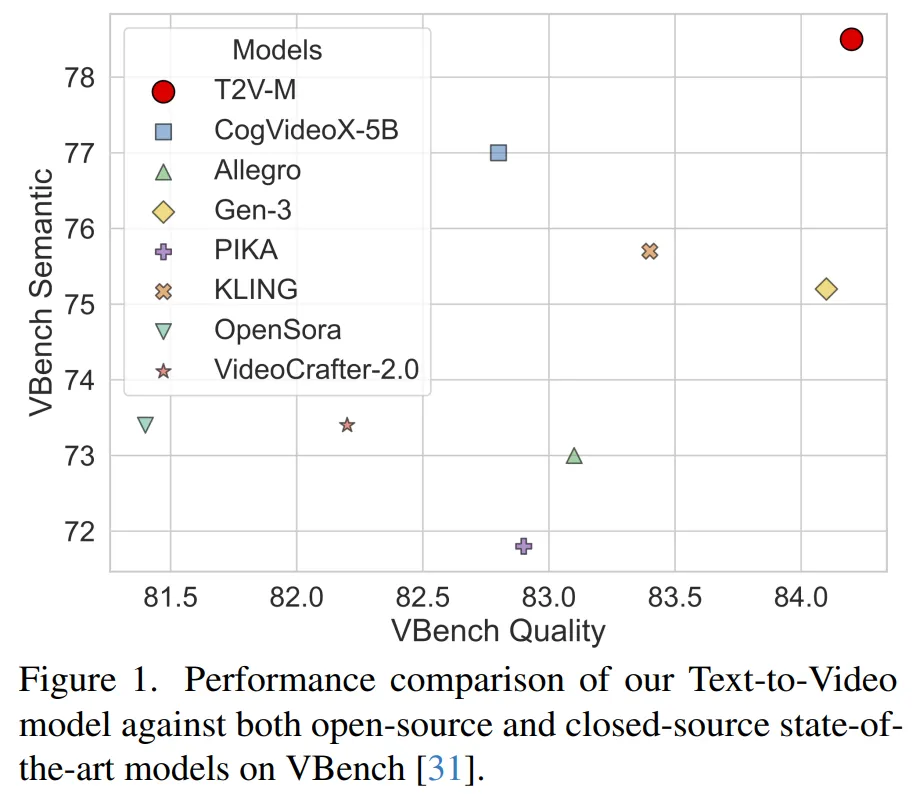

T2V 性能

表格列了不同 T2V 模型在 VBench 上的對比結果,包括 VBench-Quality、VBench-Semantic 和 VBench-Total 分數。分析表明,擴展 T2V 模型的參數能夠提升語義理解能力。具體來說,當模型從 XL 增加到 XXL 和 M 時(三種模型尺度),VBench-Semantic 分數從 72.5 提升到 72.7,最終達到 74.8。這表明更大的模型在捕獲語義信息方面表現更好。然而,對于視頻質量的影響相對有限,VBench-Quality 僅從 80.7 提升至 82.1。這一發現表明,模型參數擴展對語義能力的提升大于對視頻質量的影響。此外,將空間分辨率從 256 提升到 512 時,VBench-Semantic 分數顯著提高,從 74.8 上升到 77.0。

SFT 的影響

通過高質量的 SFT 數據微調模型,可以顯著提升 VBench-Quality 分數,從 82.2 提升到 83.9。在無掩碼條件下對模型進行微調時,語義分數略有提升。我們的最佳模型實現了 79.5 的 VBench-Semantic 分數,超越了 KLING、PIKA 和 Gen-3 等領先的閉源模型。結合時間插值技術后,我們的模型在質量評分方面超越了所有其他模型,達到了最新的行業標準。

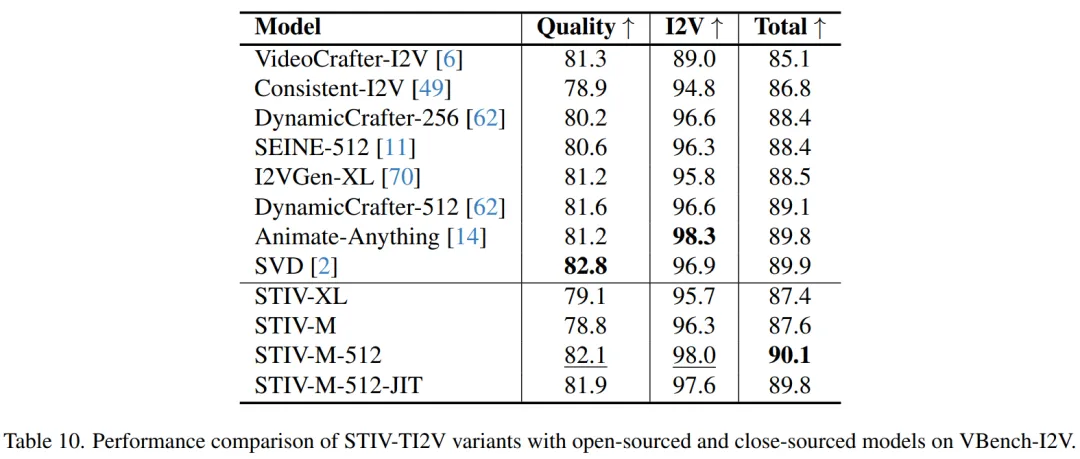

TI2V 性能

如表中所示,我們的模型在與最新方法的對比中表現出色。分析表明,盡管模型參數擴展提升了 I2V 分數,但對質量的影響較小。相比之下,提高分辨率能夠顯著改善質量和 I2V 分數。這一趨勢表明,分辨率的提高對于提升多任務生成能力尤為關鍵。完整的分解維度結果見文章附錄。

應用

視頻預測

我們從 STIV-XXL 模型出發,訓練一個以前四幀為條件的文本 - 視頻到視頻模型(STIV-V2V)。實驗結果表明,在 MSRVTT 測試集和 MovieGen Bench 上,視頻到視頻模型的 FVD 分數顯著低于文本到視頻模型。這表明視頻到視頻模型在生成高保真和一致性視頻幀方面表現出色,尤其適用于自動駕駛和嵌入式 AI 等需要高質量生成的領域。

幀插值

我們提出了 STIV-TUP,一個時間插值模型,以 STIV-XL 為初始模型,并在具有時間間隔的連續幀上進行訓練,同時添加文本條件。實驗表明,STIV 可以在文本和圖像條件下進行高質量的幀插值,并且在 MSRVTT 測試集中,使用文本條件稍微優于其他條件。此外,我們將時間插值器與主模型級聯,發現這種方法能夠提升生成質量,同時保持其他指標穩定。

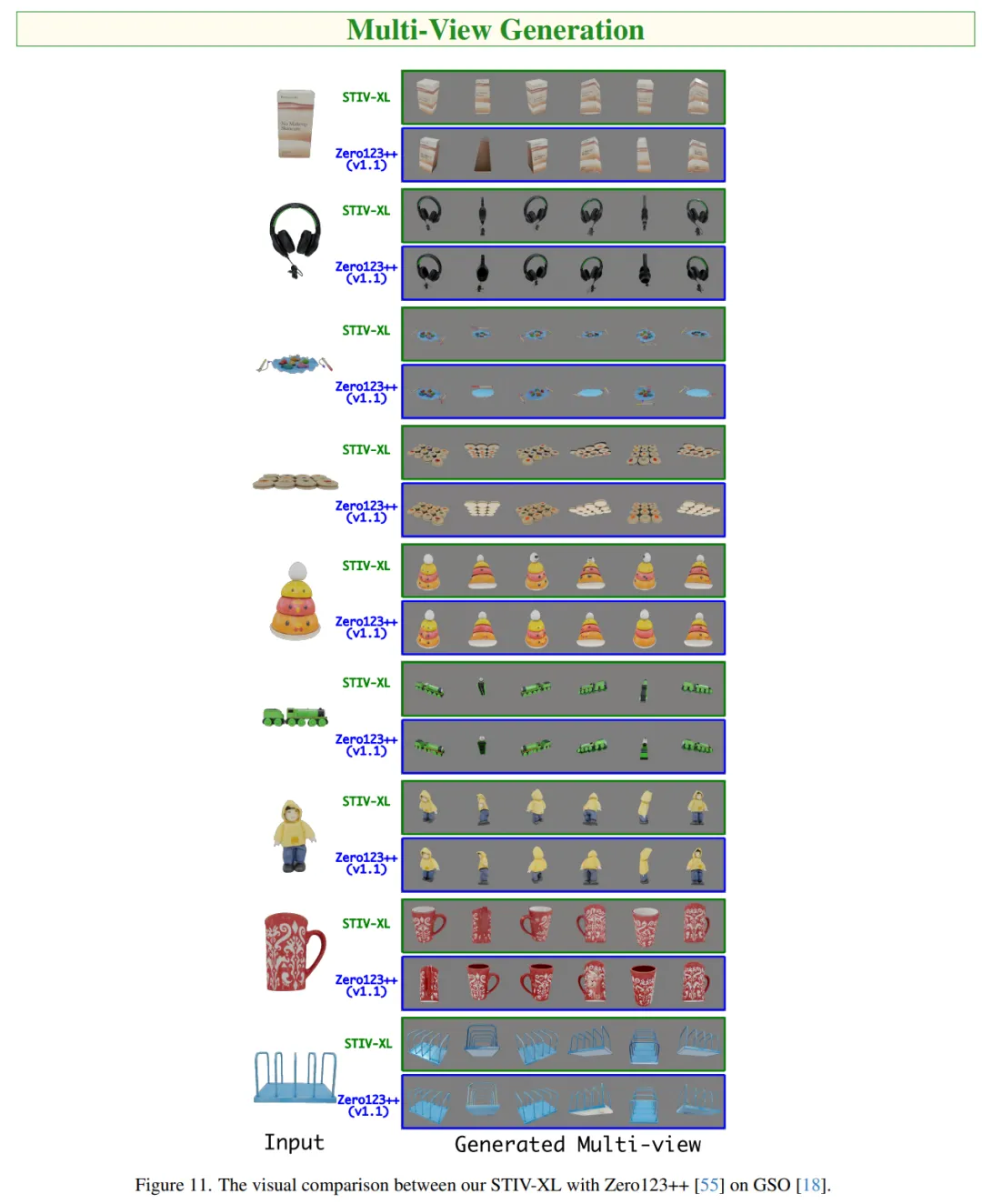

多視角生成

多視角生成旨在從給定的輸入圖像創建新視角。這項任務對視角一致性要求較高,依賴于良好預訓練的視頻生成模型。通過將視頻生成模型適配為多視角生成,我們可以驗證預訓練是否有效捕獲了 3D 信息,從而提升生成效果。

我們使用某些新視角相機的定義,并以初始幀為給定圖像,預測接下來的新視角幀。通過訓練一個 TI2V 模型并調整分辨率和訓練步數,我們實現了與現有方法相當的表現,同時驗證了我們的時空注意力機制在保持 3D 一致性方面的有效性。

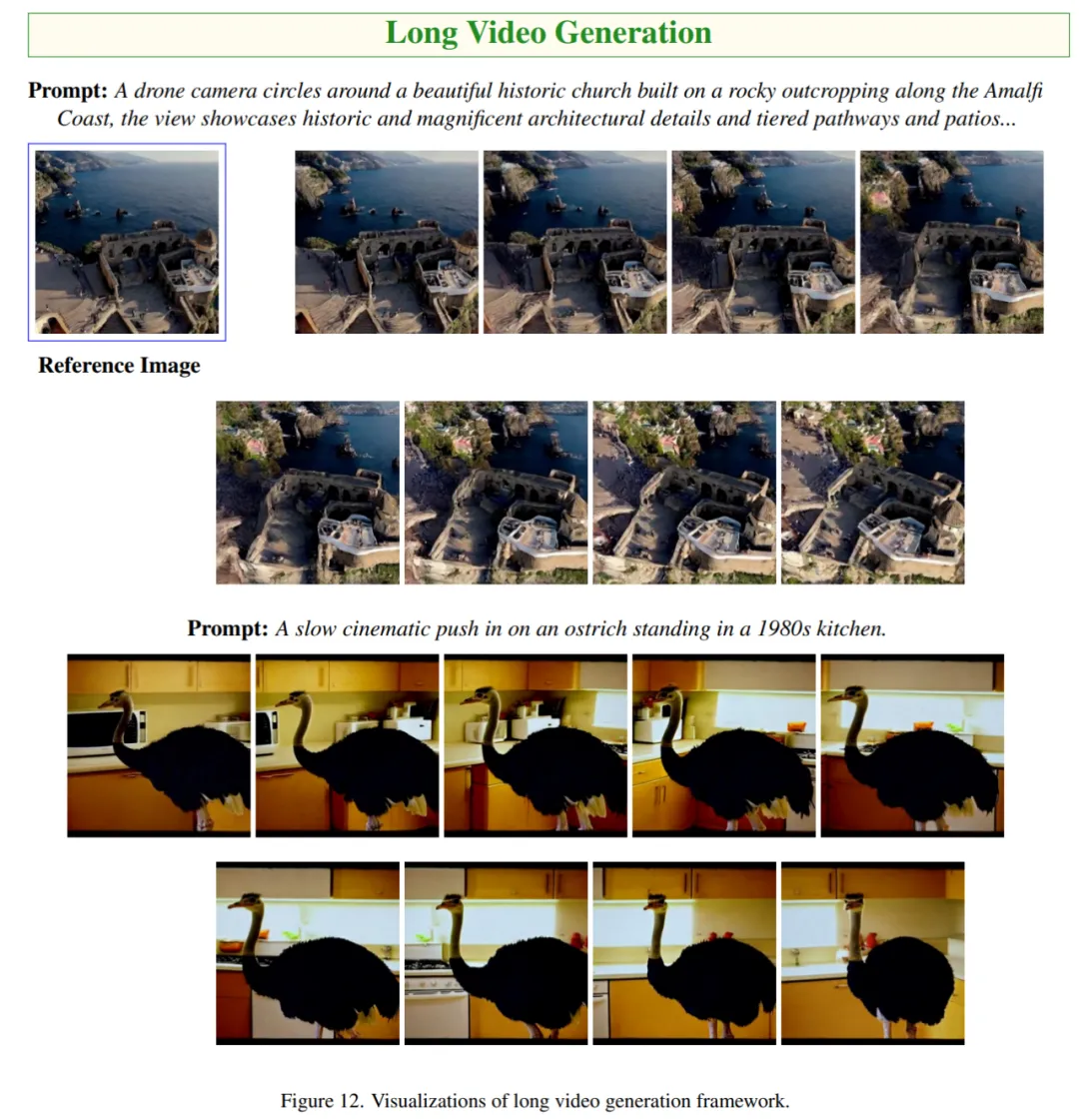

長視頻生成

我們開發了一種高效生成長視頻的分層框架,包括兩種模式的訓練:(1) 關鍵幀預測,學習以較大時間間隔采樣的幀;(2) 插值幀生成,通過學習連續幀,并將首尾幀作為條件。在采樣階段,首先使用關鍵幀預測模式生成關鍵幀,再通過插值模式生成中間幀,從而實現長視頻生成。

更多關于模型結構、圖像條件融合方法,訓練策略的各種消融實驗以及其他研究細節,請參考原論文。