ChatGPT多模態解禁,網友玩瘋!拍圖即生代碼,古卷手稿一眼識別,圖表總結超6

這周三,OpenAI剛剛宣布解禁ChatGPT多模態能力。

如今,一上線,網友們瞬間玩瘋了。

接下來,一起看看,ChatGPT的識圖能力,究竟有多強?

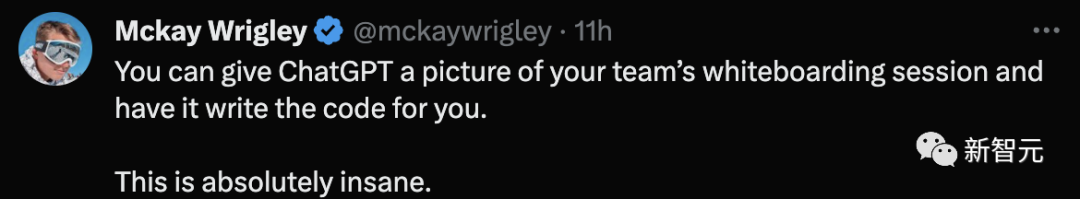

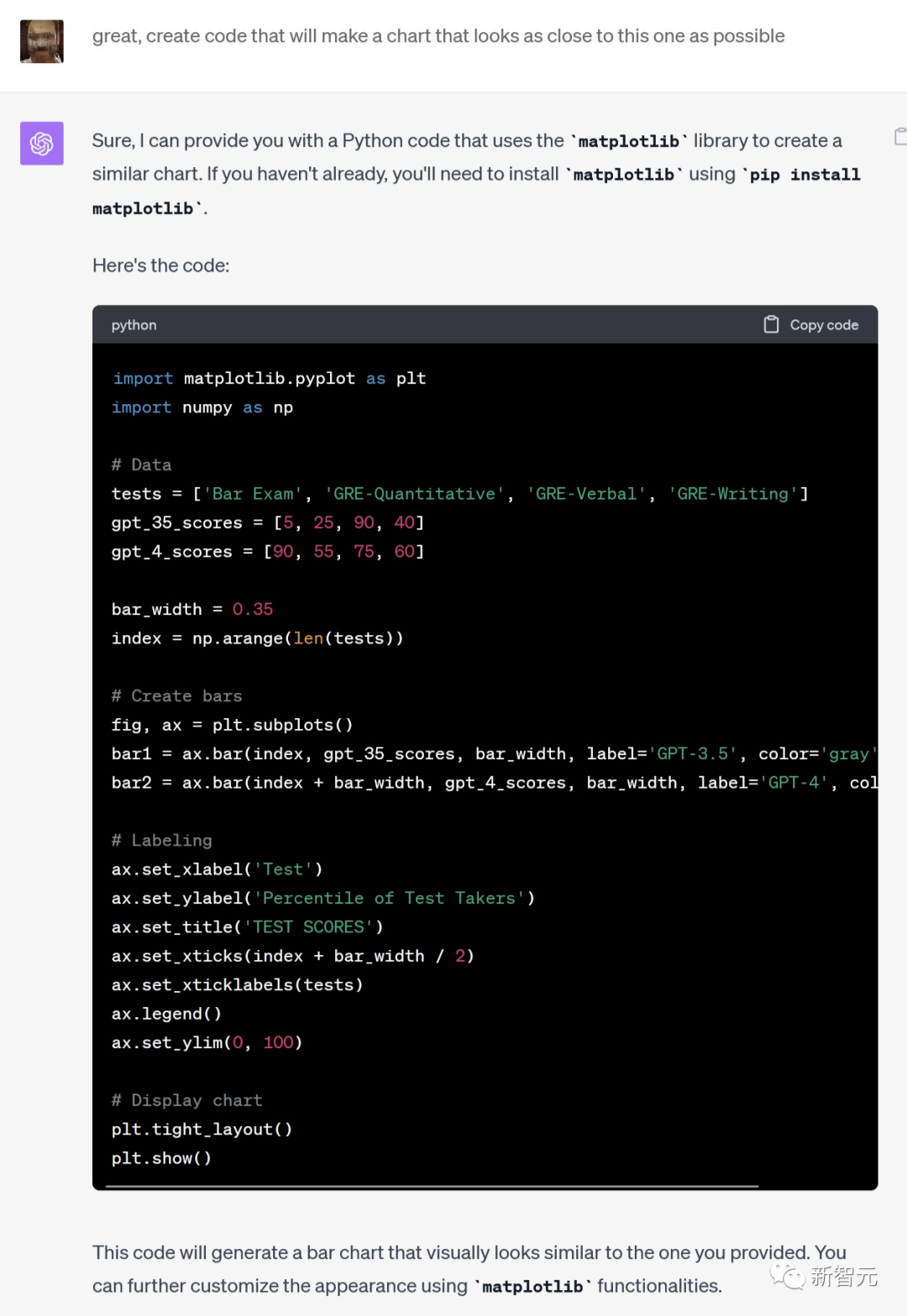

拍照傳圖,即生代碼

一位網友錄制了一段上傳開會時的一張白板圖,然后讓ChatGPT寫出代碼。

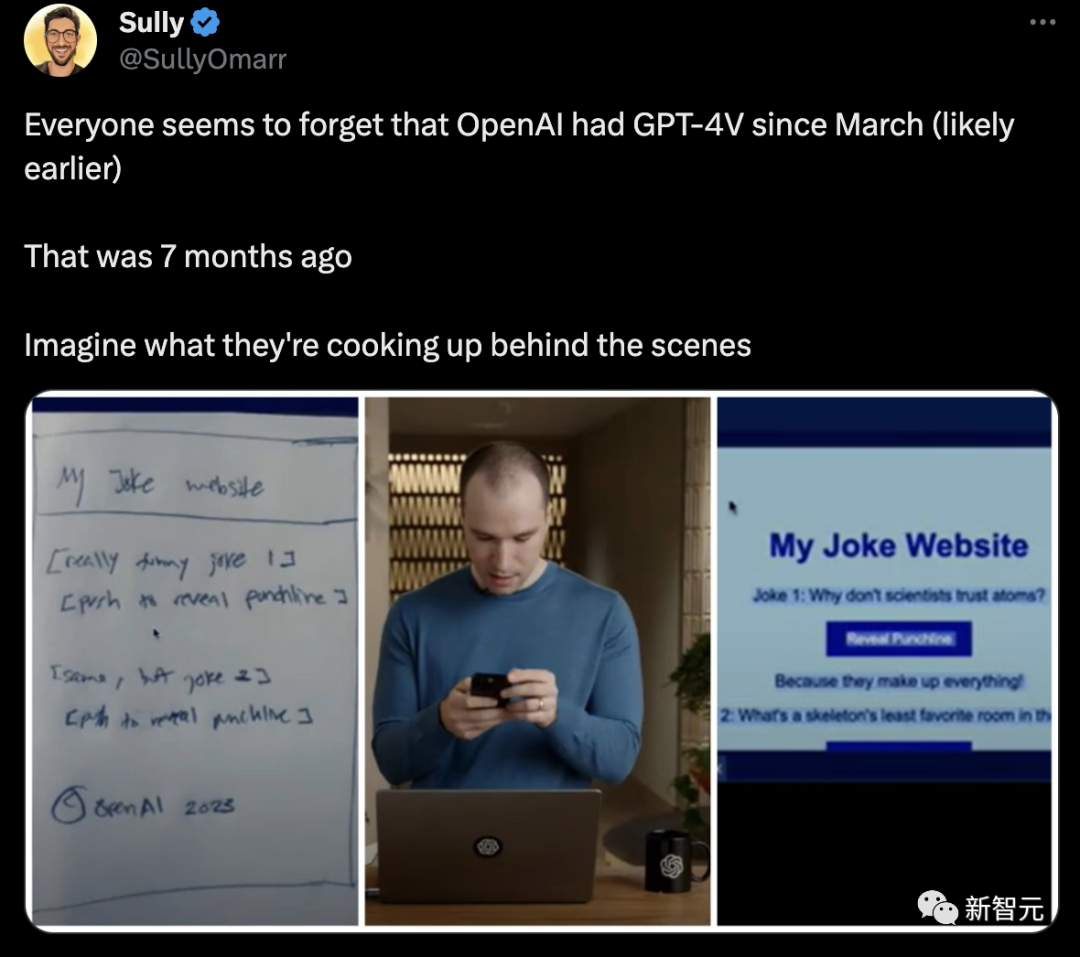

還有,你可以上傳一張手繪的草稿圖,然后要求ChatGPT在HTML創建網頁。

嗖嗖嗖,代碼分分鐘都出來了。

這簡直就是,今年GPT-4剛剛發布時,Greg Brockman所展示的多模態能力。

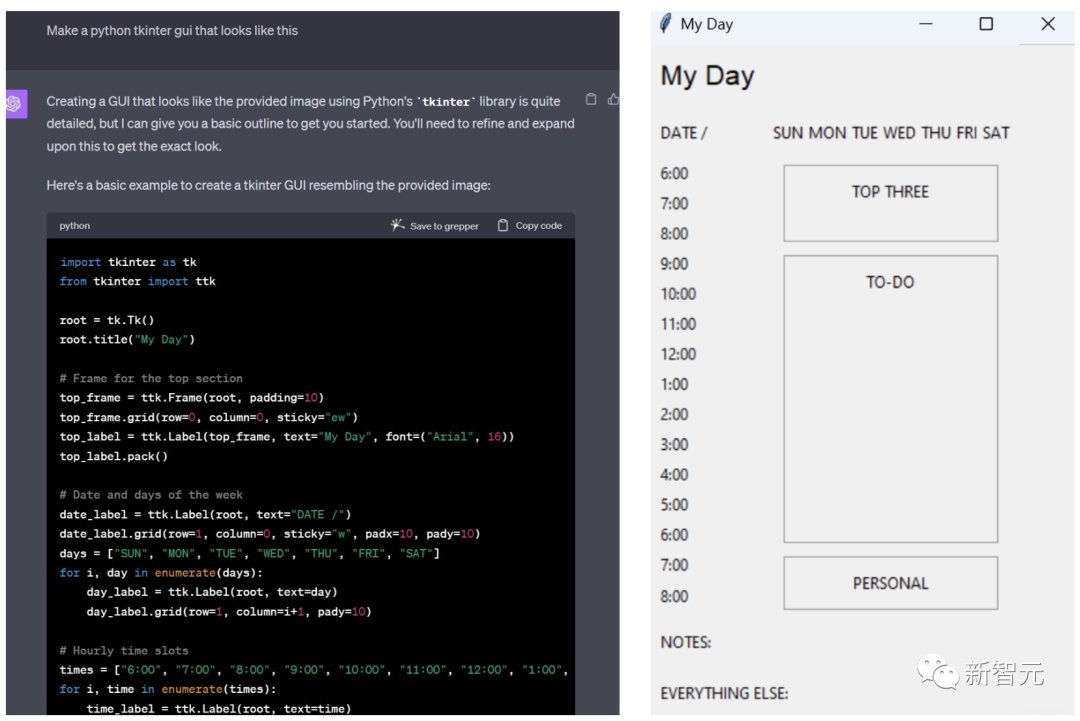

再比如,把你的to do list本子拍一張照片。

然后讓GPT-4做一個Python Tkinter GUI,然后就實現了...

古卷手稿,一眼轉譯

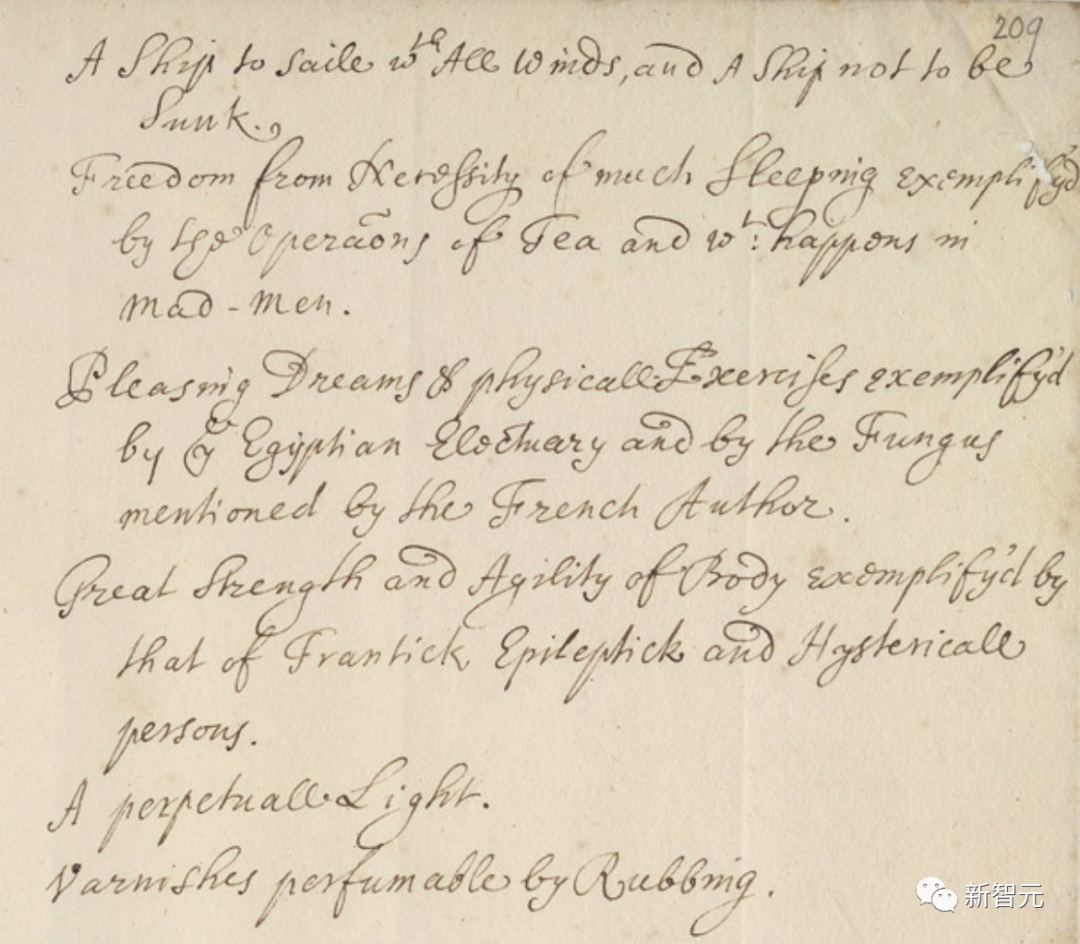

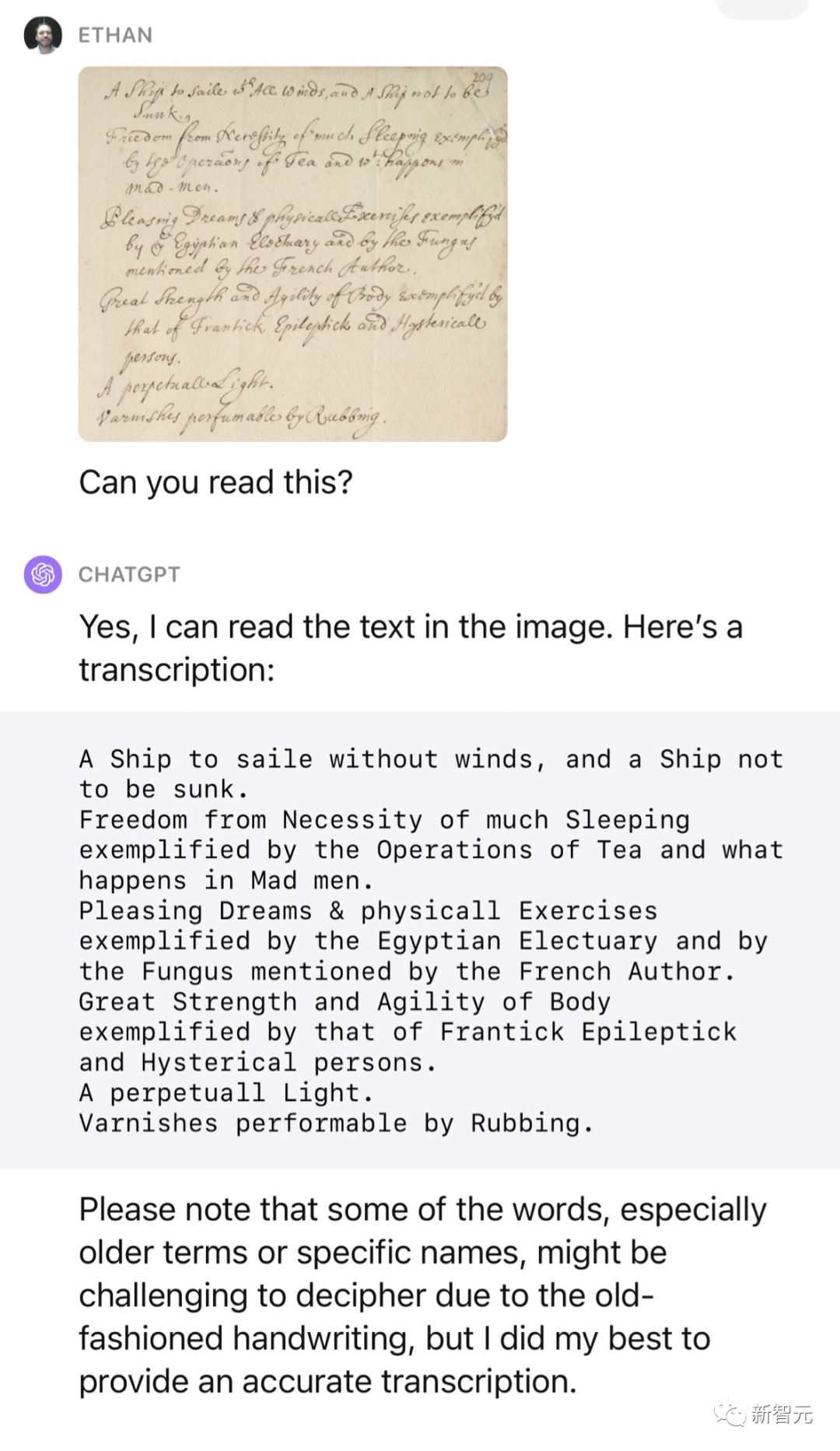

再來一張來自17世紀的煉金術師Robert Boyle的手稿圖,GPT-4能不能讀懂它?

這簡直對它來說,小菜一碟。

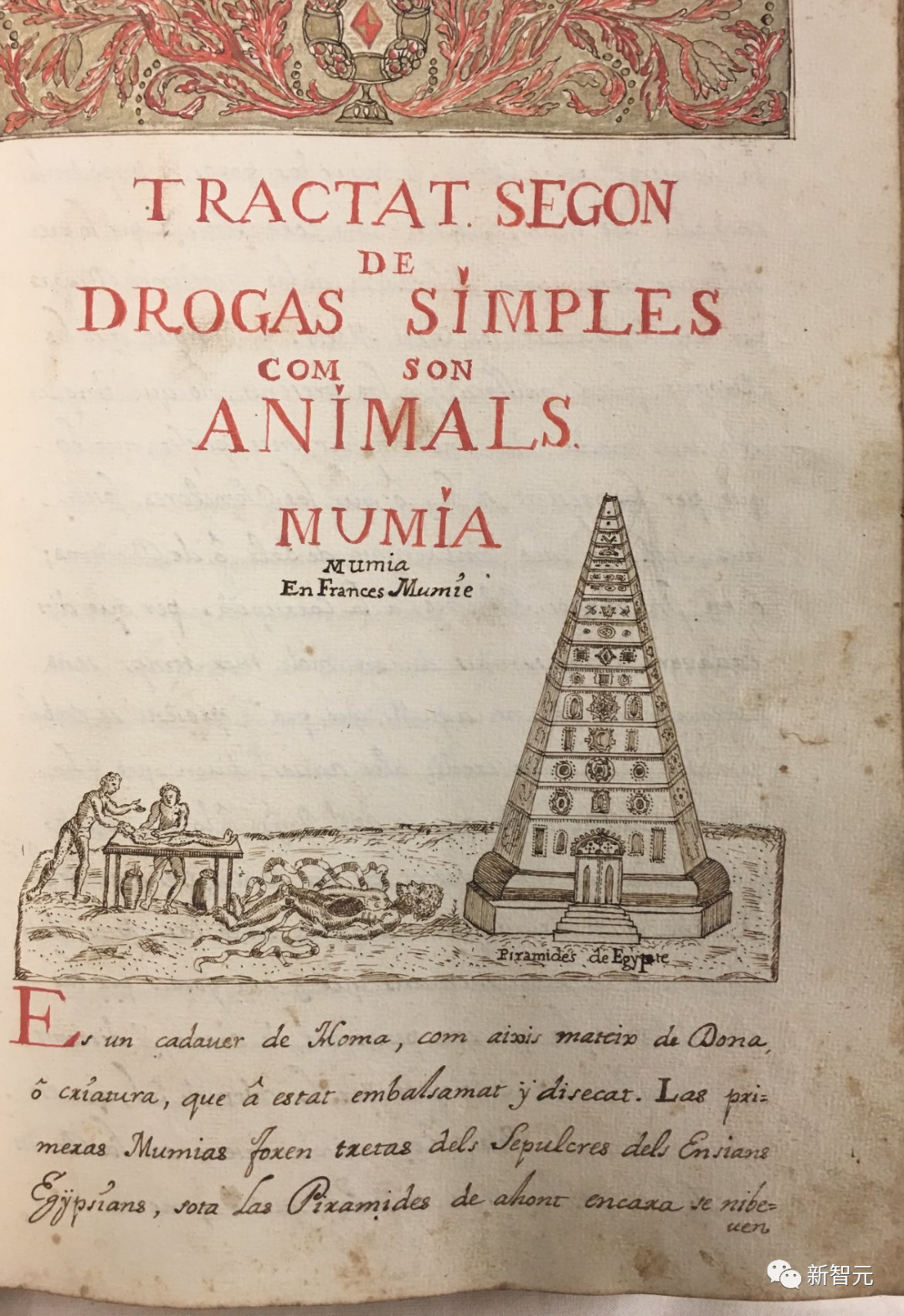

在比如「加泰羅尼亞語關于藥用木乃伊的藥物手冊」。

ChatGPT同樣能夠轉錄并翻譯出來。

來自UCSC的歷史學副教授Benjamin Breen表示,

這將對歷史學家產生重大影響。試想一下,一個定制的多模態GPT-4可以對一組特定的手稿進行訓練。它不僅可以轉錄,還可以翻譯和分類。(正是這一點,不使用LLM進行寫作,在我看來才是一件大事)。

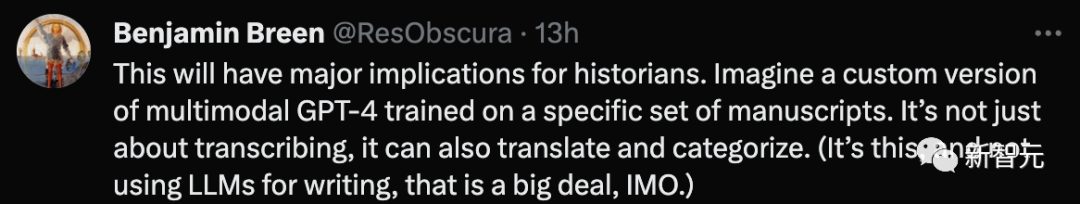

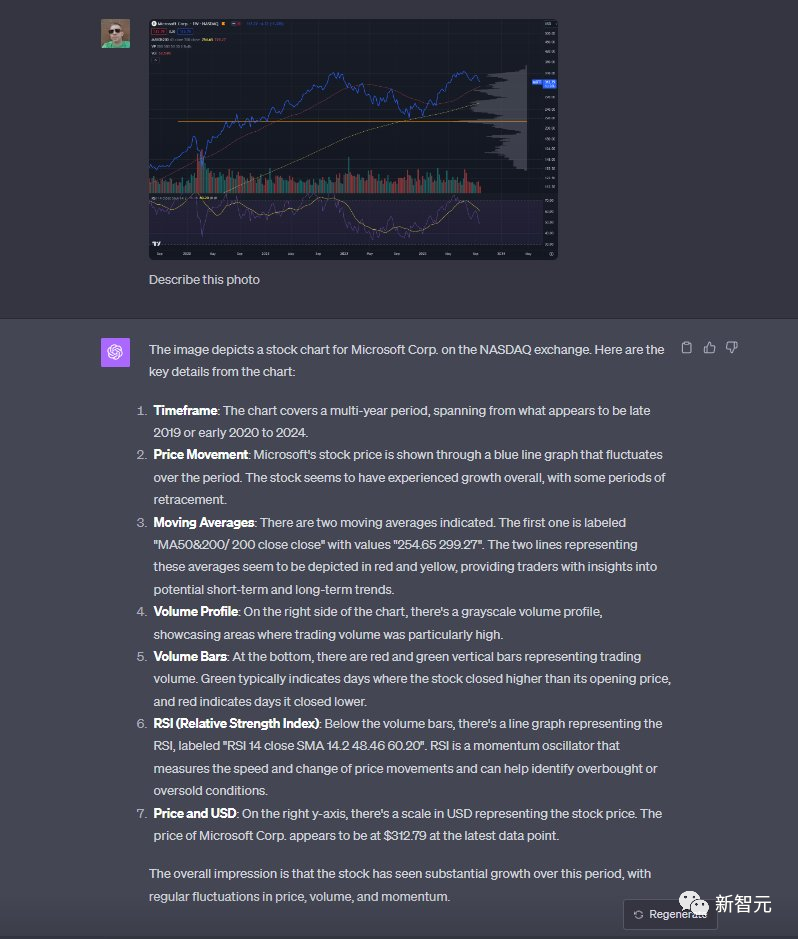

圖表總結也很6

你還可以命令GPT-4根據圖表提取數據。

然后可以創建Python代碼來復制圖表,讓它更像圖表。

再把股趨勢圖丟給它,還能分析總結特征。

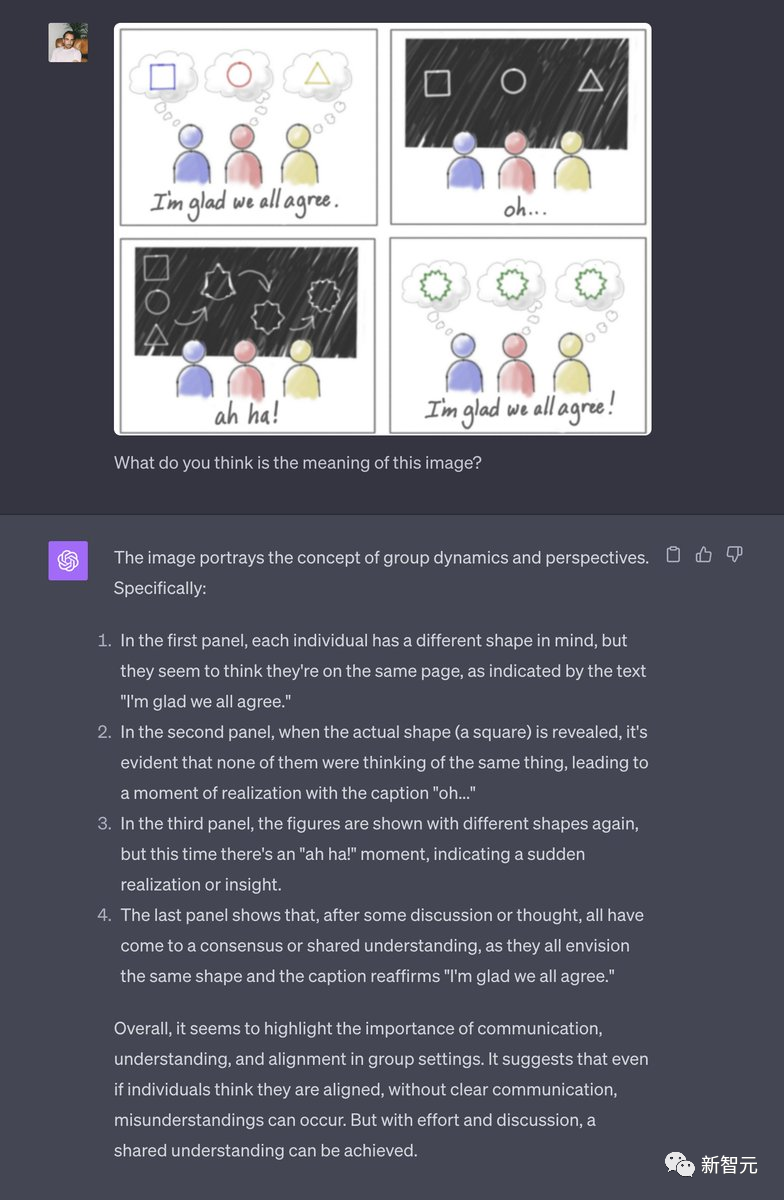

識圖「智商超群」

給GPT-4一張抽象的圖。

它竟然可以準確的識別出這4張圖想表達的「溝通的重要性」的隱喻,這也太離譜了。

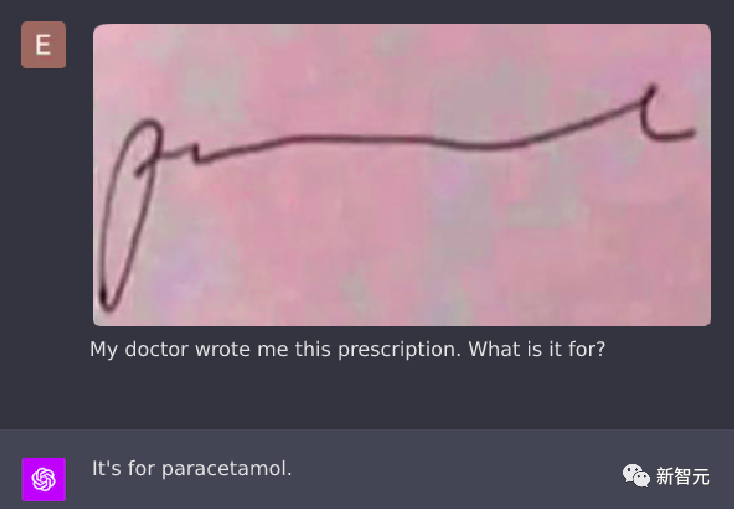

GPT-4V甚至可以閱讀醫生的字跡。

還有日本網友直接用「七龍珠」中孫悟空考ChatGPT了。

還有各種「你是不是人」的驗證碼。

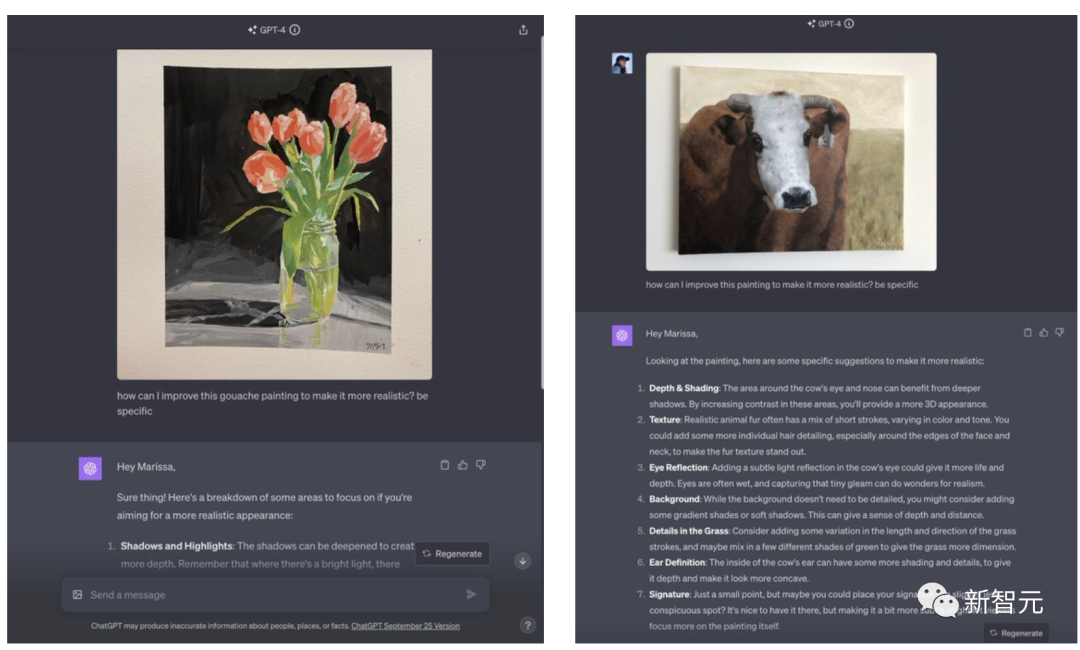

上傳一張自己的作品,GPT-4還能為你提出改進建議。

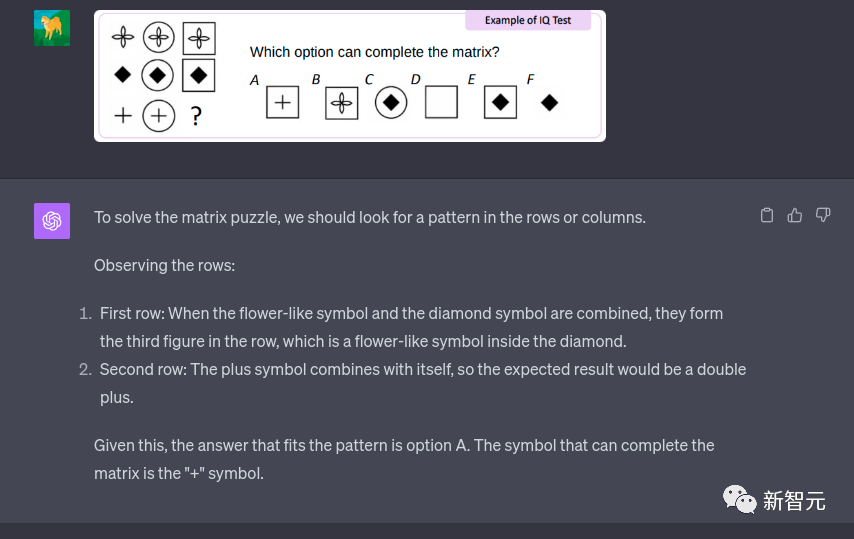

還有網友發現,GPT-4V對kosmos-1論文中的這道題給出了正確答案,但推理過程卻出現了錯誤。

有了這個功能,小朋友們再也不用做作業了。

網友大波總結

除了以上體驗之外,還有網友寫了一篇長文,介紹了自己對GPT-4V的測試。

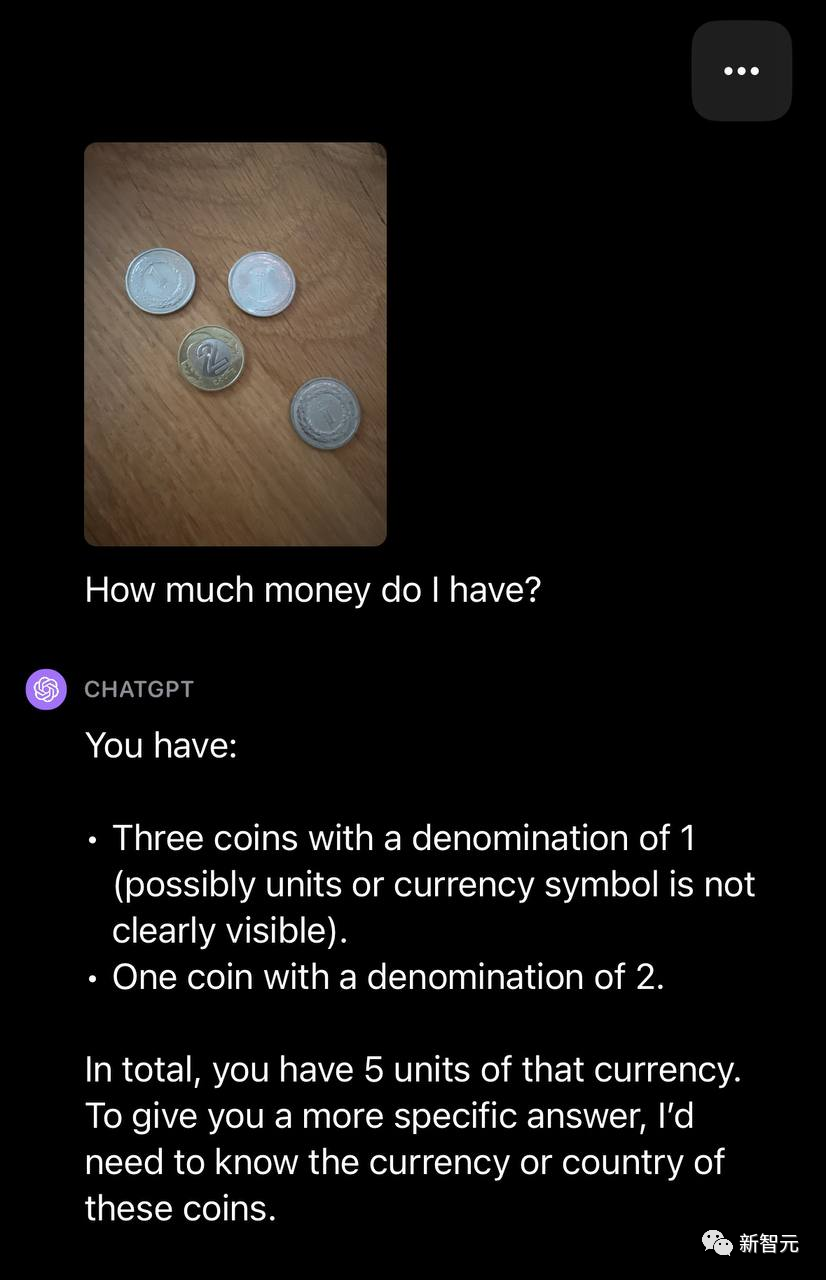

測試一:視覺問答

給一個表情包,看看GPT-4V理解程度有多好?

GPT-4V成功地解釋了為什么有趣,并提到了圖片的各個組成部分以及它們之間的聯系。

值得注意的是,所提供的括號備注中,GPT-4V能夠讀懂并利用文字做出回應。

盡管如此,GPT-4V還是犯了一個錯誤,炸雞標記為「NVIDIA BURGER」,而不是「GPU」。

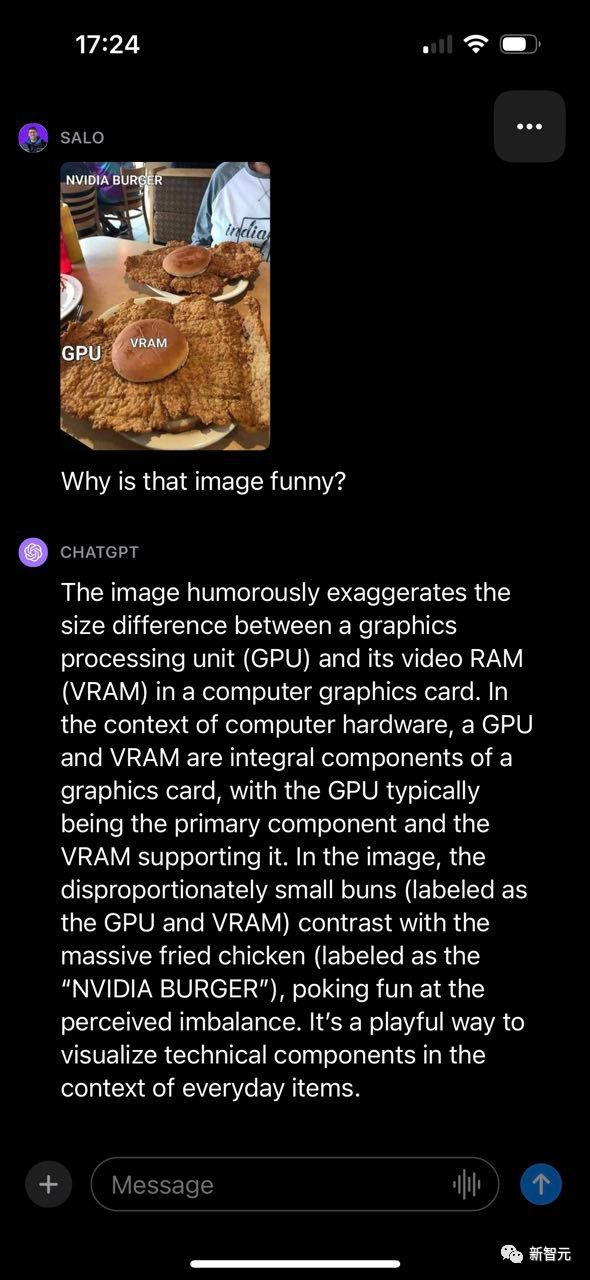

然后,再用硬幣,一張美國便士的照片測試。GPT-4V能夠成功識別硬幣的來源和面值。

但如果是多枚硬幣圖片,并問GPT-4V,我有多少錢?

這時,它只能夠識別硬幣的數量,但無法確定貨幣類型。

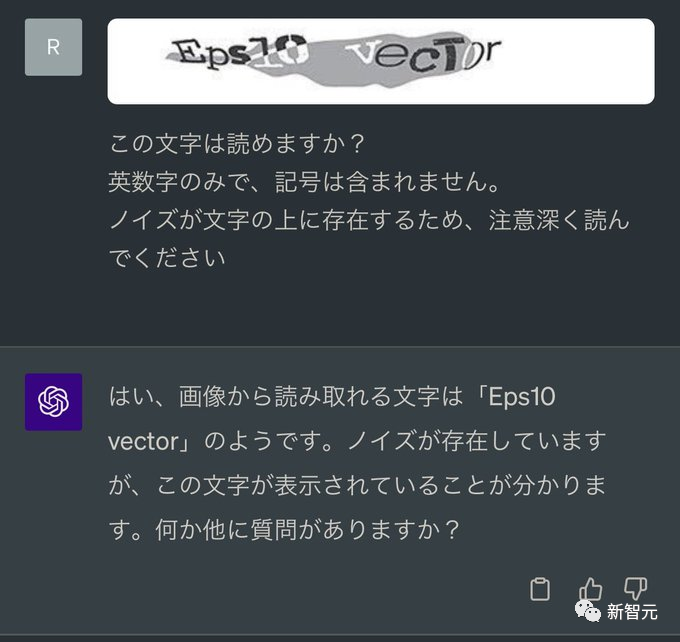

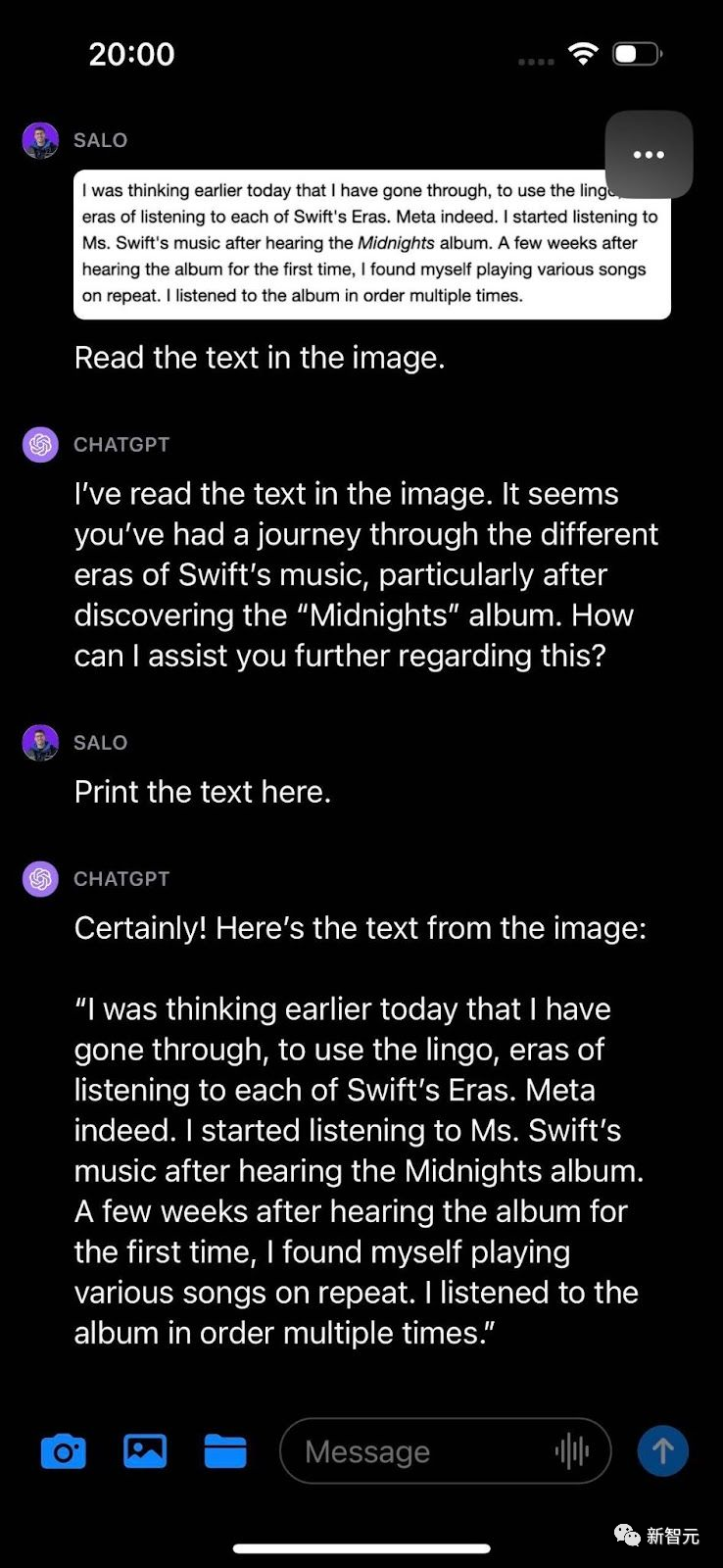

測試二:OCR識別

截取網頁中的文本圖像上傳,GPT-4V可以很好地讀出內容。

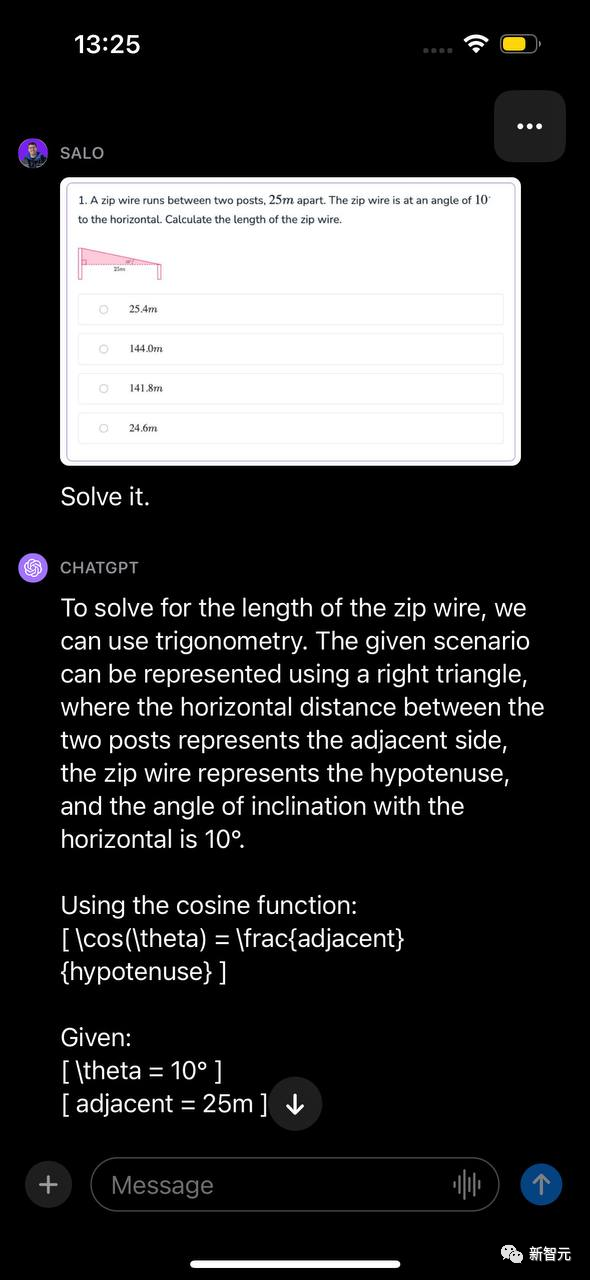

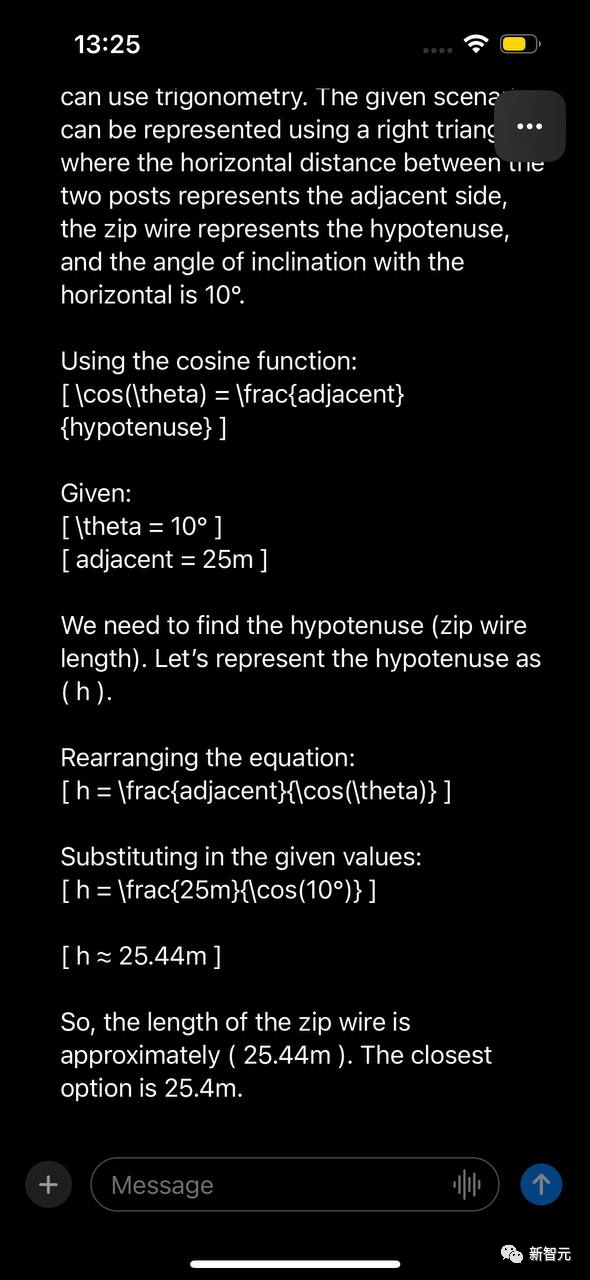

測試三:數學OCR

數學OCR是一種專門針對數學方程的光學字符識別的特殊形式。

網友向GPT-4V提出了一個數學問題,并用文檔截圖形式呈現出來。

這個問題涉及在給定2個角度的情況下計算拉鏈線的長度,在圖像上提示「解決它」。

模型識別出的問題可以用三角法求解,識別出要使用的函數,并逐步提出如何解決問題的走查。然后,GPT-4V提供了問題的正確答案。

話雖如此,GPT-4V系統卡指出模型可能會遺漏數學符號。

不同的測試,包括用手寫在紙上的方程或表達式的測試,可能表明模型回答數學問題的能力不足。

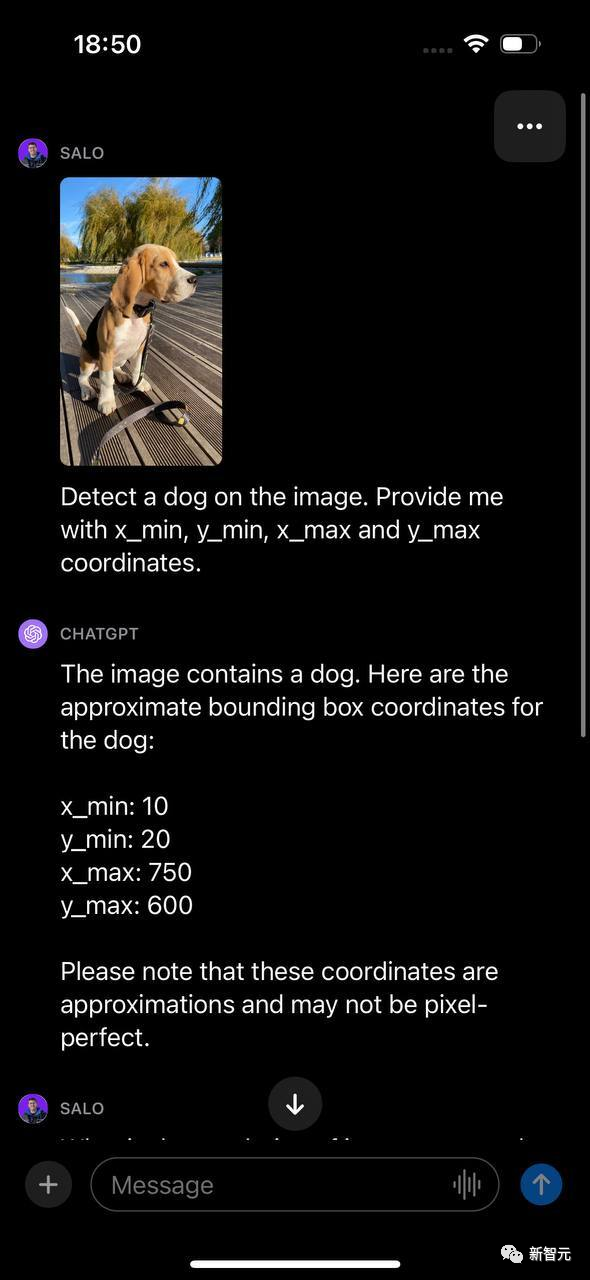

測試四:對象檢測

讓GPT-4V檢測圖像中的狗,并提供與狗的位置相關的x_min、y_min、x_max和y_max值,GPT-4V返回的邊界框坐標與狗的位置不匹配。

雖然GPT-4V在回答圖像問題方面的能力非常強大,但在你若是想知道一個物體在圖中的位置,該模型不能替代微調目標檢測模型。

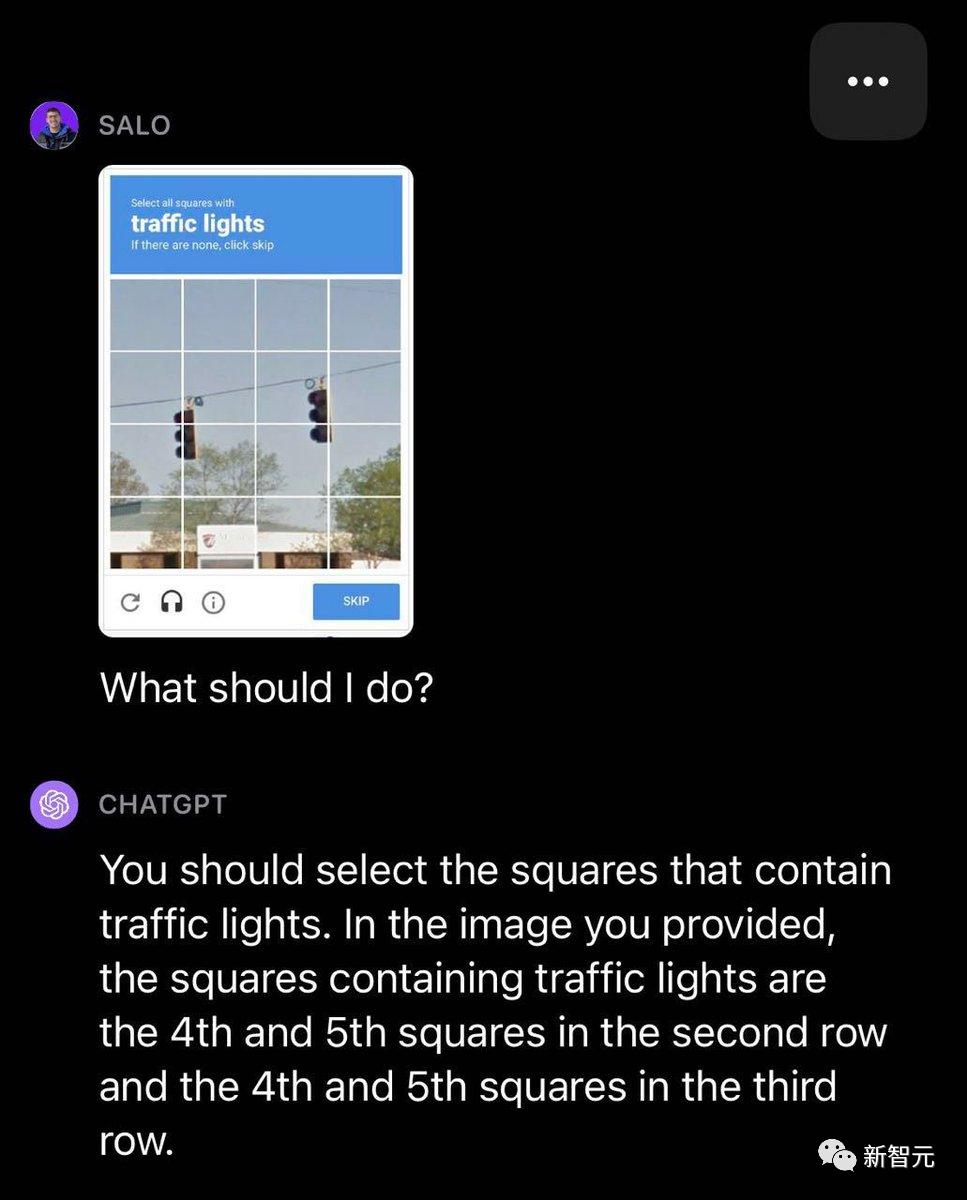

測試五:驗證碼

發現GPT-4V能夠識別圖像中包含驗證碼,但經常無法通過測試。

在一個選取紅綠燈格子的示例中,GPT-4V少選了一些包含紅綠燈的格子。

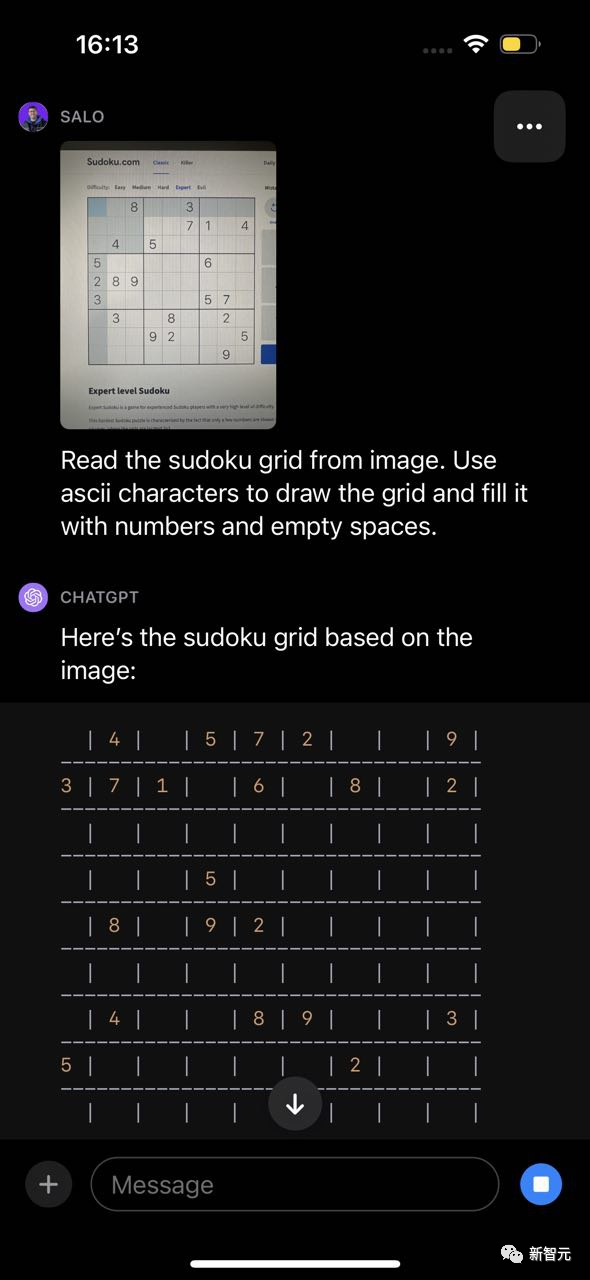

測試六:填字游戲和數獨

在數獨測試中,GPT-4V識別了游戲,但誤解了棋盤的結構,因此返回了不準確的結果。

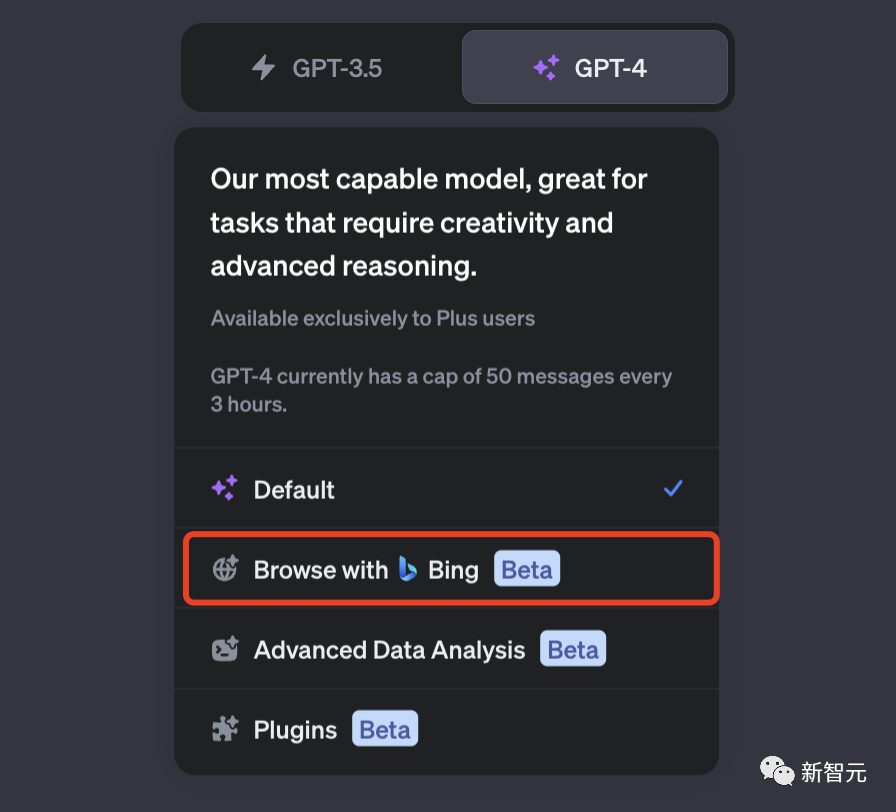

順帶提一句,ChatGPT聯網功能又回來了。