智源開放3億條語義向量模型訓練數據, BGE模型持續迭代更新

伴隨著大模型開發和應用的火熱發展,作為大模型核心基礎組件的 Embedding 重要性愈發凸顯。智源于一月前發布的開源可商用中英文語義向量模型 BGE(BAAI General Embedding)在社區收獲頗高關注度,Hugging Face 累計下載量達到數十萬。當前,BGE 快速迭代推出 1.5 版本并公布多項更新,其中,BGE 首次開源 3 億條大規模訓練數據,幫助社區訓練同類模型,推動該領域技術發展。

- MTP數據集鏈接:https://data.baai.ac.cn/details/BAAI-MTP

- BGE 模型鏈接:https://huggingface.co/BAAI

- BGE 代碼倉庫:https://github.com/FlagOpen/FlagEmbedding

3 億中英向量模型訓練數據開放

業界語義向量模型訓練數據首次開源,達 3 億中英文數據。

BGE 的出色能力很大程度上源于其大規模、多樣化的訓練數據。此前,業界同行鮮有發布同類數據集。在本次更新中,智源首次將 BGE 的訓練數據向社區予以開放,為推動此類技術進一步發展打下了基礎。

此次發布的數據集 MTP 由總計 3 億條中英文關聯文本對構成;其中,中文記錄達 1 億條,英文數據達 2 億條。數據收集自 Wudao Corpora、Pile、DuReader、Sentence Transformer 等語料,經過必要的采樣、抽取、清洗獲得。

詳細細節請參考 Data Hub:https://data.baai.ac.cn

MTP 為迄今開源的最大規模中英文關聯文本對數據集,為訓練中英文語義向量模型提供重要基礎。

響應開發者社區,BGE 功能升級

基于社區反饋,BGE 在其 1.0 的版本之上進行了進一步優化,其表現更加穩健、出色。具體升級如下:

- 模型更新。BGE-*-zh-v1.5 緩解了相似度分布問題,通過對訓練數據進行過濾,刪除低質量數據,提高訓練時溫度系數 temperature 至 0.02,使得相似度數值更加平穩 。

- 新增模型。開源 BGE-reranker 交叉編碼器模型,可更加精準找到相關文本,支持中英雙語。不同于向量模型需要輸出向量,BGE-reranker 直接文本對輸出相似度,排序準確度更高,可用于對向量召回結果的重新排序,提升最終結果的相關性。

- 新增功能。BGE1.1 增加難負樣本挖掘腳本,難負樣本可有效提升微調后檢索的效果;在微調代碼中增加在微調中增加指令的功能;模型保存也將自動轉成 sentence transformer 格式,更方便模型加載。

值得一提的是,日前,智源聯合 Hugging Face 發布了一篇技術報告,報告提出用 C-Pack 增強中文通用語義向量模型。

《C-Pack: Packaged Resources To Advance General Chinese Embedding》

鏈接:https://arxiv.org/pdf/2309.07597.pdf

在開發者社區收獲高熱度

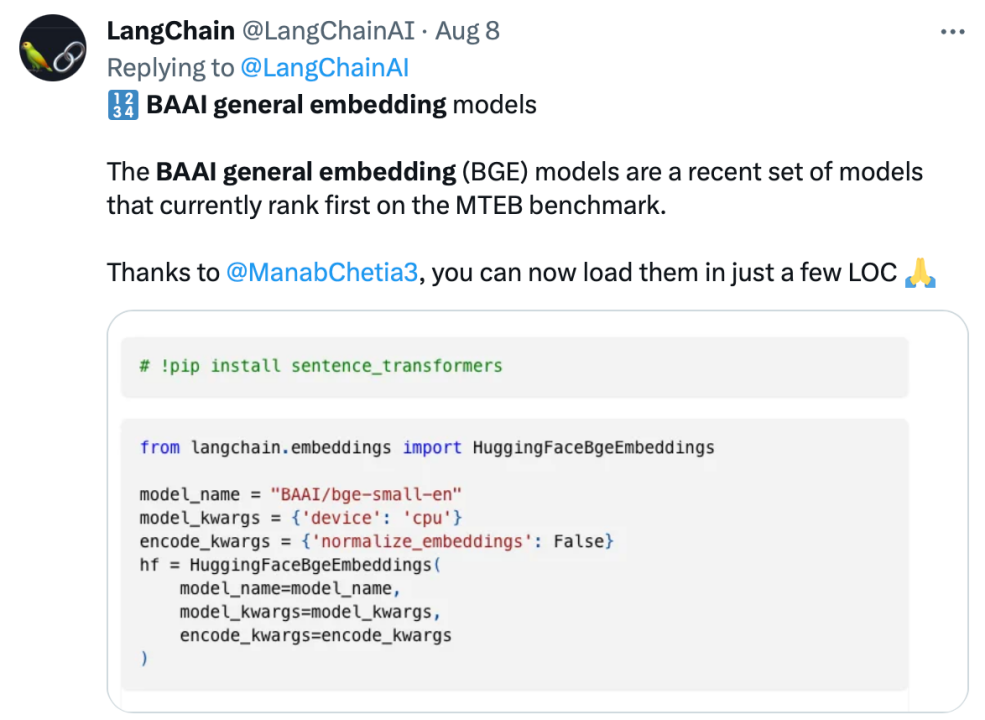

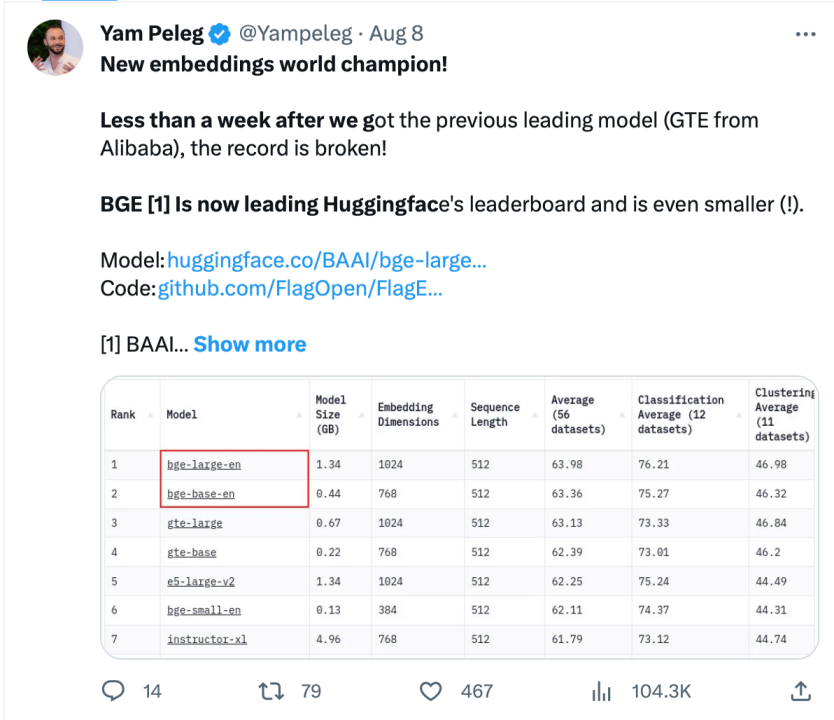

BGE 發布自以來受到大模型開發者社區關注,目前 Hugging Face 累計下載量達到數十萬,且已被 LangChain、LangChain-Chatchat、llama_index 等知名開源項目集成。

Langchain 官方、LangChain 聯合創始人兼首席執行官 Harrison Chase、Deep trading 創始人 Yam Peleg 等社區大 V 對 BGE 表示關注。

堅持開源開放,促進協同創新,智源大模型技術開體系 FlagOpen BGE 新增 FlagEmbedding 新版塊,聚焦于 Embedding 技術和模型,BGE 是其中明星開源項目之一。FlagOpen 致力于打造大模型時代的 AI 技術基礎設施,未來將持續向學術界和產業界開源更為完整的大模型全棧技術。