「人與場景交互生成」新突破!天大、清華發(fā)布Narrator:文本驅(qū)動(dòng),自然可控|ICCV 2023

自然可控的人與場景交互(Human Scene Interaction, HSI)生成在虛擬現(xiàn)實(shí)/增強(qiáng)現(xiàn)實(shí)(VR/AR)內(nèi)容創(chuàng)作和以人為中心的人工智能等多個(gè)領(lǐng)域發(fā)揮著重要作用。

然而,現(xiàn)有方法的可控能力有限、交互種類有限、生成結(jié)果不自然,嚴(yán)重限制了其在現(xiàn)實(shí)中的應(yīng)用場景。

針對(duì)這一問題,天津大學(xué)團(tuán)隊(duì)聯(lián)合清華大學(xué)在ICCV 2023的工作中提出Narrator,將重點(diǎn)放在一項(xiàng)具有挑戰(zhàn)性的任務(wù)上,即從文本描述中自然可控地生成逼真且多樣的人與場景交互。

圖片

圖片

項(xiàng)目主頁:http://cic.tju.edu.cn/faculty/likun/projects/Narrator

代碼:https://github.com/HaibiaoXuan/Narrator

從人類認(rèn)知角度來看,理想的生成模型應(yīng)能正確推理空間關(guān)系并探索交互的自由度。

因此,作者提出了一個(gè)基于關(guān)系推理的生成模型,通過場景圖分別對(duì)場景和描述中的空間關(guān)系進(jìn)行建模,并引入一種將交互動(dòng)作表示為原子身體部位狀態(tài)的部位級(jí)交互機(jī)制。

特別是,受益于關(guān)系推理,作者進(jìn)一步提出了一種簡單但有效的多人生成策略,這是當(dāng)時(shí)對(duì)可控的多人場景交互生成的首次探索。

最后,作者進(jìn)行了大量實(shí)驗(yàn)和用戶調(diào)研,證明了Narrator能夠可控地生成多樣化的交互,其效果明顯優(yōu)于現(xiàn)有工作。

方法動(dòng)機(jī)

現(xiàn)有的人與場景交互生成方法大多關(guān)注在交互的物理幾何關(guān)系,但缺乏對(duì)生成的語義控制,也局限于單人生成。

因此,作者著眼于一項(xiàng)具有挑戰(zhàn)性的任務(wù),即從自然語言描述中可控生成真實(shí)且多樣的人與場景交互。作者觀察到人類通常會(huì)通過空間感知和動(dòng)作識(shí)別來自然描述在不同地點(diǎn)進(jìn)行各種互動(dòng)的人。

圖片

圖片

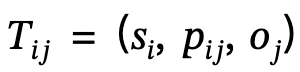

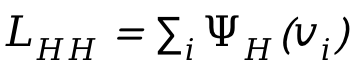

圖1 Narrator可以自然可控地生成語義一致且物理合理的人與場景交互,適用于以下各種情況:(a)由空間關(guān)系引導(dǎo)的交互,(b)由多動(dòng)作引導(dǎo)的交互,(c)多人場景交互,以及(d)結(jié)合上述交互類型的人與場景交互。

具體來說,空間關(guān)系可以表示為場景或局部區(qū)域中不同物體之間的相互關(guān)系,而交互動(dòng)作則由原子身體部位狀態(tài)指定,如人的腳踩地、軀干靠著、右手輕拍和低著頭等。

以此為出發(fā)點(diǎn),作者采用場景圖來表示空間關(guān)系,提出了聯(lián)合全局和局部場景圖 (Joint Global and Local Scene Graph, JGLSG) 機(jī)制,為隨后的生成提供了全局位置感知。

同時(shí),考慮到身體部位狀態(tài)是模擬符合文本的逼真交互的關(guān)鍵,作者引入了部位級(jí)動(dòng)作(Part-Level Action, PLA)機(jī)制來建立人體部位與動(dòng)作之間的對(duì)應(yīng)關(guān)系。

受益于有效的觀察認(rèn)知以及所提出的關(guān)系推理的靈活性和復(fù)用性,作者進(jìn)一步提出一種簡單而有效的多人生成策略,這是當(dāng)時(shí)第一個(gè)自然可控且用戶友好的多人場景交互(Multi-Human Scene Interaction, MHSI)生成方案。

方法思路

Narrator框架總覽

Narrator的目的是自然可控地生成人與場景交互,這種交互在語義上與文本描述一致且在物理上與三維場景匹配。

圖片

圖片

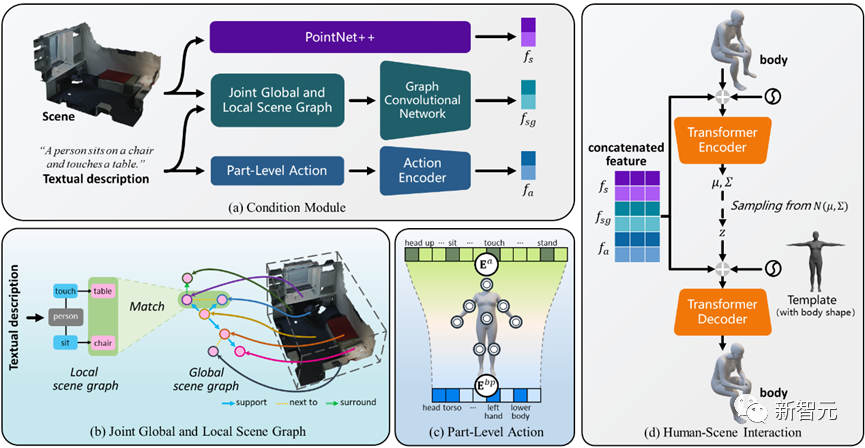

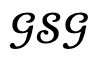

圖2 Narrator框架總覽

如圖2所示,該方法采用基于Transformer的條件變分自編碼器 (cVAE),主要包括:

1)與孤立考慮場景或物體的現(xiàn)有研究相比,設(shè)計(jì)了一種聯(lián)合全局和局部場景圖機(jī)制,來推理復(fù)雜空間關(guān)系和實(shí)現(xiàn)全局定位感知;

2)針對(duì)人們會(huì)同時(shí)通過不同的身體部位完成交互動(dòng)作的觀察,引入了部件級(jí)動(dòng)作機(jī)制,以實(shí)現(xiàn)逼真和多樣化的交互;

3)在場景感知優(yōu)化過程中額外引入了交互二分面損失,以便獲得更好的生成結(jié)果;

4)進(jìn)一步擴(kuò)展到多人交互生成,并最終促進(jìn)了多人場景交互的第一步。

聯(lián)合全局和局部場景圖機(jī)制

空間關(guān)系的推理可以為模型提供特定場景的線索,對(duì)于實(shí)現(xiàn)人與場景交互的自然可控性具有重要作用。

因此,作者設(shè)計(jì)了一種全局和局部場景圖聯(lián)合機(jī)制,通過以下三個(gè)步驟來實(shí)現(xiàn):

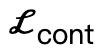

1. 全局場景圖生成:給定場景,用預(yù)訓(xùn)練好的場景圖模型生成全局場景圖,即 ,其中

,其中 ,

, 是帶有類別標(biāo)簽的對(duì)象,

是帶有類別標(biāo)簽的對(duì)象, 是

是 和

和 之間的關(guān)系,n是物體數(shù)量,m是關(guān)系數(shù)量;

之間的關(guān)系,n是物體數(shù)量,m是關(guān)系數(shù)量;

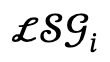

2. 局部場景圖生成:采用語義解析工具來識(shí)別描述的句式結(jié)構(gòu)并提取生成局部場景 ,其中

,其中 定義了主語-謂語-對(duì)象的三元組;

定義了主語-謂語-對(duì)象的三元組;

3. 場景圖匹配:模型根據(jù)相同的對(duì)象語義標(biāo)簽將全局與局部場景圖中的節(jié)點(diǎn)對(duì)應(yīng)起來,并通過擴(kuò)展邊關(guān)系來自動(dòng)增加一個(gè)虛擬人節(jié)點(diǎn)以提供位置信息。

部件級(jí)動(dòng)作(PLA)機(jī)制

場景中人的交互是由原子身體部位狀態(tài)組成的,因此作者提出了一種細(xì)粒度部位級(jí)動(dòng)作機(jī)制,使得模型能從給定交互中注意重要部位而忽略無關(guān)部位。

具體來說,作者探索了豐富且多樣的交互動(dòng)作,并將這些可能的動(dòng)作對(duì)應(yīng)到人體的五個(gè)主要部位:頭部、軀干、左/右臂、左/右手和左/右下半身。

同時(shí),分別使用獨(dú)熱編碼(One-Hot)代表這些動(dòng)作和身體部位,并根據(jù)對(duì)應(yīng)關(guān)系將它們連接起來以便后續(xù)編碼。

對(duì)于多動(dòng)作的交互生成,作者采用注意力機(jī)制來學(xué)習(xí)身體結(jié)構(gòu)的不同部位狀態(tài)。

在給定的交互動(dòng)作組合中,每個(gè)動(dòng)作對(duì)應(yīng)的身體部位與所有其他動(dòng)作之間的注意力都會(huì)被自動(dòng)屏蔽。

以「一個(gè)人使用柜子蹲在地上」為例,蹲下對(duì)應(yīng)的是下半身狀態(tài),因此其他部位標(biāo)記的注意力將被屏蔽為零。

場景感知優(yōu)化

作者利用幾何和物理約束進(jìn)行場景感知優(yōu)化,以改善生成結(jié)果。在整個(gè)優(yōu)化過程中,該方法確保生成的姿勢(shì)不會(huì)出現(xiàn)偏差,同時(shí)鼓勵(lì)與場景接觸,并約束身體以避免與場景相互穿透。

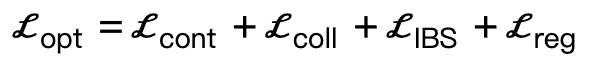

給定三維場景S和生成的SMPL-X參數(shù)后,優(yōu)化損失為:

其中, 鼓勵(lì)身體頂點(diǎn)與場景接觸;

鼓勵(lì)身體頂點(diǎn)與場景接觸; 是基于符號(hào)距離的碰撞項(xiàng);

是基于符號(hào)距離的碰撞項(xiàng); 是相比現(xiàn)有工作額外引入的交互二分面(IBS)損失,其為取樣于場景和人體之間的等距點(diǎn)集合;

是相比現(xiàn)有工作額外引入的交互二分面(IBS)損失,其為取樣于場景和人體之間的等距點(diǎn)集合; 是一個(gè)正則因子,用于懲罰偏離初始化的參數(shù)。

是一個(gè)正則因子,用于懲罰偏離初始化的參數(shù)。

多人場景交互(MHSI)

在現(xiàn)實(shí)世界的場景中,很多情況下并非只有一個(gè)人與場景交互,而是多人以獨(dú)立或關(guān)聯(lián)的方式進(jìn)行交互。

然而,由于缺乏MHSI數(shù)據(jù)集,現(xiàn)有方法通常需要額外的人工努力,無法以可控和自動(dòng)的方式處理這項(xiàng)任務(wù)。

為此,作者僅利用現(xiàn)有的單人數(shù)據(jù)集,為多人生成方向提出了一種簡單而有效的策略。

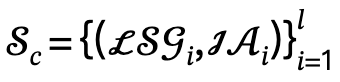

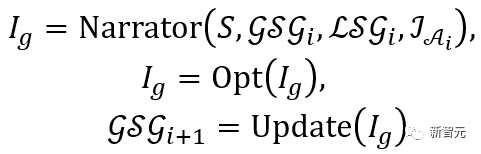

給定多人相關(guān)的文本描述后,作者首先將其解析為多個(gè)局部場景圖 和交互動(dòng)作

和交互動(dòng)作 ,并定義候選集為

,并定義候選集為 ,其中l(wèi)為人數(shù)。

,其中l(wèi)為人數(shù)。

對(duì)于候選集中的每一項(xiàng),首先將其與場景 和對(duì)應(yīng)全局場景圖

和對(duì)應(yīng)全局場景圖 一起輸入Narrator,然后執(zhí)行優(yōu)化過程。

一起輸入Narrator,然后執(zhí)行優(yōu)化過程。

為了處理人與人之間的碰撞,在優(yōu)化過程中額外引入了損失 ,其中

,其中 為人與人符號(hào)距離。

為人與人符號(hào)距離。

然后,當(dāng)優(yōu)化損失低于根據(jù)實(shí)驗(yàn)經(jīng)驗(yàn)確定的閾值時(shí),接受這一生成結(jié)果,同時(shí)通過添加人類節(jié)點(diǎn)更新 ;否則認(rèn)為生成結(jié)果不可信,并通過屏蔽對(duì)應(yīng)的物體節(jié)點(diǎn)來更新

;否則認(rèn)為生成結(jié)果不可信,并通過屏蔽對(duì)應(yīng)的物體節(jié)點(diǎn)來更新 。

。

值得注意的是,這種更新方式建立了每一代結(jié)果與前一代結(jié)果之間的關(guān)系,避免了一定程度的擁擠,并且與簡單的多次生成相比空間分布更合理和交互更逼真。

以上過程可以表述為:

實(shí)驗(yàn)結(jié)果

由于目前現(xiàn)存的方法無法直接從文本描述中自然可控地生成人與場景交互,作者將PiGraph [1]、POSA [2]、COINS [3] 合理擴(kuò)展為適用于文本描述的方式,并使用相同的數(shù)據(jù)集訓(xùn)練它們的官方模型,修改后的方法定義為PiGraph-Text、POSA-Text和COINS-Text。

圖片

圖片

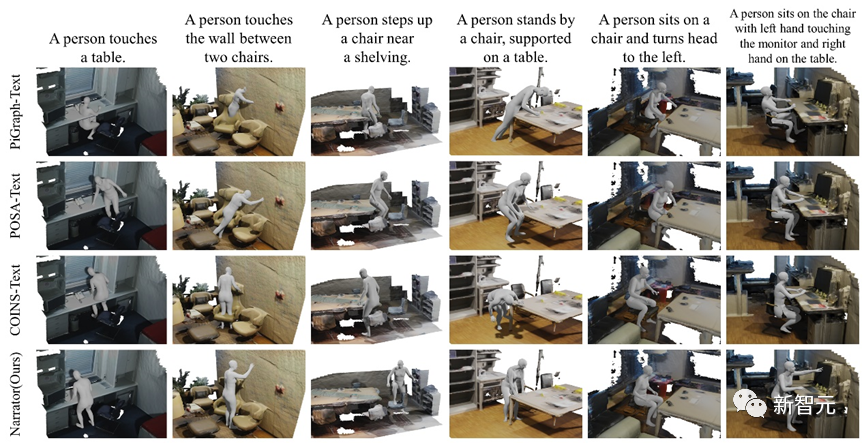

圖3 不同方法的定性對(duì)比結(jié)果

圖3展示了Narrator與三種基線的定性比較結(jié)果。PiGraph-Text由于其自身表現(xiàn)形式的限制,存在更嚴(yán)重的穿透問題。

POSA-Text在優(yōu)化過程中往往會(huì)陷入局部最小值,從而產(chǎn)生不良的交互接觸。COINS-Text將動(dòng)作綁定到特定物體上,缺乏對(duì)場景的全局感知,從而導(dǎo)致與未指定物體的穿透,并且難以處理復(fù)雜的空間關(guān)系。

相比之下,Narrator可以根據(jù)不同層次的文字描述,正確推理空間關(guān)系,剖析多動(dòng)作下的身體狀態(tài),從而獲得更好的生成效果。

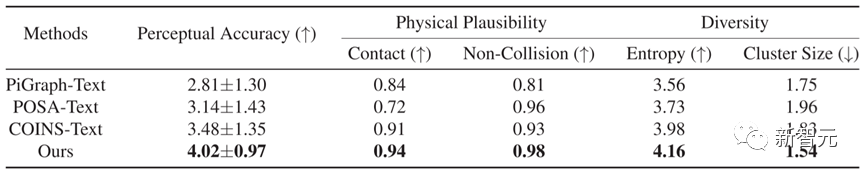

在定量比較方面,如表1所示,Narrator在五個(gè)指標(biāo)上均優(yōu)于其他方法,顯示出該方法生成的結(jié)果具有更準(zhǔn)確的文本一致性和更優(yōu)秀的物理合理性。

表1 不同方法的定量對(duì)比結(jié)果

表1 不同方法的定量對(duì)比結(jié)果

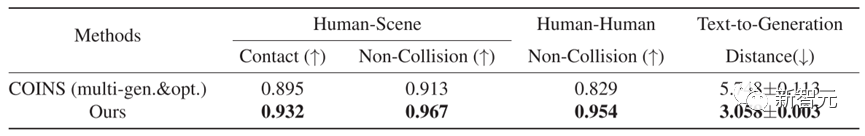

除此之外,作者也提供了詳細(xì)的比較與分析來更好了解所提出的MHSI策略的有效性。

考慮到目前還沒有針對(duì)MHSI的工作,他們選擇了一種直接的方法作為基線,即與用COINS按順序生成和優(yōu)化的方法。

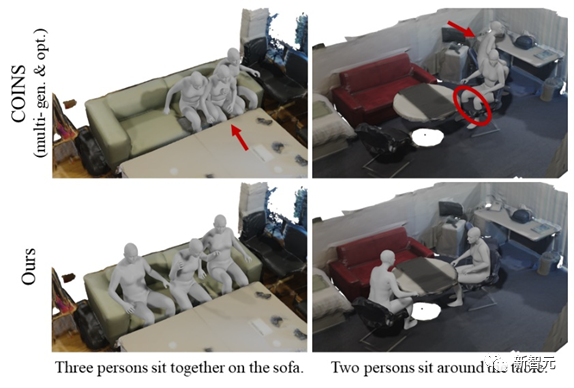

為了進(jìn)行公平比較,同樣為其引入了人為碰撞損失。圖4和表2分別展示了定性和定量結(jié)果,都有力證明了作者所提出的策略在MHSI上語義一致和物理合理的優(yōu)勢(shì)。

圖4 與用 COINS 按順序生成和優(yōu)化的方法進(jìn)行的MHSI定性比較

圖4 與用 COINS 按順序生成和優(yōu)化的方法進(jìn)行的MHSI定性比較

作者簡介

主要研究方向:三維視覺、計(jì)算機(jī)視覺、人與場景交互生成

主要研究方向:三維視覺、計(jì)算機(jī)視覺、人體與衣物重建

主要研究方向:三維視覺、計(jì)算機(jī)視覺、圖像生成

主要研究方向:以人為中心的計(jì)算機(jī)視覺和圖形學(xué)

主要研究方向:計(jì)算機(jī)圖形學(xué),三維視覺與計(jì)算攝像

個(gè)人主頁:https://liuyebin.com/

主要研究方向:三維視覺、智能重建與生成

個(gè)人主頁:http://cic.tju.edu.cn/faculty/likun

參考資料:

[1] Savva M, Chang A X, Hanrahan P, et al. Pigraphs: learning interaction snapshots from observations[J]. ACM Transactions on Graphics (TOG), 2016, 35(4): 1-12.

[2] Hassan M, Ghosh P, Tesch J, et al. Populating 3D scenes by learning human-scene interaction[C]. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2021: 14708-14718.

[3] Zhao K, Wang S, Zhang Y, et al. Compositional human-scene interaction synthesis with semantic control[C]. European Conference on Computer Vision. Cham: Springer Nature Switzerland, 2022: 311-327.