基于Hadoop生態SparkStreaming的大數據實時流處理平臺的搭建

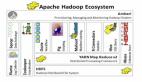

隨著公司業務發展,對大數據的獲取和實時處理的要求就會越來越高,日志處理、用戶行為分析、場景業務分析等等,傳統的寫日志方式根本滿足不了業務的實時處理需求,所以本人準備開始著手改造原系統中的數據處理方式,重新搭建一個實時流處理平臺,主要是基于hadoop生態,利用Kafka作為中轉,SparkStreaming框架實時獲取數據并清洗,將結果多維度的存儲進HBase數據庫。

整個平臺大致的框架如下:

操作系統:Centos7

用到的框架:

- Flume1.8.0

- Hadoop2.9.0

- kafka2.11-1.0.0

- Spark2.2.1

- HBase1.2.6

- ZooKeeper3.4.11

- maven3.5.2

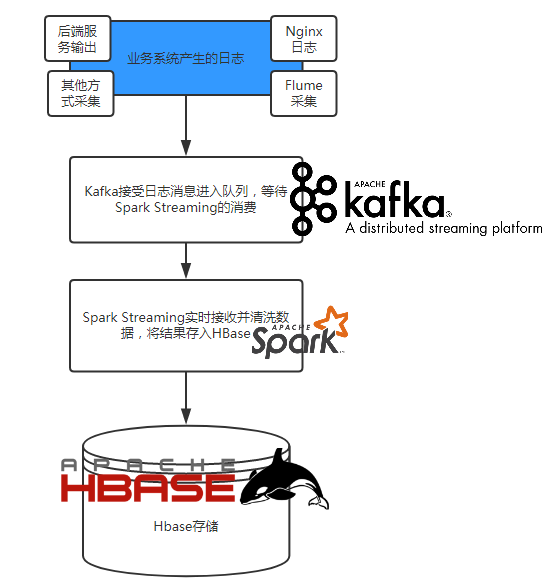

整體的開發環境是基于JDK1.8以上以及Scala,所以得提前把java和Scala的環境給準備好,接下來就開始著手搭建基礎平臺:

一、配置開發環境

下載并解壓JDK1.8,、下載并解壓Scala,配置profile文件:

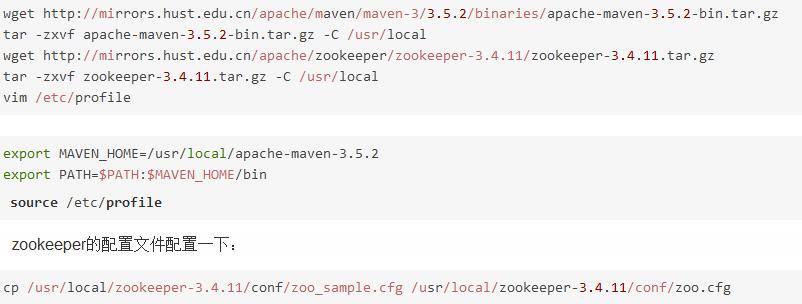

二、配置zookeeper、maven環境

下載并解壓zookeeper以及maven并配置profile文件

然后配置一下zoo.cfg里面的相關配置,指定一下dataDir目錄等等

啟動zookeeper:

- /usr/local/zookeeper-3.4.11/bin/zkServer.sh start

如果不報錯,jps看一下是否啟動成功

三、安裝配置Hadoop

Hadoop的安裝配置在之前文章中有說過(傳送門),為了下面的步驟方便理解,這里只做一個單機版的簡單配置說明:

下載hadoop解壓并配置環境:

首先配置hadoop-env.sh、yarn-env.sh,修改JAVA_HOME到指定的JDK安裝目錄/usr/local/java/jdk1.8.0_144

創建hadoop的工作目錄

- mkdir /opt/data/hadoop

編輯core-site.xml、hdfs-site.xml、yarn-site.xml等相關配置文件,具體配置不再闡述請看前面的文章,配置完成之后記得執行hadoop namenode -format,否則hdfs啟動會報錯,啟動完成后不出問題瀏覽器訪問50070端口會看到hadoop的頁面。

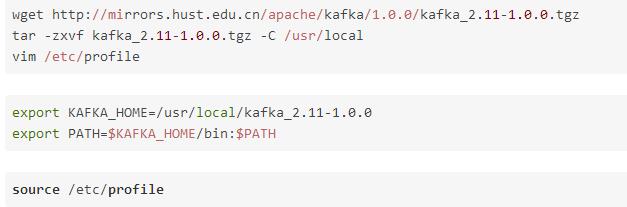

四、安裝配置kafka

還是一樣,先下載kafka,然后配置:

進入kafka的config目錄,配置server.properties,指定log.dirs和zookeeper.connect參數;配置zookeeper.properties文件中zookeeper的dataDir,配置完成后啟動kafka

- kafka-server-start.sh -daemon $KAFKA_HOME/config/server.properties

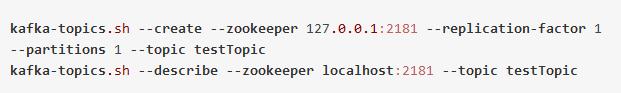

可以用jps查看有沒有kafka進程,然后測試一下kafka是否能夠正常收發消息,開兩個終端,一個用來做producer發消息一個用來做consumer收消息,首先,先創建一個topic

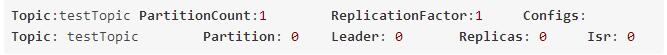

如果不出一下會看到如下輸出:

然后在第一個終端中輸入命令:

- kafka-console-producer.sh –broker-list localhost:9092 –topic testTopic

在第二個終端中輸入命令:

- kafka-console-consumer.sh –zookeeper 127.0.0.1:2181 –topic testTopic

如果啟動都正常,那么這兩個終端將進入阻塞監聽狀態,在第一個終端中輸入任何消息第二個終端都將會接收到。

五、安裝配置HBase

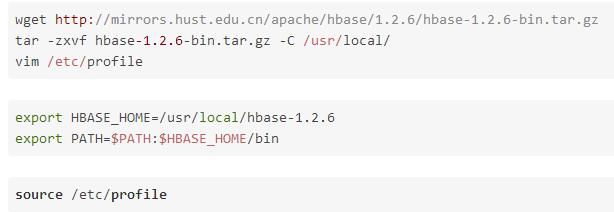

下載并解壓HBase:

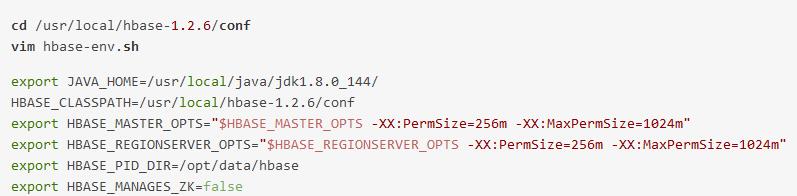

修改hbase下的配置文件,首先修改hbase-env.sh,主要修改JAVA_HOME以及相關參數,這里要說明一下HBASE_MANAGES_ZK這個參數,因為采用了自己的zookeeper,所以這里設置為false,否則hbase會自己啟動一個zookeeper

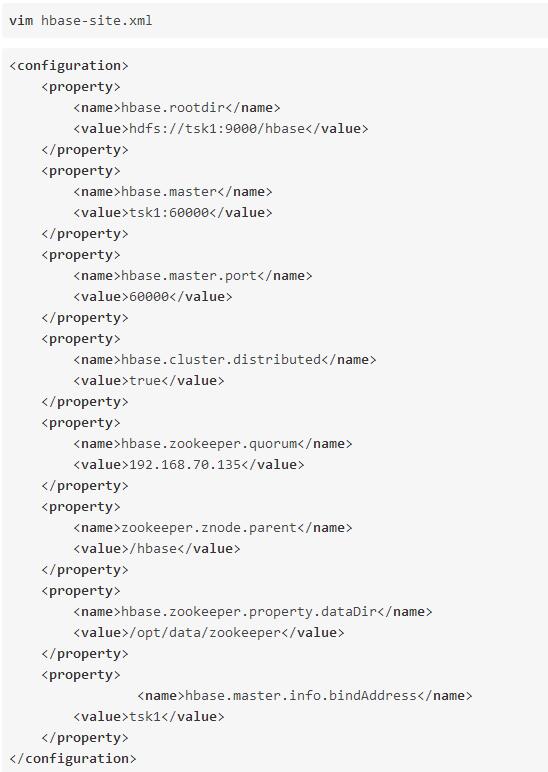

然后修改hbase-site.xml,我們設置hbase的文件放在hdfs中,所以要設置hdfs地址,其中tsk1是我安裝hadoop的機器的hostname,hbase.zookeeper.quorum參數是安裝zookeeper的地址,這里的各種地址最好用機器名

配置完成后啟動hbase,輸入命令:

- start-hbase.sh

完成后查看日志沒有報錯的話測試一下hbase,用hbase shell進行測試:

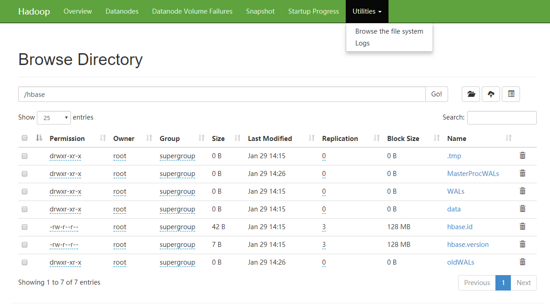

至此,hbase搭建成功,訪問以下hadoop的頁面,查看file system(菜單欄Utilities->Browse the file system),這時可以看見base的相關文件已經載hadoop的文件系統中。

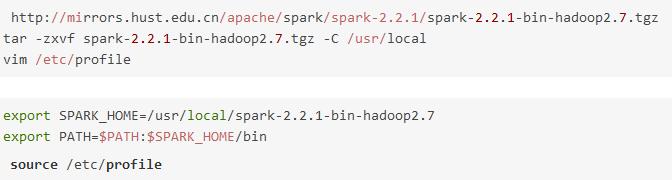

六、安裝spark

下載spark并解壓

七、測試

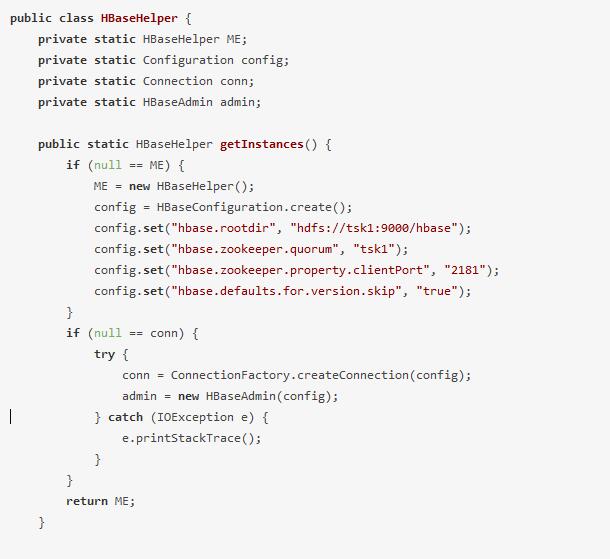

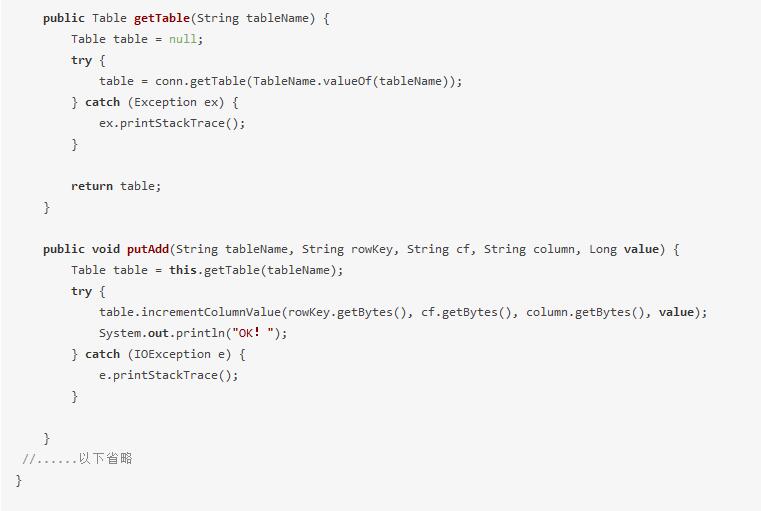

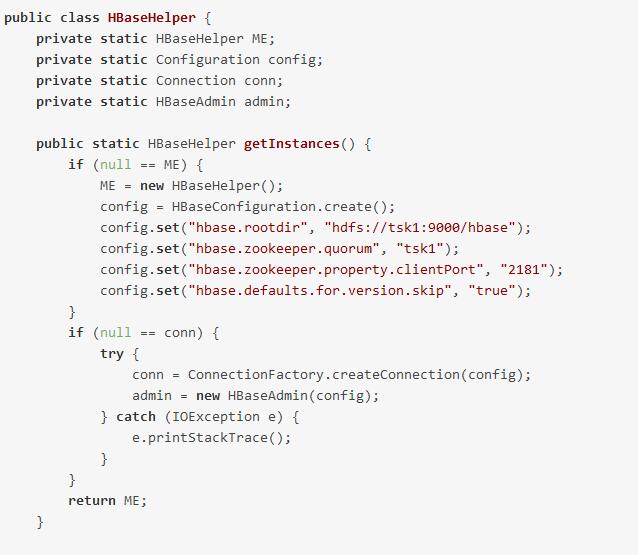

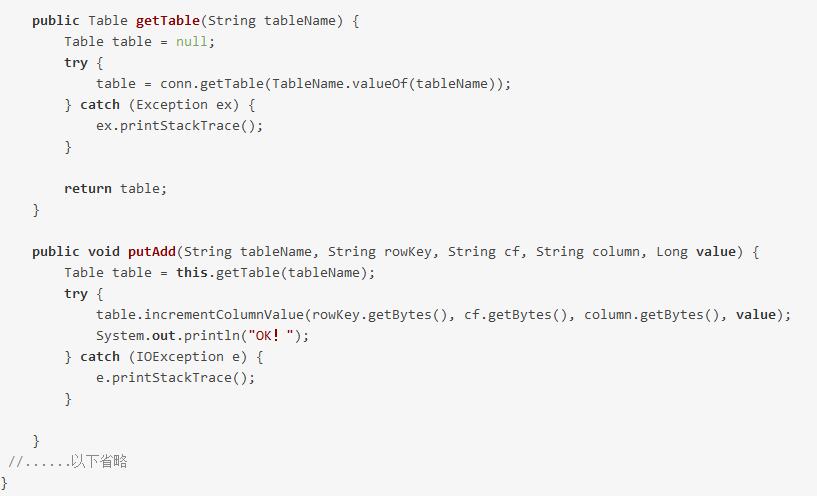

至此,環境基本搭建完成,以上搭建的環境僅是服務器生產環境的一部分,涉及服務器信息、具體調優信息以及集群的搭建就不寫在這里了,下面我們寫一段代碼整體測試一下從kafka生產消息到spark streaming接收到,然后處理消息并寫入HBase。先寫一個HBase的連接類HBaseHelper:

再寫一個測試類KafkaRecHbase用來做spark-submit提交

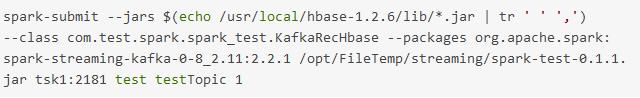

編譯提交到服務器,執行命令:

沒報錯的話執行kafka的producer,輸入幾行數據在HBase內就能看到結果了!

八、裝一個Flume實時采集Nginx日志寫入Kafka

Flume是一個用來日志采集的框架,安裝和配置都比較簡單,可以支持多個數據源和輸出,具體可以參考Flume的文檔,寫的比較全 傳送門

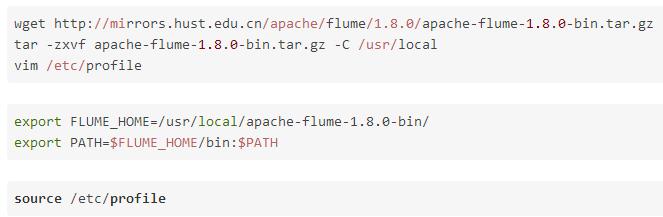

下載Flume并配置環境

寫一個Flume的配置文件在flume的conf目錄下:

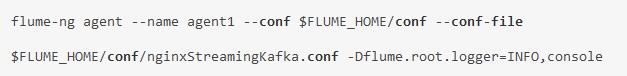

kafka創建一個名為flumeKafka的topic用來接收,然后啟動flume:

如果沒有報錯,Flume將開始采集opt/data/nginxLog/nginxLog.log中產生的日志并實時推送給kafka,再按照上面方法寫一個spark streaming的處理類進行相應的處理就好。

OK!全部搞定,然而~~~~就這樣就搞定了?NO!!!這只是萬里長征的第一步!呵呵!