深度神經(jīng)網(wǎng)絡(luò)比拼人類視覺(jué):信號(hào)弱時(shí)的物體識(shí)別差異

近日,來(lái)自德國(guó) Tubingen大學(xué)和Potsdam大學(xué)的研究人員們共同發(fā)布了一項(xiàng)研究成果——深度神經(jīng)網(wǎng)絡(luò)和人類視覺(jué)在信號(hào)變?nèi)鯐r(shí)進(jìn)行物體識(shí)別的差異對(duì)比。這些專家分別來(lái)自神經(jīng)信息處理、綜合神經(jīng)學(xué)、心理學(xué)與生物控制等不同領(lǐng)域。此項(xiàng)研究旨在對(duì)DNN和人類神經(jīng)系統(tǒng)的結(jié)構(gòu)和處理過(guò)程的差別作出相應(yīng)解釋,并且找到在信號(hào)變?nèi)鯐r(shí)兩種視覺(jué)系統(tǒng)的分類錯(cuò)誤模式的不同。

論文:Comparing deep neural networks against humans: object recognition when the signal gets weaker

論文鏈接:https://arxiv.org/pdf/1706.06969.pdf

摘要:人類視覺(jué)在進(jìn)行物體識(shí)別時(shí)通常是很迅速的,而且似乎毫不費(fèi)力,并且很大程度上與視角和面向?qū)ο鬅o(wú)關(guān)。直到最近,動(dòng)態(tài)視覺(jué)系統(tǒng)才有能力完成這一非凡的計(jì)算技能。這正是隨著一類叫做深度神經(jīng)網(wǎng)絡(luò)(DNN)算法的出現(xiàn)而改變的,它在物體識(shí)別任務(wù)中已經(jīng)可以達(dá)到人類級(jí)別的分類表現(xiàn)。而且,更多與 DNN 方法相類似的研究報(bào)告,還有人體視覺(jué)系統(tǒng)處理物體的進(jìn)程,都表明現(xiàn)在的 DNN 可能就是人類視覺(jué)進(jìn)行物體識(shí)別的良好模型。然而,***型的 DNN 和靈長(zhǎng)類動(dòng)物的視覺(jué)系統(tǒng)確實(shí)在結(jié)構(gòu)和處理過(guò)程上還存在著明顯的不同。這些不同的潛在的行為結(jié)果還不能得到充分的解釋。我們的目標(biāo)正是通過(guò)比較人類和 DNN 對(duì)圖像降解(image degradations)的整合能力來(lái)解決這一問(wèn)題。我們發(fā)現(xiàn)人類視覺(jué)系統(tǒng)對(duì)圖像處理操作具有更好的魯棒性,比如在反差衰(contrast reduction)、加性噪聲(additive noise)或者新型的幻象失真(eidolon-distortions)這些方面。而且我們逐步地找到了在信號(hào)逐漸變?nèi)鯐r(shí),人類和 DNN 進(jìn)行分類時(shí)的錯(cuò)誤方式的不同,這表明人類和現(xiàn)在的 DNN 在進(jìn)行視覺(jué)物體識(shí)別(visual object recognition)時(shí)仍舊存在著很大差異。我們希望我們的發(fā)現(xiàn),還有我們經(jīng)過(guò)仔細(xì)測(cè)試而且可以自由使用的行為型數(shù)據(jù)集,可以給計(jì)算機(jī)視覺(jué)界提供一種新的且實(shí)用的基準(zhǔn),從而來(lái)增強(qiáng) DNN 的魯棒性,并且促使神經(jīng)科學(xué)家去搜尋可以促進(jìn)這種魯棒性的大腦機(jī)制。

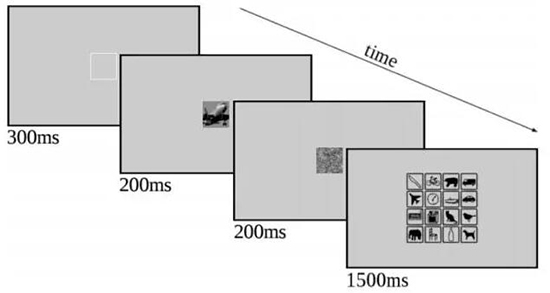

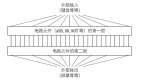

圖 1

圖 1.:實(shí)驗(yàn)原理圖。在呈現(xiàn)出一個(gè)中央固定方塊之后(300 ms),圖像在 200ms 的情況下可視,緊接著是一個(gè) 1/f 頻譜(200ms)的噪聲屏蔽(noise-mask)。然后,在 1500ms 時(shí)出現(xiàn)一個(gè)響應(yīng)屏,在這里觀察者可以點(diǎn)擊一個(gè)類別。注意我們?cè)谶@張圖中增強(qiáng)了噪聲屏蔽的對(duì)比,這是為了在出版時(shí)擁有更好的可視性。從上到下的類別分別是:刀具,自行車,熊,卡車,飛機(jī),表,船,小汽車,鍵盤(pán),烤箱,貓,鳥(niǎo),大象,椅子,瓶子,狗。這些圖示是 MS COCO(http://mscoco.org/ explore/)版本的修改版。

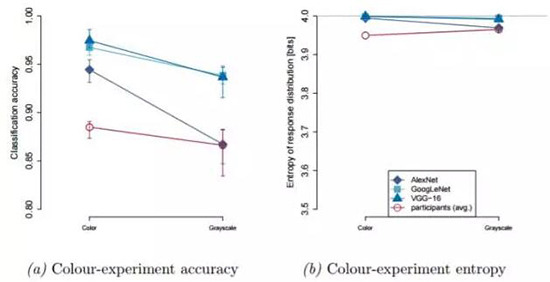

圖 2

圖 2: 顏色試驗(yàn)結(jié)果(n=3)。(a)精度。DNN 對(duì)應(yīng)藍(lán)色,人類對(duì)應(yīng)紅色;菱形對(duì)應(yīng) AlexNet,方形對(duì)應(yīng) GoogLeNet,三角是 VGG-16,圓圈是人類觀察者。(b)響應(yīng)分布熵(Response distribution entropy)。

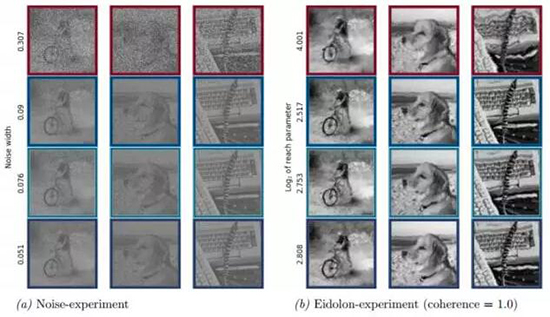

圖 3

圖 3: 預(yù)估刺激信號(hào)(Estimated stimuli)對(duì)應(yīng) 50% 分類精度。(a)噪聲實(shí)驗(yàn)。(b)Eidolon 實(shí)驗(yàn)。連貫性參數(shù)=1.0。首行:刺激信號(hào)(stimuli)對(duì)應(yīng)平均人類觀察者的閾值(threshold)。底下三行:刺激信號(hào)對(duì)應(yīng) VGG-16(第二行), GoogLeNet(第三行)和 AlexNet(***一行)的相同精度。

【本文是51CTO專欄機(jī)構(gòu)“機(jī)器之心”的原創(chuàng)譯文,微信公眾號(hào)“機(jī)器之心( id: almosthuman2014)”】