圖像技術在直播中的應用(上)——美顏技術

2016年作為視頻直播元年,無論從資本層面不斷高漲的估值,到平臺主播各種天文數字的報酬,再到像“局座”這樣的主流人士爭相上直播,直播的社會熱度可見一斑。而各大直播平臺在經歷了直播概念從無到有的階段后,如何做出差異化,如何解決在野蠻生長期產生的各種涉黃問題,成為了幾乎所有平臺“成長的煩惱”。拋開政策、內容問題不說,單就技術層面,基于圖像技術的創新成為解決這些難題最為可行的辦法。作為Tu料的***分享,我們首先就選擇了直播這個熱門話題,就圖像技術在直播中的應用做一個入門的介紹。該分享系列整理自涂圖CTO在架構師沙龍上的演講內容。

一、技術框架

愛美之心,人皆有之。早期的圖片美顏教育了市場,到了直播時代,美顏同樣成為直播平臺的標配。就目前來說,直播美顏用的主流技術是OpenGL ES。它的好處首先是直接在GPU上運行的,所以性能高、功耗小,用在直播上比較劃算。第二,它是跨平臺的,iOS和安卓都支持,美顏效果能夠直接在這兩個平臺上達到跨平臺的效果。另外OpenGL ES有一個優勢,就是有大量現成的開源庫。比如像GPUImage,谷歌的grafika,還有基于安卓的一些具有實踐意義的庫,都是很常用的。網上也有一些比較熱心的開發者把自己的美顏的算法直接開源,包括一整套解決方案,從采集到處理到美顏處理,到***輸出一個源編碼,都有相關的解決方案。

二、美顏原理——混合不能少

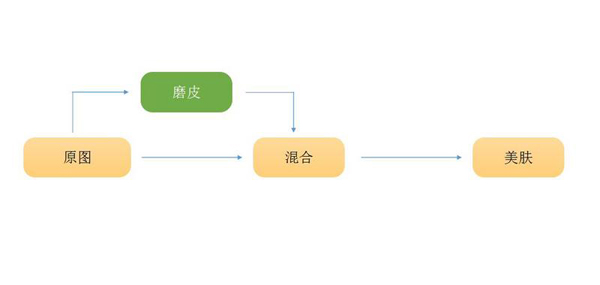

市面上大部分美顏產品的一般原理都是相似的。攝像頭采集畫面,通過一定的方式處理,***輸出一張美顏后的圖片。

具體的說,原圖首先經過磨皮處理,也就是把痘、斑這些消除掉。然后把經過磨皮的圖片與原圖進行混合。混合這個步驟是不可缺少的,因為如果只用磨皮后的圖,很容易丟失細節。而且把兩張圖混合,還可以通過調整兩個圖的混合權重,來控制磨皮的程度,達成不同級別的磨皮效果。當然***一步也很關鍵,就是美膚,比如把皮膚膚色調得白一點、紅嫩一點,或者一些特殊的需求都可以實現。基本上大部分的美顏,都是這樣的流程。

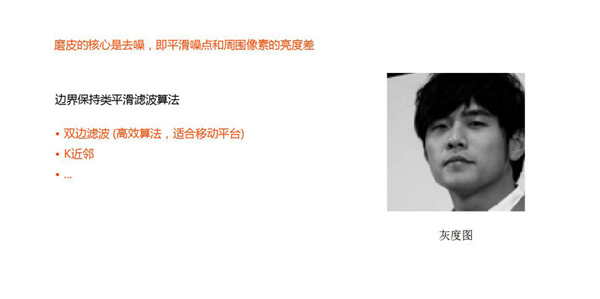

三、磨皮算法——去痘就是降噪

本質上說,一張圖就是一個二維的數據。如果相臨的兩個區域灰度值相差比較大,這就意味著存在著噪點。比如臉上有個痘,這個痘自然產生一個灰度值的變化,從抽象意義上說就是一個噪點。所以美顏磨皮的算法,核心是去噪。去噪有很多的辦法,網上有各種各樣的算法,包括現成的論文。但是不管產用什么算法,美顏的去噪算法都要保持一個特點,那就既要是邊界保持,同時還要做到平滑,也就是要濾波。

濾波算法中比較常見的是雙邊濾波,它的優點在于很高效,因此非常適合移動平臺。還有一些其他的算法比較復雜一點,也可以達到那樣的效果,但是在移動應用上效率不高。雖然GPU是并行運算的,很適合這種運算,但GPU的能力是有一定范圍的,超過這個范圍也很耗電。包括雙邊濾波在內,一種濾波算法也有各種各樣實現,考慮在移動平臺上運行,可以做一下特別的優化,比如在精度計算里,適當降低精度,達到效果與效率的平衡。

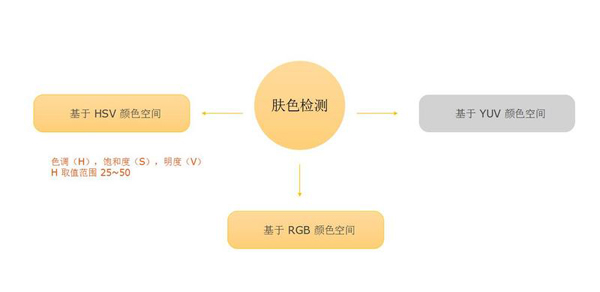

四、膚色調整——檢測才是難題

在做好磨皮后,***一個流程就是膚色調整。調整膚色本身的手法已經非常成熟,所以更難的其實在于膚色檢測。為什么要做膚色檢測?有些早期的直播美顏是沒有這個功能的,所以他們就是以美化的膚色為基礎,簡單粗暴的把整個圖像按這個色彩全部處理掉了,這就造成了整體偏色,效果還不如不做。因此,在處理圖像前,必須先進行膚色檢測,在圖像的所有像素點中找到對應膚色范圍的像素再進行處理。

直播中的膚色檢測特殊的地方在于顏色空間的轉換。因為跟圖像處理相關的顏色空間主要有三種:RGB、YUV、HSV,而這三種色彩空間在直播中都要用到。

RGB是最常見的色彩空間,我們日常用的顯示設備就是基于RGB空間,這里不多解釋。

YUV是一種比較傳統的顏色空間,最早是應用在電視信號的傳播里面的,目前多用在直播的數據采樣、傳輸的過程。這是因為人眼對亮度(Y)遠比色度(U、V)更敏感,所以YUV比起RGB更容易被壓縮,這樣就更容易節省帶寬進行傳輸。

而基于HSV顏色空間才是用來做膚色檢測的。因為如果用RGB來做膚色檢測,需要檢測R、G、B三個值是否同時滿足膚色的顏色范圍,YUV同理。而HSV三個值:色調(H)、飽和度(S),明度(V)中,只有H是關乎膚色的,因此只需要對H進行考慮(H值在25-50之間即可判斷為膚色),所需要的運算量自然比RGB少很多。

所以,在直播的不同階段,要分別使用這三種色彩空間,要不停的把這三種色彩空間進行相互轉換。

五、細節——在算法之外

美顏算法固然重要,但美更是一件很主觀的事。算法寫得非常優美和高效并不能保證美顏效果是***的,所以用標準的算法處理后,還需要設計師依據自己的經驗去進行調整。比如很多平臺算法都大同小異,但是為什么最終出來的美顏效果讓人感覺還是有差異,其實就是說里面有很多細節在,需要花時間優化,特別是用戶的需求是什么,怎樣更漂亮。

再舉一個例子。很多平臺在不同的光照條件下,比如白天、晚上,室內、室外,自然光、人工光,直播出來的美顏效果差異很大。這其中的原因可能就是算法中沒有考慮光照因素,結果使很小的因素影響了效果。

所以,這就要求進行大量的測試,用技術手段結合人工去優化,才能保證***的美顏效果。還是那句話:細節是魔鬼。

六、性能——不服跑個分?

說到性能,iOS平臺目前一般來說沒什么問題,或者問題很少。比如 GPUImage是第三方的,算是iOS平臺上很有歷史的一個庫。它實現了很多效果,比如剛才提到的一些算法,在GPUImage里面可以看到簡單版的實現,包括怎么寫腳本,怎么跑起來,怎么做雙邊濾波,里面有簡單的實現,也可以有很好的效果。包括在做直播的時候,GPUImage可以作為很好的客戶端擴展,唯一需要做的事情,就是加上一個推流;因為它包含的從客戶端的采集、處理到每一幀的數據,無論是YUV,還是RGB,都可以輸出來。所以iOS平臺上相對來說問題少很多。

而安卓平臺問題就比較大了。因為安卓本身的特點,廠商很多、設備很多、系統版本很多,因此相互間比較難兼容。

***個是設備問題。比如一個美顏算法在不同機器上跑起來,即使是同一款GPU,性能也可能會差別很大。所以,為了保證一個腳本去適應不同的機器,有種辦法是這樣的:根據GPU的性能做了一個分級算法,如果評級比較高就采用最復雜的算法,如果性能評級比較低,就把美顏效果降低,保證在大部分環境下使用。

第二是版本的問題。比如,只有4.0以上版本才能夠通過相機,直接從相機采集里面獲取到一個紋理,這個叫GLTEXTUREEXTERNAL_OES,相機直接把采集到的畫面轉給GPU,全部通過GPU加速。4.3以后可以做什么事情?從相機采集到處理到編碼,走的是全GPU,這是效果***的也是最快的,當然這對系統的兼容要求是***的。因為有些廠商在實現的時候沒有兼容這些東西,所以GPU加速很難做。

還有輸出YUV。很多直播平臺都要支持輸出YUV。這些YUV的數據就涉及到CPU和GPU的轉換過程。因為處理可能是在GPU里面完成的,GPU沒法直接輸出來,就需要從GPU到CPU的轉換,這個目前來說還沒有比較好的方案。安卓目前一些底層的GPU還沒有開放,有的時候可以通過Graphics Buffer來實現,但是安卓并沒有把這個開放出來。如果要有這個東西,唯一能做的是把安卓源代碼拿出來,包括把源代碼link到關鍵碼里面去,這樣才能達到比較好的效果。CPU到GPU的轉換,是可以毫秒級別的,如果直接從GPU轉換到CPU,可能好的設備也會花費20毫秒左右,這樣導致的數據,你預測的是24幀,可能就會有掉幀的情況。在主流上可能影響不大,大部分情況下都是可以接受的,當然這***也要看用戶只有的應用場景。

***說說常被問到的一個問題: iOS平臺、安卓平臺都自帶有人臉檢測的API,為什么不用?

首先是系統頻率低、速度慢。蘋果可能有這樣一個考慮,不要影響到相機API的正常使用,所以頻率很低。檢測一次可能3秒鐘;不是檢測一次需要3秒鐘,而是3秒鐘才給你一個數據,告訴你這張照片有沒有人臉。而作為一個實用的產品,一秒鐘假設24幀,起碼要做十幾次檢測才可以達到實時的要求,要不然的話跟不上對幀率的要求。在安卓問題更嚴重,因為還要看設備,有些設備甚至就沒有,廠商把這個設置就直接去掉了。另外一個特征點的問題。iOS上面有這些特征點,比如眼睛、嘴巴、鼻子這些,安卓上面是直接沒有這些特征點的。

七、美顏2.0——從化妝到整容

以上的內容都屬于美顏1.0的概念,而目前***的美顏技術已經發展到了2.0概念。打個簡單的比方,如果美顏1.0只是化妝的話,美顏2.0基本就能達到整容的效果——把眼睛變大,把圓臉變成瓜子臉。而實現這一效果的基礎就是人臉識別。這很好理解,只有確定了有沒有人臉,知道了五官在什么位置,我們才能把它們“整”的更漂亮。

關于人臉識別,就又是一個大問題了。限于篇幅,我們會在下一期詳細展開這個問題說。