ReSearch: 突破性強化學習框架實現大模型推理搜索能力無縫整合

引言:大模型推理與搜索的融合挑戰

隨著OpenAI-o1和DeepSeek-R1等模型的出現,大型語言模型(LLMs)在推理能力上取得了顯著突破。然而,將復雜推理與外部搜索過程有效整合仍然面臨重大挑戰,尤其是在處理需要多步檢索的復雜多跳問題時。傳統方法往往依賴手動設計的提示或啟發式規則,這在可擴展性和靈活性方面存在明顯局限。更重要的是,為多步推理場景生成監督數據通常成本高昂且在實踐中難以實現。

百川科技、同濟大學、愛丁堡大學和浙江大學的研究團隊近期提出了一種突破性解決方案——ReSearch框架。這一創新框架通過強化學習訓練大語言模型將推理與搜索無縫整合,其獨特之處在于完全不依賴推理步驟的監督數據。本文將深入探討ReSearch的核心原理、技術實現以及其在多跳問答任務中的卓越表現。

ReSearch的核心方法論

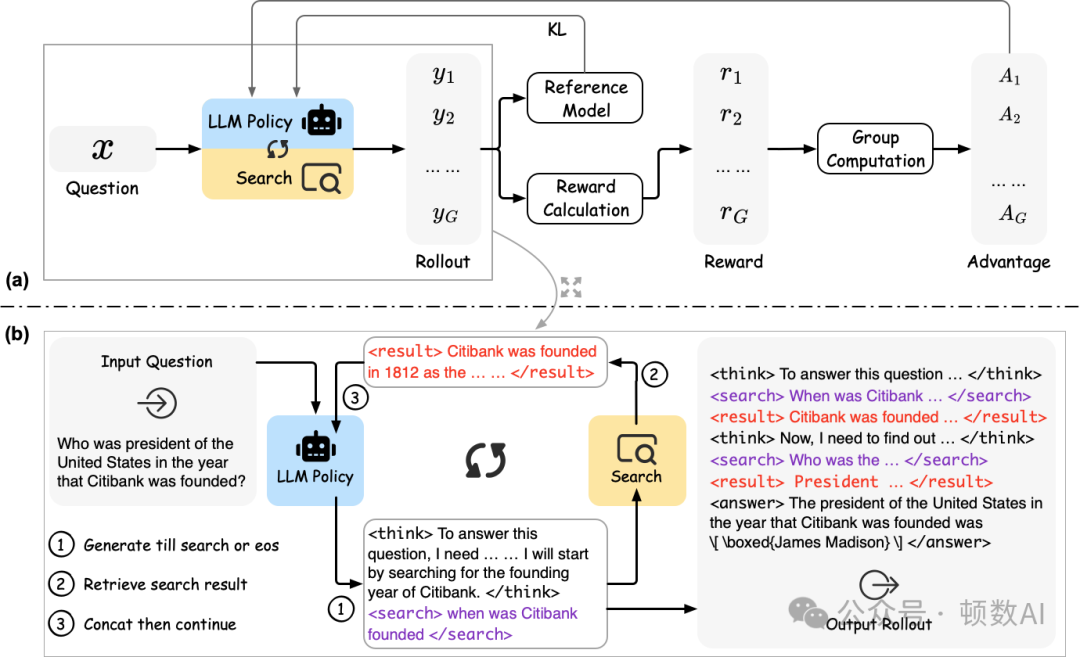

ReSearch的核心創新在于將搜索操作視為推理鏈的有機組成部分。在這一框架中,何時以及如何執行搜索由模型基于文本的思考過程自主決定,而搜索結果又會反過來影響后續的推理過程。這種雙向互動機制使模型能夠在處理復雜問題時靈活地利用外部知識。

從技術角度看,ReSearch采用了結構化的輸出格式,通過在推理鏈中嵌入特定標簽(如<think>、<search>、<result>和<answer>)來實現模型與外部檢索環境之間的清晰通信。這些標簽不僅系統地組織了生成的輸出,還為模型提供了明確的行動框架。

群體相對策略優化(GRPO)

ReSearch采用了群體相對策略優化(Group Relative Policy Optimization, GRPO)作為其強化學習的核心技術。這一技術使模型能夠自主識別執行搜索操作的最佳時機和策略,從而優化整體推理過程。值得注意的是,在訓練過程中,ReSearch有意將檢索結果排除在損失計算之外,以防止模型產生偏差。

指導強化學習過程的獎勵信號基于兩個簡單而有效的標準:

- 通過F1分數評估的準確度

- 對預定義結構化輸出格式的遵守程度

這種設計巧妙地鼓勵模型自主發展復雜的推理模式,同時避免了對手動注釋推理數據集的依賴。

技術實現細節

ReSearch的實現基于多個開源框架和工具,包括:

- verl作為強化學習的基礎框架

- FlashRAG用于評估和檢索

- FastAPI用于檢索器服務

- SGLang用于模型服務

- Qwen2.5作為基礎模型

檢索器服務架構

在模型訓練和評估過程中,搜索操作被設計為在部署和推理過程中執行。實際上,研究團隊通過FlashRAG和FastAPI托管檢索器服務,將搜索操作標準化為API調用。這種設計將搜索操作與強化學習過程解耦,使訓練和評估更加清晰靈活。

數據準備與訓練流程

ReSearch在MuSiQue的訓練集上進行訓練,并在HotpotQA、2WikiMultiHopQA、MuSiQue和Bamboogle的開發集上進行評估。訓練流程包括以下關鍵步驟:

- 數據準備將MuSiQue數據集解析為parquet格式

- 檢索器服務啟動配置并啟動基于FlashRAG的檢索服務

- 模型訓練使用定制版的verl框架進行強化學習訓練

- 評估通過SGLang服務部署模型并使用FlashRAG進行標準評測

對于不同類型的基礎模型,ReSearch提供了靈活的配置選項:

- 對于預訓練模型:使用--apply_chat False和--prompt_template_name re_search_template

- 對于指令調整模型:使用--apply_chat True和--prompt_template_name re_search_template_sys

實驗評估與性能表現

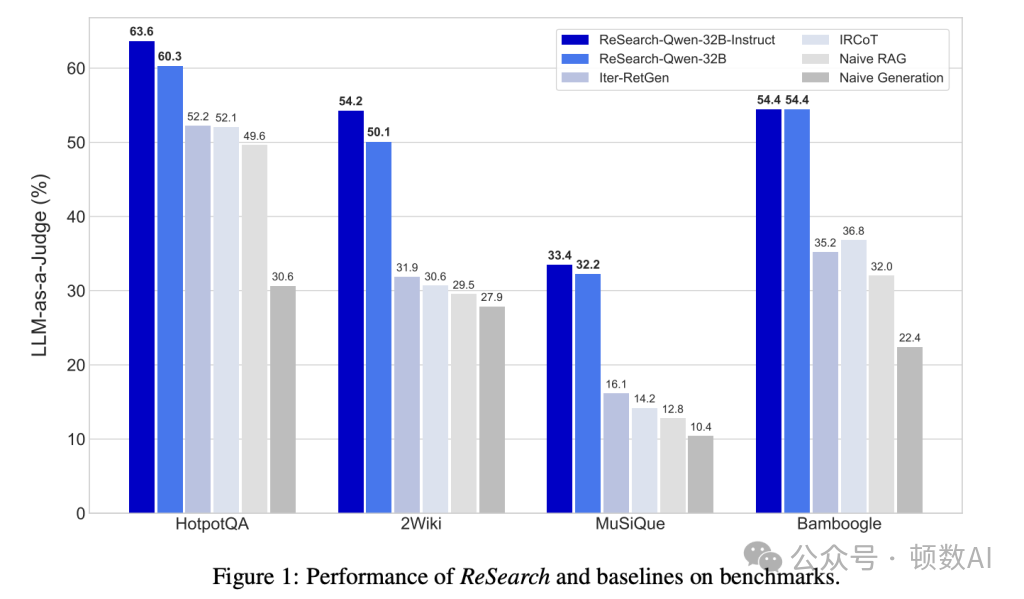

實驗評估充分證明了ReSearch的穩健性和有效性。在多跳問答基準測試中,包括HotpotQA、2WikiMultiHopQA、MuSiQue和Bamboogle,ReSearch始終優于基線方法。具體而言,ReSearch-Qwen-32B-Instruct相比既定基線實現了8.9%至22.4%的性能提升。

值得注意的是,這些顯著進步是在模型僅在單一數據集上訓練的情況下實現的,這凸顯了ReSearch框架強大的泛化能力。進一步分析表明,模型在整個訓練過程中逐漸增加了對迭代搜索操作的依賴,這表明其推理能力得到了持續提升。

案例研究:自我反思與糾正能力

詳細的案例研究展示了ReSearch模型令人印象深刻的能力:

- 識別次優搜索查詢

- 反思其推理步驟

- 自主實施糾正措施

這種自我反思和糾正能力使ReSearch在復雜、現實的應用場景中表現出色,為解決實際問題提供了強大工具。

技術實現與代碼示例

ReSearch的開源實現提供了完整的訓練和評估流程。以下是啟動檢索服務的示例代碼::

cd scripts/serving

python retriever_serving.py \

--config retriever_config.yaml \

--num_retriever {num_retriever} \

--port {port}對于模型訓練,可以使用以下命令:

cd scripts/train

bash train.sh \

--train_batch_size 8 \

--ppo_mini_batch_size 8 \

--apply_chat True \

--prompt_template_name re_search_template_sys \

--actor_model_path {model/path/to/qwen2.5-7b-instruct} \

--search_url {your-hosted-retriever-url} \

--project_name {wandb-project-name} \

--experiment_name {wandb-experiment-name} \

--nnodes 1 \

--n_gpus_per_node 4 \

--save_freq 5 \

--test_freq 5 \

--total_epochs 2 \

--wandb_api_key {your-wandb-api-key} \

--save_path {path/to/save} \

--train_files {path/to/train/parquet/data} \

--test_files {path/to/test/parquet/data}評估模型性能的示例代碼:

cd scripts/evaluation

python run_eval.py \

--config_path eval_config.yaml \

--method_name research \

--data_dir {root/path/to/evaluation/data} \

--dataset_name bamboogle \

--split test \

--save_dir {your-save-dir} \

--save_note research_qwen7b_ins

--sgl_remote_url {your-launched-sgl-url} \

--remote_retriever_url {your-hosted-retriever-url} \

--generator_model {your-local-model-path} \

--apply_chat True完整的代碼實現和詳細文檔可在GitHub上找到:https://github.com/Agent-RL/ReSearch

ReSearch的理論意義與實踐價值

ReSearch框架在理論和實踐層面都具有重要意義。從理論角度看,它提供了一種新穎的方法,通過強化學習將推理與外部搜索機制無縫整合,而無需依賴監督推理數據。這一突破性方法有效解決了多跳推理場景中固有的可擴展性和適應性問題。

從實踐角度看,ReSearch的自我反思和糾正能力大大增強了其在復雜、現實環境中的適用性。這使得它成為解決需要多步推理和外部知識檢索的實際問題的強大工具。

與現有方法的比較

與依賴手動設計提示或啟發式規則的傳統方法相比,ReSearch提供了以下顯著優勢:

- 自主學習能力模型能夠自主學習何時以及如何執行搜索操作,無需人工干預

- 靈活性能夠適應各種復雜的多跳問題,不受預定義規則的限制

- 可擴展性無需為每個新任務或領域創建專門的監督數據

- 反思與糾正具備識別錯誤并自主糾正的能力

這些優勢使ReSearch在處理復雜推理任務時表現出明顯的優越性,特別是在需要多步檢索和推理的場景中。

未來研究方向

盡管ReSearch已經取得了顯著成果,但仍有多個值得探索的未來研究方向:

- 擴展應用領域將ReSearch框架應用于更廣泛的任務,如科學研究、醫療診斷和法律分析等

- 整合多樣化知識源探索將更多類型的外部知識資源整合到推理過程中

- 優化強化學習策略進一步改進獎勵機制和訓練策略,提高模型性能

- 多模態擴展將ReSearch的原理擴展到處理圖像、視頻等多模態數據

- 效率優化提高搜索和推理過程的計算效率,使其更適合實時應用

結論

ReSearch代表了大語言模型推理能力發展的重要里程碑。通過創新性地將強化學習應用于訓練模型整合推理與搜索能力,而無需監督推理數據,ReSearch為解決復雜多跳問題提供了一種高效、靈活的方法。實驗結果表明,這一方法在多個基準測試中均優于現有方法,展示了其強大的泛化能力和實用價值。

隨著研究的深入和技術的進一步發展,ReSearch有望在更廣泛的應用領域發揮重要作用,為人工智能系統處理復雜推理任務提供新的可能性。這一框架不僅推動了大語言模型技術的進步,也為未來的研究提供了寶貴的啟示和方向。

論文:??https://arxiv.org/abs/2503.19470??

GitHub:https://github.com/Agent-RL/ReSearch

本文轉載自??頓數AI??,作者:小頓