FGM:刷新流匹配模型單步文本到圖像生成紀錄!(浙大&卡內基梅隆&北大&西湖大學)

文章鏈接:https://arxiv.org/pdf/2410.19310

亮點直擊

- 創新性的一步蒸餾框架:提出了一種名為“流生成匹配 (FGM)”的概率框架,通過一步蒸餾的方式將流匹配模型的采樣過程簡化為單步生成,大幅提高計算效率,保持了原始模型的生成質量。

- 對流匹配模型的蒸餾優化:FGM 彌補了流匹配模型在蒸餾方面的研究空白,實現了流匹配模型的一步采樣,克服了該模型在采樣過程中的計算資源限制。

- 出色的生成表現:在 CIFAR10 和大規模文本生成圖像等任務上,FGM 在單步生成中取得了優異的生成表現,與多步生成模型的性能相當,并刷新了流匹配模型的一步生成記錄。

- 提升流模型的實用性:FGM 不僅擴展了蒸餾技術的應用場景,還顯著提升了流匹配模型的實際應用潛力,特別適合需要快速高效采樣的應用場景。

總結速覽

解決的問題

在AIGC領域中,流匹配模型因其堅實的理論基礎和強大的大規模生成能力而取得了顯著成功。然而,這些模型的采樣過程對計算資源要求極高,因為它們需要多步數值常微分方程 (ODEs) 的計算。

提出的方案

本文提出了一種名為“流生成匹配 (Flow Generator Matching, FGM)”的創新方法,通過將流匹配模型的采樣加速為一步生成,降低了對計算資源的需求,同時保證了模型性能。

應用的技術

FGM 模型在 CIFAR10 無條件生成基準測試上獲得了優異的成績,創造了3.08的最新 Fréchet Inception Distance (FID) 分數,超越了原有的50步流匹配模型。此外,通過 FGM 對 Stable Diffusion 3 進行了蒸餾,生成了一步文本生成圖像的 MM-DiT-FGM 模型。

達到的效果

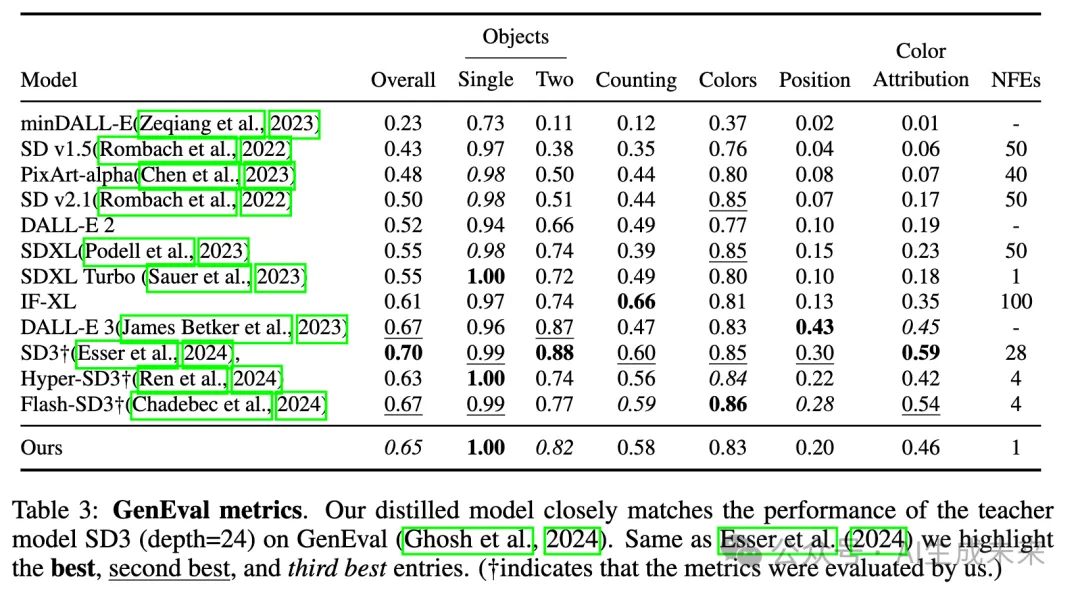

在 GenEval 基準測試上,MM-DiT-FGM 展現出卓越的生成效果,在單步生成的高效性下,生成質量可與多步模型相媲美。

流生成匹配

本節介紹流生成匹配(Flow Generator Matching, FGM),這是一種專為流匹配模型設計的一步蒸餾設計的通用方法。首先定義問題設置和符號,然后介紹我們的匹配目標函數以及 FGM 如何最小化該目標。最后,將 FGM 與現有的流蒸餾方法進行比較,突出我們方法的經驗和理論優勢。

問題設置

問題表述。本文的框架基于一個預訓練的流匹配模型,該模型能夠準確地逼近邊際向量場 。流 在噪聲分布和數據分布之間建立了聯系。同時,也知道條件轉移 ,這意味著 。假設預訓練的流匹配模型對數據分布有足夠好的逼近,即 是真實的數據分布。

本文的目標是訓練一個一步生成器模型 ,直接將隨機噪聲 轉換為樣本 。令 表示學生模型生成樣本 的分布, 表示通過 轉移的邊際概率路徑。

該學生邊際概率路徑隱式地引導了生成該路徑的流向量場 ,該向量場未知且難以處理。

不可處理的目標。一步流生成匹配的目標是使學生分布 與數據分布 匹配。為此,考慮將邊際向量場 與預訓練的向量場 進行匹配,從而使得分布 和 能夠彼此匹配。

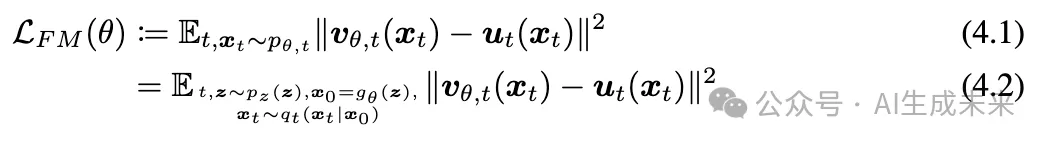

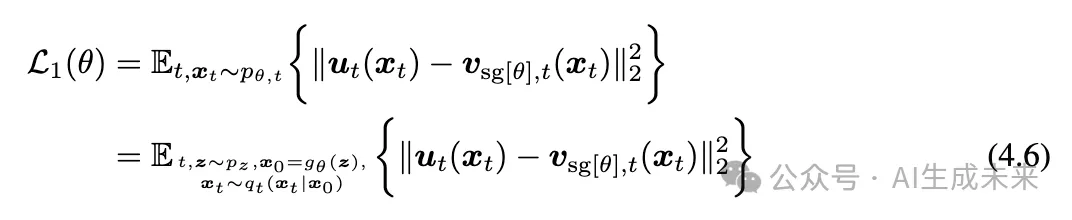

本節定義流生成匹配的目標。基于之前的討論,目標是最小化隱式向量場 和預訓練流模型向量場 之間的期望 距離,表示為

注意到樣本 依賴于參數 。在必要時,可以使用 來強調這種參數依賴關系。

顯然,當且僅當所有誘導向量場一致時,,即 幾乎處處對 成立。因此,這意味著 幾乎處處對 成立,這表明兩個分布 幾乎處處對 匹配。然而,盡管最小化目標可以得到一個強大的一步生成器,但它是不可處理的,因為我們不知道 和生成器分布 之間的關系。下面介紹本文的主要貢獻:一個具有理論保證的、與(4.1)等價且可處理的訓練目標。

可處理的目標

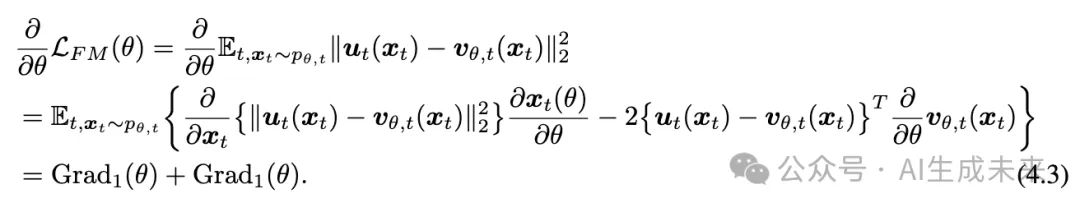

本文的目標是優化參數 以最小化目標。然而,隱式向量場 是未知且不可處理的,因此無法直接最小化該目標。不過,通過對 求損失函數的梯度,可以得到

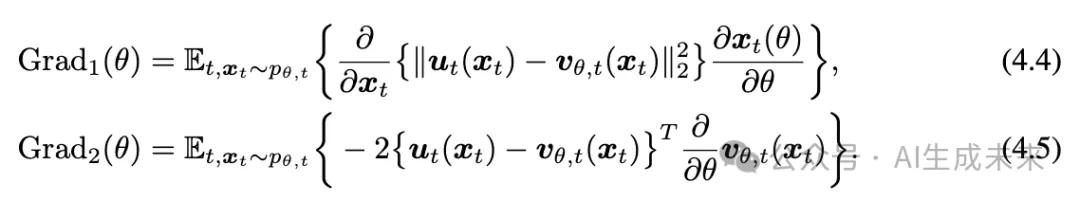

其中, 和 定義為

公式 (4.3) 中的梯度考慮了關于參數 的所有導數。

請注意,第一個梯度 可以通過停止對 的 -梯度來獲得,即 。這導致了一個替代損失函數,其梯度與 一致。

然而,第二個梯度 (4.5) 包含一個不可處理的項 。對于學生生成器,我們只能從條件概率路徑中有效地采樣,但向量場 及其關于 的梯度未知。幸運的是,在本文中,我們提出了如下定理 4.2,使得學生向量場的 -梯度更加可處理。在此之前,我們需要首先引入一個新的流乘積恒等式(Flow Product Identity),這是我們的貢獻之一,即定理 4.1。

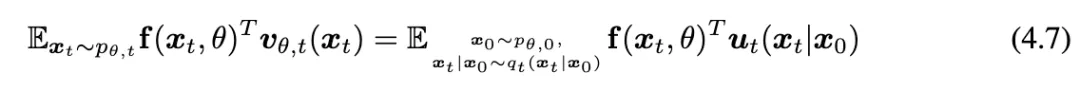

定理 4.1 (流乘積恒等式) 設 為一個向量值函數,使用 4.1 節中的符號,在溫和的條件下,該恒等式成立:

接下來,展示可以引入一個等效的可處理損失函數,該損失函數與不可處理的損失函數 (4.1) 在參數梯度上相同,如定理 4.2 所示。

定理 4.2. 如果分布 滿足某些廣義正則性條件,則對于所有不依賴于參數的向量值函數 ,對于所有參數 ,該等式成立:

公式 (4.8) 表明,無法處理的梯度 的期望可以與來自學生模型的可微樣本的可處理期望進行互換。

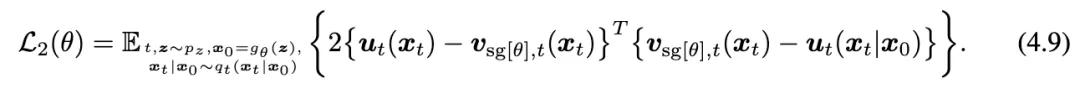

恒等式 (4.8) 的直接結果是,梯度 Grad2() 與以下可處理損失函數 (4.9) 一致,該損失函數在生成器向量中對 施加了停止梯度操作 :

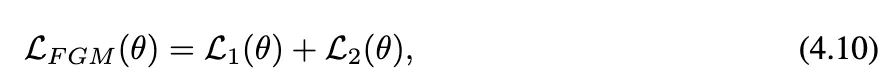

將 (4.6) 和 (4.9) 結合到 (4.3) 中,得到一個等效的損失函數,用于最小化原始目標,即:

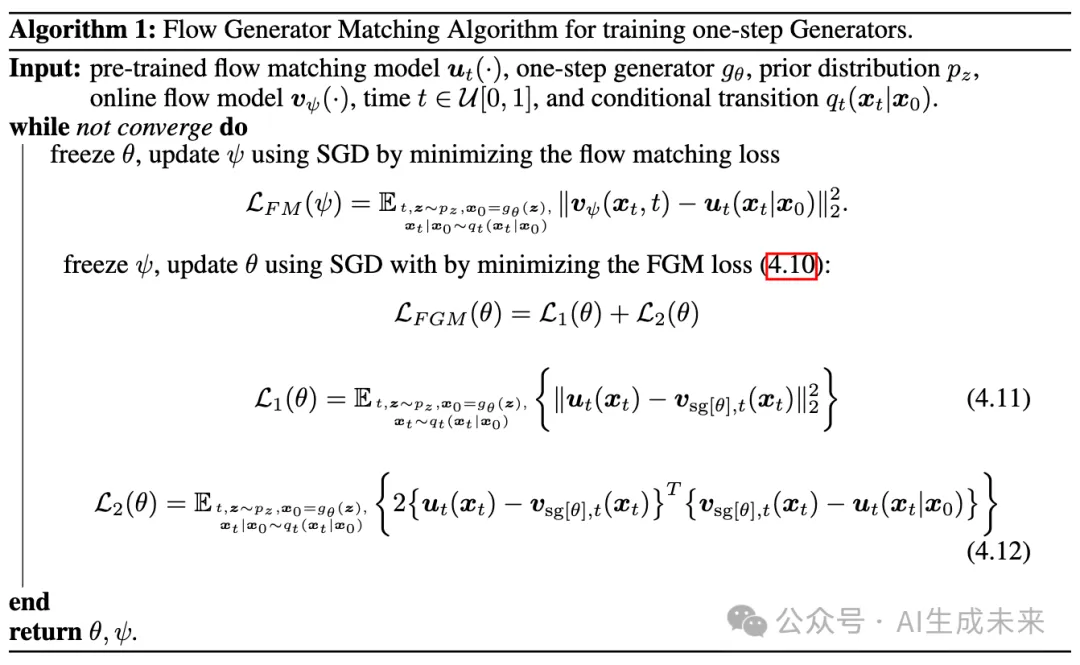

定義在 (4.6) 和 (4.9) 中的 L1(θ) 和 L2(θ)。這產生了通過最小化損失函數 (4.10) 提出的流生成匹配 (FGM) 目標。下算法 1 總結了流生成匹配的偽算法,將預訓練的流匹配模型蒸餾成一個單步生成器。

與擴散蒸餾的區別 FGM 從單步擴散蒸餾中獲得靈感,旨在最小化分布發散,然而,所得到的理論與單步擴散蒸餾的理論本質上是不同的。FGM 和單步擴散蒸餾之間最顯著的區別在于,流匹配并不意味著對概率密度進行顯式建模,如擴散模型所做。因此,分布發散的定義不能應用于流模型及其蒸餾。然而,FGM 通過直接處理流匹配目標而不是分布發散來克服這個問題。主要的見解是我們提出的顯式-隱式梯度等效理論繞過了不可處理的流匹配目標,從而產生具有理論保證的強大實用算法。定理 4.2 也可能為未來對流匹配模型的研究帶來新的貢獻。

與其他流蒸餾方法的比較 目前有少數現有工作嘗試將流模型加速到單步或少步生成模型。一致性流匹配 (CFM)是最近的一項工作,將預訓練的流模型蒸餾為一個或兩個步的模型。盡管 CFM 顯示出不錯的結果,但在理論和實際方面與我們的 FGM 不同。首先,CFM 背后的理論建立在流模型的軌跡一致性上,這直接從一致性模型中推廣。相反,我們的 FGM 是以流匹配目標為出發點,試圖用真值教師流來訓練單步生成器的隱式流,并具有理論保證。在實際方面,在 CIFAR10 生成上,展示了訓練的單步 FGM 模型在流模型中達到了 3.08 的新的 SoTA FID,超過了 CFM 最好的 2 步生成結果 5.34 的 FID。如此強大的實證表現使得 FGM 成為在標準基準上加速流匹配模型的可靠解決方案。除了簡單的 CIFAR10 生成,在第 5.2 節中,我們還使用 FGM 蒸餾領先的大規模文本到圖像流模型,獲得了幾乎沒有性能下降的非常強大的單步文本到圖像模型。

實驗

這里進行了實驗以評估 FGM 的有效性和靈活性。實驗涵蓋了標準評估基準、無條件 CIFAR10 圖像生成和使用Stable Diffusion 3 (SD3)的大規模文本到圖像生成。這些實驗展示了 FGM 在構建高效單步生成器的能力,同時保持高質量樣本。

單步 CIFAR10 生成

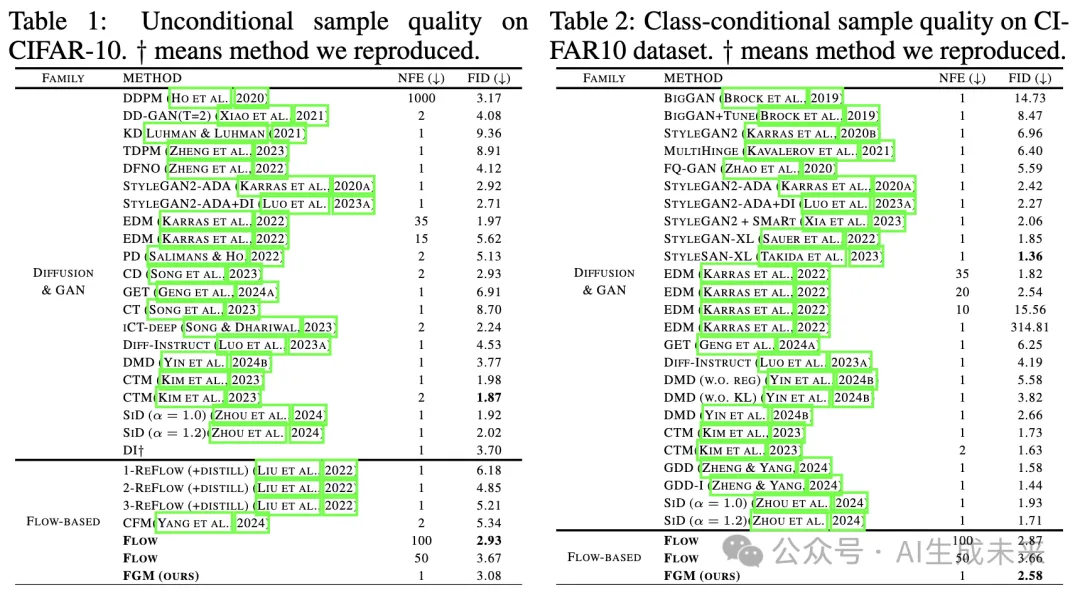

實驗設置 首先在 CIFAR10 數據集上評估 FGM 的有效性,這是生成模型性能的標準測試平臺。在 CIFAR10 上使用 ReFlow 目標 (3.6) 預訓練流匹配模型進行條件和無條件生成。參考了用于 EDM 模型的神經網絡架構。以 512 的批量大小訓練條件和無條件模型 20,000 張圖像,得到的內部訓練流模型顯示出 CIFAR10 無條件 FID 為 2.52,生成步為 300,這略微低于原始 ReFlow 模型,其 FID 為 2.58,使用 127 個生成步。然而,在下表 1 中,發現這樣的略微較差模型并不會影響強單步生成器的蒸餾。

這些流模型作為流生成匹配 (FGM) 的教師模型。然后應用 FGM 從流模型中蒸餾單步生成器。通過FID評估生成圖像的質量。較低的 FID 分數表示樣本質量和多樣性更高。

注意損失 (4.11) 和損失 (4.12) 共同構成 FGM 損失的完整參數梯度。我們發現這兩個損失在使用多層感知機進行 2D 數據集生成時效果很好。在實踐中,發現使用損失 (4.11) 在 CIFAR10 模型上會導致不穩定,這與 Poole et al. (2022) 的觀察相似,即其雅可比項的條件數可能不適定。因此,在訓練時我們不使用損失 (4.11),而是觀察到良好的性能。

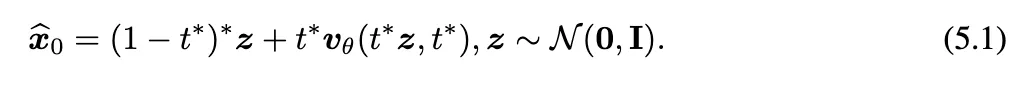

用預訓練流模型初始化生成器 受擴散蒸餾技術的啟發,用預訓練流模型初始化單步生成器。回憶流模型的訓練目標 (3.6),預訓練流模型 θ 大致預測從隨機噪聲到數據的方向。因此,我們使用預訓練流來構建我們的單步生成器。具體來說,構建單步生成器:

θ 是生成器的可學習參數,而 是預先確定的最佳時間步。

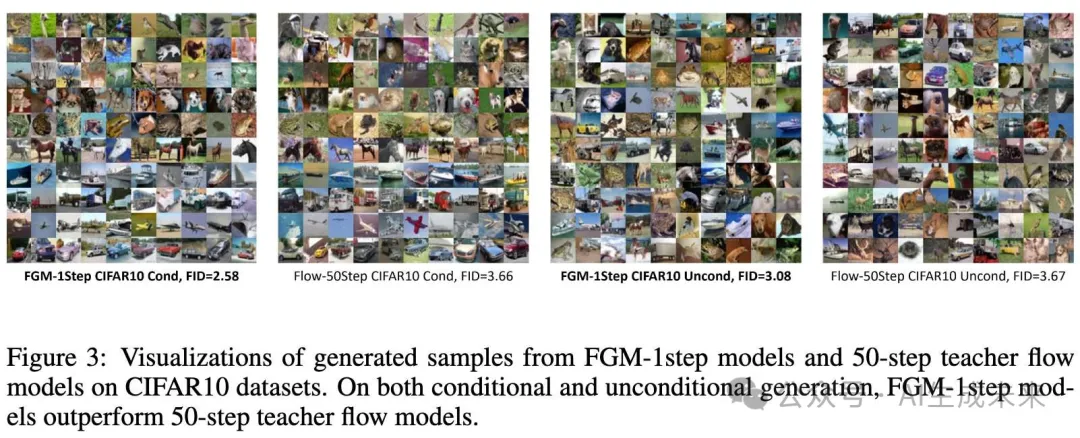

定量評估 使用 Fretchet Inception Distance(FID)評估每個模型,這是評估 CIFAR10 數據集上圖像生成結果的黃金標準。上表1和表2總結了生成模型在 CIFAR10 數據集上的 FID。在無條件生成任務中,我們的教師流模型在50個生成步和100個生成步下分別獲得了 3.67 和 2.93 的 FID。FGM 模型在僅使用一個生成步的情況下取得了 3.08 的 FID,顯著超越了教師模型在50個生成步下的結果,幅度達到了16%。在 CIFAR10 條件生成任務中,我們的一步 FGM 模型獲得了 2.58 的 FID,超越了教師流模型在100個生成步下的 2.87 FID。在 CIFAR10 生成基準上的結果展示了 FGM 的優越性能,它能夠在顯著幅度上超越多步教師流模型。

CIFAR-10 生成任務相對簡單。進行了實驗,訓練大型的一步文本到圖像生成器,采用來自頂級性能的基于Transformer的流模型進行蒸餾。

文本到圖像生成實驗:

下面展示了通過 FGM 蒸餾的一步 T2I 生成器在其他行業級模型中展現出最先進的結果。在進一步的實驗中,FGM 被應用于從頂尖的流匹配模型(如Stable Diffusion 3 Medium)中訓練單步文本到圖像生成器。用于訓練的大型數據集包含大約 200 萬條記錄,增強了模型生成高質量圖像的能力。盡管在使用某些損失函數時訓練動態存在初始不穩定性,FGM 仍然保持了與多步模型的競爭力,展示了其在處理復雜文本輸入生成圖像方面的魯棒性。

總的來說,提出的 FGM 框架為生成模型的效率和有效性帶來了有希望的進展,為流匹配和文本到圖像生成技術的未來發展鋪平了道路。

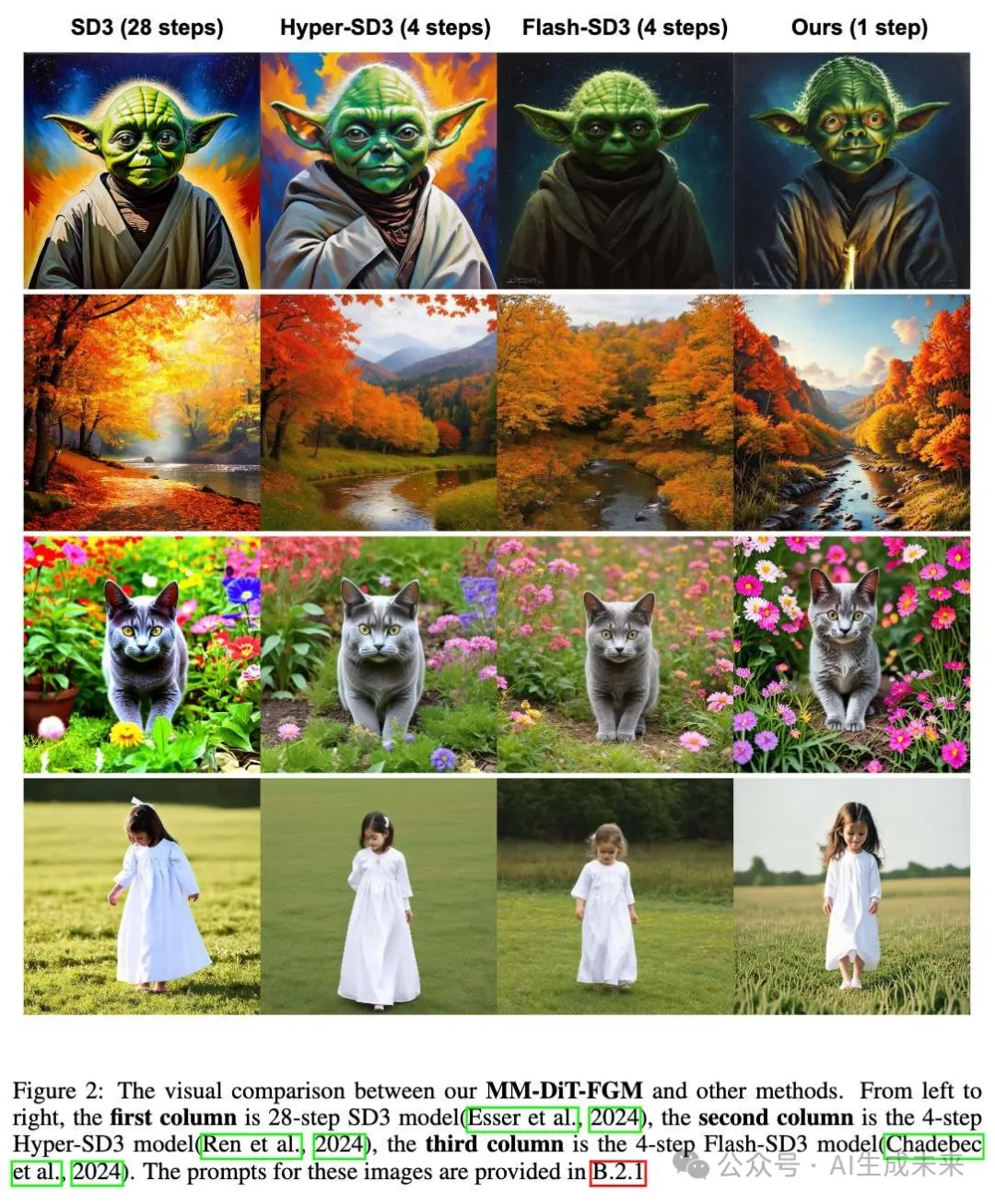

定性評估 對所提出的蒸餾方法的定性評估,以分析其性能。下圖2展示了多個樣本輸出,比較了教師模型 Hyper-SD3和 Flash-SD3的方法。結果顯示,即使在僅使用單步生成的情況下,視覺質量依然很高,尤其是在細節和顏色再現方面。特別是,一步的 MM-DiT-FGM 在每個生成圖像上展現了美學上的光影效果。與現有的蒸餾方法相比,我們的模型在生成質量上達到了可比水平,但成本顯著降低。這種優勢使得 FGM 在需要實時交互的應用中變得切實可行。

GAN 損失的整合 顯然,純 FGM 算法在訓練時并不依賴任何圖像數據。近年來,許多研究表明,在蒸餾中引入 GAN 損失對于提高生成圖像的高頻細節是有益的。因此,也將 GAN 損失與 FGM 結合用于訓練單步文本到圖像模型,并發現了其益處。

在訓練過程中,觀察到在 FGM 效率較低的某些噪聲調度間隔中,GAN 損失能夠提供有效的梯度,從而改善模型輸出的質量。因此,GAN 損失的一個重要優勢是能夠補償 FGM 在某些噪聲調度中的效率不足,從而對我們的損失函數形成補充。

結論

本文介紹了流生成匹配(FGM),一種強有力的概率性單步蒸餾方法,專為流匹配模型而設計。本文建立了 FGM 的理論基礎,并驗證了其在單步 CIFAR10 生成和大規模單步文本到圖像生成方面的強大經驗表現。

盡管 FGM 具有堅實的理論基礎和強大的經驗表現,但它仍然存在一些局限性。第一個局限性是目前 FGM 仍需額外的流模型來近似生成器引起的流向量。這一要求增加了蒸餾的內存開銷,并在預訓練的流模型和生成器的模型大小較大時可能帶來挑戰。其次,FGM 是一種完全不依賴圖像數據的方法,這意味著在蒸餾時不需要真實的圖像數據。然而,眾所周知的一個論點是,持續引入高質量圖像數據對于提高文本到圖像生成模型的性能至關重要。希望未來的工作能夠探索如何將數據整合到蒸餾過程中。

本文轉自AI生成未來 ,作者:AI生成未來