具身智能又進一步!卡內基梅隆&Meta&蘇黎世聯邦實現虛擬人超靈活抓取

論文鏈接:https://arxiv.org/pdf/2407.11385

github鏈接:https://www.zhengyiluo.com/Omnigrasp-Site/

亮點直擊

- 本文設計了一種靈巧且通用的人形機器人運動表示,這顯著提高了樣本效率,并使得通過簡單而有效的狀態和獎勵設計來學習抓取成為可能;

- 本文展示了利用這一運動表示,可以在不使用配對的全身和物體運動數據的情況下,學習合成抓取姿勢和軌跡的抓取策略;

- 本文證明了訓練人形控制器的可行性,該控制器能夠實現高成功率的抓取物體,遵循復雜軌跡,適應多樣的訓練對象,并推廣到未見過的對象。

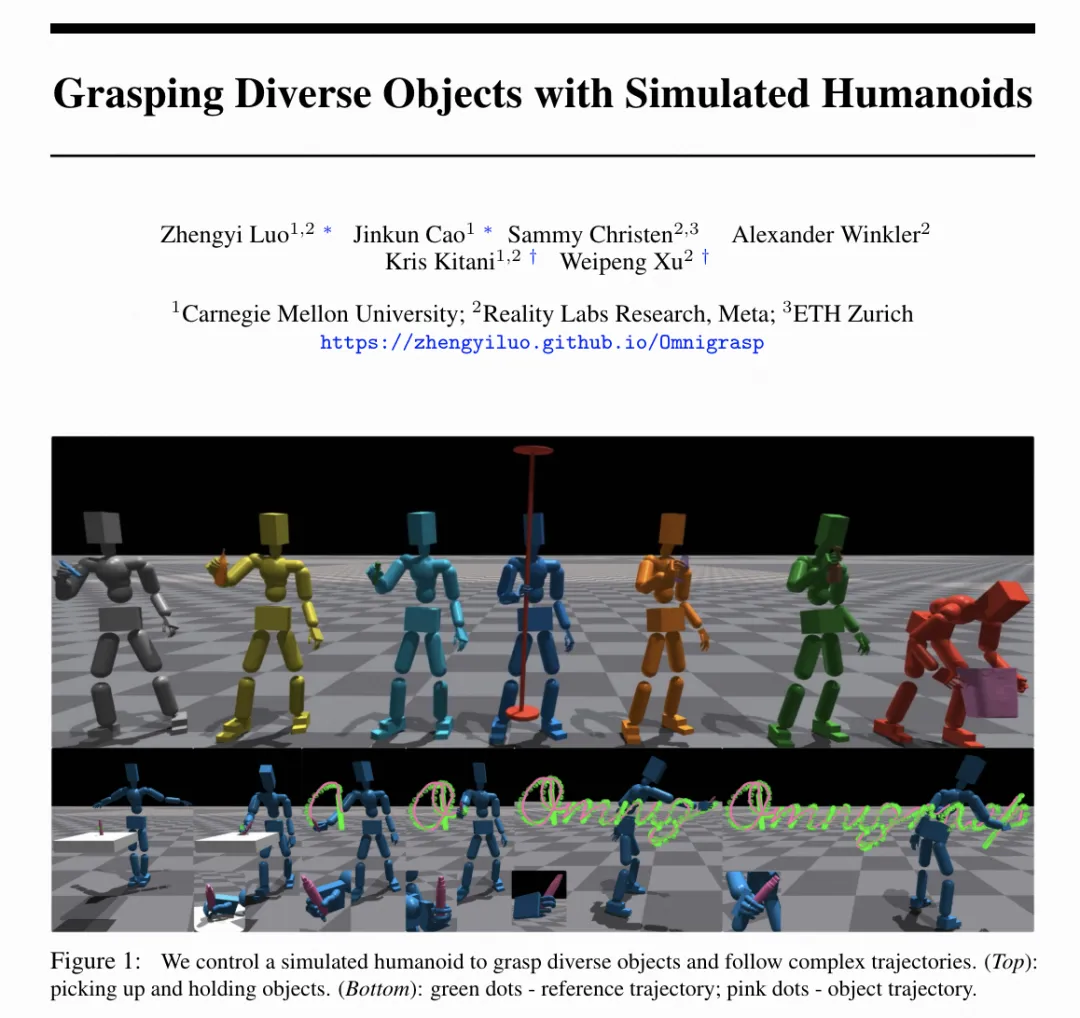

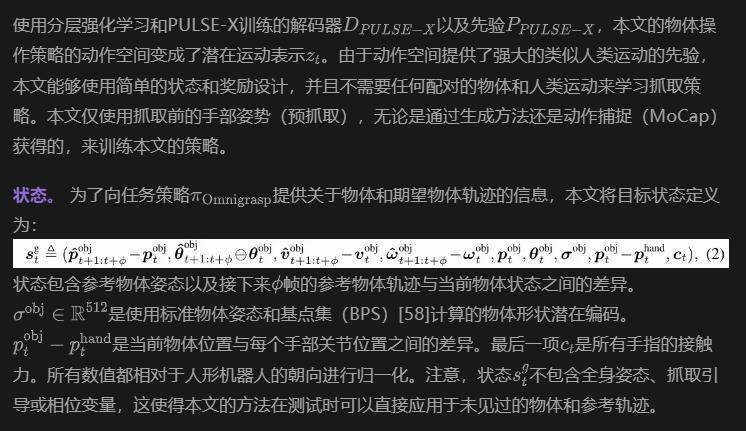

本文提出了一種控制虛擬人形抓取物體并沿著物體軌跡移動的方法。由于控制具有靈巧手的人形存在挑戰,先前的方法通常使用無身體的手,并且只考慮垂直提升或短軌跡。這種有限的范圍限制了它們在動畫和模擬所需的物體操作方面的適用性。為了彌補這一差距,本文學習了一個控制器,可以抓取大量(>1200)的物體并將它們攜帶到隨機生成的軌跡上。本文的關鍵見解是利用一種提供類似人類運動技能并顯著加快訓練速度的人形運動表示。僅使用簡單的獎勵、狀態和物體表示,本文的方法在不同物體和軌跡上顯示出良好的可擴展性。在訓練過程中,不需要配對的全身運動和物體軌跡數據集。在測試時,只需要物體網格和抓取、運輸所需的軌跡。為了展示本文方法的能力,本文展示了在跟隨物體軌跡和推廣到未見物體方面的最新成功率。

Omnigrasp:抓取多樣化的物體并跟隨物體軌跡

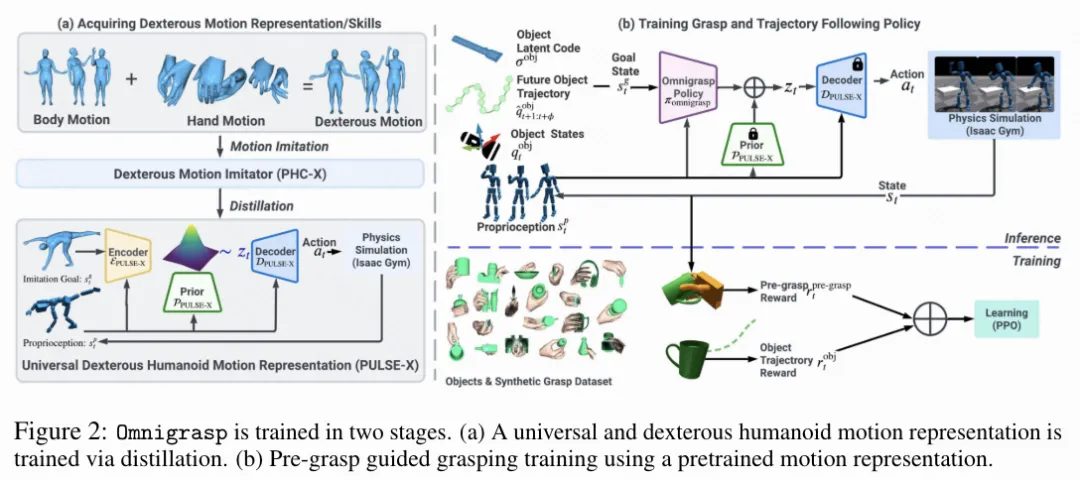

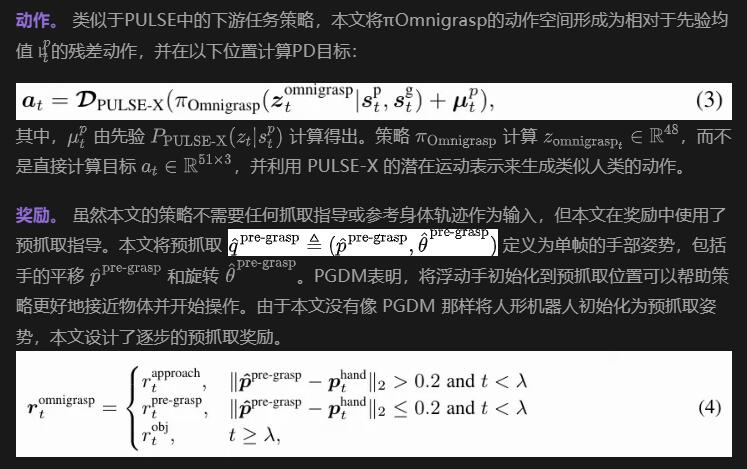

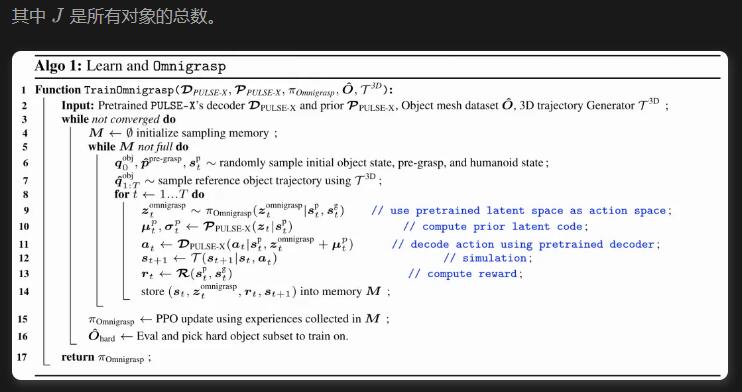

為了解決拾取物體并跟隨多樣化軌跡的挑戰性問題,作者首先獲取了一個通用的靈巧人形機器人運動表示。利用這一運動表示,本文設計了一個分層強化學習框架,通過預抓取引導的簡單狀態和獎勵設計來實現抓取物體。本文設計的架構如下圖2所示。

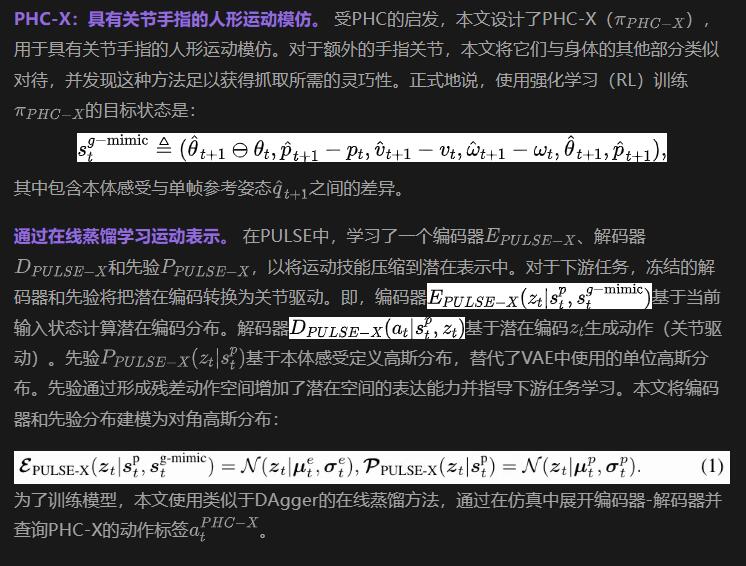

PULSE-X:基于物理的通用靈巧人形機器人運動表示

本文介紹了PULSE-X,它通過增加關節手指擴展了PULSE,使其適用于靈巧的人形機器人。 本文首先訓練了一個人形機器人運動模仿器,該模仿器可以擴展到包含手指運動的大規模人類運動數據集。然后,本文使用 variational information bottleneck(類似于VAE)將運動模仿器提煉成一個運動表示。

數據增強。 由于包含手指動作的全身運動數據集很少(例如,AMASS序列中91%的數據不包含手指動作),本文首先通過添加關節手指動作來增強現有序列,并構建一個靈巧的全身運動數據集。類似于BEDLAM中的過程,本文將來自AMASS的全身運動與從GRAB和Re:InterHand中采樣的手部動作隨機配對,以創建一個靈巧的AMASS數據集。直觀上,在這個數據集上進行訓練可以提高模仿者的靈巧性以及后續的運動表示。

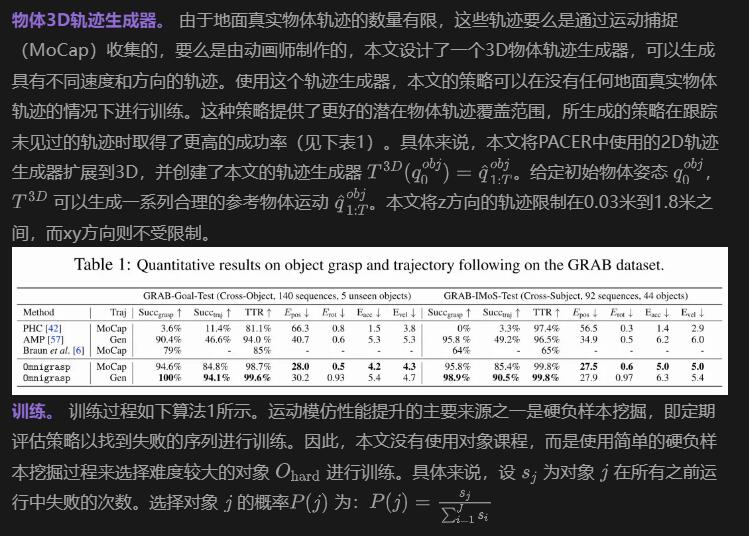

預抓取引導的物體操作

實驗

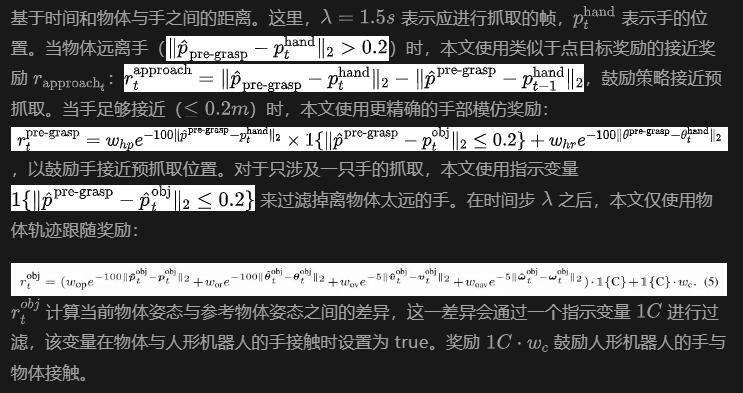

抓取和軌跡跟蹤

由于運動效果在視頻中呈現得最好.除非另有說明,所有策略均在各自數據集的訓練集上進行訓練,并且本文在GRAB和OakInk數據集上進行了跨數據集實驗。所有實驗運行10次并取平均值,因為模擬器每次運行時會由于浮點誤差等原因產生略微不同的結果。由于全身模擬人形抓取是一個相對較新的任務,基線數量有限,本文使用Braun等人[6]作為主要比較對象。本文還實現了AMP和PHC作為基線。本文在訓練AMP時采用了類似的狀態和獎勵設計(不使用PULSE-X的潛在空間),并使用了任務和鑒別器獎勵權重0.5和0.5。PHC指的是使用模仿器進行抓取,本文直接將真實的運動學身體和手指運動數據輸入預訓練的模仿器以抓取物體。

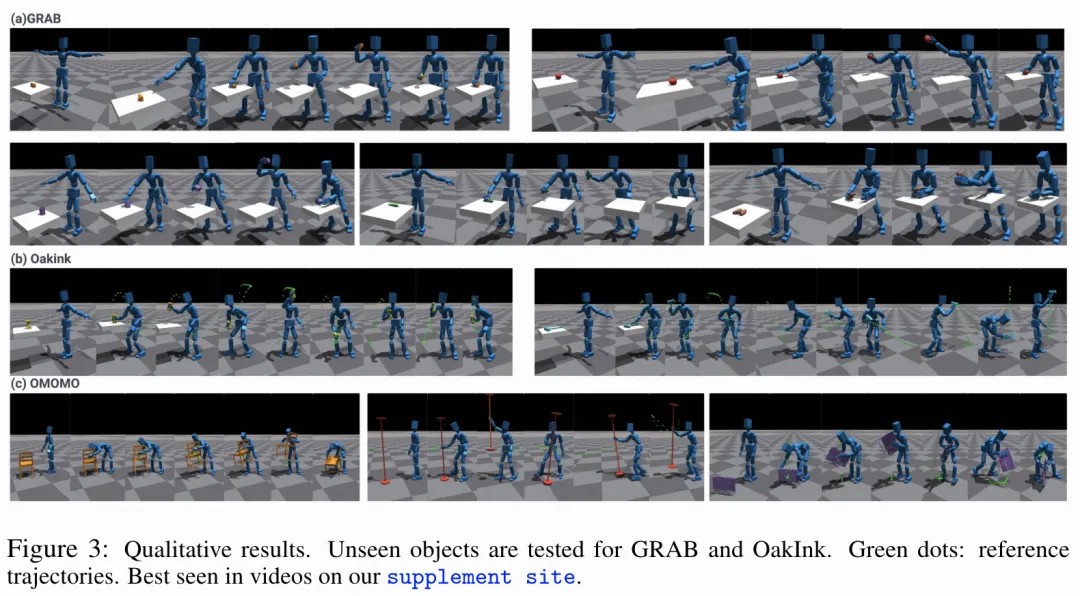

GRAB數據集(50個物體)。 由于Braun等人不使用隨機生成的軌跡,為了公平比較,本文在兩種不同的設置下訓練了Omnigrasp:一種僅使用MoCap物體軌跡進行訓練,另一種僅使用合成軌跡進行訓練。從表1中可以看出,本文的方法在所有指標上都優于之前的SOTA和基線,尤其是在成功率和軌跡跟蹤方面。由于所有方法都基于模擬,本文省略了穿透/腳滑動指標,并報告了精確的軌跡跟蹤誤差。與Braun等人相比,Omnigrasp在物體提升和軌跡跟蹤方面都實現了高成功率。直接使用運動模仿器PHC,即使提供了真實的運動學姿態,成功率也很低,顯示出模仿器的誤差(平均30毫米)對于精確抓取物體來說太大。MoCap和本文的模擬人形之間的身體形狀不匹配也導致了這種誤差。AMP導致低軌跡成功率,顯示了在動作空間中使用運動先驗的重要性。Omnigrasp可以以平均28毫米的誤差精確跟蹤MoCap軌跡。比較在MoCap軌跡和隨機生成的軌跡上進行訓練,本文可以看到在生成的軌跡上訓練在成功率和位置誤差上表現更好,雖然在旋轉誤差上表現較差。這是因為本文的3D軌跡生成器在物理上合理的3D軌跡上收斂得很好,但在隨機生成的旋轉和MoCap物體旋轉之間存在差距。通過在軌跡生成器上引入更多的旋轉變化可以改善這一點。軌跡成功率(Succtraj)和抓取成功率(Succgrasp)之間的差距顯示,跟蹤完整軌跡比僅僅抓取要困難得多,并且在軌跡跟蹤過程中物體可能會掉落。定性結果見下圖3。

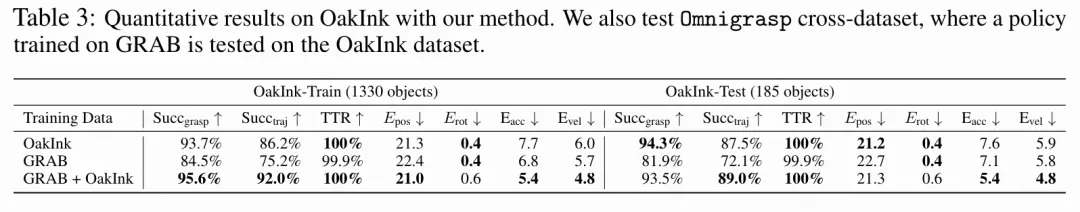

OakInk數據集(1700個物體)。 在OakInk數據集上,本文將抓取策略擴展到超過1000個物體,并測試對未見過物體的泛化能力。本文還進行了跨數據集實驗,在GRAB數據集上訓練,并在OakInk數據集上測試。結果如下表3所示。可以看到,1330個物體中有1272個被訓練成功抓取,整個提升過程也有很高的成功率。在測試集中本文觀察到類似的結果。經過檢查,失敗的物體通常要么太大,要么太小,導致人形機器人無法建立抓取。大量的物體也對難負樣本挖掘過程造成了壓力。在GRAB和OakInk上訓練的策略顯示出最高的成功率,因為在GRAB中有雙手預抓取,策略學會了使用雙手。使用雙手顯著提高了一些較大物體的成功率,人形機器人可以用一只手勺起物體并用雙手攜帶。由于OakInk只有單手預抓取,因此無法學習這種策略。令人驚訝的是,僅在GRAB上訓練在OakInk上也取得了很高的成功率,抓取了超過1000個物體而無需在該數據集上進行訓練,展示了本文抓取策略在未見過物體上的魯棒性。

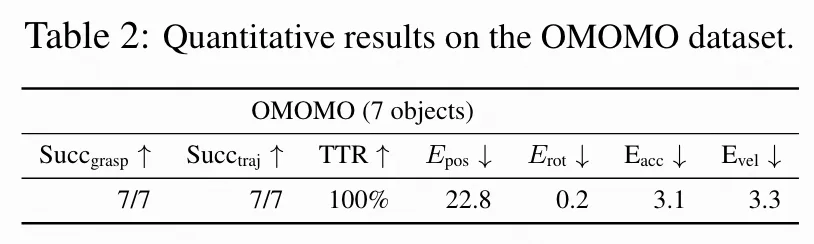

OMOMO數據集(7個物體)。 在OMOMO數據集上,本文訓練了一種策略以展示本文的方法能夠學習抓取大型物體。如下表2顯示,本文的方法能夠成功學習抓取所有物體,包括椅子和燈。對于較大的物體,預抓取指導對于引導策略學習雙手操作技能至關重要(如上圖3所示)。

消融 & 分析

消融實驗

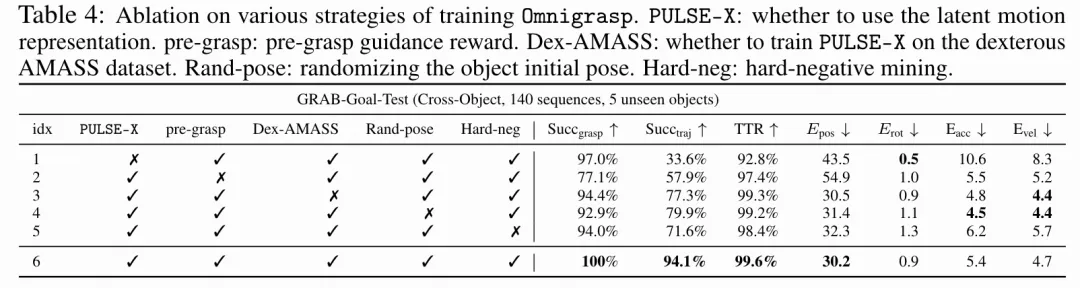

在本節中,本文使用GRAB數據集的跨對象分割來研究本文框架中不同組件的影響。結果如下表4所示。

首先,本文比較了在有(第6行)和沒有(第1行)PULSE-X動作空間的情況下訓練本文的方法。使用相同的獎勵和狀態設計,可以看出使用通用運動先驗顯著提高了成功率。經過檢查,使用PULSE-X還產生了類似人類的運動,而不使用則導致不自然的運動。

第2行與第6行的對比表明,預抓取指導對于學習穩定的抓取動作至關重要,但沒有它,某些物體仍然可以成功抓取。

第3行與第6行的對比顯示了靈巧AMASS數據集的重要性:如果沒有在包含多樣手部運動和全身運動的數據集上進行訓練,策略可以學會拾取物體(高抓取成功率),但在軌跡跟蹤方面會有困難。這是預期的,因為運動先驗可能缺乏“移動時持物”的動作。

第4行和第5行表明,物體位置隨機化和硬負挖掘對于學習穩健和成功的策略至關重要。

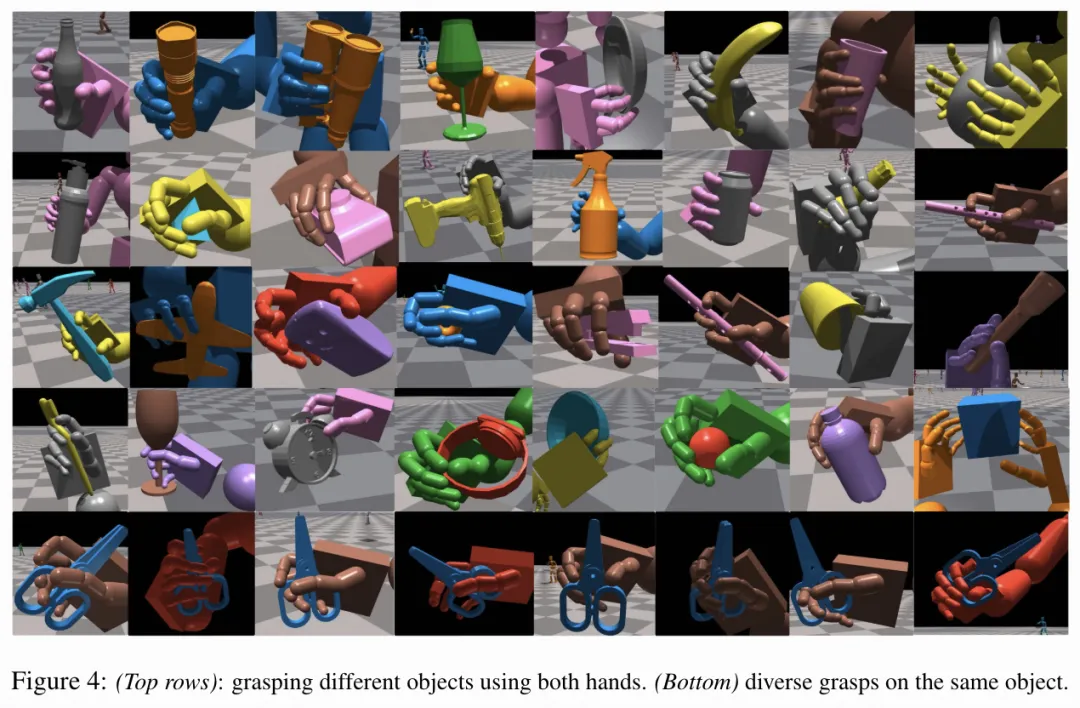

分析:多樣化的抓取策略。 在下圖4中,本文可視化了本文方法所使用的抓取策略。可以看到,根據物體的形狀,本文的策略在軌跡跟蹤過程中使用了多樣化的抓取方式。基于軌跡和物體的初始姿態,Omnigrasp為同一物體發現了不同的抓取姿態,這展示了使用模擬和物理定律進行抓取生成的優勢。本文還注意到,對于較大的物體,本文的策略會采用雙手和非抓握式的運輸策略。這種行為是從GRAB中的預抓取學習到的,GRAB使用雙手進行物體操作。

限制、總結和未來工作

限制

盡管Omnigrasp展示了控制模擬人形機器人抓取各種物體并在保持物體的同時跟隨全方向軌跡的可行性,但仍然存在許多限制。例如,盡管輸入和獎勵中提供了6自由度(6DoF)輸入,系統在旋轉誤差方面仍需進一步改進。Omnigrasp尚未支持精確的手內操作。軌跡跟隨的成功率可以提高,因為物體可能會掉落或無法被拾起。另一個改進領域是實現對物體的特定類型抓取,這可能需要額外的輸入,例如所需的接觸點和抓取方式。即使在模擬中,實現人類水平的靈巧度仍然具有挑戰性。有關失敗案例的可視化,請參見補充網站。

結論與未來工作

總之,本文展示了Omnigrasp,這是一種能夠抓取超過1200種物體并在保持物體的同時跟隨軌跡的人形機器人控制器。它可以推廣到類似尺寸的未見過的物體,利用雙手技能,并支持拾取較大的物體。本文證明,通過使用預訓練的通用人形機器人運動表示,可以通過簡單的獎勵和狀態設計來學習抓取。未來的工作包括提高軌跡跟隨的成功率,提高抓取的多樣性,并支持更多的物體類別。此外,改進人形機器人運動表示也是一個有前途的方向。雖然本文使用了一個簡單但有效的統一運動潛在空間,將手和身體的運動表示分開可能會帶來進一步的改進。有效的物體表示也是一個重要的未來方向。如何制定一種不依賴于標準物體姿勢且能夠推廣到基于視覺系統的物體表示,將有助于模型推廣到更多物體。

本文轉自AI生成未來 ,作者:Zhengyi Luo等