可在手機終端部署,人大等提出全新人物圖片保護模型RID

RID 的作者來自于中國人民大學(xué)和 Sea AI Lab。第一作者為香港大學(xué)在讀博士生郭瀚中,該工作為其碩士期間完成,其研究方向為擴散模型。本文由中國人民大學(xué)孫浩教授和李崇軒教授共同指導(dǎo),其他作者包括中國人民大學(xué)博士生聶燊和 Sea AI Lab 研究員龐天宇和杜超。

近年來許多論文研究了基于擴散模型的定制化生成,即通過給定一張或幾張某個概念的圖片,通過定制化學(xué)習(xí)讓模型記住這個概念,并能夠生成這個概念的新視角、新場景圖片。

但是當(dāng)有用戶惡意使用定制化生成技術(shù),例如利用發(fā)布在社交平臺的照片生成假照片,會對用戶的隱私權(quán)造成威脅。一些研究通過對原始圖片加擾動的方式來保護圖片不被定制化學(xué)習(xí),而由于這些研究都是通過梯度上升的方式去優(yōu)化對應(yīng)的擾動,因此瓶頸在于計算時間和計算開銷上,為了給一個圖片添加保護的擾動,需要花費幾分鐘甚至幾十分鐘,并且需要較大的顯存消耗。

本文中,中國人民大學(xué)和 Sea AI Lab 聯(lián)名提出名為 RID 的全新人物圖片保護模型,通過一個提前訓(xùn)練的小網(wǎng)絡(luò)實現(xiàn)輸入圖片輸出擾動的方式,在 RID 范式下,圖片的防定制化保護只需要幾十毫秒并且可以在用戶手機終端部署。

- 論文標(biāo)題:Real-time Identity Defenses against Malicious Personalization of Diffusion Models

- 論文地址:https://arxiv.org/pdf/2412.09844

- 項目地址:https://github.com/Guohanzhong/RID

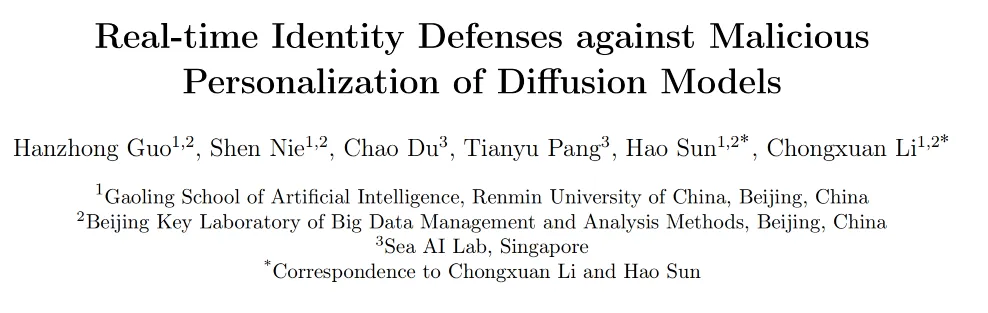

為了更助于理解,RID 提供了涉及到的不同任務(wù)和解決方案的流程框圖。定制化學(xué)習(xí)的概念是指用戶提供幾張同個概念的幾張圖片(RID 聚焦在人物的保護上),微調(diào)預(yù)訓(xùn)練擴散模型,如下圖 a 所示。在定制化學(xué)習(xí)完后,用戶可以利用定制化微調(diào)模型實現(xiàn)原始概念的新圖片生成,如下圖 b 所示。而目前為了保護圖片不被定制化,存在的方案是基于預(yù)訓(xùn)練模型梯度上升優(yōu)化一個微小擾動,但是這個過程對計算時間和計算量要求較大,如下圖 c 所示。而 RID 是利用 Adv-SDS 的方式在使用前優(yōu)化一個小網(wǎng)絡(luò),如下圖 d 所示。RID 使用的時候即輸入圖片輸出擾動,實現(xiàn)低成本、實時的圖片保護,如下圖 e 所示。當(dāng)對 RID 保護后的圖片再進行定制化學(xué)習(xí),微調(diào)得到的定制化模型則已經(jīng)無法生成真實、正常的圖片,即圖片被定制化保護成功,如圖 f 所示。

對抗得分蒸餾采樣 Adv-SDS

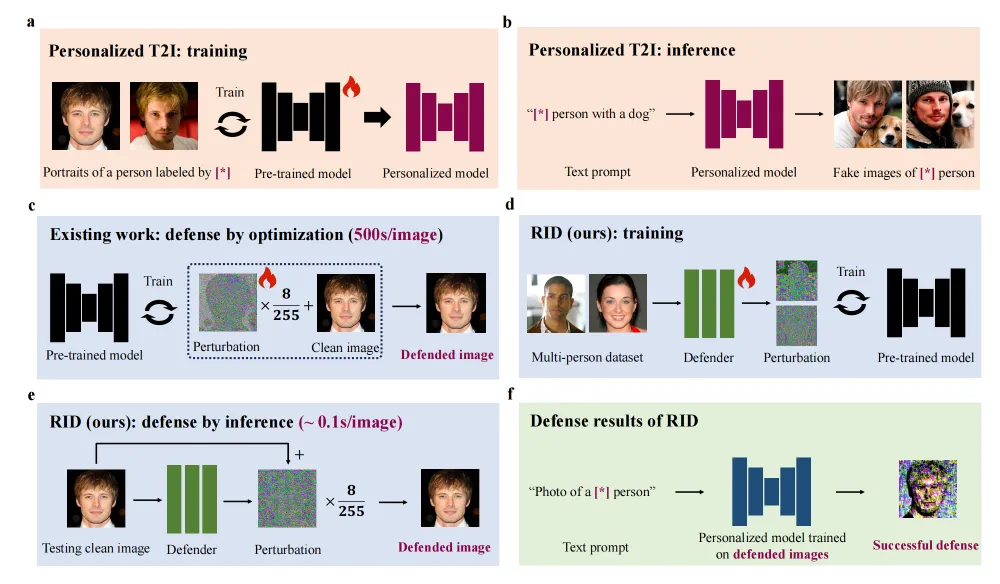

RID 的目標(biāo)是通過一個小網(wǎng)絡(luò)的單步推理,實現(xiàn)對圖片增加微小的擾動實現(xiàn)圖片不被成功定制化學(xué)習(xí)。受到 Dreamfusion 的 score distillation sampling (SDS) 啟發(fā),RID 與 Dreamfusion 本質(zhì)上都是優(yōu)化一個圖片生成器,在 Dreamfusion 里是不同角度渲染圖片,而 RID 的場景是通過添加一個擾動得到一個 “新” 的圖片。而 RID 與 Dreamfusion 的任務(wù)定義不同,Dreamfusion 目的是生成一個不同角度渲染的圖片符合擴散模型空間的,因此需要 SDS 損失最小,而我們是希望 RID 保護后的圖片不被定制化學(xué)習(xí),因此通過引入一個最大化 SDS 損失的 Adv-SDS。

但實驗中 RID 發(fā)現(xiàn),如果只通過 Adv-SDS 優(yōu)化,RID 會陷入局部最優(yōu),RID 產(chǎn)生的擾動是網(wǎng)格狀的,為了更好的保護效果以及讓擾動更不易察覺,RID 還引入了一個回歸損失。RID 會提前離線產(chǎn)生干凈圖片、擾動數(shù)據(jù)對,這個擾動是通過基于梯度優(yōu)化的方式制造的,例如 AdvDM 或 Anti-DB 等。完整的 RID 優(yōu)化見下圖所示,相比僅采用其中一種損失優(yōu)化,在兩個損失共同優(yōu)化下,RID 可以達到較好的保護效果。

模型架構(gòu):由于 RID 的目的是輸入圖片,輸入擾動,這個任務(wù)和擴散模型網(wǎng)絡(luò)的任務(wù)類似,擴散模型是輸入帶噪圖片,輸出預(yù)測噪聲,因此本文采用 DiT 作為主要網(wǎng)絡(luò)架構(gòu),由于我們不需要額外的條件引導(dǎo),因此 RID 的網(wǎng)絡(luò)架構(gòu)是將 DiT 的條件注入變成常數(shù)。此外為了限制 RID 的輸出擾動大小,RID 會在網(wǎng)絡(luò)最后增加一個 tanh 非線性映射并進行縮放達到每個 RID 網(wǎng)絡(luò)可以產(chǎn)生不同大小約束的擾動。

實驗結(jié)果

訓(xùn)練評估測試集構(gòu)建:RID 的訓(xùn)練數(shù)據(jù)集是經(jīng)過篩選后的 70k VGG-Face 2 數(shù)據(jù)集,評估集是從 Celeba-HQ 中隨機篩選的 15 個 ID,每個 ID 的 12 張圖片組成的。

評估方式:對于每個 ID,會對 12 張干凈圖片或者不同方法的保護圖片進行定制化學(xué)習(xí),定制化學(xué)習(xí)均采用 Dreambooth 損失,微調(diào)參數(shù)為 Textual Inversion (TI),TI + LoRA, 全參數(shù)微調(diào) (DB),RID 默認的評估定制化方法為 TI + LoRA,訓(xùn)練的 prompt 均為 “photo of a <news>/sks person”。用每組定制化模型再推理 12 張圖片,定量評測的時候推理均用 “photo of a <news>/sks person”,定性分析的時候會做任意文本的組合泛化生成。

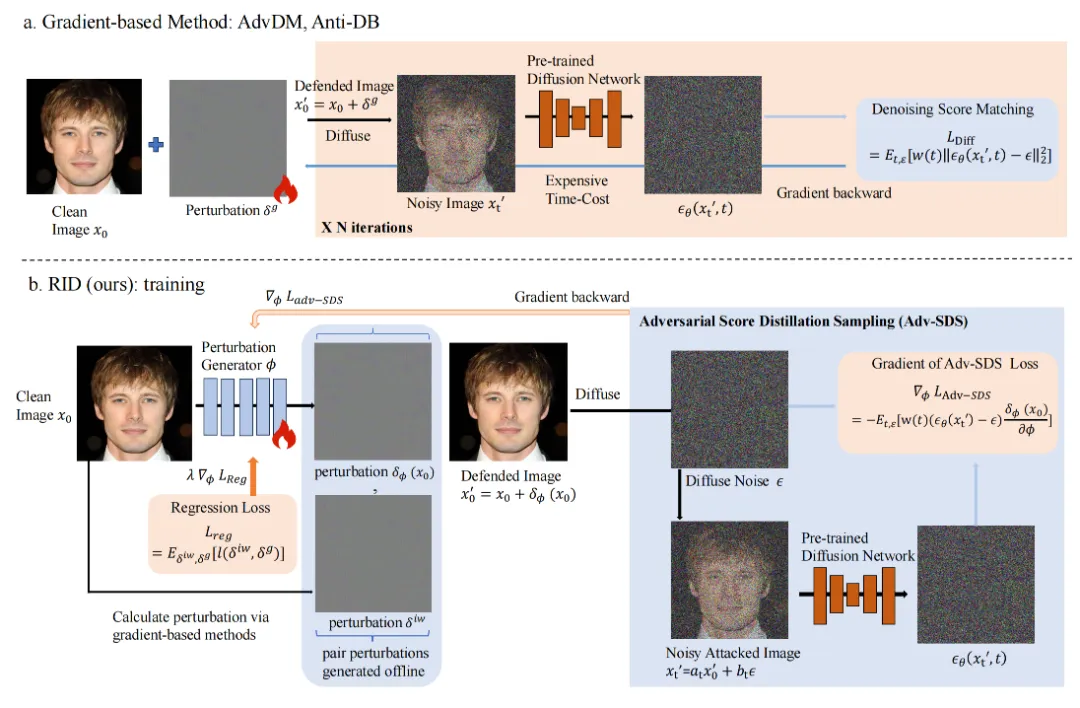

從下圖 a 中可以看出,經(jīng)過 RID 保護的圖片可以有效的實現(xiàn)圖片的反定制化,即保護后的圖片的定制化模型無法生成正常的圖片。并且圖 b 展示了不同方法之間的保護對數(shù)時間,RID 可以在一張 GPU 上實現(xiàn) 8.33 Images/Second 的保護速度,雖然圖 c 展示 RID 的定量指標(biāo)上有所下降,但從圖 d 的定性中說明不同方法間均能使用有效的保護,因此說明 RID 的有效性。

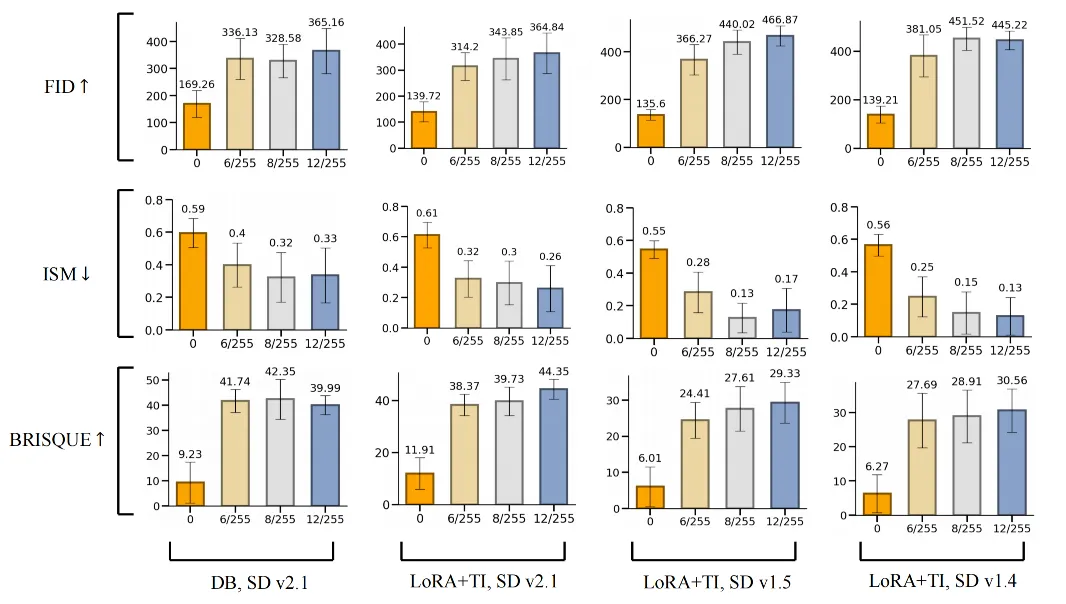

并且 RID 能夠在不同定制化方法、 不同定制化使用的預(yù)訓(xùn)練模型、不同噪聲幅度下均達到有效的保護效果。

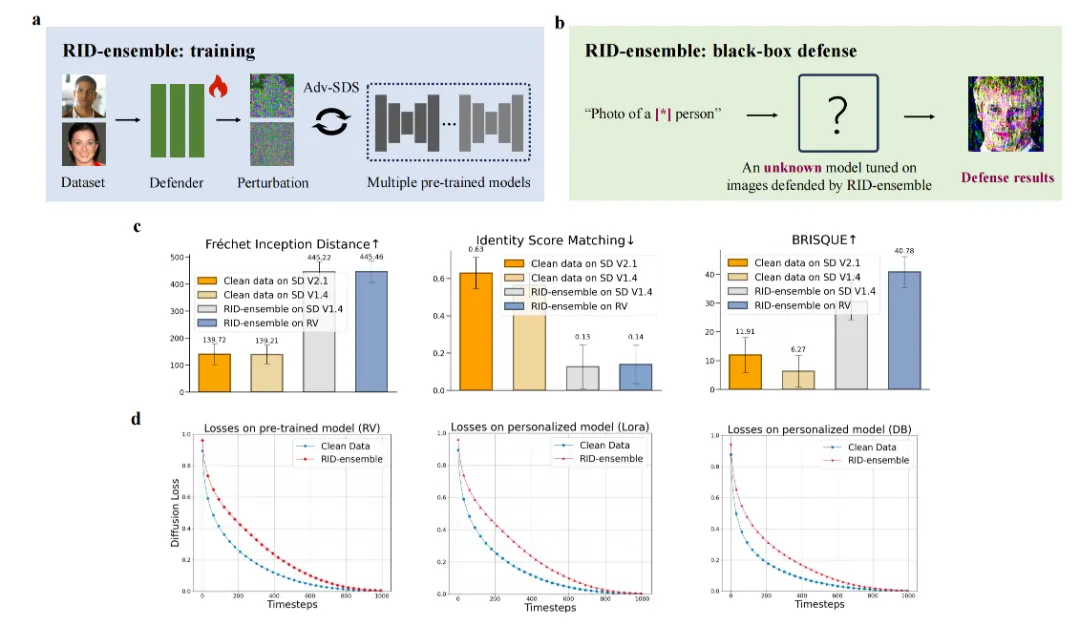

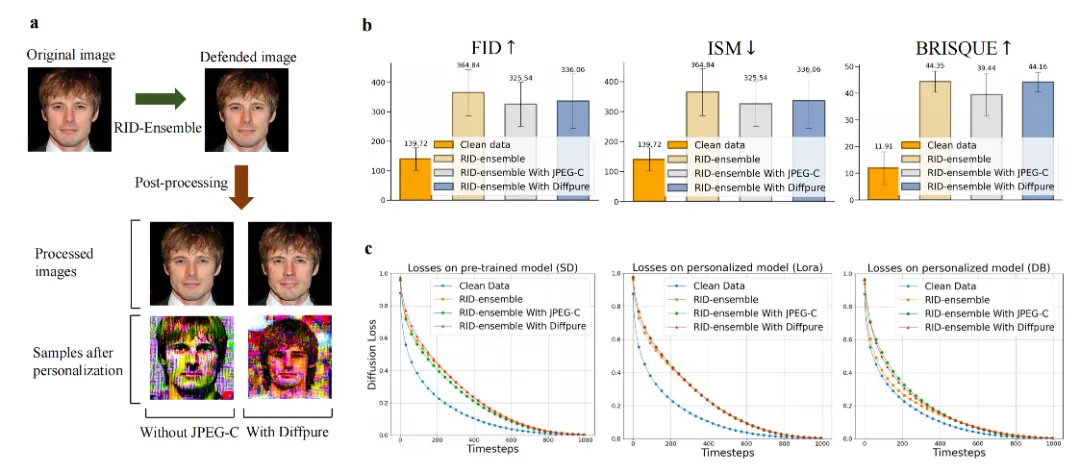

并且對于黑盒攻擊場景和圖片后處理場景下,無論從定性上還是定量上,RID 均可以展現(xiàn)出有效的保護效果。下圖展示了 RID 保護成功的原理,相比干凈圖片,RID 保護的圖片在擴散模型不同時間步上的損失均有較大程度的上升,而定制化模型本質(zhì)上只是引入了一個新的概念,對于同一組圖片,定制化前后的模型損失變化并不大,因此沒辦法覆蓋 RID 增加擾動所帶來的損失上升,因此 RID 保護的圖片對于模型而言是一個 OOD 的圖片概念,模型無法正確學(xué)習(xí)到并且生成。

思考和展望

目前基于 SD 系列集成訓(xùn)練的 RID 展現(xiàn)出來了魯棒的保護能力,但目前主流開源的還有許多 DiT 架構(gòu)的擴散模型,因此未來如何將 DiT 架構(gòu)的擴散模型融合進 Adv-SDS 一起優(yōu)化實現(xiàn)更魯棒的保護效果值得探索。此外,目前 RID 的擾動仍然是隨機優(yōu)化的擾動,未來能否設(shè)計一種具有良性作用的擾動,例如將擾動設(shè)計為妝照,也是值得更深入的研究。