突破視頻多模態大模型瓶頸!「合成數據」立大功,項目已開源

本文作者來自字節跳動,南洋理工大學 S-Lab 和北京郵電大學。其中第一作者為南洋理工大學 S-Lab 的博士生 Yuanhan Zhang (https://zhangyuanhan-ai.github.io/),主要研究領域為將基礎模型適配于開放世界。本文的指導老師為 Ziwei Liu 教授 ((https://liuziwei7.github.io/) 和 Chunyuan Li 博士 (https://chunyuan.li/), 其中 Chunyuan Li 領導了這個項目。本文其他作者包括北京郵電大學 Jinming Wu,南洋理工大學 S-Lab 的博士生 Bo Li, 字節跳動研究員 Wei Li, Zejun Ma.

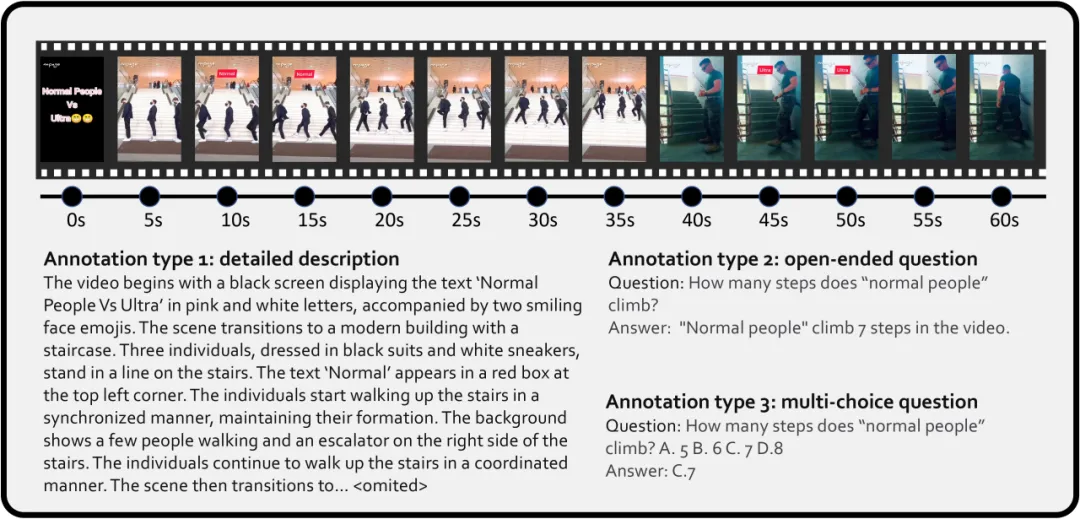

視頻多模態大模型(LMMs)的發展受限于從網絡獲取大量高質量視頻數據。為解決這一問題,我們提出了一種替代方法,創建一個專為視頻指令跟隨任務設計的高質量合成數據集,名為 LLaVA-Video-178K。

該數據集包含詳細的視頻的描述、開放式問答(QA)、和多項選擇題。通過在該數據集和現有的視覺指令微調數據上訓練模型,我們推出了新的視頻 LMM——LLaVA-Video。實驗表明,LLaVA-Video 在多個視頻基準上表現出色,展示了該數據集的有效性。

- 論文標題:VIDEO INSTRUCTION TUNING WITH SYNTHETIC DATA

- 論文鏈接:https://arxiv.org/pdf/2410.02713

- 項目主頁:https://llava-vl.github.io/blog/2024-09-30-llava-video/

先來看一組交互性演示,了解 LLaVA-Video 在真實世界中與人交互:

1.LLaVA-Video 教我下載 "TikTok":

2.LLaVA-Video 描述我的客廳,并指導我找健康飲料:

視頻指令跟隨數據合成

一個高質量的視頻指令跟隨數據集對于開發有效的視頻語言模型至關重要。我們確定了構建此類數據集的關鍵因素:確保視頻內容和語言注釋的豐富性和多樣性。我們對現有的視頻基準進行了全面調查,涵蓋了各種公共視頻描述和問答數據集,然后確定了十個獨特的視頻來源,這些來源為超過 40 個視頻語言基準提供了數據。從每個來源中,我們選擇具有顯著時間動態的視頻。為了保持注釋的多樣性,我們建立了一條能夠生成任何長度視頻的詳細描述的流水線。此外,我們定義了 16 種問題類型,指導 GPT-4o 生成問答對,以訓練視頻語言模型的感知和推理能力。

視頻來源

我們注意到,盡管不同的視頻語言數據集側重于各種視頻理解任務,但大多數都來源于十個主要視頻來源,這些來源提供了廣泛的來自不同網站、拍攝視角和題材的視頻。下圖展示了這十個我們選擇的視頻數據集與其他現有視頻語言數據集之間的關系。進一步,我們從這些來源中選擇了動態視頻,詳細的選擇邏輯在論文中描述。

我們使用的 10 個視頻來源與其他現有視頻語言數據集的關系。

自動生成視頻詳細描述

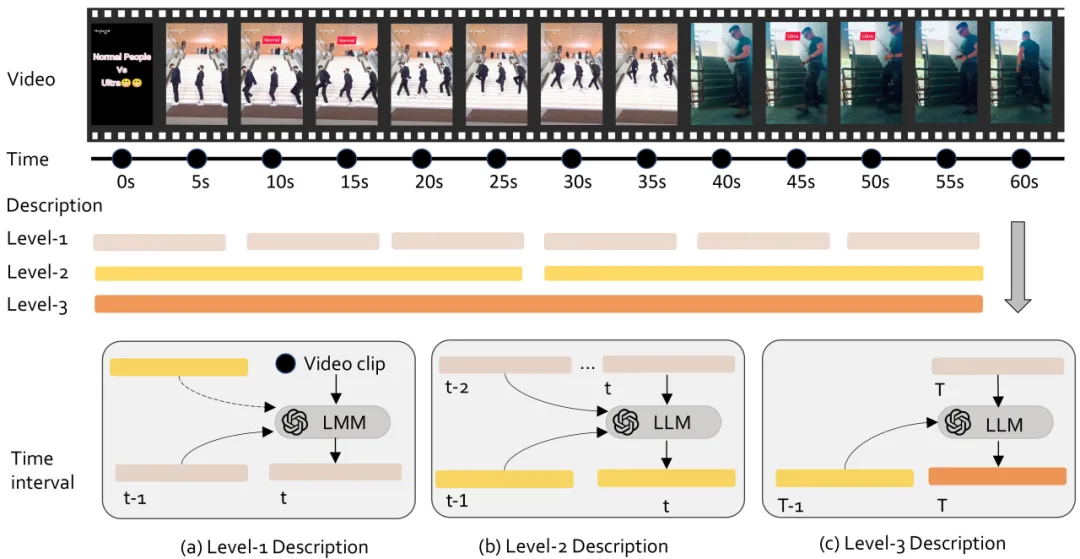

對于選定的視頻,我們使用 GPT-4o 系統地描述其內容。我們從每秒一幀的頻率開始采樣視頻。然而,由于 GPT-4o 的輸入大小限制,我們無法一次性使用視頻中所有采樣的幀。因此,我們按順序描述視頻,如下圖所示。我們在三個不同級別上創建描述,詳細如下,簡單來說,第一個層級(leve-1)指的是針對 10s 區間的視頻描述,第二個層級(level-2)指的是針對 30s 區間的視頻描述,第三個層級(level-3)指的是針對整個視頻的描述。

視頻描述的生成流程:通過遞歸方法對三個不同的視頻描述層級(leve-1,level-2,level-3)進行描述。`t` 是時間區間在其自身層級的索引,`T` 是最后一個時間區間的索引。(a) 我們根據 level-1 的 `t` 內收集的幀、level-1 的 `t-1` 的描述,以及最近的一次 level-2 描述(如果有的話),來生成 level-1 時間區間 `t` 的視頻描述。(b) 我們使用 level-2 的 `t-1` 的描述,以及最近的三個 level-1 描述,生成 level-2 的時間區間 `t` 的描述, (c) 我們基于最近一次 level-2 的描述和最近的一次 level-1 的描述,生成 level-3 的 `T` 的描述。

自動生成視頻問答

除了詳細的視頻描述,我們的數據集中還包含設計用于復雜交互的各種問答對。這種設置提高了視頻理解模型處理現實問題的能力。我們參考公共視頻問答基準,將這些問題組織為 16 種特定類別,如圖 3 所示。給定詳細的視頻描述,我們使用 GPT-4o 為每種問題類型最多生成一個問答對。有關問題類型和生成過程的更多細節,請參閱論文。

數據創建中用于生成視頻問答對的問題類型。對于每種類型,我們提供其名稱和示例問題。

數據集統計

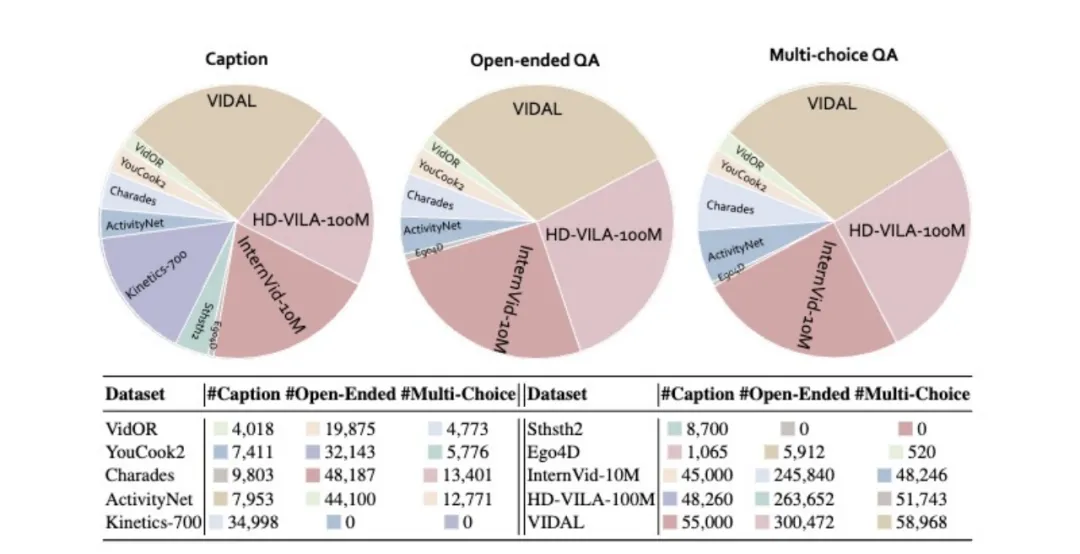

我們從收集到的數據源中精心挑選,以形成一個平衡且全面的集合,最終得到總共 178K 個視頻和 1.3M 個指令跟隨樣本。這包括 178K 個視頻描述、960K 個開放式問答和 196K 個多項選擇問答。

不同數據集和問題類型(描述、開放式 Q&A、多項選擇 Q&A)中的數據分布。

一個用于說明 LLaVA-Video-178K 中視頻指令跟隨數據的示例。

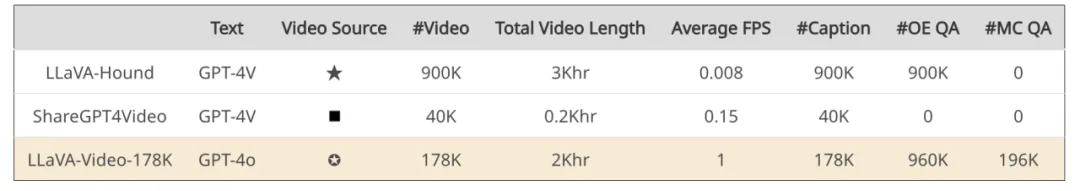

數據集比較

LLaVA-Video-178K 和其他視頻語言數據集的比較。平均 FPS 代表用于提示 GPT-4o/GPT-4V 進行注釋的每秒幀數。★:VIDAL, WebVid, ActivityNet。?:Panda-70M, Pexels, Pixabay, Mixkit, BDD100K, Ego4d。?:HD-VILA-100M, Kinetics-700M, Ego4D, VidOR, InternVid, YouCook2, ActivityNet, Sth-sthv2, VIDAL, Charades。

我們提供了和其他高質量指令跟隨視頻語言數據集的比較,LLaVA-Video-178K 展現了如下優勢

1. 廣泛的動態視頻集合:在視頻來源方面,雖然 LLaVA-Hound 包含最多的視頻,但其 44% 的視頻數據來自 [WebVid](https://ak.picdn.net/shutterstock/videos/21179416/preview/stock-footage-aerial-shot-winter-forest.mp4),其中大多數視頻是靜態的。ShareGPT4Video 的 30% 視頻來自 [Pexels](https://www.pexels.com/video/a-bird-is-standing-on-the-beach-27916646/)、[Pixabay](https://pixabay.com/videos/plane-modelling-miniature-lockheed-134519/) 和 [Mixkit](https://mixkit.co/free-stock-video/a-young-woman-clad-in-snugly-black-sportswear-doing-lunges-52112/)。這些視頻美學效果很好,但是同時存在視頻本身較為靜態的弊病。此外,其大部分視頻來自 Panda-70M,這些是從較長視頻中剪輯的短片,其情節較為簡單。相比之下,我們精心選擇了動態,情節復雜的視頻,這對于開發強大的視頻理解模型至關重要。

2. 高幀率:關于采樣的幀的頻率,LLaVA-Video-178K 考慮了 1 FPS,而其他數據集考慮的 FPS 較低。LLaVA-Hound 從任意長度的視頻中均勻采樣 10 幀。平均 FPS 為 0.008,這樣會錯過一些細節。ShareGPT4Video 使用 CLIP 基于幀的獨特性選擇關鍵幀。此方法可能也會錯過視頻中的細微變化,因為 CLIP 的特征無法很好地捕捉細粒度動態。我們的方法以 FPS=1 進行采樣,不使用關鍵幀選擇算法,確保詳細的時間信息能夠在注釋中得到高覆蓋率的表達。

3. 多樣化的任務:所提出的數據集考慮了三種常見的任務類型,包括描述、自由形式和封閉形式問答,而現有的數據集僅考慮了其中的一部分。同時,我們數據集的樣本質量和數量更高。

該數據集聚焦動態視頻, 高幀率, 和多樣化的任務, 讓視頻多模態大模型洞察每一瞬精彩。

視頻表示

基于經典的 SlowFast 視頻表示方法,我們開發了 LLaVA-Video_SlowFast,以在視頻表示中,平衡幀數和視覺 token 的數量,同時考慮 LLM 的上下文窗口限制和 GPU 內存的限制。

具體來說,我們根據擊中率 s 將幀分為兩組,每隔 s 幀均勻選出形成 * 慢 * 幀組,剩下的幀被認為是 * 快 * 幀組。需要注意的是,當 s=1 時,只有一組幀,這種情況下 SlowFast 表示就簡化為原始的簡單表示。對于每組幀,我們使用 PyTorch 函數 avg_pool2d}() 應用不同的池化率。我們對慢幀使用 pXp 池化,對快幀使用 2pX2p 池化。

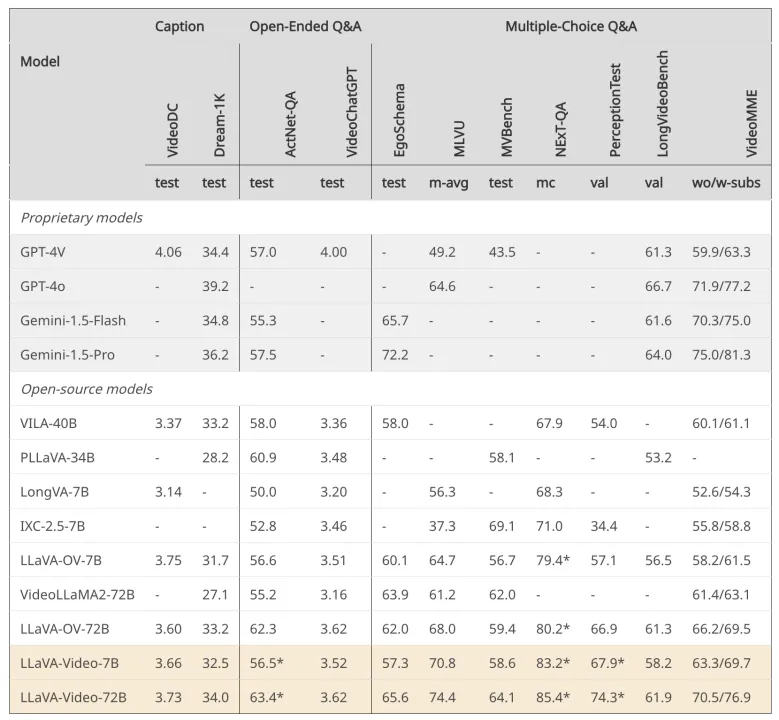

基準性能

LLaVA-Video 的表現。對于 VideoDC 和 VideoChatGPT 的,我們使用 5 分制度打分,其他評測集結果以準確率打分。所有結果均為 0-shot 準確率。* 表示該評測集的訓練集已在我們的訓練集中使用。

我們在視頻和圖像數據的聯合數據集上微調了 LLaVA-OneVision (SI)。具體而言,我們添加了來自 LLaVA-Video-178K 數據集和四個公共數據集的視頻數據:ActivityNet-QA、NExT-QA、PerceptionTest 和 LLaVA-Hound-255K,此外,我們還使用了來自 LLaVA-OneVision 模型的 110 萬個圖像語言對。如表格所示,LLaVA-Video 展現了出色的性能。

結論

本研究介紹了高質量的專為視頻語言指令任務設計的 LLaVA-Video-178K 數據集。它的特點是在較長的未修剪視頻中進行密集的幀采樣,覆蓋了包括字幕制作、開放式和多項選擇問答等多種任務。通過將 LLaVA-Video-178K 數據集與現有的視覺指令數據結合起來,我們開發了一系列新的模型,LLaVA-Video。這些模型改進了視頻表現,更有效地利用了 GPU 資源,使我們能夠在訓練過程中處理更多幀。實驗結果證明了所提出的合成數據集的有效性,LLaVA-Video 模型在各種視頻基準測試中都表現出色。