拋棄視覺編碼器,這個「原生版」多模態大模型也能媲美主流方法

一作刁海文,是大連理工大學博士生,導師是盧湖川教授。目前在北京智源人工智能研究院實習,指導老師是王鑫龍博士。他的研究興趣是視覺與語言,大模型高效遷移,多模態大模型等。共同一作崔玉峰,畢業于北京航空航天大學,是北京智源人工智能研究院視覺中心算法研究員。他的研究興趣是多模態模型、生成模型和計算機視覺,主要工作有 Emu 系列。

近期,關于多模態大模型的研究如火如荼,工業界對此的投入也越來越多。國外相繼推出了炙手可熱的模型,例如 GPT-4o (OpenAI)、Gemini(Google)、Phi-3V (Microsoft)、Claude-3V(Anthropic),以及 Grok-1.5V(xAI)等。與此同時,國內的 GLM-4V(智譜 AI)、Step-1.5V(階躍星辰)、Emu2(北京智源)、Intern-VL(上海 AI 實驗室)、Qwen-VL(阿里巴巴)等模型百花齊放。

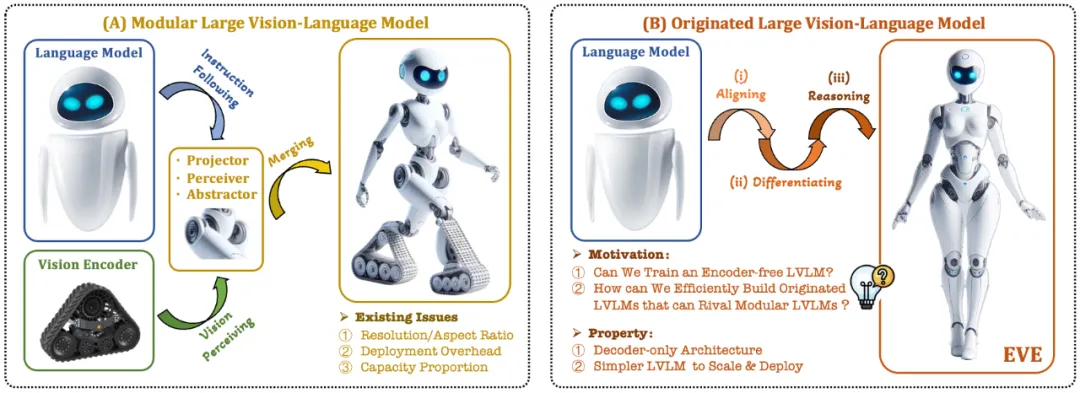

當前的視覺語言模型(VLM)通常依賴視覺編碼器(Vision Encoder, VE)來提取視覺特征,再結合用戶指令傳入大語言模型(LLM)進行處理和回答,主要挑戰在于視覺編碼器和大語言模型的訓練分離。這種分離導致視覺編碼器在與大語言模型對接時引入了視覺歸納偏置問題,例如受限的圖像分辨率和縱橫比,以及強烈的視覺語義先驗。隨著視覺編碼器容量的不斷擴大,多模態大模型在處理視覺信號時的部署效率也受到極大限制。此外,如何找到視覺編碼器和大語言模型的最佳容量配置,也變得越來越具有復雜性和挑戰性。

在此背景下,一些更加前沿的構想迅速浮現:

- 能否去除視覺編碼器,即直接構建無視覺編碼器的原生多模態大模型?

- 如何高效且絲滑地將大語言模型演變為無視覺編碼器的原生多模態大模型?

- 如何彌合無編碼器的原生多模態框架和基于編碼器的主流多模態范式的性能差距?

Adept AI 在 2023 年末發布了 Fuyu 系列模型并做出了一些相關嘗試,但在訓練策略、數據資源和設備信息方面沒有任何披露。同時,Fuyu 模型在公開的視覺文本評測指標上與主流算法存在顯著的性能差距。同期,我們進行的一些先導試驗顯示,即使大規模拉升預訓練數據規模,無編碼器的原生多模態大模型仍面臨收斂速度慢和性能表現差等棘手問題。

針對這些挑戰,智源研究院視覺團隊聯合大連理工大學、北京大學等國內高校,推出了新一代無編碼器的視覺語言模型 EVE。通過精細化的訓練策略和額外的視覺監督,EVE 將視覺 - 語言表征、對齊和推理整合到統一的純解碼器架構中。使用公開數據,EVE 在多個視覺 - 語言基準測試中表現出色,與類似容量的基于編碼器的主流多模態方法相媲美,并顯著優于同類型 Fuyu-8B。EVE 的提出旨在為純解碼器的原生多模態架構發展提供一條透明且高效的路徑。

- 論文地址: https://arxiv.org/abs/2406.11832

- 項目代碼: https://github.com/baaivision/EVE

- 模型地址: https://huggingface.co/BAAI/EVE-7B-HD-v1.0

1. 技術亮點

- 原生視覺語言模型:打破了主流的多模態模型的固定范式,去除視覺編碼器,可處理任意圖像長寬比。在多個視覺語言基準測試中顯著優于同類型的 Fuyu-8B 模型,并接近主流的基于視覺編碼器的視覺語言架構。

- 數據和訓練代價少: EVE 模型的預訓練僅篩選了來自 OpenImages、SAM 和 LAION 的公開數據,并利用了 66.5 萬條 LLaVA 指令數據和額外的 120 萬條視覺對話數據,分別構建了常規版本和高分辨版本的 EVE-7B。訓練在兩個 8-A100 (40G) 節點上約需 9 天完成,或者在四個 8-A100 節點上約需 5 天完成。

- 透明和高效的探索: EVE 嘗試探索一條高效、透明且實用的路徑通往原生視覺語言模型,為開發新一代純解碼器的視覺語言模型架構提供全新的思路和寶貴的經驗,為未來多模態模型的發展開辟新的探索方向。

2. 模型結構

首先,通過 Vicuna-7B 語言模型進行初始化,使其具備豐富的語言知識和強大的指令跟隨能力。在此基礎上,去除深度視覺編碼器,構建輕量級視覺編碼層,高效無損地編碼圖像輸入,并將其與用戶語言命令輸入到統一的解碼器中。此外,通過視覺對齊層與通用的視覺編碼器進行特征對齊,強化細粒度的視覺信息編碼和表征。

2.1 Patch Embedding Layer

- 首先使用單層卷積層來獲取圖像的 2D 特征圖,然后通過平均池化層進行下采樣;

- 使用交叉注意力模塊(CA1)在限定感受野中交互,增強每個 patch 的局部特征;

- 使用 < CLS> token 并結合交叉注意力模塊(CA2),為后續每個 patch 特征提供全局信息;

- 在每個 patch 特征行的末尾插入了一個可學習的 < SPL> token,幫助網絡理解圖像的二維空間結構。

2.2 Patch Aligning Layer

- 記錄有效 patch 的二維形狀;丟棄 < CLS>/<PAD> tokens,并利用自適應池化層還原到原始的二維形狀;

- 通過層級交叉注意力模塊(CA3),整合多層網絡視覺特征,從而實現與視覺編碼器輸出的細粒度對齊。

3. 訓練策略

- 大語言模型引導的預訓練階段:建立視覺和語言之間的初步聯系,為后續穩定高效的大規模預訓練打下基礎;

- 生成式預訓練階段:進一步提高模型對視覺 - 語言內容的理解能力,實現純語言模型到多模態模型的絲滑轉變;

- 監督式的微調階段:進一步規范模型遵循語言指令和學習對話模式的能力,滿足各種視覺語言基準測試的要求。

- 在預訓練階段,篩選了來自 SA-1B、OpenImages 和 LAION 等 3300 萬公開數據,僅保留分辨率高于 448×448 的圖像樣本。特別地,針對 LAION 圖像冗余度高的問題,通過在 EVA-CLIP 提取的圖像特征上應用 K-means 聚類,生成 50,000 個聚類,并從中挑選出最接近每個聚類中心的 300 張圖像,最終選出 1500 萬張 LAION 圖像樣本。隨后,利用 Emu2 (17B)和 LLaVA-1.5 (13B)重新生成高質量圖像描述。

- 在監督微調階段,使用 LLaVA-mix-665K 微調數據集來訓練得到標準版的 EVE-7B,并整合 AI2D、Synthdog、DVQA、ChartQA、DocVQA、Vision-Flan 和 Bunny-695K 等混合數據集來訓練得到高分辨率版本的 EVE-7B。

4. 定量分析

EVE 模型在多個視覺語言基準測試中明顯優于同類型的 Fuyu-8B 模型,并且與多種主流的基于編碼器的視覺語言模型表現相當。然而,由于使用大量視覺語言數據訓練,其在準確響應特定指令方面存在挑戰,在部分基準測試中表現有待提高。令人興奮的是,通過高效的訓練策略,可以實現無編碼器的 EVE 與帶編碼器基礎的視覺語言模型取得相當的性能,從根本上解決主流模型在輸入尺寸靈活性、部署效率和模態容量匹配方面的問題。

相較于帶編碼器的模型易受到語言結構簡化和豐富知識丟失等問題困擾,EVE 表現出隨著數據規模的增加而逐步穩定地提升性能,逐漸逼近基于編碼器模型的性能水平。這可能是因為在統一網絡中編碼和對齊視覺和語言模態更具挑戰性,使得無編碼器模型相對于帶編碼器的模型更不容易過擬合。

5. 同行怎么看?

英偉達高級研究員 Ali Hatamizadeh 表示,EVE 令人耳目一新,嘗試提出全新的敘事,區別于構建繁雜的評測標準和漸進式的視覺語言模型改進。

谷歌 Deepmind 首席研究員 Armand Joulin 表示,構建純解碼器的視覺語言模型令人興奮。

蘋果機器學習工程師 Prince Canuma 表示,EVE 架構非常有趣,對 MLX VLM 項目集是一個很好的補充。

6.未來展望

作為無編碼器的原生視覺語言模型,目前 EVE 取得了令人鼓舞的結果。沿著這條路徑,未來還有一些有趣的方向值得探索嘗試:

- 進一步的性能提升:實驗發現,僅使用視覺 - 語言數據進行預訓練顯著地降低了模型的語言能力(SQA 得分從 65.3% 降至 63.0%),但逐步提升了模型的多模態性能。這表明在大語言模型更新時,內部存在語言知識的災難性遺忘。建議適當融合純語言的預訓練數據,或采用專家混合(MoE)策略來減少視覺與語言模態間干擾。

- 無編碼器架構的暢想:通過恰當策略和高質量數據的訓練,無編碼器視覺語言模型可以與帶編碼器的模型相匹敵。那么在相同的模型容量和海量的訓練數據下,二者性能如何?我們推定通過擴大模型容量和訓練數據量,無編碼器架構是能夠達到甚至超越基于編碼器架構,因為前者幾乎無損地輸入圖像,避開了視覺編碼器的先驗偏置。

- 原生多模態的構建: EVE 完整地展現了如何高效穩定地構建原生多模態模型,這為之后整合更多模態(如音頻、視頻、熱成像、深度等)開辟了透明和切實可行的道路。核心思想是在引入大規模統一訓練之前,先通過凍結的大語言模型對這些模態進行預對齊,并利用相應的單模態編碼器和語言概念對齊進行監督。