美媒:OpenAI刪除了禁止其技術(shù)被用于軍事用途的條款

據(jù)美國調(diào)查新聞網(wǎng)站“攔截者”(The Intercept)1月12日報道,美國知名人工智能企業(yè)、ChatGPT母公司OpenAI近日悄悄修改了其產(chǎn)品的使用條款,刪除了禁止將OpenAI技術(shù)用于軍事用途的條文。

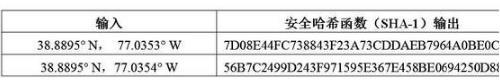

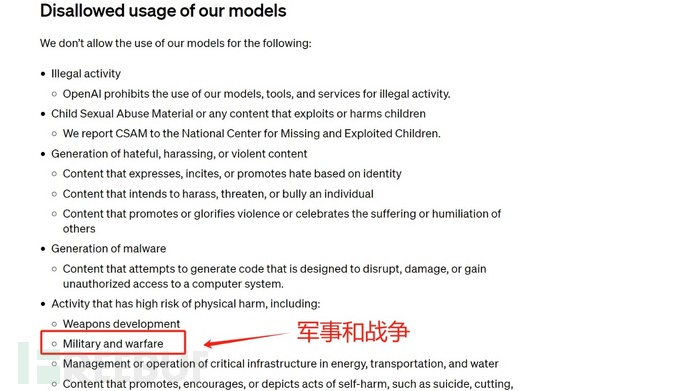

報道稱,在今年1月10日之前,OpenAI公司網(wǎng)站發(fā)布的使用條款曾明確規(guī)定,禁止將該公司的AI模型應用于“很可能造成人員傷亡的用途”,比如“武器研發(fā)”和“軍事與戰(zhàn)爭”。“軍事”一詞,極為明確地將美國國防部、美軍、CIA等排除出了OpenAI的用戶范疇。

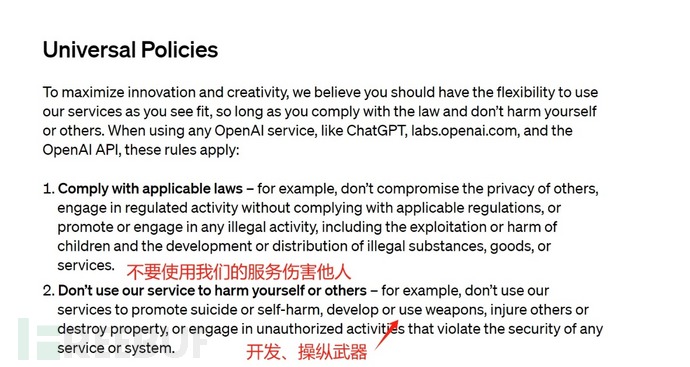

在上周的修改后,OpenAI在“通用政策”條款中雖然也有“不要使用公司服務傷害自己或他人”,并明確表示禁止“AI開發(fā)或操縱武器”,但軍事這一關(guān)鍵限制性詞匯,卻從政策中消失了。

對此,OpenAI公司發(fā)言人尼克·菲利克斯(Niko Felix)在一份回復“攔截者”網(wǎng)站的郵件中表示,調(diào)整使用條款是為了設立一套易于記憶和應用的通用原則,“像‘不傷害他人’這樣的規(guī)則很寬泛且容易理解,可以適用于很多語境之下。我們還特別列舉了武器作為例子。”

但菲利克斯拒絕說明“禁止傷害他人”的表述是否包括所有軍事用途。他僅在郵件中表示:“包括軍方在內(nèi),任何將我們的技術(shù)用于研發(fā)或使用武器、傷害他人或破壞財產(chǎn)、在未經(jīng)授權(quán)的情況下用于破壞任何服務或系統(tǒng)安全的行為,都是不被允許的。”

美國網(wǎng)絡安全公司Trails of Bits的機器學習和自主系統(tǒng)安全專家海蒂·赫拉夫(Heidy Khlaaf)認為,OpenAI的新政策可能是想在確保法律合規(guī)之上提供更多的靈活性,“發(fā)展武器以及從事與軍事有關(guān)的活動在不同程度上是合法的,這項調(diào)整對AI安全的潛在影響非常大。”

但赫拉夫警告說,鑒于大語言模型中普遍存在“幻覺”和“偏見”的問題,總體上缺乏足夠的準確性,將其應用于軍事與戰(zhàn)爭很可能會加劇平民傷亡。

一些專家還表示,OpenAI似乎在悄悄弱化其反對軍事應用的立場。他們對“攔截者”網(wǎng)站指出,OpenAI的主要投資者、美國科技巨頭微軟公司就是美國軍方的主要供應商之一。

美國AI研究機構(gòu)“AI Now”總經(jīng)理、前聯(lián)邦貿(mào)易委員會AI政策分析師莎拉·邁爾斯·韋斯特(Sarah Myers West)直言,新使用條款的措辭含糊不清,這引發(fā)了外界對于OpenAI會如何執(zhí)行新條款的疑問。

美國軍方領(lǐng)導層此前已對AI技術(shù)表現(xiàn)出興趣,美國國防部副部長凱瑟琳·希克斯去年11月曾表示,AI技術(shù)是“以作戰(zhàn)人員為中心的全面創(chuàng)新方法的關(guān)鍵組成部分”。但希克斯也承認,當前的AI技術(shù)還不夠成熟,“不符合我們要求的AI道德原則”。

“攔截者”網(wǎng)站稱,盡管OpenAI提供的產(chǎn)品還無法被用于操控武器,但美國軍方已經(jīng)開始將其技術(shù)應用于協(xié)助編寫代碼、處理武器采購訂單和情報分析等工作,“盡管OpenAI工具沒有被直接用于殺人,它們已經(jīng)被用于協(xié)助這樣的工作。”

參考鏈接:https://news.china.com/socialgd/10000169/20240115/46082732_1.html