AI智能超越人類終解開!李飛飛高徒新作破圈,5萬個(gè)合成數(shù)據(jù)碾壓人類示例,備咖啡動(dòng)作超絲滑

AI巨佬Geoffrey Hinton稱,「科技公司們正在未來18個(gè)月內(nèi),要使用比現(xiàn)在GPT-4多100倍的算力訓(xùn)練新模型」。

更大參數(shù)的模型,對(duì)算力需求巨大的同時(shí),對(duì)數(shù)據(jù)也提出了更高的要求。

但是,更多的高質(zhì)量數(shù)據(jù)該從何來?

英偉達(dá)高級(jí)科學(xué)家Jim Fan表示,「合成數(shù)據(jù),將為我們饑渴的模型提供萬億個(gè)token」。

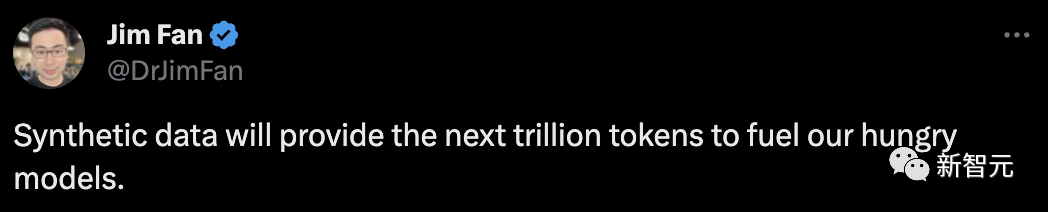

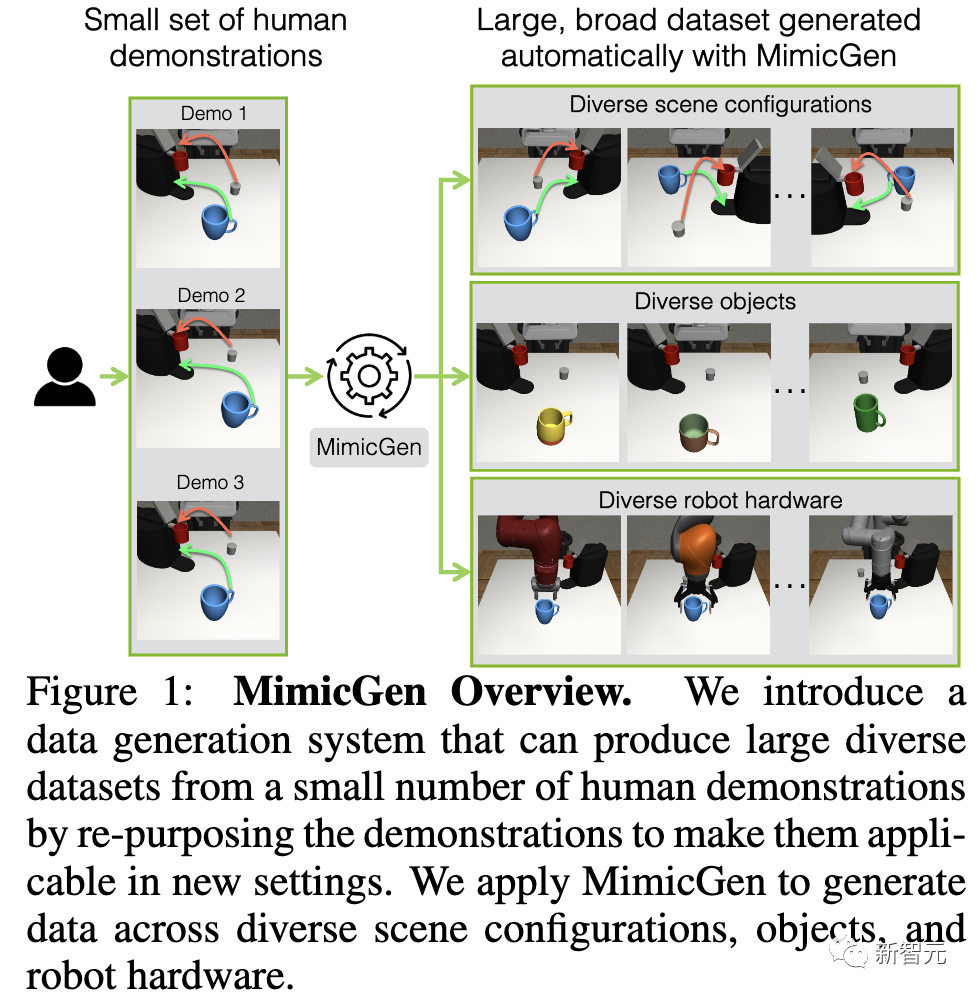

作為例證,英偉達(dá)與UT的研究人員在最新研究中,提出了一個(gè)MimicGen系統(tǒng),能夠大量生成機(jī)器人訓(xùn)練數(shù)據(jù)。

論文地址:https://arxiv.org/pdf/2310.17596.pdf

具體過程是,通過在模擬環(huán)境中,使用數(shù)字孿生技術(shù)復(fù)制真實(shí)世界中,人類的操作數(shù)據(jù)。

僅用了不到200個(gè)人類演示,MimicGen實(shí)現(xiàn)了在18個(gè)任務(wù)、多個(gè)模擬環(huán)境,甚至是現(xiàn)實(shí)世界中,自主生成5萬個(gè)訓(xùn)練數(shù)據(jù)。

值得一提的是,這項(xiàng)研究所有數(shù)據(jù)集全部開源。

在Jim Fan看來,合成數(shù)據(jù)和模擬對(duì)AI發(fā)展非常重要,可以獲得更多訓(xùn)練數(shù)據(jù),維持學(xué)習(xí)算法的進(jìn)步。它不僅適用于機(jī)器人領(lǐng)域,也會(huì)應(yīng)用到其他AI領(lǐng)域。

我們正在迅速耗盡來自網(wǎng)絡(luò)的高質(zhì)量的真實(shí)token。從人工合成數(shù)據(jù)中獲得人工智能,將是未來的發(fā)展方向。

恰恰,MimicGen展示了合成數(shù)據(jù)和模擬的力量,讓「縮放法則」(scaling law)得以延續(xù)。

準(zhǔn)備咖啡,操作如此絲滑

MimicGen實(shí)際表現(xiàn)如何,一起看些演示。

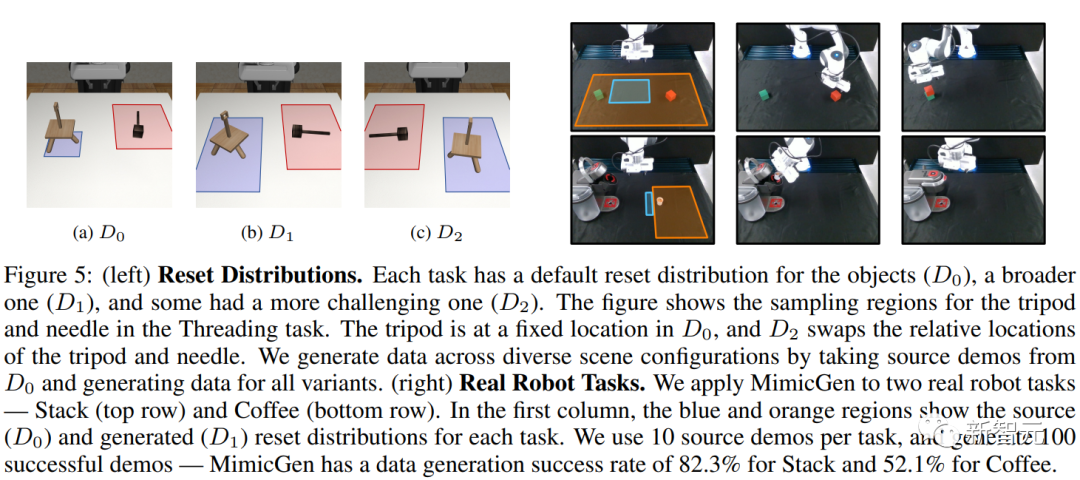

在下圖的示例中,MimicGen僅從10個(gè)人類演示中,為3種不同的環(huán)境分布生成了1000個(gè)演示。

下面,將展示MimicGen在跨多個(gè)不同任務(wù)和環(huán)境分布中生成的幾個(gè)數(shù)據(jù)集,比如積木堆疊、「穿針引線」、咖啡準(zhǔn)備、拼裝等等。

對(duì)于從未見過的杯子,MimicGen也能夠?qū)⑵涫占{到抽屜里。

不同的機(jī)械臂,也能靈活自如地操作。

MimicGen在長(zhǎng)期復(fù)雜的任務(wù)中的表現(xiàn)。

另外,MimicGen適用于需要毫米級(jí)精度的接觸式任務(wù)。

準(zhǔn)備咖啡的過程很絲滑。

而在其他生成示例中,合成數(shù)據(jù)都能完成高性能的展示,效果驚人!

MimicGen:生成式數(shù)據(jù)無限擴(kuò)展

可以看到,從人類演示中進(jìn)行模仿學(xué)習(xí),已成為訓(xùn)練機(jī)器人執(zhí)行各種操作行為的有效范例。

最為常見的方法是,人類通過不同的控制接口遠(yuǎn)程操作機(jī)器臂,生成執(zhí)行各種任務(wù)的示例,然后用這些數(shù)據(jù)訓(xùn)練機(jī)器人自己完成這些任務(wù)。

然鵝,這種方法既費(fèi)時(shí),又費(fèi)力。

另外,研究人員提出了另一個(gè)問題,在這些數(shù)據(jù)集中,實(shí)際上有多少數(shù)據(jù)包含了獨(dú)特的操作技能?

在最新研究中,作者提出了一種新型系統(tǒng)MimicGen,通過對(duì)人類演示進(jìn)行處理,自動(dòng)生成不同場(chǎng)景下的大規(guī)模數(shù)據(jù)集,進(jìn)而用于機(jī)器人的模仿學(xué)習(xí)。

具體來說:

- 人類遠(yuǎn)程操控機(jī)器人完成一個(gè)任務(wù),生成非常高質(zhì)量演示數(shù)據(jù),但緩慢且昂貴。

- 在高保真的GPU加速的模擬環(huán)境中,創(chuàng)建機(jī)器人和場(chǎng)景的數(shù)字孿生。

- 在模擬環(huán)境中移動(dòng)對(duì)象,替換新的物體,甚至改變機(jī)械臂,基本上是使用程序生成的方式擴(kuò)充訓(xùn)練數(shù)據(jù)。

- 導(dǎo)出成功的場(chǎng)景,提供給神經(jīng)網(wǎng)絡(luò)進(jìn)行訓(xùn)練。這樣就獲得了一個(gè)近乎無限的訓(xùn)練數(shù)據(jù)流。

總而言之,這項(xiàng)研究的主要貢獻(xiàn)在于,展示了MimicGen可以在各種新的場(chǎng)景配置、對(duì)象實(shí)例和機(jī)械臂上生成高質(zhì)量數(shù)據(jù),來通過模仿學(xué)習(xí)訓(xùn)練出熟練的智能體,這些都是人類演示中沒有的。

MimicGen廣泛適用于需要不同操作技能的長(zhǎng)序列任務(wù)和高精確度任務(wù),比如抓放、組裝等。

在2個(gè)模擬環(huán)境和1個(gè)物理機(jī)械臂上,只用大約200個(gè)人類演示就生成了5萬個(gè)新的演示,涵蓋18個(gè)任務(wù)。

與收集更多人類演示相比,這一方法更加優(yōu)越。

使用MimicGen生成的合成數(shù)據(jù)(例如從10個(gè)人類演示生成200個(gè)演示)與200個(gè)人類演示訓(xùn)練出的智能體性能相當(dāng)。

論文細(xì)節(jié)

問題設(shè)定

模仿學(xué)習(xí)

研究人員將每一個(gè)機(jī)器人操縱任務(wù)視為一個(gè)馬爾可夫決策過程(MDP),并旨在學(xué)習(xí)一個(gè)將狀態(tài)空間S映射到動(dòng)作空間A的機(jī)器人操縱策略。

問題陳述和假設(shè)

研究人員的目標(biāo)是使用一個(gè)源數(shù)據(jù)集D1,該數(shù)據(jù)集由在任務(wù)M上收集的一小組人類演示組成,并用它來生成一個(gè)大型的數(shù)據(jù)集D(用于相同任務(wù)或任務(wù)變體,其中初始狀態(tài)分布 D、對(duì)象或機(jī)器人臂可能發(fā)生變化)。

生成新演示的步驟如下:

(1)從研究人員想要生成數(shù)據(jù)的任務(wù)中抽樣一個(gè)起始狀態(tài),

(2)從D1中選擇并適應(yīng)一個(gè)演示以生成一個(gè)新的機(jī)器人軌跡τ',

(3)機(jī)器人在當(dāng)前場(chǎng)景中執(zhí)行軌跡τ',如果任務(wù)成功完成,則將狀態(tài)和動(dòng)作的序列添加到生成的數(shù)據(jù)集D中(具體的每一步請(qǐng)參見方法)。接下來,研究人員概述系統(tǒng)利用的一些假設(shè)。

假設(shè) 1:增量末端執(zhí)行器位姿( delta end effector Pose)動(dòng)作空間。動(dòng)作空間(action space)A包括用于末端執(zhí)行器控制器和夾持器開/關(guān)命令的增量位姿命令。

這使研究人員能夠?qū)⒀菔局械膭?dòng)作視為末端執(zhí)行器控制器的一系列目標(biāo)位姿。

假設(shè) 2:任務(wù)由已知的對(duì)象中心子任務(wù)序列組成。設(shè) O = {o?, ..., o?} 為任務(wù) M 中的對(duì)象集合。

研究人員假設(shè)任務(wù)由一系列對(duì)象中心子任務(wù) 組成,其中每個(gè)子任務(wù)

組成,其中每個(gè)子任務(wù) 相對(duì)于單一對(duì)象的坐標(biāo)系

相對(duì)于單一對(duì)象的坐標(biāo)系 。研究人員假設(shè)這個(gè)序列是已知的。

。研究人員假設(shè)這個(gè)序列是已知的。

假設(shè) 3:在數(shù)據(jù)收集期間,每個(gè)子任務(wù)開始時(shí)都可以觀察到對(duì)象的姿態(tài)。研究人員假設(shè)在每個(gè)子任務(wù) 的數(shù)據(jù)收集期間(但在策略部署期間則不是),研究人員可以觀察到相關(guān)對(duì)象 o?? 的姿態(tài)。

的數(shù)據(jù)收集期間(但在策略部署期間則不是),研究人員可以觀察到相關(guān)對(duì)象 o?? 的姿態(tài)。

研究方法

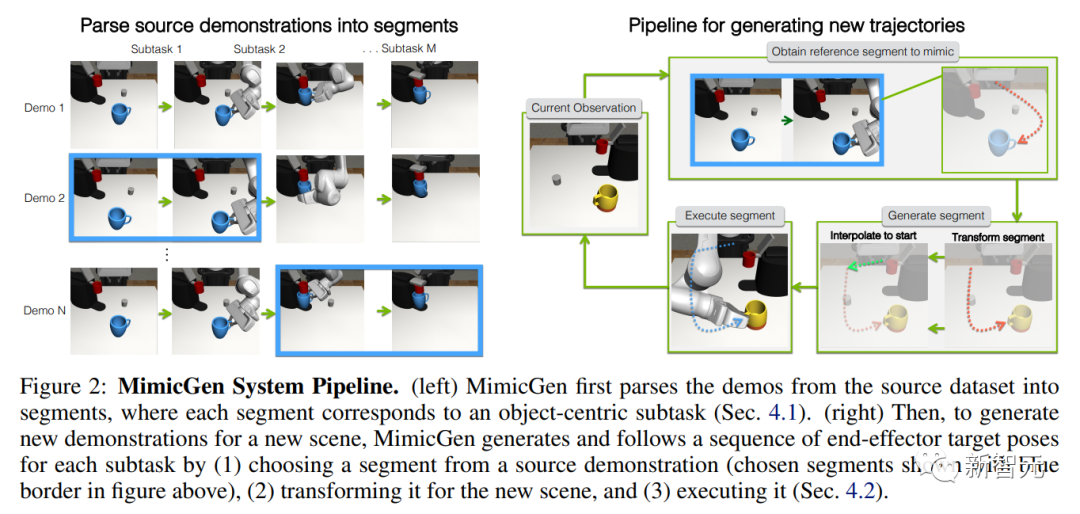

研究人員展示了如何使用一個(gè)小型的人類演示源數(shù)據(jù)集來生成新的演示(下圖 2 )。

MimicGen首先將源數(shù)據(jù)集解析為多個(gè)段(segment) — 每個(gè)段對(duì)應(yīng)于任務(wù)中的一個(gè)對(duì)象中心子任務(wù)。

然后,為了在新場(chǎng)景中生成一個(gè)演示,MimicGen會(huì)為每一個(gè)子任務(wù)生成并執(zhí)行一個(gè)軌跡(末端執(zhí)行器控制位姿的序列,sequence of end-effector control poses)。

方法是從源示例中選擇一個(gè)參考段,根據(jù)新場(chǎng)景中對(duì)象的位姿進(jìn)行轉(zhuǎn)換,然后使用末端執(zhí)行器控制器執(zhí)行目標(biāo)位姿的序列。

將源數(shù)據(jù)集解析為對(duì)象中心的段

每個(gè)任務(wù)都由一系列對(duì)象中心的子任務(wù)組成 — 研究人員希望將源數(shù)據(jù)集中的每個(gè)軌跡τ解析為多個(gè)段 {τ?}??=?,其中每個(gè)段τ?對(duì)應(yīng)于一個(gè)子任務(wù)S?(o??)。

為新場(chǎng)景轉(zhuǎn)換源數(shù)據(jù)段

為了在新場(chǎng)景中生成一個(gè)任務(wù)演示,MimicGen會(huì)為任務(wù)中的每一個(gè)對(duì)象中心子任務(wù)生成并執(zhí)行一個(gè)段。如上圖2(右)所示,這包括每個(gè)子任務(wù)的三個(gè)關(guān)鍵步驟:

(1)在源數(shù)據(jù)集中選擇一個(gè)參考子任務(wù)段,

(2)為新的上下文轉(zhuǎn)換子任務(wù)段,

(3)在場(chǎng)景中執(zhí)行該段。

選擇一個(gè)參考段:MimicGen將源數(shù)據(jù)集解析為與每個(gè)子任務(wù)相對(duì)應(yīng)的段 在每個(gè)子任務(wù) S?(o??) 開始時(shí),MimicGen從集合

在每個(gè)子任務(wù) S?(o??) 開始時(shí),MimicGen從集合 中選擇一個(gè)相應(yīng)的段。這些段可以隨機(jī)選擇或使用相關(guān)對(duì)象的位姿。

中選擇一個(gè)相應(yīng)的段。這些段可以隨機(jī)選擇或使用相關(guān)對(duì)象的位姿。

轉(zhuǎn)換源子任務(wù)段:研究人員可以將選定的源子任務(wù)段 τ? 視為末端執(zhí)行器控制器的目標(biāo)位姿序列。

執(zhí)行新段(Executing the new segment)

最后,MimicGen通過在每個(gè)時(shí)間步取目標(biāo)位姿,將其轉(zhuǎn)換為增量位姿動(dòng)作,與源段中相應(yīng)的抓取器打開/關(guān)閉動(dòng)作配對(duì),并執(zhí)行新動(dòng)作來執(zhí)行新段τ′?。

以上步驟重復(fù)每個(gè)子任務(wù),直到執(zhí)行了最后一個(gè)段。

然而,這個(gè)過程可能是不完美的——由于控制和手臂運(yùn)動(dòng)學(xué)問題導(dǎo)致的小軌跡偏差可能導(dǎo)致任務(wù)失敗。

因此,MimicGen在執(zhí)行所有段后檢查任務(wù)成功與否,并僅保留成功的演示。研究人員將成功生成軌跡的數(shù)量與總嘗試次數(shù)之間的比率稱為數(shù)據(jù)生成率。

這個(gè)流程只依賴于對(duì)象框架和機(jī)器人控制器框架——這使得數(shù)據(jù)生成可以在具有不同初始狀態(tài)分布、對(duì)象(假設(shè)它們有規(guī)范框架定義)和機(jī)器人手臂(假設(shè)它們共享末端執(zhí)行器控制框架的約定)的任務(wù)之間進(jìn)行。

在研究人員的實(shí)驗(yàn)中,研究人員為每個(gè)機(jī)器人操作任務(wù)設(shè)計(jì)了任務(wù)變體,其中研究人員改變初始狀態(tài)分布(D)、任務(wù)中的一個(gè)對(duì)象(O)或機(jī)器人手臂(R),并表明 MimicGen 支持這些變體之間的數(shù)據(jù)收集和模仿學(xué)習(xí)。

175個(gè)人類演示,生成5萬個(gè)數(shù)據(jù)集

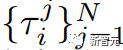

研究人員將MimicGen應(yīng)用于多種不同的任務(wù)(見下圖3)和任務(wù)變體,以展示它如何為模仿學(xué)習(xí)在包括拾取-放置、富有接觸性的交互以及關(guān)節(jié)動(dòng)作在內(nèi)的多樣化的操控行為生成有用的數(shù)據(jù)。

實(shí)驗(yàn)和結(jié)果

研究人員進(jìn)行了實(shí)驗(yàn),目的是(1)突出顯示MimicGen能夠生成數(shù)據(jù)的多樣情境;(2)展示MimicGen與收集額外人類示范相比在努力和數(shù)據(jù)下游政策性能方面都有優(yōu)勢(shì);(3)提供系統(tǒng)不同方面的洞見;(4)證明MimicGen能在真實(shí)世界的機(jī)器人手臂上工作。

MimicGen的應(yīng)用

研究人員概述了幾個(gè)展示MimicGen有用屬性的應(yīng)用場(chǎng)景。

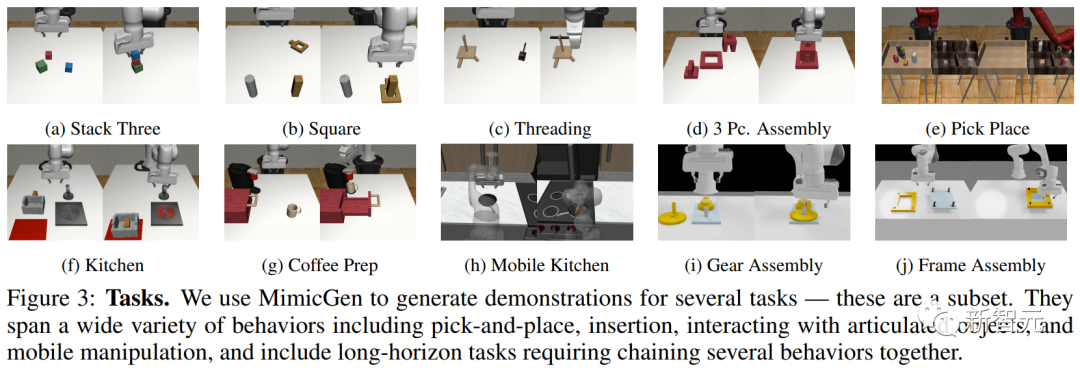

MimicGen數(shù)據(jù)大幅提升了代理在源任務(wù)上的性能。MimicGen一個(gè)直接的應(yīng)用就是收集某個(gè)感興趣任務(wù)的小型數(shù)據(jù)集,然后為該任務(wù)生成更多數(shù)據(jù)。與在小型源數(shù)據(jù)集上訓(xùn)練的代理相比,使用MimicGen生成的D0數(shù)據(jù)集訓(xùn)練的代理表現(xiàn)有顯著提升。

MimicGen數(shù)據(jù)能在廣泛的初始狀態(tài)分布下生成高性能的代理。如下圖4所示,使用在廣泛的初始狀態(tài)分布(D1、D2)上生成的數(shù)據(jù)集訓(xùn)練的代理具有很高的性能。

MimicGen能為不同對(duì)象生成數(shù)據(jù)。例如,在「Mug Cleanup(馬克杯收納)」任務(wù)的源數(shù)據(jù)集中只有一個(gè)馬克杯,但研究人員用MimicGen為一個(gè)未見過的馬克杯(O1)和一組12個(gè)馬克杯(O2)生成了演示。

MimicGen可以為多種機(jī)器人硬件生成數(shù)據(jù)。研究人員將MimicGen應(yīng)用于使用Panda手臂的Square和Threading源數(shù)據(jù)集,并為Sawyer、IIWA和UR5e生成了跨D0和D1重置分布變體的數(shù)據(jù)集。

將MimicGen應(yīng)用于移動(dòng)操縱。在「Mobile Kitchen(移動(dòng)廚房)」任務(wù)中,MimicGen使得成功率從2.0%提升到46.7%。

MimicGen是模擬器不可知的。研究人員證明MimicGen不僅限于一個(gè)模擬框架,通過將其應(yīng)用于在Isaac Gym之上構(gòu)建的Factory模擬框架中需要毫米級(jí)精度的高精度任務(wù)。

MimicGen和人類數(shù)據(jù)對(duì)比

MimicGen可以利用少量人類示例生成大規(guī)模數(shù)據(jù)集:

在18個(gè)任務(wù)中,只用175個(gè)人類示例就生成了超過5萬個(gè)示例。在Square任務(wù)中,只用10人類示例就生成了1000個(gè)示例,覆蓋不同場(chǎng)景配置。

而且MimicGen生成的數(shù)據(jù)集可以訓(xùn)練出高性能策略,甚至比人類示例的效果好很多:

在Square任務(wù)中,從10人類示例的數(shù)據(jù)集成功率11.3%,從生成數(shù)據(jù)集成功率可達(dá)90.7%。

在復(fù)雜的Coffee Preparation任務(wù)中,成功率從12.7%提升到97.3%,在高精度裝配任務(wù)Gear Assembly中,成功率從14.7%提升到98.7%。

MimicGen生成的數(shù)據(jù)集與人類數(shù)據(jù)集性能相當(dāng):

在Square任務(wù)中,200人類示例成功率為12%,200個(gè)生成示例成功率為11.3%,在Three Piece Assembly任務(wù)中,200人類示例成功率為14%,200生成示例成功率為13.3%。

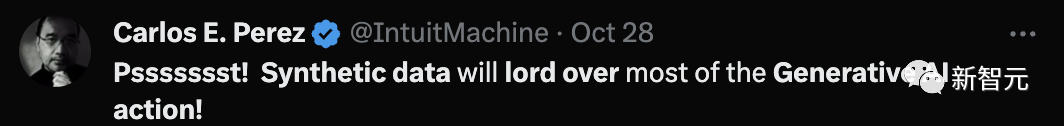

在機(jī)械臂上的表現(xiàn)上,MimicGen生成的數(shù)據(jù)的Stack任務(wù)從源域0%的成功率提升到了36%,Coffee任務(wù),成功率從源域的0%成功率到目標(biāo)域14%成功功率。

網(wǎng)友熱議

合成數(shù)據(jù)將主導(dǎo)大部分生成式人工智能行動(dòng)!

終有一天,人類標(biāo)注和演示成為過去。

有網(wǎng)友驚呼,這與AGI大差不差了,人類靈巧程度的機(jī)器人也會(huì)突然能力大爆發(fā)。

這正是我之前思考的AI智能超越人類智能,大概率只是時(shí)間問題:因?yàn)檎鎸?shí)世界有限的數(shù)據(jù)并不是限制,數(shù)據(jù)可以通過AI合成,之后再投入到模型訓(xùn)練中:Artificial synthetic data ? Training AI ? AI smarter ? Generating more synthetic data ? more into trianing AI model; Feedback Loop已建立。

有網(wǎng)友表示,「這可以用來生成自動(dòng)駕駛訓(xùn)練集嗎?這樣汽車公司就不必僅僅依靠真實(shí)世界的數(shù)據(jù)來訓(xùn)練他們的模型了?」