圖文并茂,三步速出「原神」文稿!首個(gè)70億參數(shù)圖文混合創(chuàng)作大模型正式開(kāi)源,一鍵生成神作

解放雙手,動(dòng)嘴碼字時(shí)代真的來(lái)了。

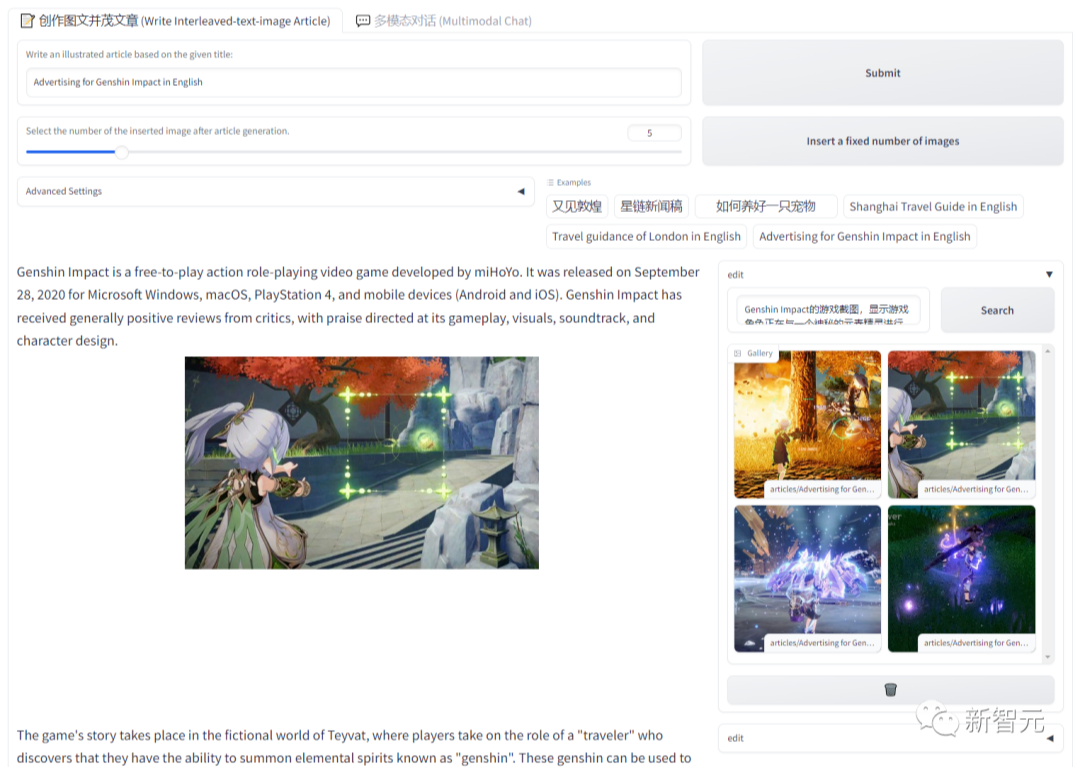

當(dāng)你想寫一份「原神」的宣傳文稿時(shí),根本完全不用上網(wǎng)翻找收集各種材料,只需要給模型一個(gè)指令「幫我以原神為題寫一篇文章」。

游戲背景現(xiàn)、上市時(shí)間、影響力等要點(diǎn)已經(jīng)成文。接下來(lái),你還可以讓LLM自動(dòng)插入趣味、生動(dòng)的配圖。

一眨眼的功夫,專屬定制的神作就完成了。

那么,究竟是什么模型有如此神力?

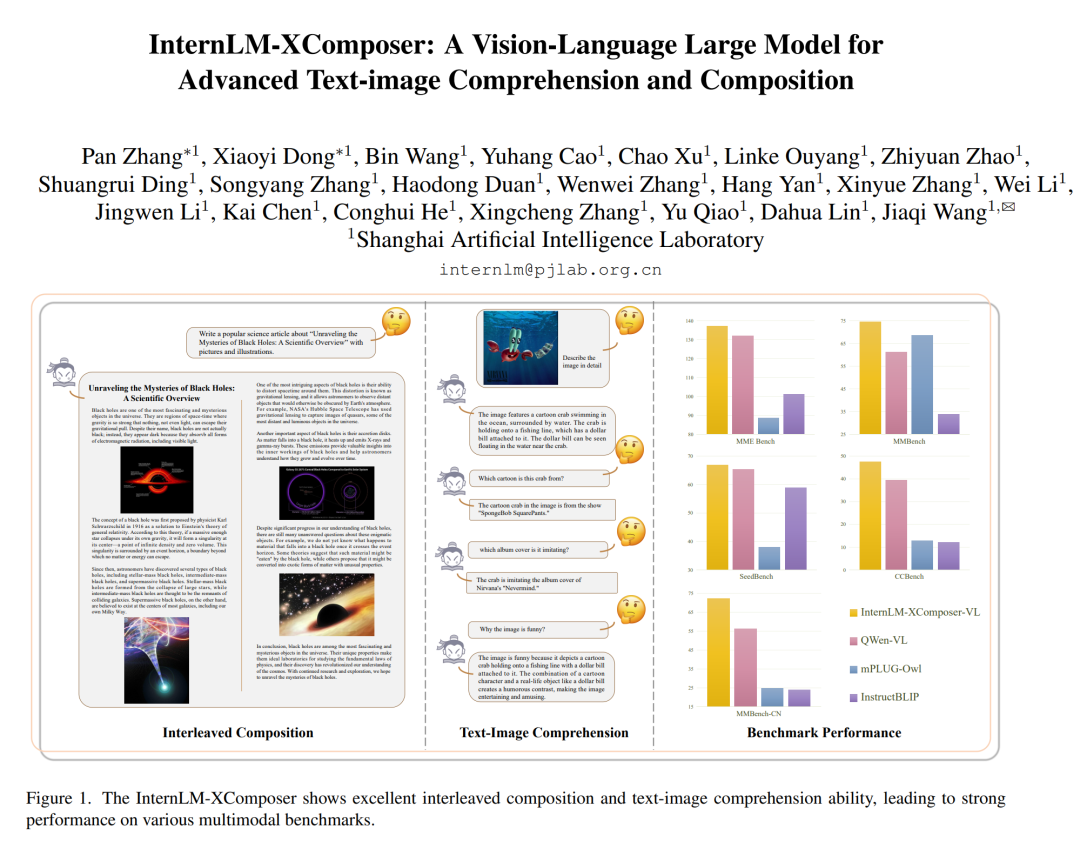

它就是,書(shū)生·浦語(yǔ)靈筆(InternLM-XComposer,以下簡(jiǎn)稱「浦語(yǔ)靈筆」)。這是上海人工智能實(shí)驗(yàn)室(上海AI實(shí)驗(yàn)室)推出的首個(gè)圖文混合創(chuàng)作大模型。

依托強(qiáng)大的多模態(tài)性能,可以解鎖「一鍵生成」圖文混合文章的創(chuàng)作能力,為大模型落地應(yīng)用提供更多可能。

目前,浦語(yǔ)靈筆已開(kāi)源其中的智能創(chuàng)作和對(duì)話(InternLM-XComposer-7B)及多任務(wù)預(yù)訓(xùn)練(InternLM-XComposer-VL-7B)版本,并提供免費(fèi)商用。

開(kāi)源鏈接:https://github.com/InternLM/InternLM-XComposer

技術(shù)報(bào)告:https://arxiv.org/abs/2309.15112

今年7月以來(lái),上海AI實(shí)驗(yàn)室陸續(xù)開(kāi)源了書(shū)生·浦語(yǔ)大語(yǔ)言模型的7B(InterLM-7B)及20B(InternLM-20B)版本,為業(yè)界提供了完整的大模型研發(fā)與應(yīng)用基座,以及全鏈條工具體系。

基于書(shū)生·浦語(yǔ)大語(yǔ)言模型(InternLM),浦語(yǔ)靈筆接受視覺(jué)和語(yǔ)言模態(tài)輸入,不僅在圖文對(duì)話方面表現(xiàn)優(yōu)秀,更具備圖文并茂文章的「一鍵生成」能力。

準(zhǔn)確圖文理解,一鍵圖文并茂

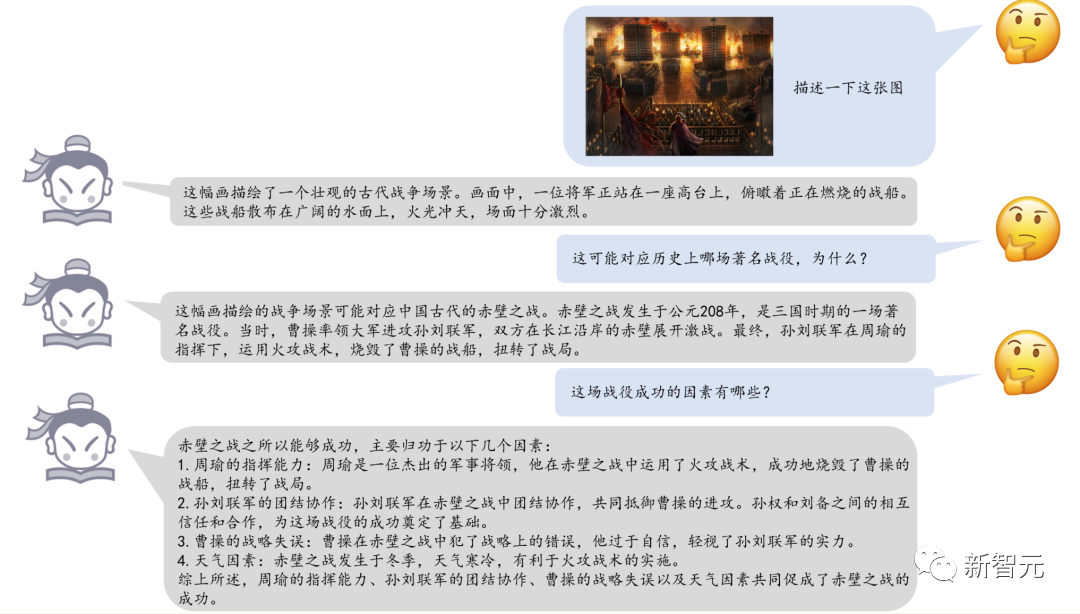

浦語(yǔ)靈筆能夠進(jìn)行流利的中英文圖文對(duì)話,準(zhǔn)確理解圖像內(nèi)容。得益于書(shū)生·浦語(yǔ)高質(zhì)量多語(yǔ)言預(yù)訓(xùn)練的優(yōu)勢(shì),浦語(yǔ)靈筆表現(xiàn)出對(duì)中國(guó)文化深厚的知識(shí)積淀。

例如,向浦語(yǔ)靈筆輸入相關(guān)畫作,其迅速識(shí)別并反饋畫作表現(xiàn)主題為《赤壁之戰(zhàn)》典故,亦能準(zhǔn)確介紹影響成敗的關(guān)鍵因素,體現(xiàn)出在圖像內(nèi)容理解和知識(shí)儲(chǔ)備方面的優(yōu)秀性能。

浦語(yǔ)靈筆識(shí)別中國(guó)文化典故

在多模態(tài)圖文對(duì)話的「基本功」之上,浦語(yǔ)靈筆更是解鎖了圖文并茂文章創(chuàng)作的全新能力。

大語(yǔ)言模型(LLM)具備文本寫作的能力,然而高質(zhì)量文章往往需要準(zhǔn)確且有趣的插圖才「更顯生動(dòng)」。

浦語(yǔ)靈筆團(tuán)隊(duì)將書(shū)生·浦語(yǔ)強(qiáng)大的語(yǔ)言能力向多模態(tài)拓展,使其能夠完成多模態(tài)文章創(chuàng)作。用戶僅需提供主題,便可一鍵生成圖文并茂的文章,體驗(yàn)全新的視覺(jué)與文本創(chuàng)作范式。

例如,向浦語(yǔ)靈筆提出創(chuàng)作一篇旅游攻略,該模型可迅速生成涵蓋歷史沿革、主要景點(diǎn)文物介紹的長(zhǎng)篇文章,并在適當(dāng)位置自動(dòng)插入與文字信息對(duì)應(yīng)的圖片。

除自動(dòng)配圖能力外,浦語(yǔ)靈筆還提供了配圖推薦和更換功能,根據(jù)用戶實(shí)際需求定制圖文內(nèi)容。

浦語(yǔ)靈筆生成中文旅游攻略

目前,浦語(yǔ)靈筆已支持科普文稿、營(yíng)銷廣告、新聞稿件、影視評(píng)論、生活指南等類型文章的圖文并茂生成,并將逐漸開(kāi)放更多能力,適應(yīng)更多樣化任務(wù)需求。

浦語(yǔ)靈筆生成英文電影評(píng)論

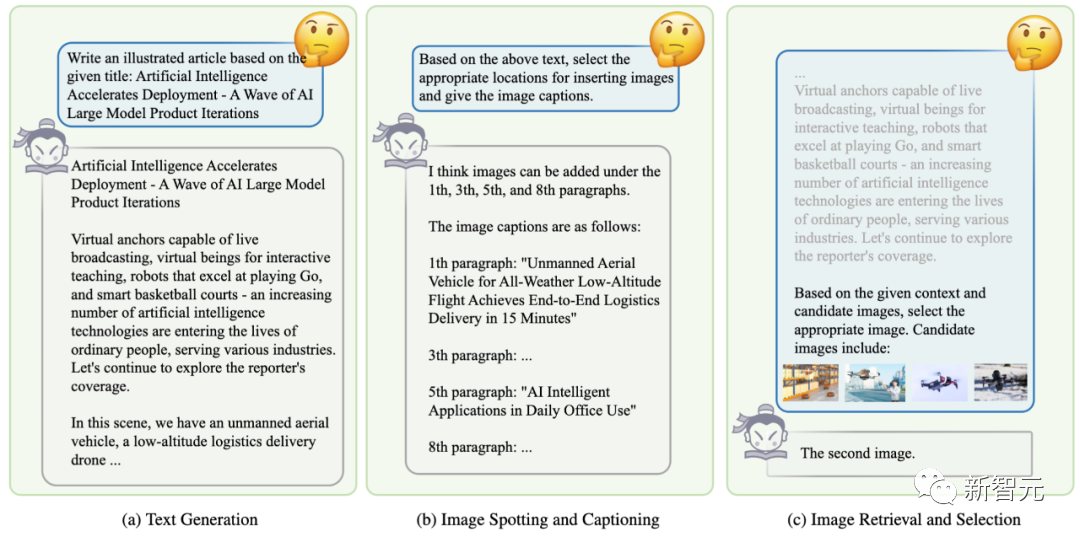

圖文文章創(chuàng)作「三步走」

浦語(yǔ)靈筆為圖文文章創(chuàng)作設(shè)計(jì)了「三步走」的算法流程。

浦語(yǔ)靈筆圖文文章創(chuàng)作流程

理解用戶指令,創(chuàng)作符合主題要求的長(zhǎng)文章:浦語(yǔ)靈筆具有強(qiáng)大的寫作能力,根據(jù)用戶輸入的主題,創(chuàng)作出文采斐然的文章。

智能分析文章,模型自動(dòng)規(guī)劃插圖的理想位置,并生成所需圖像的內(nèi)容要求:浦語(yǔ)靈筆自動(dòng)分析文章內(nèi)容和段落布局,規(guī)劃需要插圖圖片的位置。對(duì)于每個(gè)模型判斷需要插圖的位置,同時(shí)生成對(duì)圖片內(nèi)容需求的描述。

多層次智能篩選,利用多模態(tài)大模型的圖像理解能力,從圖庫(kù)中鎖定最完美的圖片:采用從粗篩到精選的配圖策略,根據(jù)生成圖像內(nèi)容需求,浦語(yǔ)靈筆會(huì)首先采用圖文檢索(Text-Image Retrieval)方式從海量圖庫(kù)中選擇出一組候選圖片。隨后,利用多模態(tài)大模型強(qiáng)大的圖像理解能力,將候選圖片作為輸入內(nèi)容,讓模型自動(dòng)選擇最符合文章上下文內(nèi)容和整體圖像風(fēng)格的圖片,完成文章的自動(dòng)配圖。

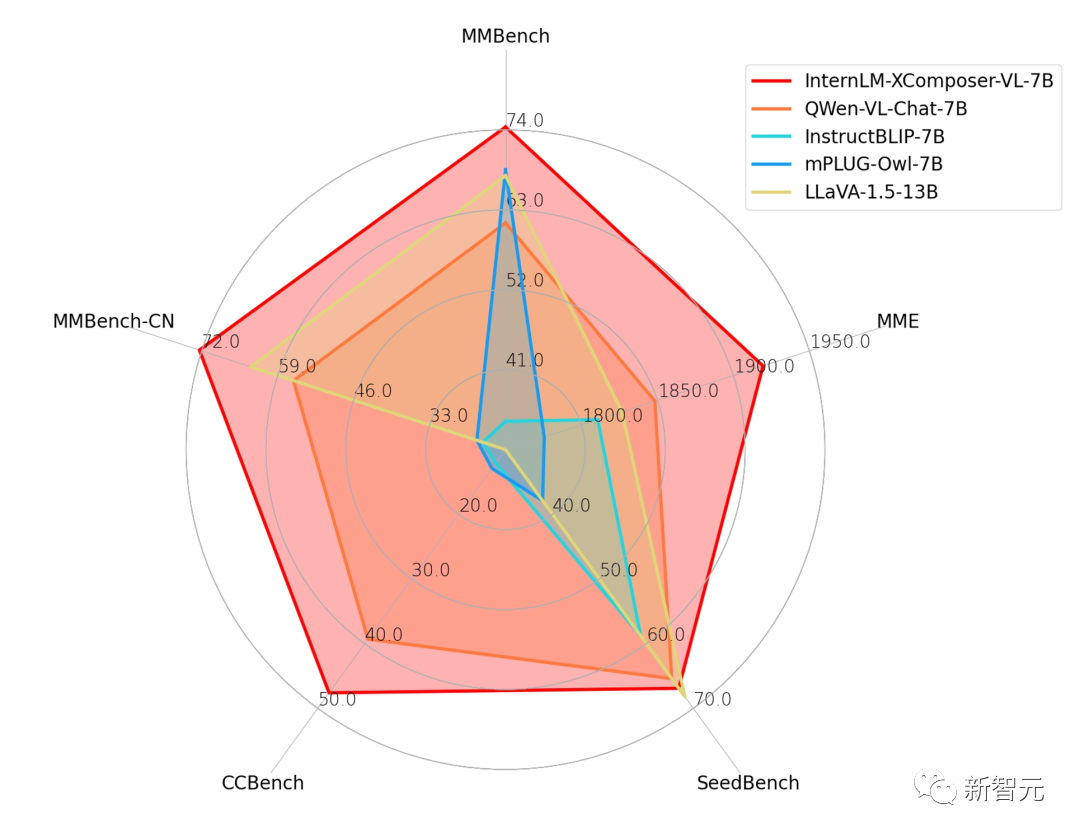

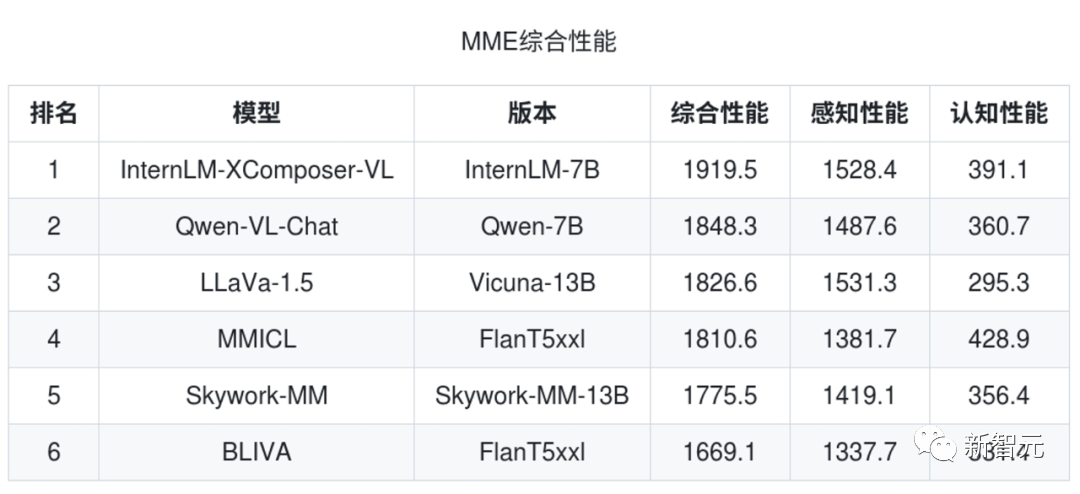

能力評(píng)測(cè):綜合領(lǐng)先開(kāi)源多模態(tài)大模型

浦語(yǔ)靈筆出色的圖文創(chuàng)作效果,得益于其多任務(wù)預(yù)訓(xùn)練模型(InternLM-XComposer-VL-7B)強(qiáng)大的多模態(tài)理解能力。

研究人員采用5個(gè)主流的多模態(tài)大模型評(píng)測(cè)對(duì)InternLM-XComposer-VL-7B的能力進(jìn)行了詳細(xì)測(cè)試,包含:

- MME Benchmark:包括14個(gè)子任務(wù)的多模態(tài)模型全面評(píng)測(cè),關(guān)注模型的感知(Perception)和認(rèn)知(Recognition)能力;

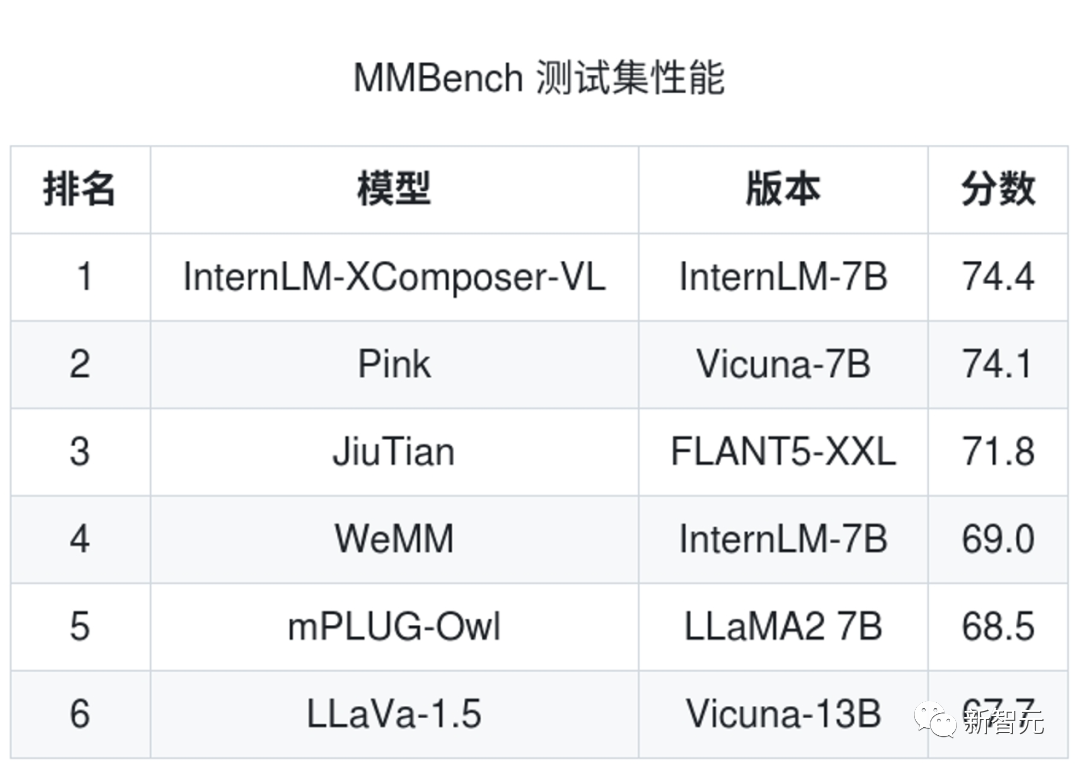

- MMBench:包括20個(gè)能力緯度和使用ChatGPT循環(huán)評(píng)估策略的多模態(tài)評(píng)測(cè);

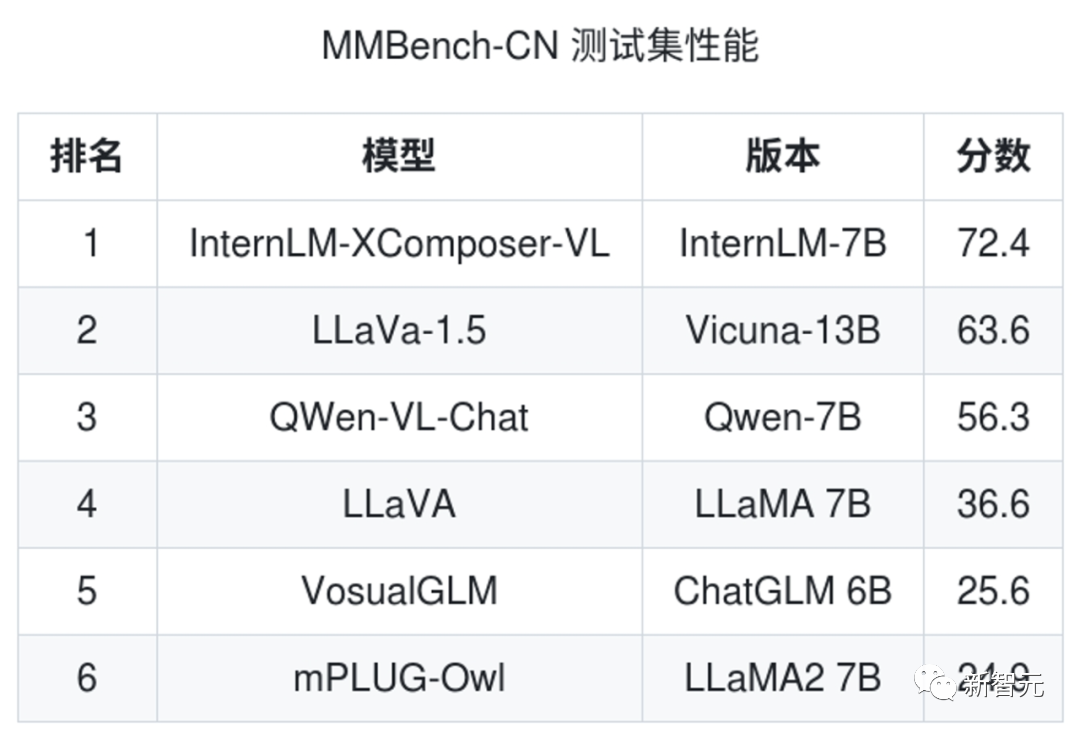

- MMBench-CN:簡(jiǎn)體中文版本問(wèn)題和答案的MMBench評(píng)測(cè);

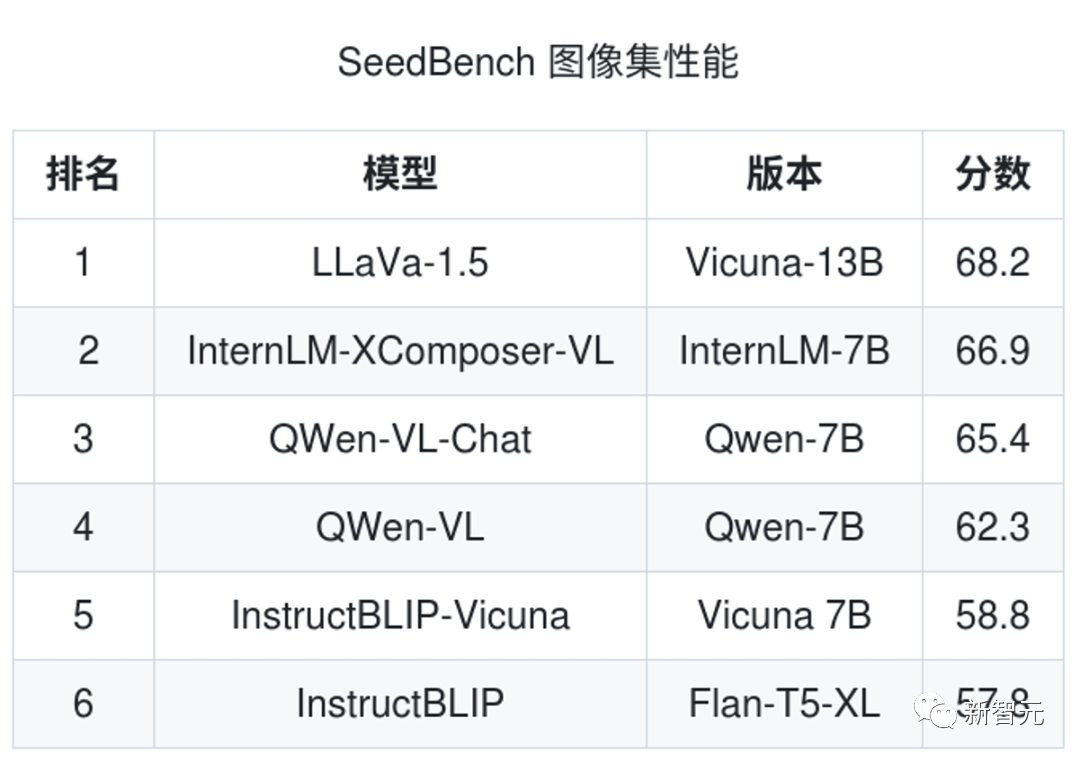

- Seed-Bench:提供包括人工標(biāo)注的1.9萬(wàn)道多模態(tài)多選題目的多模態(tài)評(píng)測(cè);

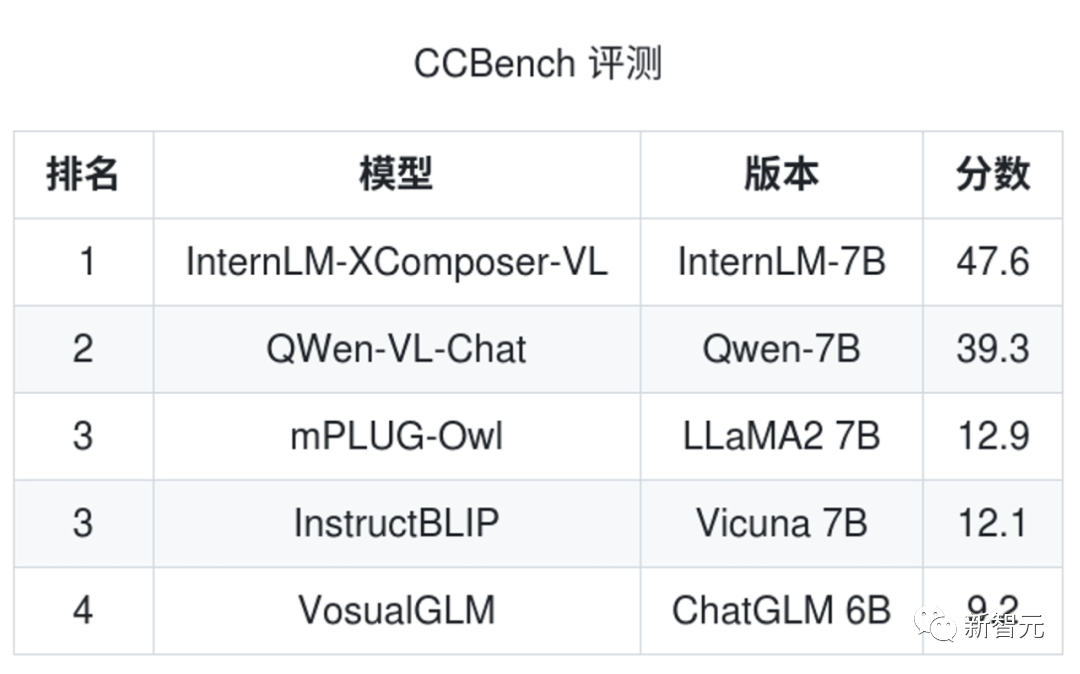

- CCBench:針對(duì)中國(guó)文化理解的中文多模態(tài)評(píng)測(cè)。

評(píng)測(cè)結(jié)果顯示,在上述5項(xiàng)中英文多模態(tài)評(píng)測(cè)中,浦語(yǔ)靈筆均體現(xiàn)出卓越性能。

浦語(yǔ)靈筆與其他開(kāi)源模型的性能對(duì)比

MME Benchmark關(guān)注模型的感知(Perception)和認(rèn)知(Recognition)能力,浦語(yǔ)靈筆綜合性能領(lǐng)先。

MMBench包括了20個(gè)能力項(xiàng),浦語(yǔ)靈筆取得了最佳成績(jī)。

MMBench-CN是中文版本的MMBench評(píng)測(cè),關(guān)注模型的中文多模態(tài)理解能力,浦語(yǔ)靈筆亦取得了最佳成績(jī),體現(xiàn)了強(qiáng)大的中文能力。

SEED-Bench 提供包括人工標(biāo)注的1.9萬(wàn)道多模態(tài)多選題目,覆蓋12個(gè)評(píng)測(cè)維度,浦語(yǔ)靈筆在圖像內(nèi)容理解上準(zhǔn)確率表現(xiàn)出色。

在針對(duì)中國(guó)文化理解設(shè)計(jì)的多模態(tài)評(píng)測(cè)CCBench,浦語(yǔ)靈筆評(píng)測(cè)成績(jī)均大幅度領(lǐng)先,生動(dòng)體現(xiàn)其在中國(guó)文化方面深厚的知識(shí)積淀。

浦語(yǔ)靈筆現(xiàn)已開(kāi)源,同時(shí)上線GitHub、Hugging Face及魔搭社區(qū)(ModelScope),歡迎開(kāi)發(fā)者下載試用。