再勝OpenAI!谷歌發布20億參數通用模型,100多種語言自動識別翻譯

上周,OpenAI發布的ChatGPT API和Whisper API,剛剛引動了一場開發者的狂歡。

3月6日,谷歌就推出了一款對標的模型——USM。不僅可以支持100多種語言,而且參數量也達到了20個億。

當然了,模型依然沒有對外開放,「這很谷歌」!

簡單來說,USM模型在涵蓋1200萬小時語音、280億個句子和300種不同語言的無標注數據集中進行了預訓練,并在較小的標注訓練集中進行了微調。

谷歌的研究人員表示,雖然用于微調的標注訓練集僅有Whisper的1/7,但USM卻有著與其相當甚至更好的性能,并且還能夠有效地適應新的語言和數據。

論文地址:https://arxiv.org/abs/2303.01037

結果顯示,USM不僅在多語種自動語音識別和語音-文本翻譯任務評測中實現了SOTA,而且還可以實際用在YouTube的字幕生成上。

目前,支持自動檢測和翻譯的語種包括,主流的英語、漢語,以及阿薩姆語這類的小語種。

最重要的是,還能用于谷歌在去年IO大會展示的未來AR眼鏡的實時翻譯。

Jeff Dean親自官宣:讓AI支持1000種語言

當微軟和谷歌就誰家擁有更好的AI聊天機器人爭論不休時,要知道,大型語言模型的用途可不僅于此。

去年11月,谷歌最先宣布了新項目「開發一種支持全球1000種最常用語言的人工智能語言模型」。

同年,Meta也發布了一個名為「No Language Left Behind」模型,并稱可以翻譯200多種語言,旨在打造「通用翻譯器」。

而最新模型的發布,谷歌將其描述為通向目標的「關鍵一步」。

在打造語言模型上,可謂群雄逐鹿。

據傳言,谷歌計劃在今年的年度 I/O 大會上展示20多款由人工智能驅動的產品。

當前,自動語音識別面臨許多挑戰:

- 傳統的監督學習方法缺乏可擴展性

在傳統的方法中,音頻數據需要費時又費錢的手動標記,或者從有預先存在的轉錄的來源中收集,而對于缺乏廣泛代表性的語言來說,這很難找到。

- 擴大語言覆蓋面和質量的同時,模型必須以高效的計算方式進行改進?

這就要求算法能夠使用來自不同來源的大量數據,在不需要完全重新訓練的情況下實現模型的更新,并且能夠推廣到新的語言和使用案例。

微調自監督學習

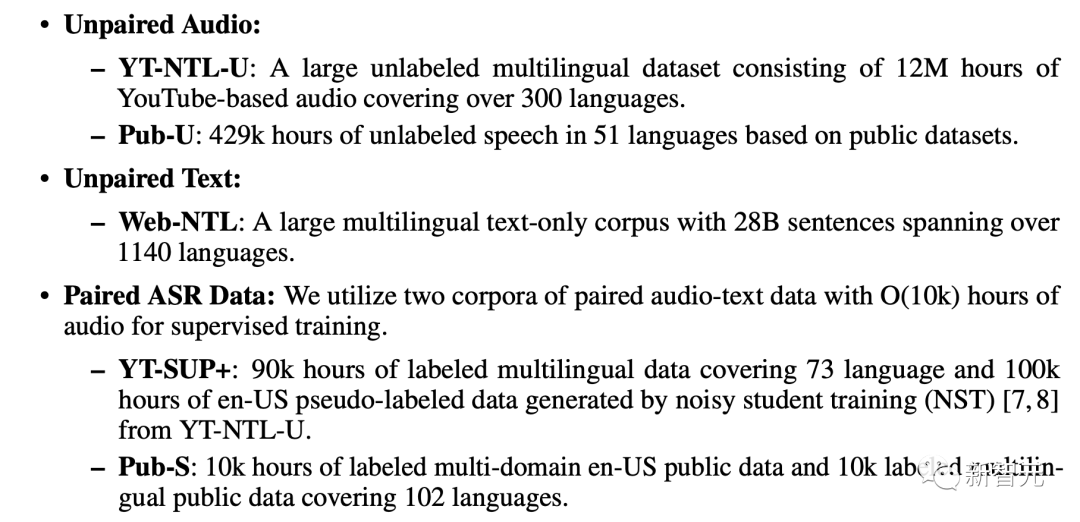

據論文介紹,USM的訓練采用了三種數據庫:未配對的音頻數據集、未配對的文本數據集、配對的ASR語料庫。

- 未配對的音頻數據集?

包括YT-NTL-U(超1200萬小時YouTube無標簽音頻數據)和Pub-U(超429,000小時的51種語言的演講內容)

- 未配對的文本數據集?

Web-NTL(超1140種不同語言的280億個句子)

- 配對的ASR語料庫?

YT-SUP +和 Pub-S語料庫(超10,000小時的音頻內容和匹配文本)

USM使用標準的編碼器-解碼器結構,其中解碼器可以是CTC、RNN-T或LAS。

對于編碼器,USM使用了Conformor,或卷積增強Transformer。

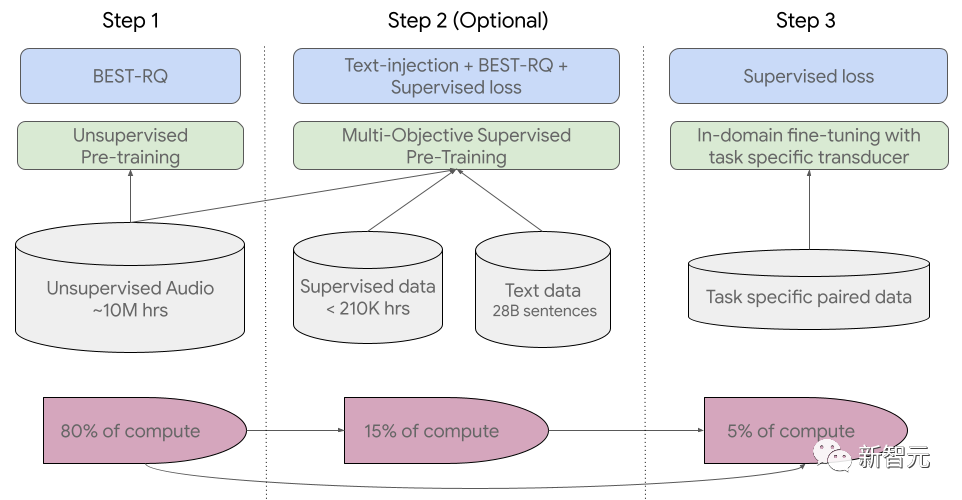

訓練過程共分為三個階段。

在初始階段,使用BEST-RQ(基于BERT的隨機投影量化器的語音預訓練)進行無監督的預訓練。目標是為了優化RQ。

在下一階段,進一步訓練語音表征學習模型。

使用MOST(多目標監督預訓練)來整合來自其他文本數據的信息。

該模型引入了一個額外的編碼器模塊,以文本作為輸入,并引入了額外的層來組合語音編碼器和文本編碼器的輸出,并在未標記的語音、標記的語音和文本數據上聯合訓練模型。

最后一步便是,對ASR(自動語音識別)和AST(自動語音翻譯)任務進行微調,經過預訓練的USM模型只需少量監督數據就可以取得很好的性能。

USM整體訓練流程

USM的性能如何,谷歌對其在YouTube字幕、下游ASR任務的推廣、以及自動語音翻譯上進行了測試。

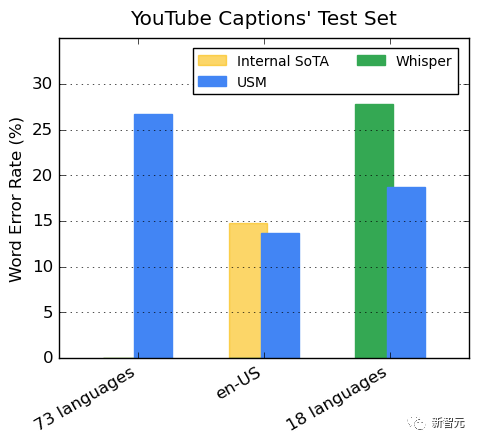

YouTube多語言字幕上的表現

受監督的YouTube數據包括73種語言,每種語言的數據時長平均不到3000個小時。盡管監督數據有限,但模型在73種語言中實現了平均不到30%的單詞錯誤率(WER),這比美國內部最先進的模型相比還要低。

此外,谷歌與超40萬小時標注數據訓練出的Whisper模型 (big-v2) 進行了比較。

在Whisper能解碼的18種語言中,其解碼錯誤率低于40%,而USM平均錯誤率僅為32.7%。

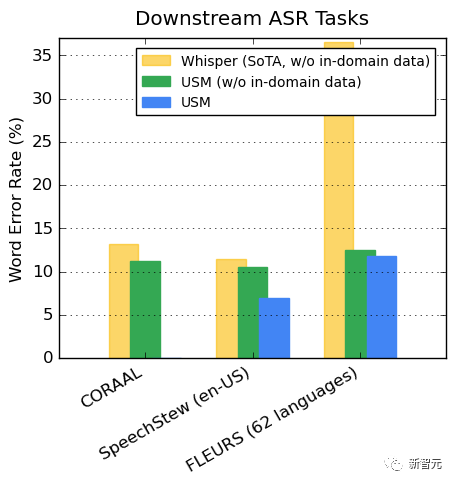

對下游ASR任務的推廣

在公開的數據集上,與Whisper相比,USM在CORAAL(非裔美國人的方言英語)、SpeechStew(英文-美國)和FLEURS(102種語言)上顯示出更低的WER,不論是否有域內訓練數據。

兩種模型在FLEURS上的差異尤為明顯。

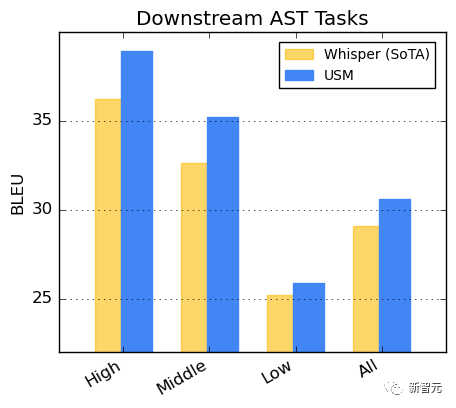

在AST任務上的表現

在CoVoST數據集上對USM進行微調。

將數據集中的語言按資源可用性分為高、中、低三類,在每一類上計算BLEU分數(越高越好),USM在每一類中的表現的優于Whisper。

研究發現,BEST-RQ預訓練是將語音表征學習擴展到大數據集的一種有效方法。

當與MOST中的文本注入相結合時,它提高了下游語音任務的質量,在FLEURS和CoVoST 2基準上實現了最好的性能。

通過訓練輕量級剩余適配器模塊,MOST表示能夠快速適應新的域。而這些剩余適配器模塊只增加2%的參數。

谷歌稱,目前,USM支持100多種語言,到未來將擴展到1000多種語言。有了這項技術,或許對于每個人來講走到世界各地穩妥了。

甚至,未來實時翻譯谷歌AR眼鏡產品將會吸引眾多粉絲。

不過,現在這項技術的應用還是有很長的一段路要走。

畢竟在面向世界的IO大會演講中,谷歌還把阿拉伯文寫反了,引來眾多網友圍觀。