從1小時到3.5分鐘,Meta新算法一部手機搞定3D人臉數據采集

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

搞定這樣的人臉3D建模需要幾步?

在數據采集的階段,答案是:一部手機 + 3.5分鐘。

沒錯,僅憑這3.5分鐘的數據,就足以生成高保真、可驅動的真實3D人臉頭像。

這項研究來自Meta Reality Labs——就是扎克伯格元宇宙計劃里的那個核心部門。論文已經被SIGGRAPH 2022接收。

作者提到,這一方法適用于VR應用。

也就是說,在VR的世界里,以后你可能就不必頂著一張卡通臉登場了。

而是可以方便地與胖友們“真身”相見。

方法原理

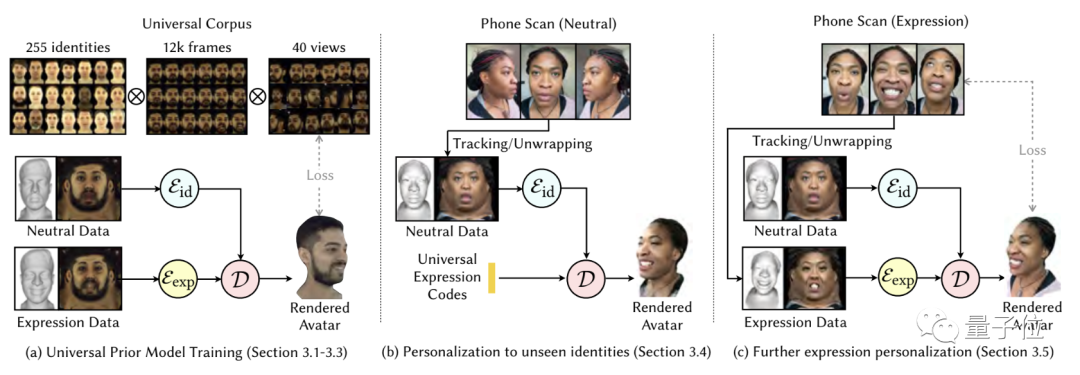

實現這一結果的方法框架如下圖所示:

具體而言,分為三個部分。

首先,是要用大型多視角人臉數據集訓練一個超網絡,這個超網絡可以通過神經網絡解碼器產生專屬于個人的頭像參數。

數據集中的人臉由多視角捕捉系統采集,包括255位不同年齡、性別和種族參與者的面部圖像數據。

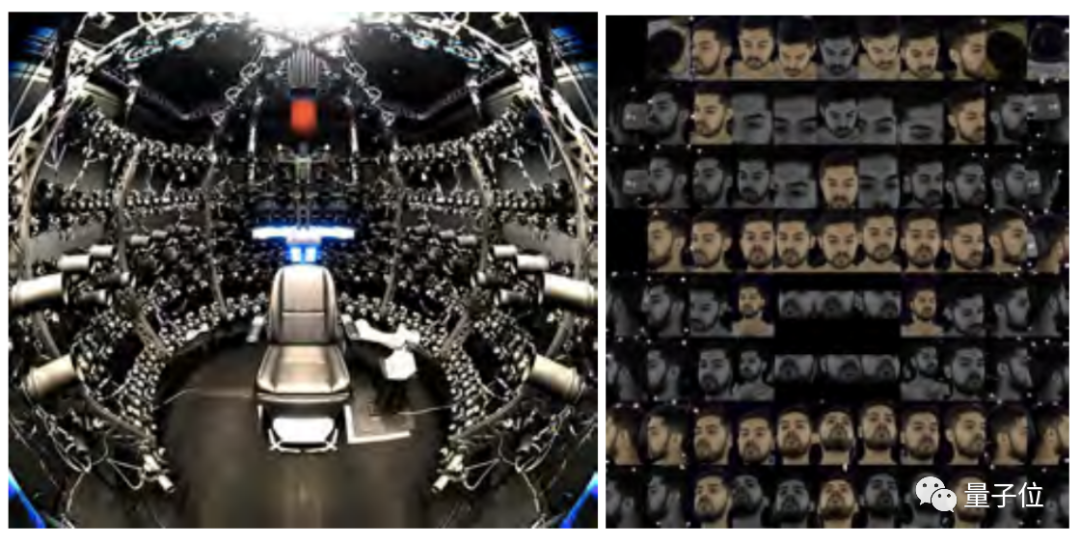

△左為圖像捕獲設備;右為采集到的人臉

這個捕獲3D人臉的巨型裝置是Meta在2019年研發的,其中配備171個高分辨率攝像頭,每秒能記錄180GB數據。采集時間在1個小時左右。

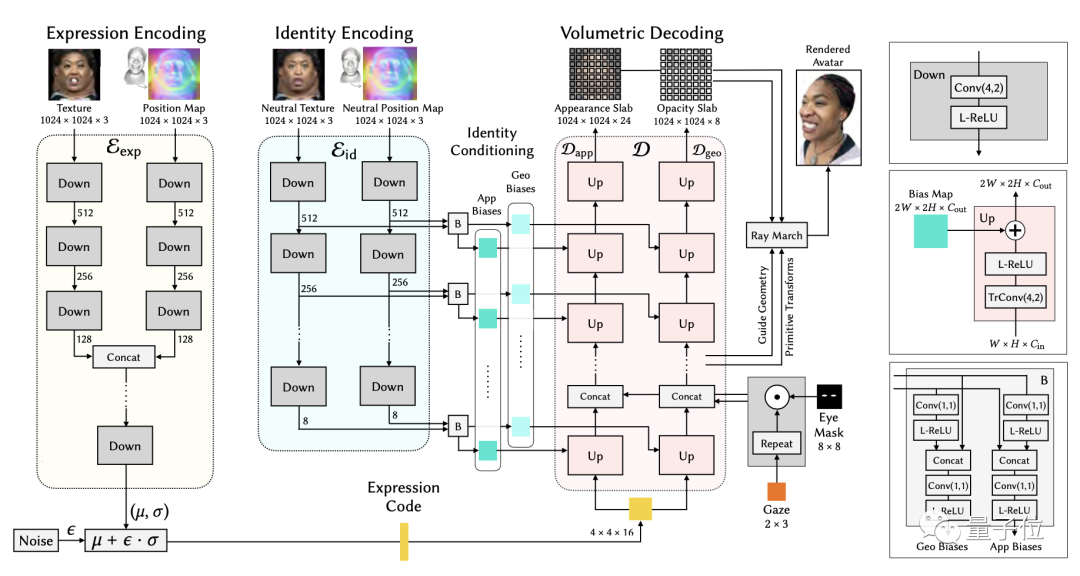

值得一提的是,在這個超網絡中,解碼器的基本組成模塊是帶有bias map的卷積上采樣層。

這些bias map會被用來生成體積單元,進而通過射線追蹤來渲染頭像。

另外,該解碼器結構能夠將視線與其他面部活動區分開,這在VR應用中意味著能夠更直接地利用眼動跟蹤系統。

其次,是輕量級人臉表情捕捉。

在這項研究中,采集人臉只需要用到一部帶有深度攝像頭的智能手機。

實驗中,研究人員采用的是iPhone 12。

采集過程就像這樣:

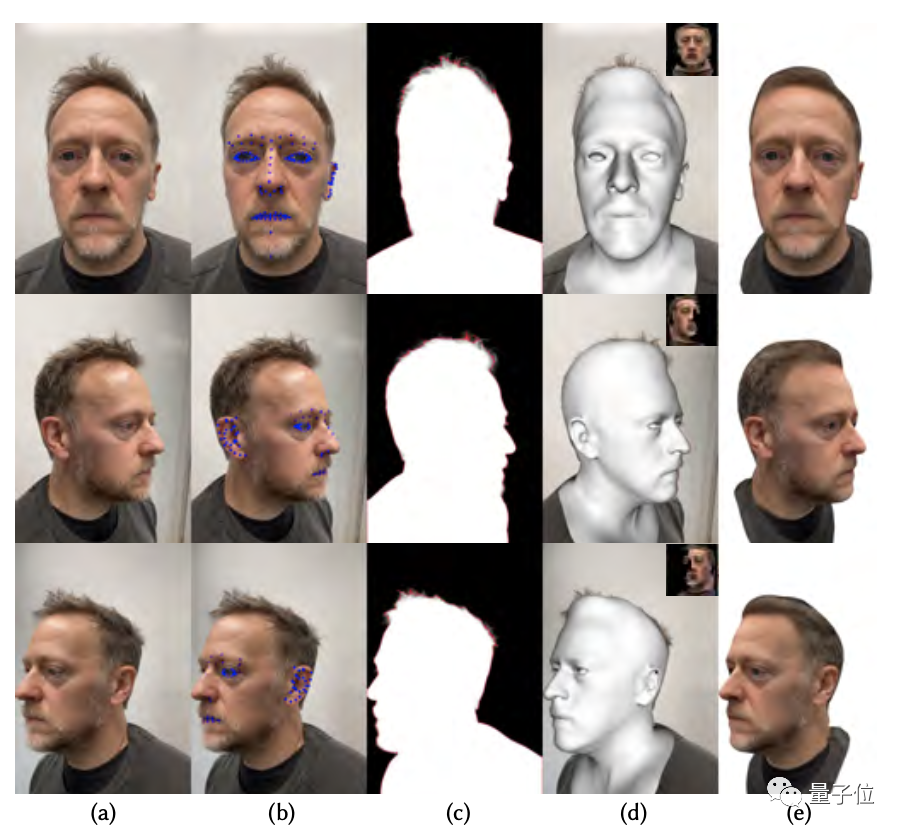

采集到的數據要進行如下處理:

- 獲取每一幀人臉圖像中的幾何形狀和紋理;

- 對輸入的RGB圖像進行人臉標志檢測和人像分割;

- 對模板網格進行擬合和變形,以匹配檢測到的人臉標志物、分割輪廓和深度圖;

- 對每一幀圖像的紋理進行解包,而后匯總得到完整的人臉紋理。

在進一步完善模型的過程中,還需要采集65種特定的表情:

最后,該方法輸出的3D人臉頭像不僅能與用戶外觀高度匹配,通過全局表情空間,還能對其進行進一步的驅動、控制。

研究人員表示,整個采集過程大概要花費3.5分鐘。

不過需要說明的是,建模的過程不是實時的,數據處理還要花費數小時的時間。

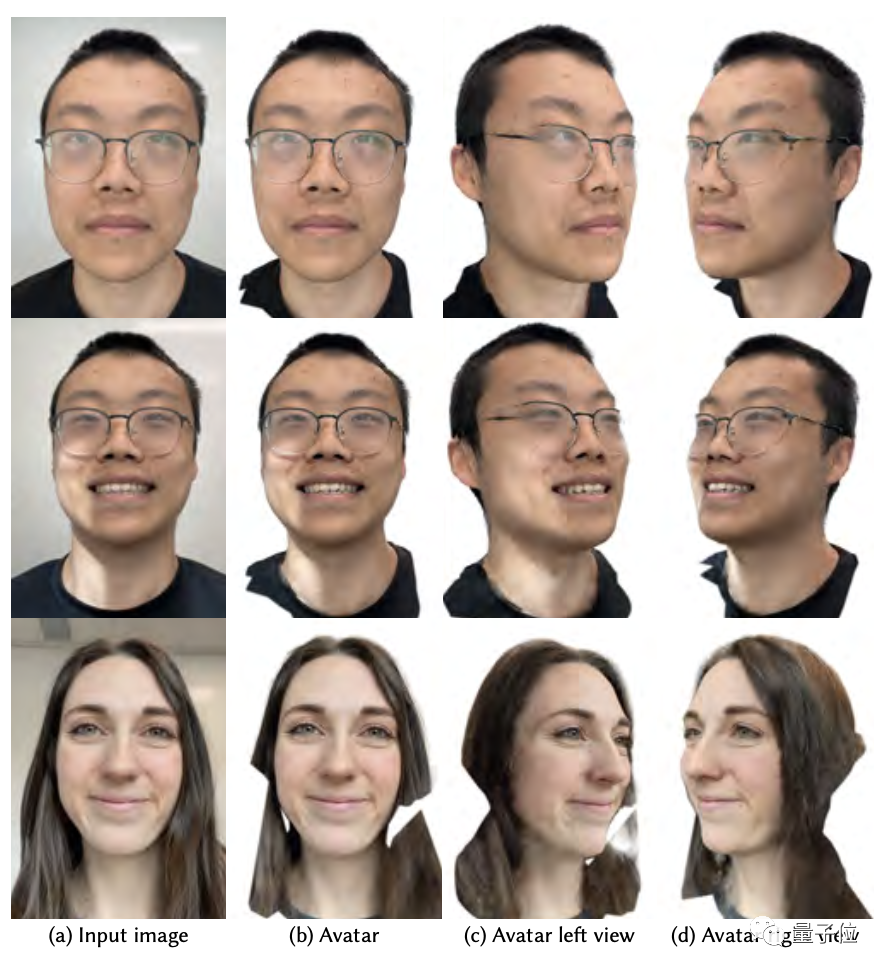

實驗結果

說了這么多,效果如何,我們還是來看實驗結果。

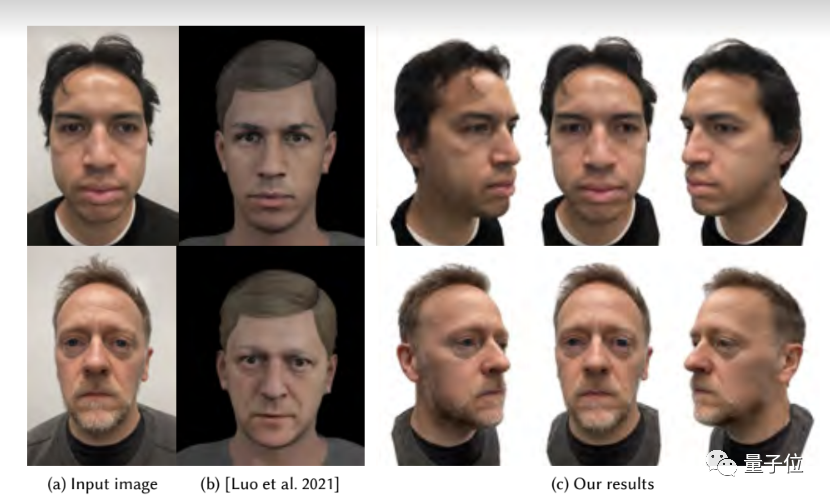

與Pinscreen提出的“一張照片構建3D數字化身”(CVPR 2021)的方法相比,該方法能生成更具真實感的人臉模型。

而與海德堡大學、慕尼黑工業大學、馬普所等研究機構在Neural Head Avatars from Monocular RGB Videos一文中提出的方法相比,該方法能生成保真度更高的結果。

不過,作者也指出了該方法的局限性:hold不太住長發和眼鏡,容易產生偽影。另外,該方法對于光照條件也有一定要求。