觸覺從未如此真實(shí)!兩位南加州大學(xué)華人博士革新「觸覺感知」算法

電子技術(shù)的發(fā)展,讓我們可以隨時(shí)隨地享受一場「視聽盛宴」,人類的聽覺和視覺從此徹底解放。

近幾年,給設(shè)備裝上「觸覺」逐漸成了新的研究熱點(diǎn),尤其是在「元宇宙」概念的加持下,加上觸感無疑能讓虛擬世界的真實(shí)感大大提升。

當(dāng)下觸覺感知技術(shù)主要是通過「數(shù)據(jù)驅(qū)動(dòng)」的模式來模擬和渲染觸感,模型首先記錄下用戶與真實(shí)紋理交互的信號(hào),然后將信號(hào)輸入到紋理生成部分,并用振動(dòng)的方式將觸感「回放」給用戶。

最近一些方法大多基于用戶交互運(yùn)動(dòng)和高頻振動(dòng)信號(hào)來對紋理的特征進(jìn)行建模,比如摩擦和微觀表面特征。

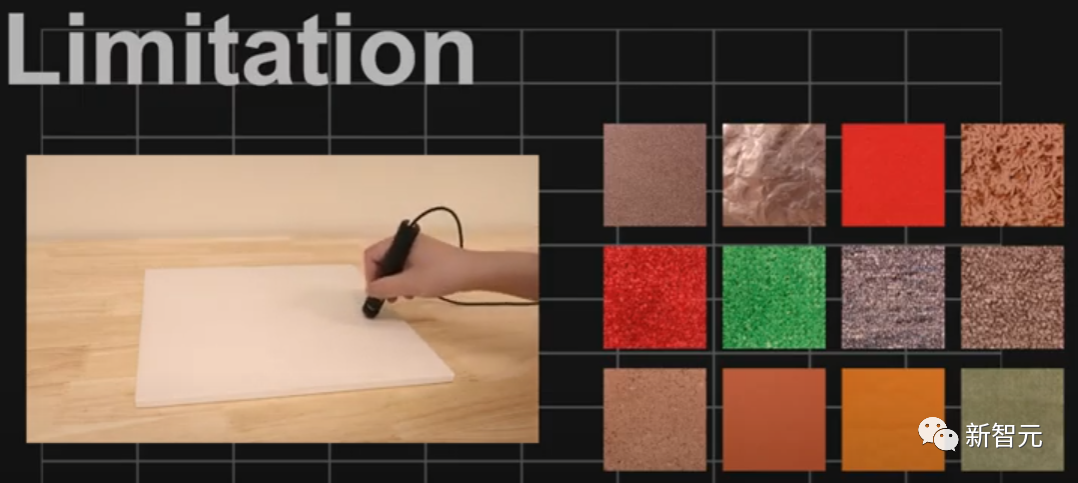

雖說數(shù)據(jù)驅(qū)動(dòng)極大提升了模擬的真實(shí)感,但仍然存在諸多限制。

比如世界上的紋理可以說是有「無數(shù)種」,如果每種紋理都記錄一遍,所需的人力、物力都不可想象,也無法滿足一些小眾用戶的需求。

人類對于觸覺的感知相當(dāng)敏感,不同的人對于相同物體的感覺也不同,數(shù)據(jù)驅(qū)動(dòng)的方式無法從根本上消除從紋理記錄到紋理渲染的感知不匹配問題。

最近,南加州大學(xué)維特比工程學(xué)院的三個(gè)博士生提出了一種全新的「偏好驅(qū)動(dòng)」模型框架,利用人類分辨紋理細(xì)節(jié)的能力對生成的虛擬感知進(jìn)行調(diào)整,最終可以達(dá)到相當(dāng)逼真的觸覺感知,論文發(fā)表在IEEE Transactions on Haptics.

論文鏈接:https://ieeexplore.ieee.org/document/9772285

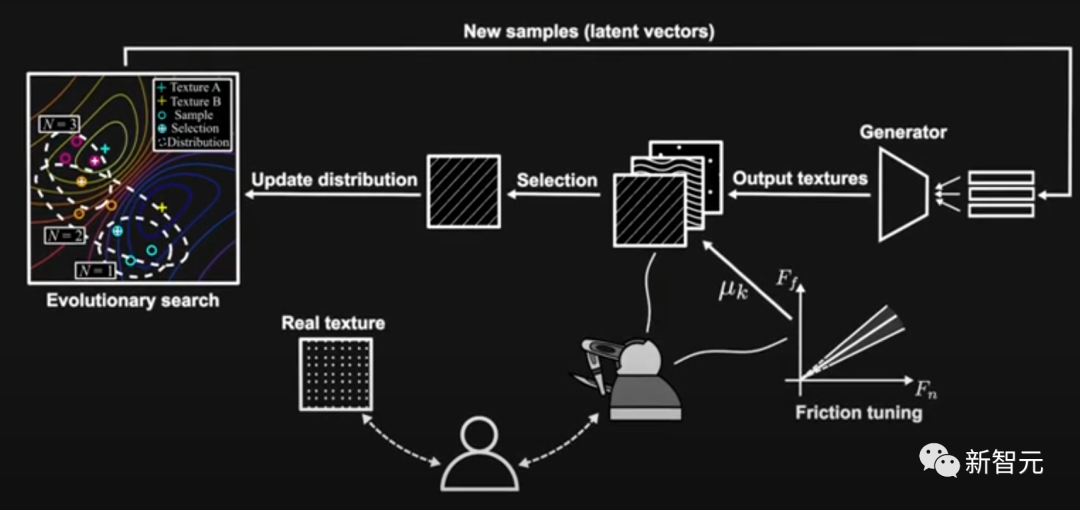

偏好驅(qū)動(dòng)的模型首先會(huì)給用戶一個(gè)真實(shí)的觸摸紋理,然后模型會(huì)使用幾十個(gè)變量隨機(jī)生成三個(gè)虛擬紋理,然后用戶可以從中選擇摸起來與真實(shí)物體最相似的一個(gè)紋理。

隨著不斷地試錯(cuò)和反饋,模型會(huì)通過搜索不斷優(yōu)化變量的分布,使得生成的紋理更接近用戶的偏好。這種方法比直接記錄、回放紋理具有明顯優(yōu)勢,因?yàn)橛?jì)算機(jī)讀取的內(nèi)容和人類的真實(shí)感受之間總是存在差距。

這個(gè)流程實(shí)際上跟「甲方乙方」差不多,我們作為感知者(甲方),如果覺得觸摸感不對勁,就打回去,讓算法(乙方)修改重新生成,直到生成的效果滿意為止。

這樣做實(shí)際上很合理,因?yàn)椴煌娜嗣嗤奈矬w都會(huì)有不同的感覺,但計(jì)算機(jī)釋放的信號(hào)卻是相同的,所以根據(jù)每個(gè)人進(jìn)行觸感定制,很有必要!

整個(gè)系統(tǒng)由兩個(gè)模塊組成,首先是一個(gè)深度卷積生成對抗網(wǎng)絡(luò)(DCGAN),用于將潛空間的向量映射到紋理模型,在UPenn Haptic Texture Toolkit (HaTT)上進(jìn)行訓(xùn)練。

第二個(gè)模塊是一個(gè)基于比較的進(jìn)化算法:一組生成的紋理模型中,協(xié)方差矩陣適應(yīng)進(jìn)化策略(CMA-ES)會(huì)根據(jù)用戶的偏好反饋創(chuàng)建一個(gè)新的紋理模型以進(jìn)化。

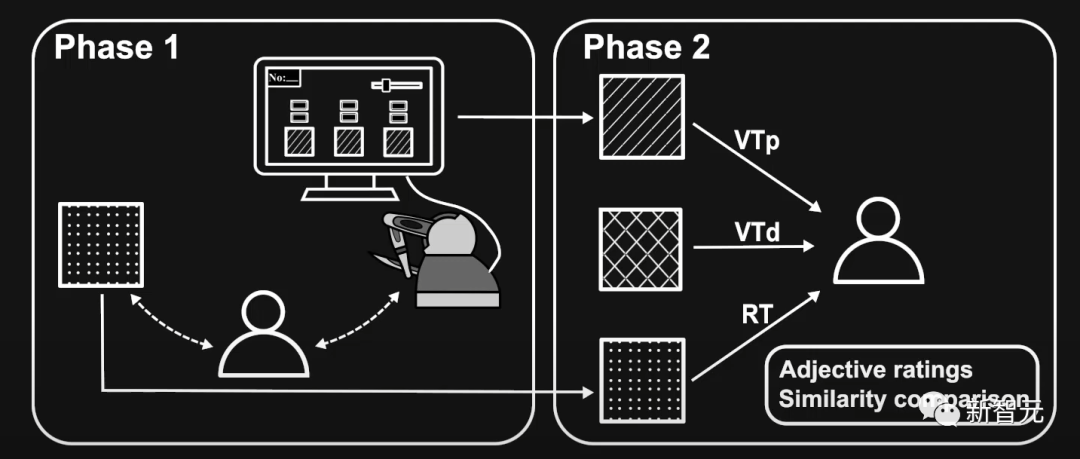

為了模擬真實(shí)紋理,研究人員首先會(huì)要求用戶使用定制工具來觸摸真實(shí)紋理,然后使用觸覺設(shè)備觸摸一組虛擬紋理候選,其中觸覺反饋通過連接到設(shè)備觸控筆的Haptuator來傳輸。

用戶唯一需要做的就是選擇最接近真實(shí)紋理的虛擬紋理,并使用簡單的滑塊接口來調(diào)整摩擦量(amount of friction),因?yàn)槟Σ翆τ诩y理觸感來說至關(guān)重要,也可能因人而異。

然后所有的虛擬紋理將根據(jù)用戶的選擇按照進(jìn)化策略進(jìn)行更新,然后用戶再次進(jìn)行選擇和調(diào)整。

重復(fù)上述過程,直到用戶找到他們認(rèn)為的接近真實(shí)紋理的虛擬紋理并保存,或者找不到更接近的虛擬紋理為止。

研究人員將評估過程分為兩個(gè)階段,每個(gè)階段分別有一組參與者。

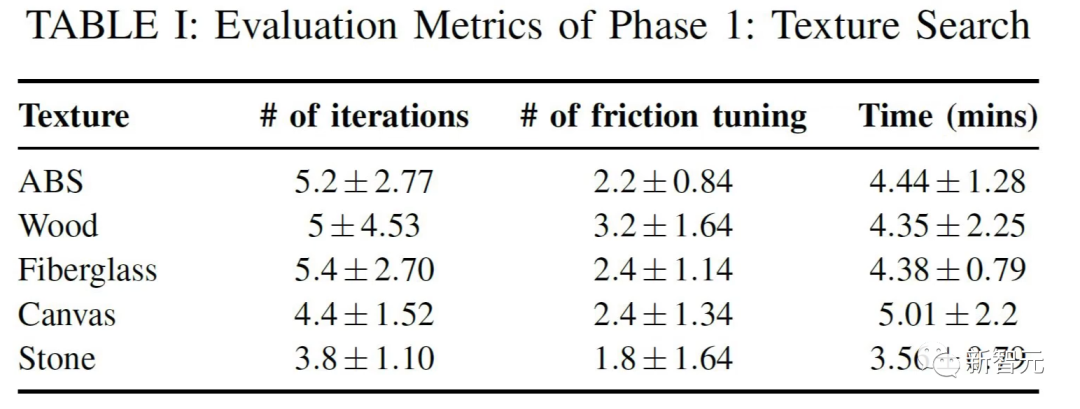

在第一階段,五名參與者分別為5個(gè)真實(shí)紋理生成和搜索虛擬紋理。

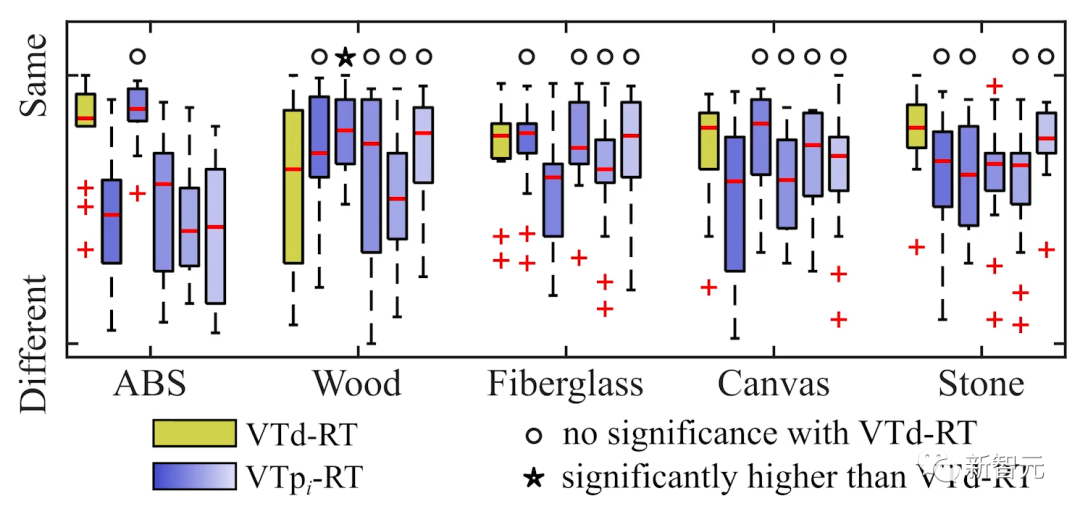

第二階段則是評估最終保存的偏好驅(qū)動(dòng)紋理(VTp)及其相應(yīng)的真實(shí)紋理(RT)之間的差距。

評估的方式主要采用形容詞評價(jià)(adjective rating)的方式,對包括粗糙度、硬度和光滑度等感知維度進(jìn)行評估。

并且在VTp、RT和數(shù)據(jù)驅(qū)動(dòng)的紋理(VTd)之間的相似性進(jìn)行比較。

實(shí)驗(yàn)結(jié)果也表明遵循進(jìn)化的過程,用戶能夠有效地找到一個(gè)虛擬紋理模型,真實(shí)程度超過數(shù)據(jù)驅(qū)動(dòng)模型。

此外,超過80%的參與者認(rèn)為偏好驅(qū)動(dòng)模型生成的虛擬紋理評級要優(yōu)于數(shù)據(jù)驅(qū)動(dòng)模型。

觸覺設(shè)備在視頻游戲、時(shí)裝設(shè)計(jì)和手術(shù)模擬中越來越受歡迎,即使在家里,我們也開始看到用戶使用與筆記本電腦一樣流行的那些觸覺設(shè)備。

比如第一人稱視頻游戲加入觸覺以后,會(huì)極大提升玩家的真實(shí)感。

論文作者表示,當(dāng)我們通過工具與環(huán)境交互時(shí),觸覺反饋只是一種形式,一種感官反饋,音頻是另一種感官反饋,兩者都非常重要。

除了游戲外,這項(xiàng)工作成果對于用于牙科或手術(shù)培訓(xùn)的虛擬紋理尤其有用,這些虛擬紋理需要非常準(zhǔn)確。

「外科訓(xùn)練絕對是一個(gè)巨大的領(lǐng)域,需要非常逼真的紋理和觸覺反饋;裝修設(shè)計(jì)還需要在開發(fā)過程中對質(zhì)地進(jìn)行高度精確地模擬,然后再進(jìn)行制造。」

從電子游戲到時(shí)裝設(shè)計(jì),一切都在集成觸覺技術(shù),而現(xiàn)有的虛擬紋理數(shù)據(jù)庫可以通過這種用戶偏好方法得到改進(jìn)。

紋理搜索模型還可以讓用戶從數(shù)據(jù)庫中提取虛擬紋理,例如賓夕法尼亞大學(xué)的觸覺紋理工具包,可以對其進(jìn)行改進(jìn),直到獲得他們想要的結(jié)果。

這項(xiàng)技術(shù)與紋理搜索模型一結(jié)合,那你就可以使用之前別人已經(jīng)記錄完成的虛擬紋理,然后根據(jù)策略來優(yōu)化紋理。

作者暢想,在未來,模型甚至可能不需要真實(shí)的紋理。

我們生活中的一些常見事物的感覺是非常直觀的,我們天生就可以通過查看照片來微調(diào)自己的感官,而無需參考真實(shí)的紋理。

比如當(dāng)我們看到一張桌子時(shí),我們可以想象一旦觸摸到這張桌子會(huì)有什么感覺,利用我們對表面的這種先驗(yàn)知識(shí),就可以向用戶提供視覺反饋,并允許他們選擇匹配的內(nèi)容。

文章的第一作者Shihan Lu目前是南加州大學(xué)計(jì)算機(jī)科學(xué)學(xué)院的博士研究生,之前在沉浸式技術(shù)方面做過聲音方面的相關(guān)工作,即通過在工具與其交互時(shí)引入匹配的聲音,使虛擬紋理更加身臨其境。

文章的的第二作者M(jìn)ianlun Zheng(鄭棉侖)是南加州大學(xué)計(jì)算機(jī)科學(xué)學(xué)院的博士研究生,本科和碩士畢業(yè)于武漢大學(xué)。

? ?