作者:千山

審校:武穆

隨著技術進步,AI展現出了強大的發展潛力。從第一個打敗人類圍棋世冠的AlphaGo到可以自主編程的AlphaCode,AI的可塑性常常令人驚嘆。不過與AI有關的爭議也一直如影隨形,比如人臉識別涉及的隱私問題、諸多假新聞的自動生成等。

如今,OpenAI新推出的DALL·E 2系統又一次引發了關注,這個系統能根據文本描述自動生成各種圖片,這些圖片不僅能以假亂真,而且往往擁有光怪陸離的表現力。但在這種能力的背后,關于偏見和造假的隱憂再次浮出水面。因為技術雖無善惡,但人性可能經不起考驗。

你見過泰迪熊在時代廣場玩滑板嗎?你見過宇航員在外太空騎馬嗎?

DALL-E 2 讓你“看”到了以上兩幅現實中根本不存在的圖像。

DALL-E 2是何物?它是聞名遐邇的 OpenAI 開發出的文本生成圖像工具DALL-E 的最新版本,也是最近有點小破圈、引起了一定討論熱度的AI系統。

DALL-E 2:畫質飛升,新增二次創作功能

2021年1月,OpenAI創造了DALL-E。這一系統是基于GPT-2/GPT-3語言模型與CLIP圖片識別系統而生成的。據了解,DALL-E這一名稱來源于超現實主義畫家薩爾瓦多·達利(Salvador Dali)和皮克斯出品動畫《機器人總動員》的主角瓦力(WALL-E)的名字組合。

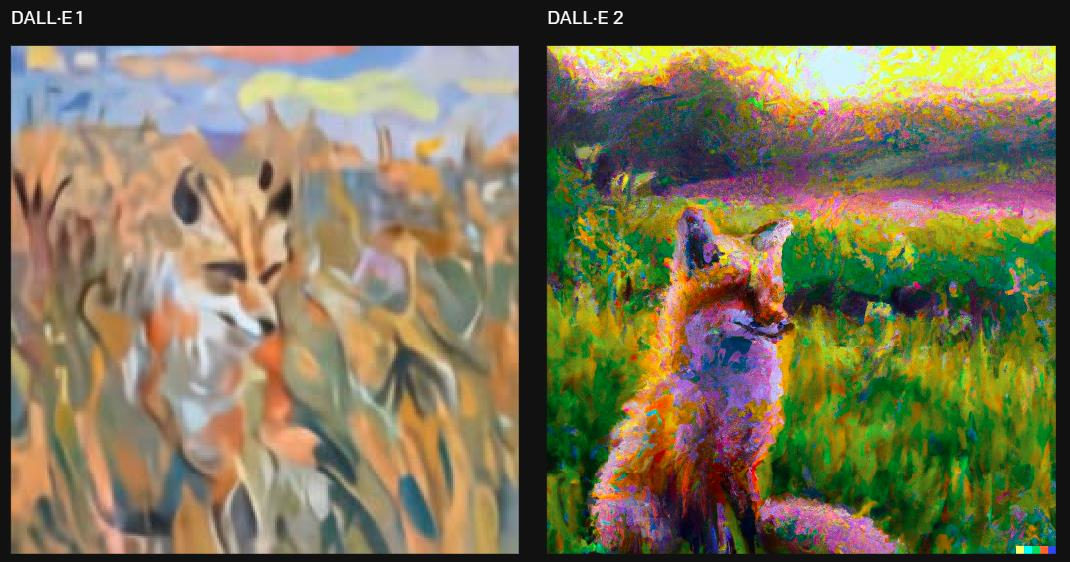

相較第一代DALL-E,DALL-E 2在精確度和寫實度上分別提升了71.7%和88.8%,在畫質上更是得到了質的飛躍。舉例來說,初代DALL·E圖片像素只有256×256,而DALL·E 2像素可達1024×1024,分辨率更勝一籌,延遲也變得更低。

就像同樣的文本描述“a painting of a fox sitting in a field at sunrise in the style of Claude Monet”(一幅狐貍在日出時坐在田野里的畫,莫奈風格),在兩代系統中生成的圖片表現就有明顯差異。直觀來看,左邊(DALL-E 1)像粗糙的卡通畫,而且糊作一團,右邊(DALL-E 2)的清晰度明顯提升,且真正有了油畫的質感。

圖源:OpenAI官網

而且,DALL-E 2還新增了兩個功能——“圖像修補”( inpainting)和“變體”(variations),可以用于編輯和潤色圖片。

“圖像修補”就是局部變更現有圖片中的一部分。具體來說,就是通過DALL·E 2用AI生成的圖像填充或替換圖片中的單個對象,同時和原圖無縫銜接,比如將沙發上的抱枕換成一只小狗,或在水池中放一只玩具鴨子。

圖源:OpenAI官網

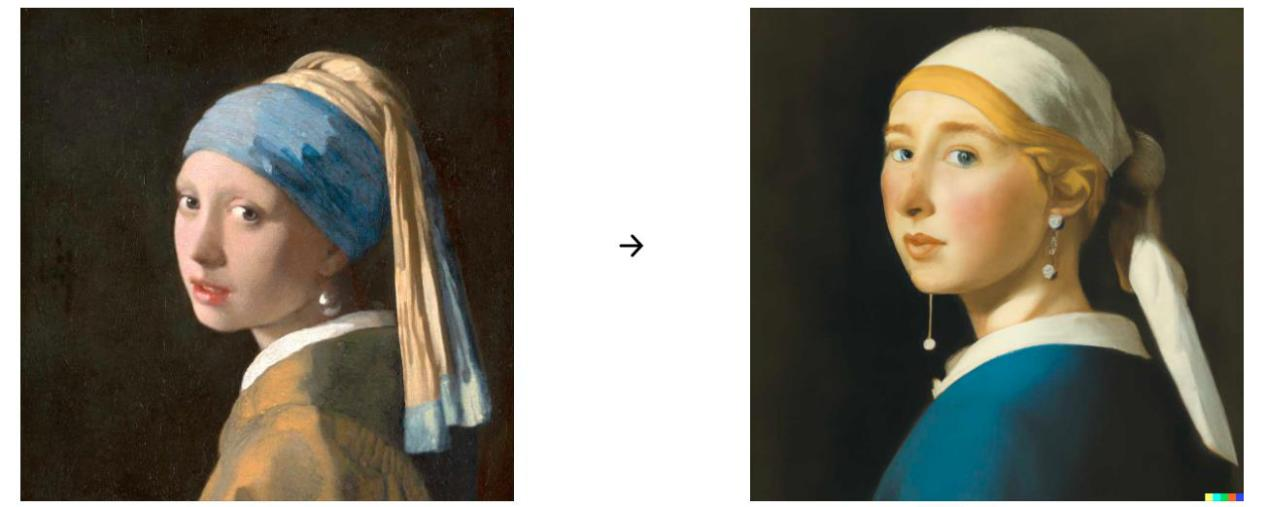

“變體”是指以一張圖像為藍本,重新創造出不同角度不同風格的新圖像。用戶可以在上傳一張原始圖片后對其進行各種風格變化,還可以將兩張圖片上的對象進行疊加生成新圖。

圖源:OpenAI官網

突破與挑戰:以假亂真的圖片是如何生成的

此次 Open AI 推出的新版本 DALL-E 2 是基于名為CLIP的計算機視覺系統而建立的。CLIP 接受了數億張圖像及其相關標題的訓練,了解給定文本片段與圖像的關聯程度。

值得關注的是,OpenAI通過對 CLIP 進行迭代,創建了“unCLIP”——一個基于描述并朝著圖像生成目標運行的新系統,同時將其用于 DALL-E 2。unCLIP可以部分完善 CLIP 的不足之處,即“人們可以通過給物體貼上一個表示其他東西的單詞,來誘使系統錯誤地識別所看到的內容”。

舉個例子,如果教給系統一個名稱錯誤的對象,比如一張標簽名稱是“汽車”的飛機圖片,那么之后當用戶想要生成“汽車”的圖像時,也許就會生成一張飛機的圖像。這個過程就像和一個學了錯詞的人交談一樣。在這一點上,unCLIP的表現要比 CLIP 出色得多。

同時,新系統支持擴散模型(Diffusion Models),這種程序會先從隨機點形成的圖案開始,一旦取得更具體的描述重點后,會漸近地轉變成圖片。其優勢在于可以生成高質量的合成圖像,尤其在與引導技術結合使用時,能夠在保真度上權衡多樣性。

不過,盡管文本生成圖片的相關研究一直在進步,但始終有不盡如人意的地方,就像DALL-E 2同樣會被其訓練中的盲區所限制。

比如,你在DALL-E 2中輸入通過學習圖像與正確標簽而理解的“猴子”,它會生成不少有意思的猴子圖像。但如果你輸入“吼猴”(howler monkey),同時它又沒學會“吼猴”是什么,不知道這其實是一個物種名稱。那么DALL-E 2會給你它所認為的最優結果——一只在大吼大叫的猴子。就目前來看,DALL-E 2的潛力和局限同樣突出、同樣清晰。

技術需要深究,人性不可窺探

有意思的是,一直以來,Open AI 都沒有完整公開過 DALL-E 的模型。目前,用戶可在其官網注冊賬號后預覽該工具。相關研究人員只表示,希望繼續進行分階段的過程,以便能安全地發布這項技術。

盡管 DALL-E 2 的造物令人眼花繚亂,但很多人已覺察到這項技術背后的隱憂。姑且不論算法自誕生以來就飽受詬病的偏見問題,光是其幾可亂真的圖片質量就可以讓人心生忌憚。就像亞利桑那州立大學計算機科學教授蘇巴拉所說:“你可以用它來做好事,但你肯定可以用它來做更加瘋狂的事情,包括深度偽造的照片和視頻。”

如同當初GPT-3被質疑用來生產假新聞一樣,DALL-E 2這樣的圖片生成工具也有可能遭到濫用。如果人人都可以不費力地輸出大量毫無違和感的假照片時,人人自危還會遠嗎?毫無疑問,“人們將不得不對他們在網上看到的幾乎所有東西持懷疑態度。”

關于DALL-E 2的外媒報道下,有讀者一針見血地指出:“如果這件事公開,最明智的做法是完全脫離網絡和電視,避免與那些想告訴你在網絡上看到什么東西的人有任何接觸。如果未來全息影像成為主流,那么我們將為子孫后代創造一個反烏托邦式的地獄。”

對此,OpenAI也有了預判并表示,其將在持續構建 DALL-E 的同時利用保護性的策略來應對圖像偏見及錯誤信息等潛在問題。這些措施包括:

DALL-E 2生成的圖片會有一個水印,標志其來自人工智能。

DALL-E 2 是基于篩選掉不良材料后的數據所訓練出來的。理想情況下已限制了其產生有害內容的能力。

反濫用功能,使DALL-E 2不能通過名字隨意生成可被識別的人物面孔。

用戶不得在該工具“上傳或生成仇恨符號、裸體、淫穢手勢及與正在發生的重大地緣政治事件有關的陰謀或評論”。

用戶需說明人工智能為生成圖像所做的變化,且不能借由軟件及網站將生成的圖像給到其他人。

雖然不知成效如何,但至少DALL-E 2現在還被鎖于“深匣”之中。當然,需要承認的是,DALL-E 2 強大的能力允許人們通過以前完全無法實現的方式用圖像表達自己,在此之前,沒人知道“長的像牛油果的椅子”“彈吉他的北極熊”“達利風格的空中花園”“留著莫西干頭的蒙娜麗莎”是什么樣,如今DALL-E2卻讓這一切都以逼近現實的方法呈現在大眾眼前。同時,DALL-E 2也幫助人們明白,一個復雜的人工智能系統如何觀察和了解我們的世界,對于研發一個有用且安全的AI,這一點至關重要。

參考鏈接:

?? https://openai.com/dall-e-2/??

?? https://www.assemblyai.com/blog/how-dall-e-2-actually-works/??

?? https://www.bilibili.com/video/BV1L3411n7nd?spm_id_from=333.337.search-card.all.click??