語音合成模型Uni-TTS升級:一音色多語言,高保真高效率

日前,微軟發布最新 Azure 神經網絡語音合成技術Uni-TTSv3多語言語音合成模型。與上一代語音合成模型相比,Uni-TTSv3語音合成保真度更高、速度更快、訓練時間更短,更降本增效。借助Uni-TTSv3,微軟升級美語合成女聲 Jenny。全新升級的Jenny Multilingual Neural,擁有跨語言能力,支持14個國家和地區的語言。此外,基于Uni-TTSv3而構建的深度神經網絡定制語音服務,也擴展了跨語言定制服務功能,客戶只需提供一個語言的錄音數據作為語料,即可訓練定制模型同時說多個語言。

隨著技術不斷迭代,微軟智能語音性能已能媲美真人,并支持超過110個國家和地區的語言,提供超過270個神經網絡聲音。為進一步拓寬語音使用場景,滿足各行業客戶的多元化需求,微軟智能語音也在不斷探索新的服務和能力:

l 跨語種語音技術需求:僅用一個音色就能生成同時覆蓋全球用戶的多語言應用需求,譬如在虛擬游戲中創建具有多語言能力的 NPC (Non-Player Character ,非玩家角色),在智能客服等場景中使用多種語言與用戶交談,提升用戶體驗。

l 穩定高效的平臺需求:使語音模型更加魯棒(robust,系統穩定性),即使在定制服務場景中,也可以不受外界環境影響,穩定、高效的處理不同類型的訓練數據。

新一代神經網絡語音合成技術Uni-TTSv3的提出,旨在解決上述訴求并完善如下功能:

保真度高

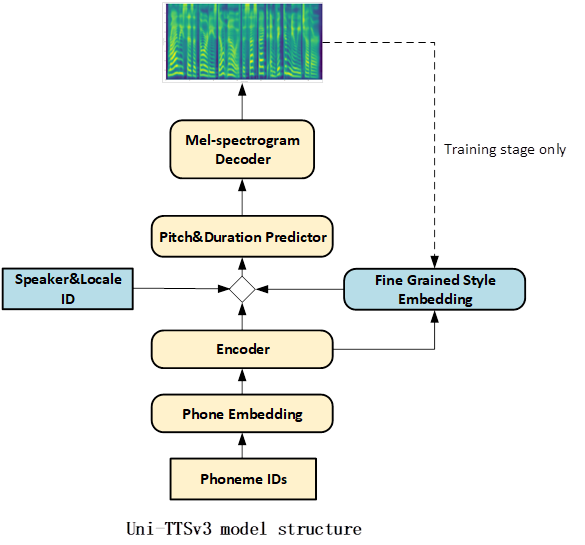

Uni-TTSv3是非自回歸語音合成模型,基于FastSpeech 2(快速高質量語音合成模型) 構建,通過直接使用真實語音進行訓練,并引入更多有關語速、語調、重音模式等語音變化信息,提高合成語音質量。經行業公認的、專業評估語音自然度的 MOS(Mean Opinion Score平均意見評分)評測結果顯示,智能合成女聲Jenny Multilingual Neural 的各語種語音平均評分達到 4.2 分以上(總分5分),語音保真度高。

Uni-TTSv3模型結構圖

多語言通用

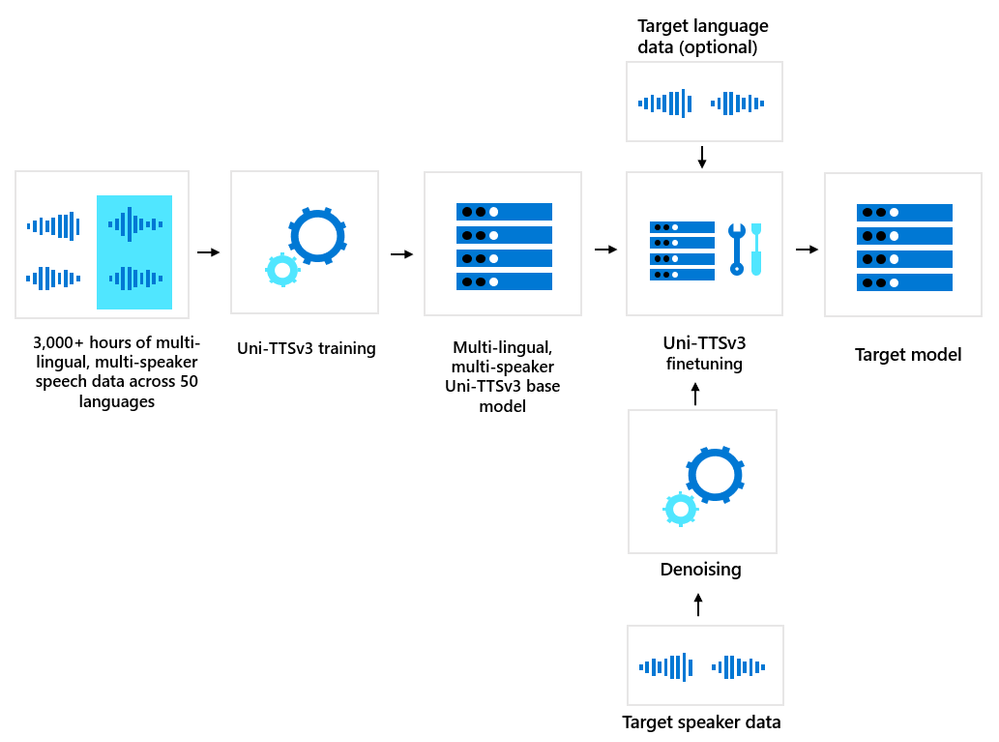

Uni-TTSv3是強大的多語言語音模型,在多語言和多說話人數據集上訓練。Uni-TTSv3通過訓練來自50多個不同地域和口音的發音人在不同場景下錄制的超過 3,000個小時的語音數據,構建多語言通用基礎語音模型,確保 AI 語音在語速、語調和重音模式等不變的情況下演繹多國語言。

訓練時間更短

Uni-TTSv3授權 Azure 語音合成平臺和自定義神經語音支持多語種語音。借助Uni-TTSv3升級自定義神經語音訓練管道,支持客戶用更短的訓練時間創建高質量的語音模型。與上一代語音合成模型相比,Uni-TTSv3調優過程簡單,尤其在聲學訓練部分, 訓練時間顯著減少 50% 左右,更加降本增效。

Uni-TTSv3 模型訓練示意圖

想即刻試用體驗Uni-TTSv3多語言語音合成模型嗎?想使用微軟 Azure 有聲內容制作平臺制作高質量合成語音嗎?請點此立即試用吧!