堪比LSTM,Transformer引燃機器學習圈:是萬能的

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

谷歌研究科學家 David Ha:Transformer 是新的 LSTM。

2017 年 6 月谷歌發布論文《Attention is All You Need》時,我們或許都沒有意識到它提出的 Transformer 架構將帶來多少驚喜。

在誕生至今不足四年的時間里,Transformer 不僅成為自然語言處理領域的主流模型(基于 Transformer 的預訓練語言模型成為主流),還開始了向其他領域的跨界,近幾個月來出現了大量將 Transformer 應用于計算機視覺領域的研究。

2020 年 10 月,谷歌提出了Vision Transformer (ViT),可以直接利用 transformer 對圖像進行分類,而不需要卷積網絡。ViT 模型取得了與當前最優卷積網絡相媲美的結果,但其訓練所需的計算資源大大減少。

2020 年 12 月,復旦、牛津、騰訊等機構的研究者提出了 SEgmentation TRansformer(SETR),將語義分割視為序列到序列的預測任務,該模型在 ADE20K 上排名第一,性能優于 OCNet、GCNet 等網絡。

2021 年 1 月初,OpenAI 又連放大招,用 DALL·E 和 CLIP 打破了自然語言與視覺的次元壁。兩個模型都利用 Transformer 達到了很好的效果,前者可以基于本文直接生成圖像,后者則能完成圖像與文本類別的匹配。

由此,「Transformer 是萬能的嗎?」成為了近期機器學習社區的熱門話題。谷歌大腦研究員 David Ha 發推表示:Transformer 是新的 LSTM。

他否定了自己在 2017 年 5 月發表的言論:「LSTM 就像神經網絡中的 AK47。不管我們多么努力地想用新事物取代它,都是白費力氣。從現在起它還將應用 50 年。」LSTM 由 Sepp Hochreiter 和 Jürgen Schmidhuber 于 1997 年聯合提出,當時已誕生 20 年。

David Ha 不會想到,這句預言被一個月后出現的 Transformer 打破,而這僅用了 4 年時間。

著名機器學習資源網站 Papers with Code 在 1 月 20 日發布的 Newsletter 中列舉了近期應用 Transformer 的十大新任務:

圖像合成

論文:Taming Transformers for High-Resolution Image Synthesis

鏈接:https://arxiv.org/pdf/2012.09841v1.pdf

多目標追蹤

論文:TransTrack: Multiple-Object Tracking with Transformer

鏈接:https://arxiv.org/pdf/2012.15460v1.pdf

音樂生成

論文:Compound Word Transformer: Learning to Compose Full-Song Music over Dynamic Directed Hypergraphs

鏈接:https://arxiv.org/pdf/2101.02402v1.pdf

舞蹈生成

論文:Dance Revolution: Long-Term Dance Generation with Music via Curriculum Learning

鏈接:https://arxiv.org/pdf/2006.06119v5.pdf

3D 目標檢測

論文:Self-Attention Based Context-Aware 3D Object Detection

鏈接:https://arxiv.org/pdf/2101.02672v1.pdf

點云處理

論文:PCT: Point Cloud Transformer

鏈接:https://arxiv.org/pdf/2012.09688v1.pdf

時序預測

論文:Temporal Fusion Transformers for Interpretable Multi-horizon Time Series Forecasting

鏈接:https://arxiv.org/pdf/1912.09363v3.pdf

視覺 - 語言建模

論文:VinVL: Making Visual Representations Matter in Vision-Language Models

鏈接:https://arxiv.org/pdf/2101.00529v1.pdf

車道形狀預測

論文:End-to-end Lane Shape Prediction with Transformers

鏈接:https://arxiv.org/pdf/2011.04233v2.pdf

端到端目標檢測

論文:Deformable DETR: Deformable Transformers for End-to-End Object Detection

鏈接:https://arxiv.org/pdf/2010.04159v2.pdf

而除了 David Ha 以外,另一位研究者英偉達研究科學家、前 OpenAI 研究科學家 Ankur Handa 也表示「Transformers are all you need」:

... is All You Need?

Transformer 引領了不止一種潮流。

在其論文《Attention is All You Need》發表后,各種「** is All You Need」論文紛紛出現。就連 LSTM 提出者 Sepp Hochreiter 也寫過一篇《Hopfield Networks is All You Need》。有趣的是,這篇論文正是對 Transformer 核心注意力機制新穎性的駁斥:Transformer 中的注意力機制等價于 Hopfield 網絡中的更新規則。

Transformer 的強大主要歸功于其中的注意力機制。注意力機制在 NLP 領域的應用最早可以追溯到 2014 年 Bengio 團隊將其引入神經機器翻譯任務,但那時模型的核心架構還是 RNN。相比之下,Transformer 完全拋棄了傳統的 CNN 和 RNN,整個網絡結構完全由注意力機制組成,這種改變所帶來的效果提升也是顛覆性的。

然而,Sepp Hochreiter 等人在 2020 年 7 月發表的論文《Hopfield Networks is All You Need》中表示,Transformer 中的注意力機制其實等價于擴展到連續狀態的 modern Hopfield 網絡中的更新規則。

Sepp 這篇論文發表時,Transformer 的跨界之旅已經開始。2020 年 5 月,Facebook AI 推出了 首個將 Transformer 成功整合為檢測 pipeline 中心構建塊的目標檢測框架——Detection Transformer(DETR),用于目標檢測和全景分割。6 月,OpenAI 將基于 Transformer 的模型GPT-2 應用到圖像領域,用于圖像分類任務。

半年過去,越來越多的工作開始探索如何將 Transformer 應用于計算機視覺等其他領域,最近更是出現了「Transformers are all you need」、「Transformers are the new LSTMs」的說法。

Transformer 是新的 LSTM 嗎?

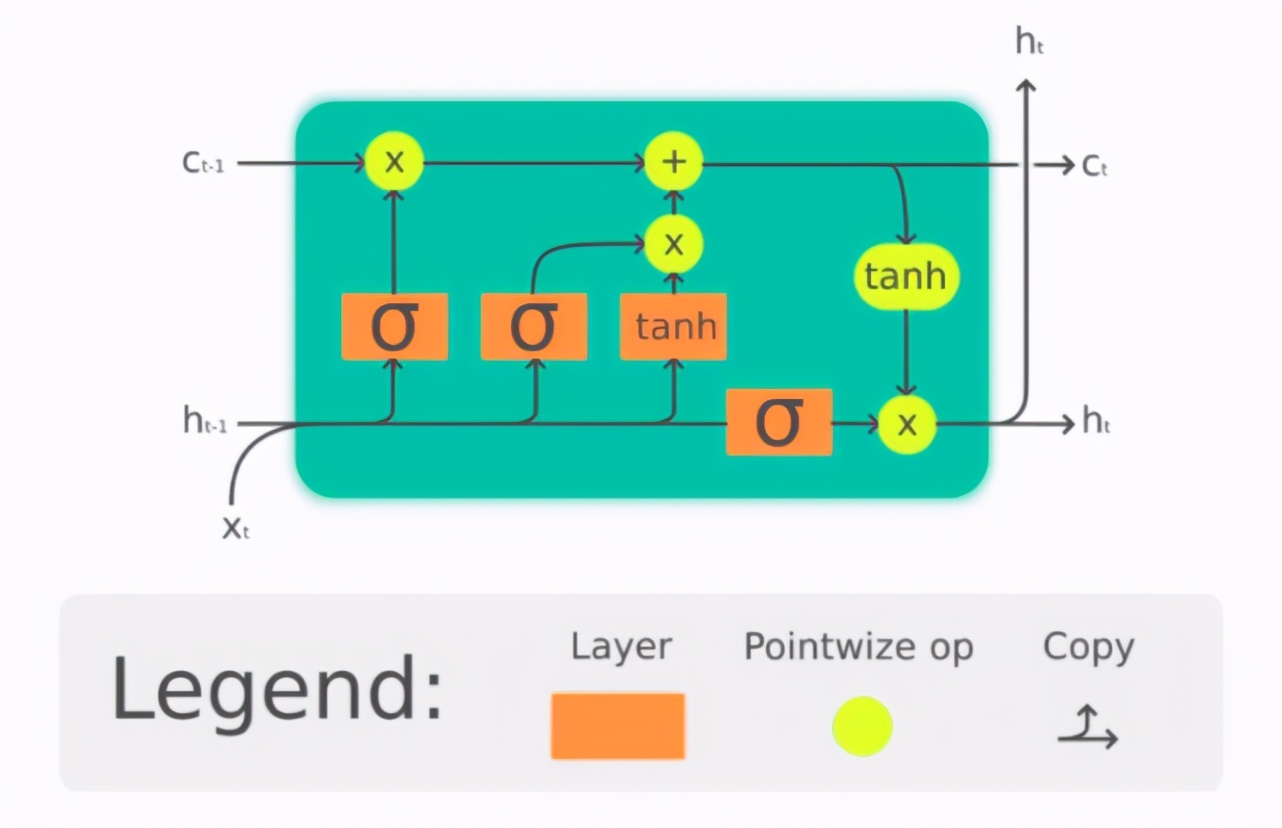

1997 年,Sepp Hochreiter 與 Jürgen Schmidhuber 聯合發表了長短期記憶網絡(LSTM)論文,被認為是機器學習發展史上的一座里程碑。

LSTM 是一種特殊的循環神經網絡(RNN)。Sepp Hochreiter 在 1991 年分析了隨時間反向傳播(BPTT)帶來的梯度爆炸和梯度消失問題;1997 年,Sepp Hochreiter 與 Jürgen Schmidhuber 在 LSTM 論文中引入 CEC 單元解決 BPTT 帶來的梯度爆炸和消失問題。之后又有許多研究者對其進行了改進和普及。

LSTM 單元的基本結構(圖源:https://en.wikipedia.org/wiki/Long_short-term_memory)

2020 年 2 月,LSTM 提出者 Jürgen Schmidhuber 撰文綜述了 LSTM 的十年發展史,介紹了它在機器翻譯、語音識別、機器人學、時序預測、聊天機器人等多個領域的應用。

而 Transformer 誕生伊始就完全舍棄了 RNN,在 LSTM 占優勢的 NLP 領域逐漸站穩腳跟。現在,許多研究又將它應用于時序預測、音樂生成、圖像分類等跨界任務中。在 Papers with Code 最近發布的 Transformer 應用十大新任務中,過去都有著 LSTM 的活躍身影。

Transformer 是新的 LSTM 嗎?從模型應用領域的多樣性來看,這似乎已見雛形。

不知道如果現在發表「Transformer 無法被替代,還可以再用 50 年」的預言,多久之后會被打破。