谷歌用AI訓練“耳機線”,實現了觸摸屏大多數功能

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

谷歌在開發可穿戴設備上從未停歇,比如和李維斯合作推出的智能夾克衫Commuter Trucker。

衣服上的袖口加裝一塊傳感器,用戶可以通過藍牙鏈接與之進行交互。

可以通過雙擊、滑動等操作進行切歌等操作。

再接再厲,谷歌希望能夠把設備做的小一點,功能更豐富一點。

谷歌隨后盯上了耳機線。

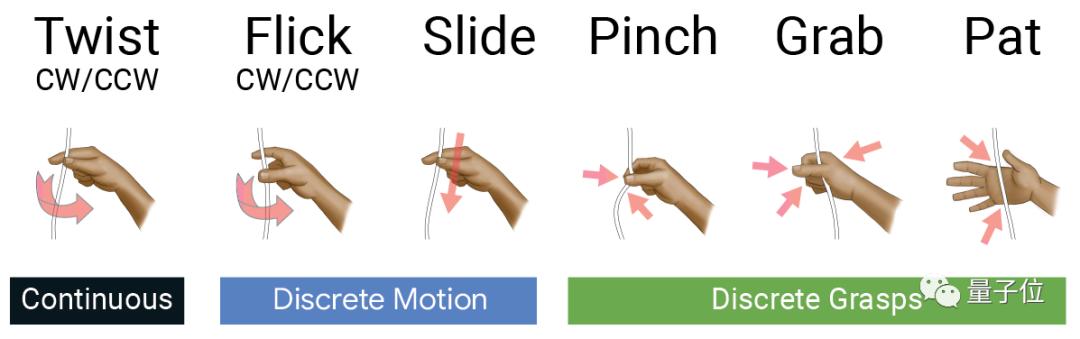

谷歌AI工程師開發了一款電子交互式編織物(E-Textile),可以讓人通過捏、搓、握、拍等手勢實現以往觸摸屏的大部分功能。

音量控制、切歌換歌等操作更是不在話下,谷歌的新功能指向的是下一步的感知交互,最終目的解放我們的雙手。

手勢數據集的訓練過程

谷歌開發的此款設備是機器學習算法和傳感器硬件的結合,而耳機線只是承載物。

實際上線不是普通的耳機線,是柔性電子材料,并且將傳感器編織進內,因此可以進行人機交互。

如果你喜歡,連帽衫也可以改造。

首先谷歌招募12名參與者進行數據采集,各做8個手勢,重復9次,共計864個實驗樣本。

為解決樣本量過小的弊端,研究者使用線性插值對每個手勢時間序列進行再采樣。

每個樣本提取16個特征,最終得到80個觀察結果。

每位用戶經過訓練的手勢識別可啟用8個新的離散手勢。

不僅有定量的數字,還有參與者的切身感受,研究者希望提供以人為本的交互體驗。

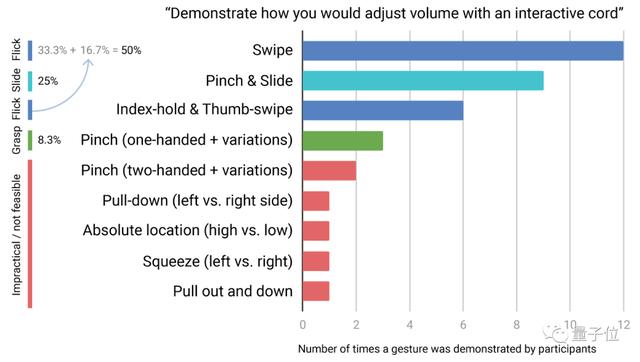

參與者還通過排名和評論提供了定性反饋,參與者還提出了多種交互方式,包括滑動、彈指、按壓、捏、拉、擠等。

定量分析結果表明,交互式編織品的感知速度比現有的耳機按鈕控件要快,并且速度可與觸摸屏媲美。

而定性反饋還表明,與耳機線控相比,電子紡織交互更受青睞。

考慮到不同的使用場景,研究者為不同的使用場景開發了不同的設備:

電子紡織USB-C耳機,用于控制手機上的媒體播放;帽衫抽繩,以無形地向衣服添加音樂控制。

算法對手勢的精準識別

谷歌能做出電子編織物,難點并不在于機器學習的算法,而在于如何在耳機線上進行手勢捕捉和交互。

耳機線等編織物出于體積考慮,無法安裝大型和眾多的傳感器,感知和分辨能力非常受限。

其次是人手姿態的曖昧性和多義性,比如捏和抓到底怎么區分,拍擊和上拉怎么分辨?

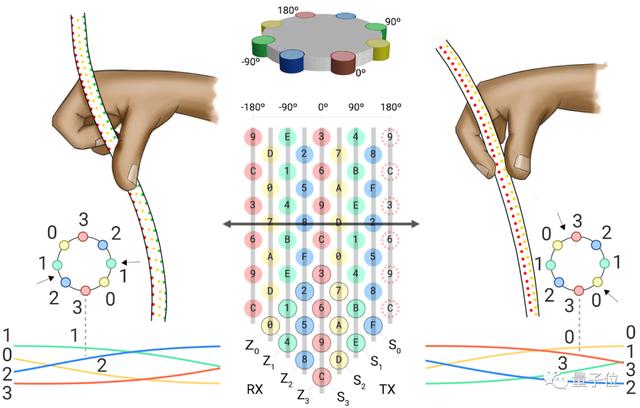

谷歌工程師用8個電極組成傳感器矩陣,對數據集進行劃分為8次為訓練數據,1次為測試數據,得到9個手勢的變換。

他們發現傳感矩陣中存在固有關系,非常適合機器學習分類算法,這使得分類算法可以運用有限數據集進行訓練,大約只需要30s,便可實現一個手勢識別。

最終準確率為93.8%,考慮到他們所使用的數據集規模和訓練時間,這個精度足夠日常使用了。

耳機操控的下一步

谷歌此次對耳機線的訓練,涉及手勢姿態識別和微觀互動兩個內容。

在觸摸屏設備上,屏幕下方空間可容納眾多傳感器,比如蘋果的3D Touch識別模塊。

但在諸如耳機線等體外設備上,可能就沒有這么輕松了,因為傳感器數量和體積要受到限制。

實驗過程中,工程師們發現需要對多種手勢的多次訓練,而且不同個體手勢需要多次捕捉動作。

這項研究顯示了一種可以在一個緊湊的外形尺寸物體中實現精確的小規模運動可能,我們可以期待智能可交互編織物的發展。

有一天。可穿戴式界面和智能織物的微交互可以任意使用,最終讓體外設備如影隨形,隨時交互,最終解放我們的雙手。

你期待這一天嗎?