華人持續炸場!8倍于SOTA模型發布,超分辨率細節還原度逆天,終于可以看清楚蜘蛛網絲了! 原創

撰稿 | 言征

出品 | 51CTO技術棧(微信號:blog51cto)

Sora帶火了“視頻一致性”的研究,但單純在時間一致性已經不能滿足業內對于高逼真視頻的渴望。這不,華人又出來炸場了!

近日,一個名為VideoGigaGAN的視頻模型在業界走紅。超分辨率電影鏡頭,不用等Sora了!

圖片

圖片

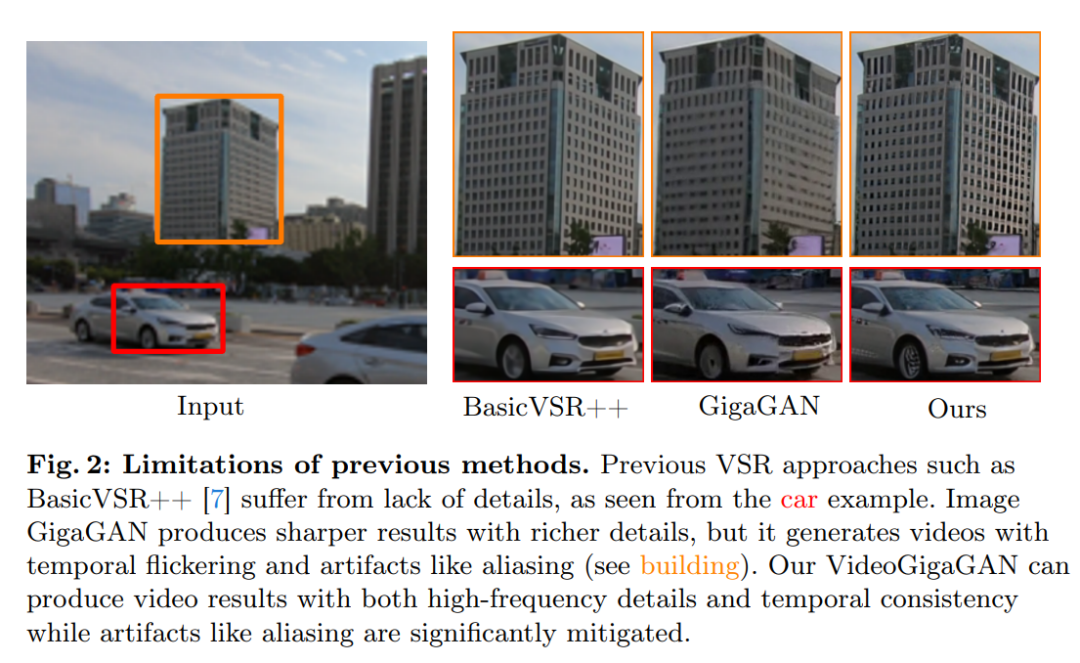

據介紹,目前VSR(視頻超分辨率)領域有兩大難題:一個挑戰是保持輸出幀之間的時間一致性。第二個挑戰是在上采樣幀中生成高頻細節。這篇論文主要的就是第二個問題。針對這個問題,GAN(生成式對抗網絡)似乎再一次被驗證而來有效性。

1.讓模糊視頻還原逼真細節,8倍于SOTA

舉個汽車識別的例子,以前的VSR方法,比如BasicVSR++等都缺乏細節,而ImageGigaGAN可以通過更豐富的細節產生更清晰的效果,但它生成的視頻存在時間閃爍和混疊等偽影(注意視頻中的建筑畫面)。

而新提出的VideoGigaGAN方法則可以生成兼具高頻細節和時間一致性的視頻結果,同時顯著減輕了像混疊偽影的問題。

圖片

圖片

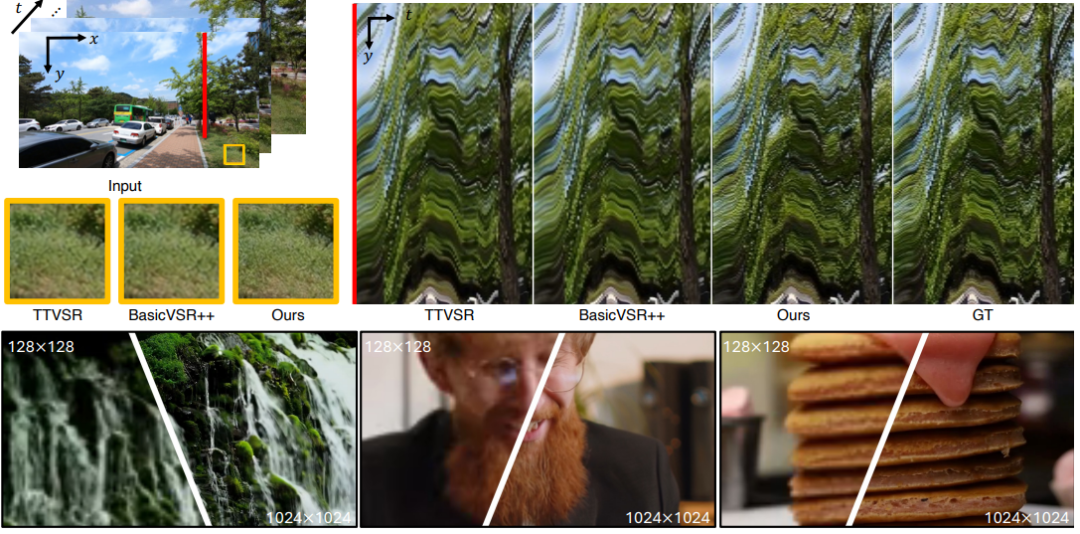

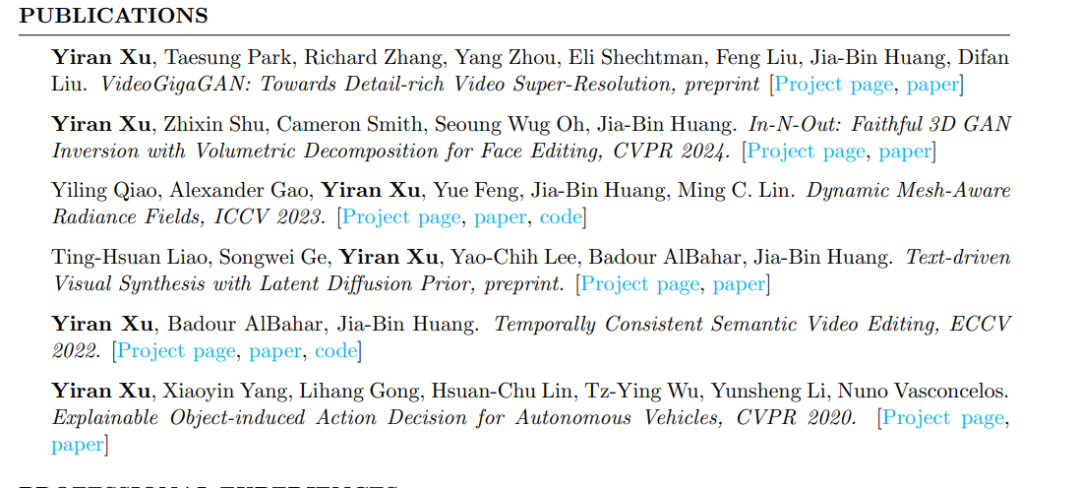

VideoGigaGAN是一種生成式視頻超分辨率模型,該模型能夠在保持時間一致性的同時,對視頻進行高頻細節的超采樣。與現有的VSR方法相比,VideoGigaGAN能夠生成具有更多細粒度外觀細節的時間一致性視頻。

研究顯示,VideoGigaGAN在公共數據集上非常有效,并展示了超過目前最先進的VSR模型8倍超分辨率的視頻結果。

圖片

圖片

先亮出幾個對比視頻,相信你都不敢相信自己的眼睛:視頻黑科技就是如此震撼!

見證奇跡的時刻到了——

研究團隊放出了一張金針菇涮鍋的視頻對比,題外話:Xu本人也是一名Cooking愛好者。

大家應該還記得之前類Sora工具放出的飛鳥視頻,從書上飛起后,總是會有一層虛影,這個問題已經被VideoGigaGAN解決掉了。

動物世界非常精彩,但如果你看不清楚蜘蛛背后的網絲,“小花貓”跟繩子之間是如何互動的,多少損失一些鏡頭的美感。

2.怎么做到的?答案藏在模型細節

接下來,我們看下這個模型的厲害之處。

圖片

圖片

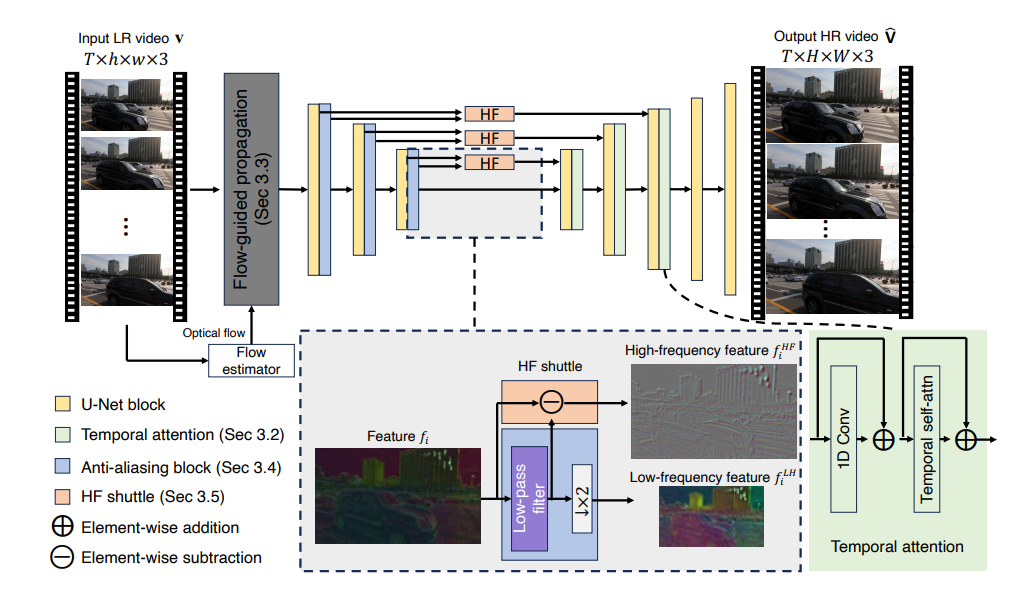

首先,該視頻超分辨率(VSR)模型建立在圖像的不對稱U-Net架構的GigaGAN上采樣器之上。

其次,為了增強時間一致性,團隊通過將時間注意力層添加到解碼器塊,將圖像采樣放大為視頻采樣器。

然后,另外一個秘訣,就是通過整合流導向傳播模塊的特征來增強一致性。

接下來,為了抑制混疊偽影,團隊使用編碼器下采樣層中的抗鋸齒塊(Anti-aliasing)。

最后,Xu等通過跳層連接直接將高頻特征傳遞到解碼器層,以補償BlurPool過程中損失的細節。

這里值得注意的一點:因為時間注意力的空間窗口大小有限。所以,Xu等團隊將流導向特征傳播引入到放大的GigaGAN中,以便基于流信息更好地對齊不同幀的特征。

其次,還有抗混疊的技術處理,也進一步減輕了GigaGAN編碼器中的下采樣塊引起的時間閃爍,同時通過將高頻特征直接傳輸到解碼器塊來保持高頻細節。

當然,這些想法也被最后的實驗結果驗證了。所以說,這些模型設計選擇非常重要。

3.背后的一作:愛Cook的Xu yiyan

沒錯,本篇研究成果的一作 Xuyiyan(許姓)又是一位中國學者,本科畢業于華南理工大學,現在是美國馬里蘭大學帕克學院的博士生。Xu目前在主要研究方向包括生成模型及其應用,據悉他也做過自動駕駛領域的場景理解的研究。

圖片

圖片

圖片

圖片

正如前文所說,Xu的個人愛好蠻特別:攝影、徒步旅行、做飯。

圖片

圖片

4.網友熱議:質量不錯,時長太短了我們需要200幀的(至少9秒)

鏡頭時長問題的研究成重點,HN上一位用戶評論道:“視頻質量看起來不錯,但局限性很大。我們的模型在處理極長視頻(例如200幀或更多)時遇到了挑戰。”所以他認為,要用于實際環境,還需要進行更多的研究。

對此還有網友亮出了類似的觀點:“在某種程度上,我會強迫性地計算鏡頭的秒數,知道一個節目/電影有幾個鏡頭超過9秒,并且能夠贏得我們的信任,我才可以放手了。”

據另一位Hackernews用戶評論,現代電影的平均鏡頭長度約為2.5秒,對于動畫來說大約是15秒。而此項研究中的30fps的幀率并不夠,意味著時間將少于7秒。

總之,大家非常期待如果該篇論文能夠擴展到200幀后的結果。

5.One More Thing:別忘了打上AI標簽

此外,此次研究成果的發布也再一次引起了AI被濫用的擔憂。“這對于娛樂來說非常有用,但過于逼真清晰的畫面依然有可能被用作任何類型的‘證據’,而大家對于這些幻覺的細節的工作原理并不知曉,所以此類視頻還是需要進行顯眼的標記。”不過清醒的是,目前智能手機上已經有不少軟件或視頻/攝影功能已經在使用專有算法來“推斷”是否存在虛假的細節,而且檢查規模會更大。不過,回到本篇研究,最有意思的,還是神奇的還原細節的能力。想想電視和電影中的許多畫面,尤其十年前的珍貴影響,有了這項技術,“增強”低分辨率圖像使其變得清晰,將不再是一件難事!

本文轉載自 ??51CTO技術棧??,作者:言征