大模型前置處理之——特征提取 原創

“ 特征提取是機器學習模型中的重要前置環境,特征提取的效果直接影響到模型的性能 ”

在學習大模型技術的過程中,每個人應該都聽過特征提取;但大部分人可能并不了解什么是特征提取,以及特征提取的方法和作用。

所以,今天我們就來介紹一下大模型的前置處理——特征提取。

特征提取

背景

有很多人認為,特征提取是由神經網絡發展而來;但事實上,在機器學習發展之出,甚至可以說在人工智能技術發展之初,特征提取就已經出現了,只不過因為那時人工智能的影響范圍還比較小,除了業內人員之外,大部分人都不了解這個事情。

特征提取的大范圍應用應該是從機器學習開始,只不過當時受限于技術條件;那時的機器學習模型還不能自動提取特征,因此那時的特征提取都是由研究人員進行人工抽取。

但隨著技術的發展,特別是深度學習和神經網絡技術的發展;神經網絡可以通過自身的編碼器-Encoder自動進行特征提取;這樣的優點就在于由神經網絡自身提取的數據特征更加符合當前的神經網絡模型;但同樣的缺點就是,神經網絡的設計和編碼器的設計會直接影響到特征提取的效果。

特征工程

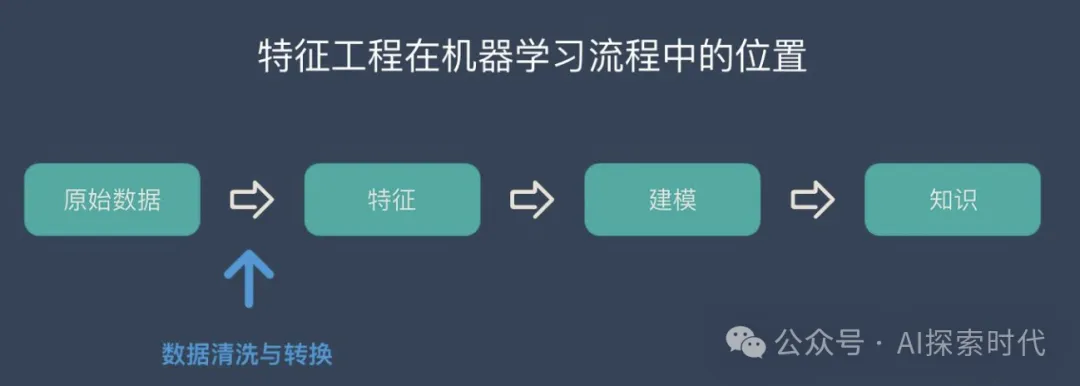

特征工程是使用專業背景知識和技巧處理數據,使得特征能在機器學習算法中發揮更好作用的過程;特征工程的好壞直接影響到模型的學習效果。

特征工程是機器學習中至關重要的一步,它涉及將原始數據轉換為適合機器學習模型的特征(也稱為變量或屬性)。好的特征工程可以顯著提高模型性能,因為它能夠揭示數據中的有用信息,降低噪音影響,甚至幫助模型更好地泛化到新數據。

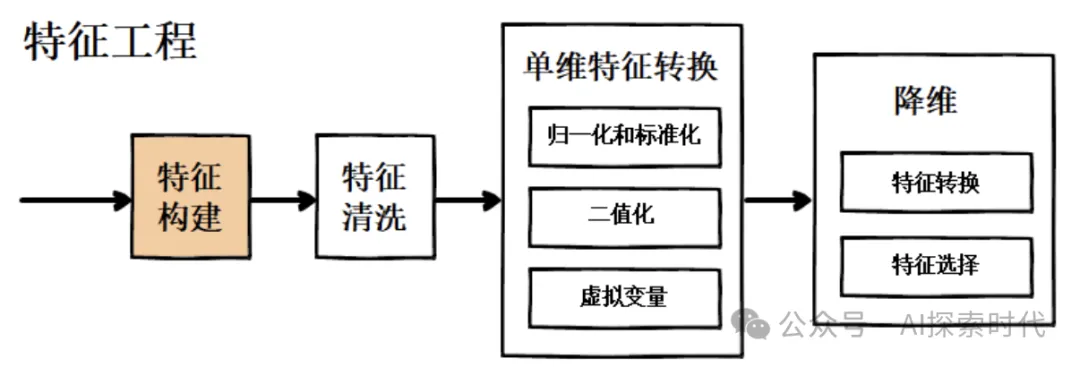

特征工程主要包含以下幾個方面:

- 特征抽取

- 特征預處理

- 特征降維

以下是特征工程的一些常見方法和技巧:

- 特征選擇(Feature Selection):從原始特征集中選擇最相關、最有用的特征,以降低模型的復雜性和過擬合風險。

- 特征提取(Feature Extraction):通過數學變換,將原始特征轉換為更具信息量的特征,例如主成分分析(PCA)、獨立成分分析(ICA)等。

- 特征轉換(Feature Transformation):對原始特征進行變換,以使其更適合模型,如對數、指數、歸一化、標準化等。

- 多項式特征擴展(Polynomial Feature Expansion):將原始特征的多項式組合添加到特征集中,以捕獲特征之間的非線性關系。

- 時間序列特征處理:針對時間序列數據,可以提取滯后特征(lag features)、移動平均、指數加權移動平均等。

- 文本特征處理:對文本數據進行詞袋模型(Bag-of-Words)、TF-IDF(Term Frequency-Inverse Document Frequency)處理,或者使用詞嵌入(Word Embeddings)等技術。

- 類別特征編碼:將類別型特征轉換為數值型特征,例如獨熱編碼(One-Hot Encoding)、標簽編碼(Label Encoding)等。

- 缺失值處理:處理缺失值的方法包括刪除含有缺失值的樣本、填充缺失值、使用模型預測缺失值等。

- 特征交互與組合:通過對特征進行交互、組合,創建新的特征來捕獲更高級的信息。

- 數據降維:使用降維技術(如PCA)減少數據維度,以減少計算復雜性和噪音的影響。

- 領域知識引導:利用領域專業知識來設計和選擇特征,以更好地捕獲問題的本質。

在進行特征工程時,需要注意以下幾點:

- 理解數據:深入了解數據的含義、結構和背景,以便做出更明智的特征工程決策。

- 避免過擬合:特征工程可能導致過擬合問題,因此需要謹慎選擇和處理特征。

- 實驗和迭代:嘗試不同的特征工程方法,并使用交叉驗證等技術來評估模型性能,以確定哪些方法有效。

- 自動化:一些自動化特征選擇和提取工具可以幫助你快速嘗試不同的特征工程技術。

總之,特征工程是機器學習中一個關鍵且有創造性的階段,它能夠顯著影響模型的性能和泛化能力。

本文轉載自公眾號AI探索時代 作者:DFires