微軟發布LLM2CLIP:一種新型AI技術,LLM成為CLIP視覺編碼器的“老師” 原創 精華

01、概述

在當今的人工智能研究領域,跨模態學習正逐漸成為一個熱門話題,尤其是在視覺和文本的結合上。其中,CLIP(Contrastive Language-Image Pre-training)模型作為一個重要的基礎模型,憑借其在視覺和文本信號之間的深度聯系,已經成為多模態學習領域的佼佼者。通過對大規模圖像-文本對進行對比學習,CLIP能夠同時理解圖片和文本,并在零-shot任務中表現出色,支持圖像分類、檢測、分割、以及圖像-文本檢索等任務。

然而,盡管CLIP在眾多任務中表現優異,它也有自己的短板,尤其是在處理復雜、長文本描述時常常力不從心。隨著大規模語言模型(LLM)的快速發展,它們在文本理解和生成方面的強大能力為CLIP帶來了新的突破。在這篇文章中,我們將深入探討如何將LLM與CLIP結合,通過創新的訓練方法提升視覺表示學習的性能,進一步推動跨模態學習的發展。

02、CLIP的優勢與挑戰

CLIP自誕生以來,憑借其創新的多模態訓練方法,已經在多個領域取得了顯著的成果。CLIP通過將視覺和文本信號映射到同一個特征空間,能夠很好地完成圖像-文本配對、圖像理解、以及文本到圖像/視頻生成等任務。它的強大之處在于,它并不依賴于傳統的視覺編碼器,而是通過大量的網絡數據和詳細的文本描述進行訓練,使得它能夠捕捉到更多的“人類知識”。

然而,CLIP在面對復雜的長文本描述時,常常表現不佳。這是因為原始CLIP的文本編碼器未能很好地處理長文本的語義關系,尤其是當文本包含多層次或復雜的描述時,CLIP的表現往往不盡如人意。

LLM與CLIP的結合:挑戰與機遇

近年來,隨著大規模語言模型(LLM)的崛起,尤其是像GPT系列、Llama等語言模型的出現,CLIP的短板逐漸顯現出了解決的可能性。LLM在語言理解、生成以及跨文本任務中的卓越能力,使其成為增強CLIP文本處理能力的理想候選。然而,將LLM與CLIP結合并非易事,主要原因在于CLIP的文本編碼器本身的限制。

研究表明,直接將LLM整合進CLIP,往往會導致性能下降。這是因為LLM與CLIP的原始設計并不完全兼容。為了突破這一局限,研究人員提出了一種創新方法——LLM2CLIP。這一方法通過替換CLIP的文本編碼器,并用LLM增強CLIP的視覺編碼器,以期更好地將文本與圖像結合,提升整體性能。

03、LLM2CLIP:創新性的多模態訓練方法

為了應對CLIP在處理長文本時的不足,復旦大學和微軟的研究人員提出了LLM2CLIP這一新方法。該方法通過替換CLIP的原始文本編碼器,將LLM的強大知識引入到CLIP模型中,從而實現視覺和文本信息的更好融合。

關鍵創新:替換文本編碼器與對比訓練

LLM2CLIP的核心創新之一是直接替換CLIP的文本編碼器。傳統上,CLIP的文本編碼器并未能很好地處理長文本的復雜性,而LLM則通過其強大的語言模型能力,能夠更清晰地理解長文本中的細節和語義。這一替換使得CLIP在處理復雜文本時能夠更加高效,尤其在圖像-文本匹配任務中,表現得更加出色。

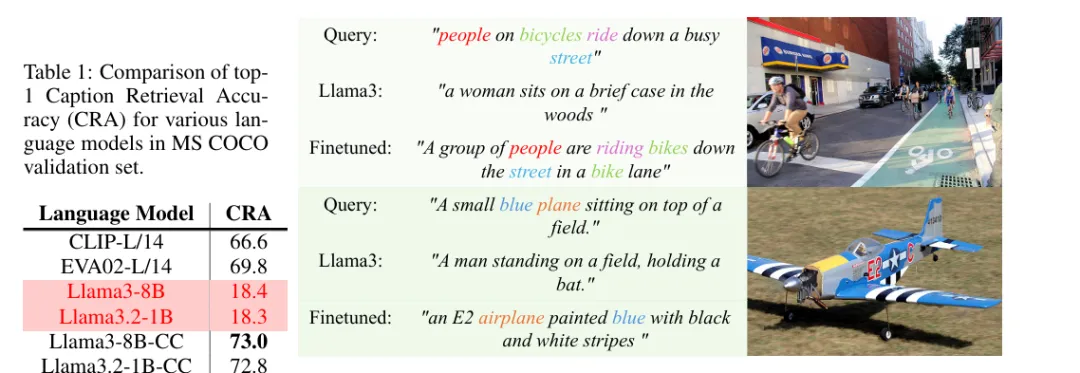

除此之外,LLM2CLIP還引入了一種名為“對比優化微調”(caption contrastive fine-tuning)的技術,幫助改進LLM對圖像描述的理解。通過這種方法,LLM的能力得到了顯著增強,不僅能夠更好地區分不同的圖像描述,還能將這些描述與圖像進行更加精準的匹配。

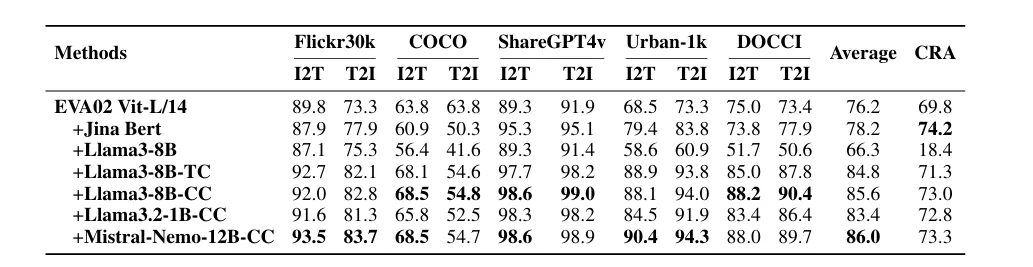

微調與數據集的使用

為了驗證LLM2CLIP的有效性,研究人員在多個數據集上進行了實驗。主要使用了CC-3M數據集,這是一組包含圖像和對應文本描述的大規模數據集。通過對該數據集的微調,LLM2CLIP在圖像-文本檢索任務中表現得比傳統的CLIP和EVA模型更為優越。

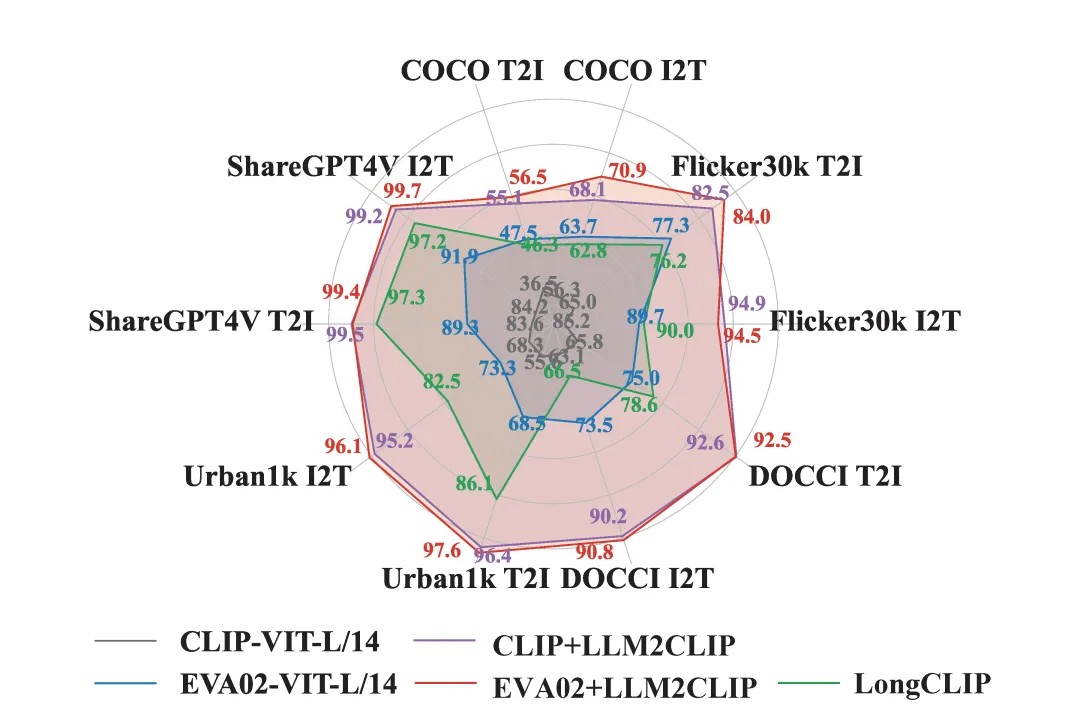

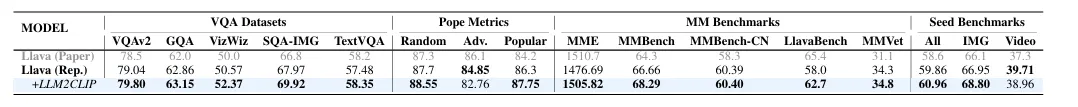

在實驗中,研究人員測試了不同大小的數據集對模型性能的影響。結果表明,使用增強后的圖像描述進行訓練,能夠有效提高性能。而當使用未經訓練的語言模型時,CLIP的表現反而變差。這也表明了微調的重要性。通過適當的數據增強和對比優化,LLM2CLIP在圖像-文本匹配任務中成功超越了現有的SOTA(State of the Art)模型,取得了16.5%的性能提升。

04、LLM2CLIP的全球化潛力

LLM2CLIP不僅僅是在單一語言環境下的突破。其跨語言能力的提升,使其在全球化應用中展現出巨大潛力。通過將LLM2CLIP與像Llava 1.5這樣的多語言模型結合,研究人員成功將CLIP從一個僅限于英語數據的模型,轉變為一個能夠在多種語言環境中表現優異的跨語種模型。

這一轉變為全球范圍內的圖像-文本檢索任務提供了強大的支持。無論是在不同語言的圖像描述之間進行匹配,還是跨語言的圖像生成,LLM2CLIP都能夠提供高效且準確的解決方案。

05、未來展望:更強大的多模態模型

LLM2CLIP的成功,不僅僅代表著一個單一模型的突破,它為多模態學習的發展指明了方向。通過結合強大的語言模型,CLIP能夠在處理復雜任務時獲得更好的表現,未來的研究可以在此基礎上進行更多的創新。

未來,研究人員可能會在數據集的選擇、訓練方式、以及LLM的微調策略上進行進一步優化。例如,使用Laion-2Band和Recaption-1B等更大的數據集,進一步提高LLM2CLIP的性能和表現。這不僅可以推動圖像-文本匹配的進步,還可以在文本到圖像的生成、視頻理解等領域取得更大的突破。

06、結語

LLM2CLIP的提出,標志著視覺與語言模型融合的新紀元。通過引入強大的大語言模型,LLM2CLIP有效解決了CLIP在處理復雜文本時的短板,提升了圖像-文本匹配任務的性能。未來,隨著更多創新技術的加入,LLM2CLIP將成為跨模態學習領域的重要基石,推動人工智能向更加智能化、更加精確的方向發展。

這項工作不僅為CLIP的訓練提供了新的思路,也為未來的多模態任務開辟了廣闊的前景。隨著大規模語言模型和視覺模型的不斷發展,跨模態學習將無疑成為人工智能的重要研究方向,而LLM2CLIP無疑是這一領域的重要里程碑。

參考:

本文轉載自公眾號Halo咯咯 作者:基咯咯