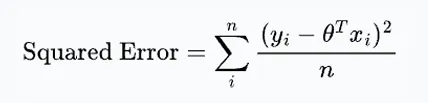

線性回歸中,為什么使用均方誤差損失函數(shù)?

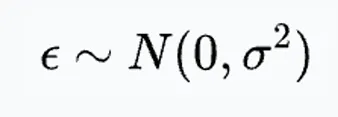

在線性回歸中,通常使用均方誤差作為損失函數(shù)。

但你知道為什么用它嗎?

要知道,很多函數(shù)都能衡量預(yù)測(cè)值和真實(shí)值之間的不同,在所有候選者中,均方誤差有什么特殊之處嗎?

據(jù)我所知,很多人都會(huì)回答:

1.均方誤差是可微的,所以才作為損失函數(shù)。->錯(cuò)

2.與絕對(duì)誤差相比,均方誤差對(duì)大的誤差懲罰更多 ->錯(cuò)

很遺憾,上述回答都是錯(cuò)的。

也許從概率視角出發(fā),可以幫助我們更好理解,為什么均方誤差更合適。

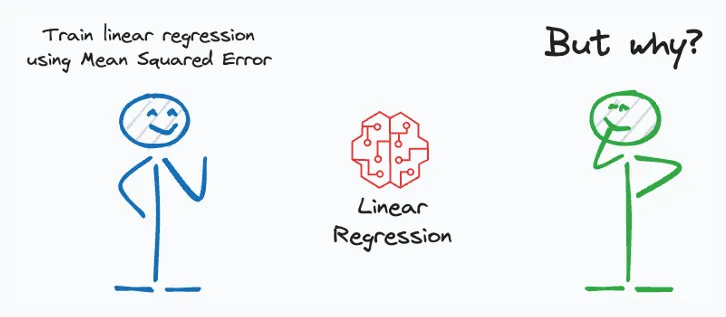

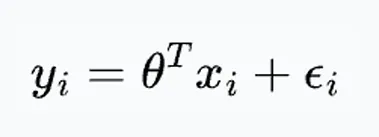

在線性回歸中,通過(guò)輸入X預(yù)測(cè)目標(biāo)變量y。

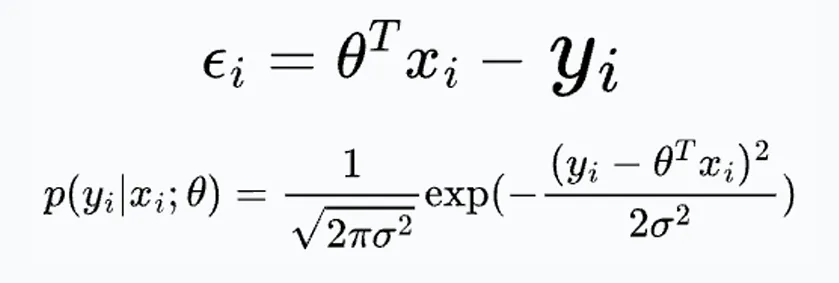

作為誤差項(xiàng),捕獲數(shù)據(jù)點(diǎn)i的隨機(jī)噪聲。

根據(jù)中心極限定理,假設(shè)噪聲服從均值為0的高斯分布。

誤差項(xiàng)的概率密度函數(shù)可以寫(xiě)成如下形式:

帶入線性回歸公式中的誤差項(xiàng):

上述公式表明,在某個(gè)參數(shù)下,觀察到數(shù)據(jù)點(diǎn)i的似然。

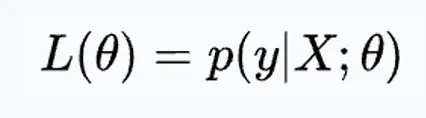

接下來(lái),我們可以定義似然函數(shù):

這意味著通過(guò)改變??,我們可以擬合一個(gè)分布到觀測(cè)數(shù)據(jù)并量化觀察到它的可能性。

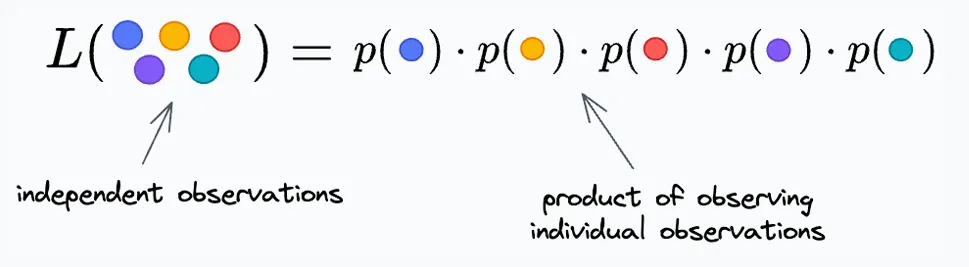

我們進(jìn)一步將其寫(xiě)成各個(gè)數(shù)據(jù)點(diǎn)的乘積,因?yàn)槲覀兗僭O(shè)所有觀測(cè)是獨(dú)立的。

因此,得到:

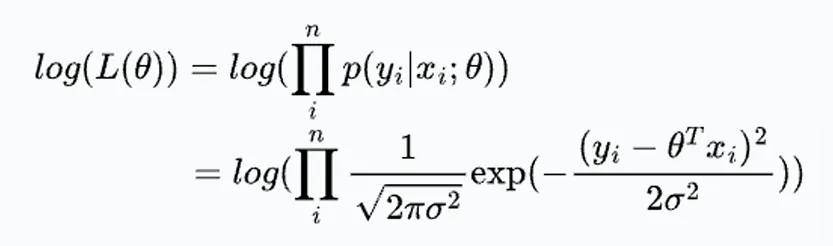

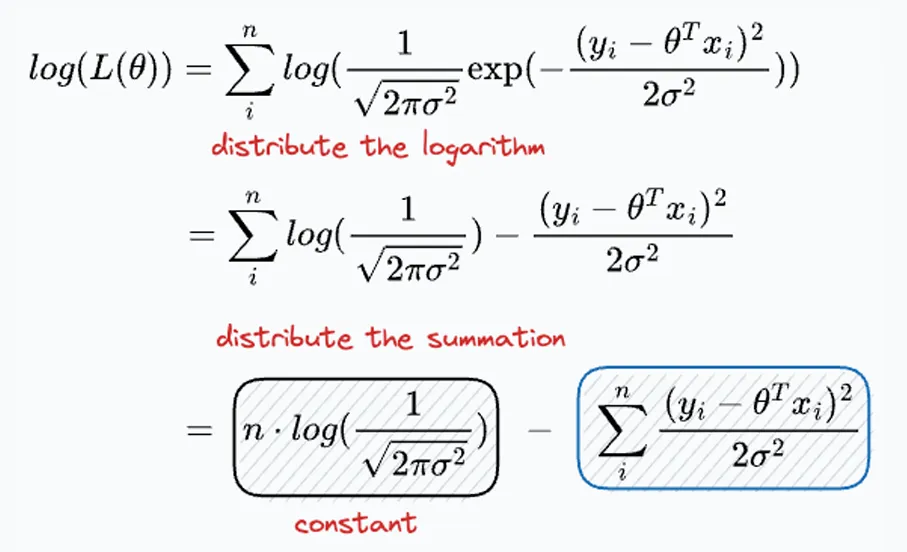

由于對(duì)數(shù)函數(shù)是單調(diào)的,我們使用對(duì)數(shù)似然并對(duì)其進(jìn)行最大化。這被稱為最大似然估計(jì)(MLE)。

簡(jiǎn)化后,得到:

重申一下,目標(biāo)是找到能夠最大化上述表達(dá)式的??。但是,第一個(gè)項(xiàng)與??無(wú)關(guān)。

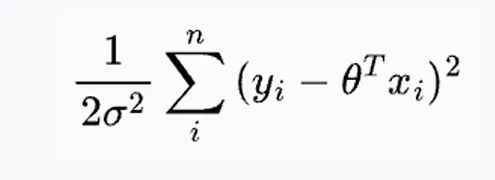

因此,最大化上述表達(dá)式等價(jià)于最小化第二個(gè)項(xiàng)。

如果你仔細(xì)觀察,這正是平方誤差。

因此,你可以通過(guò)最小化平方誤差來(lái)最大化對(duì)數(shù)似然。這就是在線性回歸中使用最小二乘法的起源。

可以看到,在線性回歸中使用平方誤差作為損失函數(shù)是有明確的證明和推理的。機(jī)器學(xué)習(xí)中的一切都不是憑空產(chǎn)生的。

本文轉(zhuǎn)載自公眾號(hào)人工智能大講堂

原文鏈接:??https://mp.weixin.qq.com/s/0-hO-91C_gVIYlnEjt-A6A??