開源大模型如何治理?斯坦福基礎模型研究中心給您支招 原創 精華

人工智能領域正經歷著范式轉變,基礎模型(如GPT - 4、LLAMA 2)處于核心位置,驅動著技術創新和大量投資。這引發了對其監管的廣泛需求。而在關于如何監管基礎模型的討論中,模型的發布過程至關重要。近日,由斯坦福大學基礎模型研究中心主任Percy Liang領導的論文《Considerations for Governing Open Foundation Models》發表在Science,對開源大模型治理與監管進行了深入探討,今天我們就一起學習一下這篇重要論文吧!

一、基礎模型的發布方式多樣

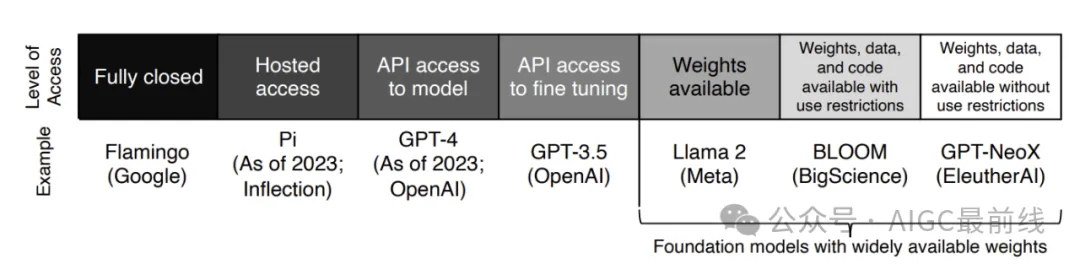

基礎模型的發布呈現出多維的態勢。從完全封閉(如Google DeepMind的Flamingo,僅模型開發者可用),到有限訪問(如OpenAI的GPT - 4,公眾可使用但為黑箱模式),再到更開放的形式(如Meta的Llama 2,模型權重廣泛可用,允許下游修改和審查)。截至2023年8月,英國競爭與市場管理局的數據顯示,公開披露模型最常見的發布方式是開放發布。

二、開放基礎模型的利弊分析

(一)優勢顯著

- 權力分散

- 基礎模型創造了新的社會經濟權力形式。封閉模型開發者在定義和限制使用案例上權力更大,而開放模型能讓下游消費者更好地自己做決策。例如,封閉模型開發者可能通過垂直整合塑造下游市場,導致單一化,而開放模型可避免權力過度集中在開發者手中。

- 創新催化

- 基礎模型是通用技術,能大幅提高創新。開放基礎模型對多種研究形式是必要的,如可解釋性工作、水印技術開發、安全研究以及模型訓練和推理效率技術等。它更具可定制性,能提供更深入的訪問,是創新的關鍵要素。據預測,到2032年生成式AI將成為1.3萬億美元的市場。

- 確保透明

- 數字技術存在不透明問題,而基礎模型開發者的透明度很重要。2023年基礎模型透明度指數顯示,主要的開放基礎模型開發者平均比封閉模型開發者更透明,在供應鏈各部分的透明度上都表現更好。這種透明度有助于避免過去不透明數字技術帶來的危害。

(二)風險存爭議

- 生物風險

- 有研究稱開放基礎模型可指導用戶構建生物武器,但證據薄弱。即使模型能提供相關信息,實際制造生物武器還需要實驗室的專業知識、設備和經驗等。可能更好的政策干預點在下游,比如加強對生物序列購買者的篩選。

- 虛假信息

- 基礎模型可能降低生成有說服力的虛假信息的成本。但對于封閉模型提供者來說,拒絕生成虛假信息的請求在技術上可能存在困難,而且虛假信息傳播的關鍵在于傳播平臺,目前沒有證據表明開放基礎模型會增加社會對虛假信息的敏感性。

- 網絡安全

- 開放代碼模型可能提高攻擊性網絡攻擊的速度和質量,但同時網絡防御也可能提高。例如谷歌證明代碼模型可大幅提高開源軟件漏洞檢測能力,廣泛使用開放模型并配合相關工具投資,可能會加強網絡安全。

- 魚叉式網絡釣魚詐騙

- 基礎模型能生成高質量的魚叉式網絡釣魚郵件,但關鍵危險在于郵件附帶的惡意軟件,而不是郵件文本本身。現代操作系統和瀏覽器有多層防護,而且現有保護措施可能使釣魚郵件無法到達收件人。

- 語音克隆詐騙

- 現實中出現了語音克隆詐騙案例,但目前不清楚與傳統詐騙相比其是否更有效或可擴展。封閉模型開發者可通過一些措施起到威懾作用,如要求用戶用信用卡注冊并能追溯音頻來源。

- 非自愿親密圖像和兒童性虐待材料

- 開放的文本到圖像模型在生成此類內容上風險獨特,因為其降低了生成門檻。封閉模型在這方面的防護相對更有效,監測封閉模型可阻止此類圖像生成。對于此類問題,政策干預在下游平臺是否更有效還有待研究。

三、政策對開放基礎模型的影響

(一)政策現狀

世界各地政府都在出臺與基礎模型相關的政策。例如,美國行政命令要求國家電信和信息管理局為總統準備一份關于開放基礎模型的報告;歐盟對計算量少于1025浮點運算的開放基礎模型可能有豁免;英國的AI安全研究所將考慮開源系統等。此外,人工智能伙伴關系也提出了基礎模型安全部署的指導方針,不建議對最強大的基礎模型進行開放發布。

(二)潛在問題

- 合規負擔不均

- 一些政策提案可能對開放基礎模型開發者造成不成比例的影響。例如,要求開發者對模型生成的內容負責的立法,會傷害開放開發者,因為用戶可修改模型生成非法內容。

- 風險評估不準確

- 一些監管方法可能沒有充分考慮開放基礎模型相對于封閉模型或現有技術的邊際風險。例如,通過對計算密集型模型授權來限制基礎模型發布的提案,對于一些低資源需求的文本到圖像模型造成的危害可能并不適用。

四、治理建議

- 考慮潛在影響

- 政策制定者應明確考慮AI監管對開放基礎模型周圍充滿活力的創新生態系統的潛在意外后果。在制定政策時,應考慮到開放基礎模型在權力分配、創新和透明度方面的社會利益,以及其可能存在的風險。

- 精準定義模型

- 當法規直接涉及開放基礎模型時,應仔細考慮用于識別這些模型和開發者的精確定義。僅基于開放權重來制定法規可能不合適,因為惡意行為者可能利用開放數據和源代碼(無模型權重)重新訓練模型并造成類似危害。

- 直接咨詢開發者

- 如果要實施相關干預措施,應與開放基礎模型社區進行直接咨詢,充分考慮他們的利益。例如,在考慮下游使用責任和嚴格的內容溯源要求等問題時,要考慮到開放基礎模型開發者對下游使用控制有限的情況。

開放基礎模型具有重要意義,政策制定應綜合考慮其利弊,避免對其創新生態造成不良影響。

本文轉載自公眾號AIGC最前線

原文鏈接:??https://mp.weixin.qq.com/s/BL9vJGBzt46zAquJ8_qO1w???

?著作權歸作者所有,如需轉載,請注明出處,否則將追究法律責任

標簽

已于2024-10-21 10:21:10修改

贊

收藏

回復

分享

微博

QQ

微信

舉報

回復

相關推薦