COLM 2024:一種新的深度學(xué)習(xí)架構(gòu)——Monotone Deep Boltzmann Machines 原創(chuàng)

在深度學(xué)習(xí)的世界里,Boltzmann機(jī)器是一種很有趣的模型,通過(guò)概率來(lái)理解數(shù)據(jù)。想象一下,我們有很多變量,它們之間的關(guān)系就像一張復(fù)雜的網(wǎng)。Boltzmann機(jī)器就是試圖描述這些變量之間的概率關(guān)系。它有不同的版本,比如深Boltzmann機(jī)器(DBM)和受限Boltzmann機(jī)器(RBM)。

RBM是一種比較常用的形式,它避免了模型同一層內(nèi)的連接,這樣可以使用更高效的基于塊的近似推理方法。但是,我們不禁要問(wèn),除了這種限制,還有沒有其他的限制方式也能讓推理變得高效呢?這就引出了我們今天要介紹的新模型——單調(diào)深度Boltzmann機(jī)器(Monotone Deep Boltzmann Machines,mDBM)。

一、背景知識(shí)

1.平衡模型及其收斂性

首先要提到的是深度平衡模型(DEQ)。它是由Bai等人提出的,就像一個(gè)神奇的公式,可以模擬一個(gè)無(wú)限深度的網(wǎng)絡(luò)。后來(lái),Winston和Kolter又提出了一種參數(shù)化的DEQ(monDEQ),它可以保證收斂到一個(gè)獨(dú)特的固定點(diǎn)。這就像給模型找到了一個(gè)穩(wěn)定的“家”,讓它不會(huì)亂跑。

2.馬爾可夫隨機(jī)場(chǎng)(MRF)及其變體

MRF是一種基于能量的模型,Boltzmann機(jī)器就是它的一種形式。其中,RBM是比較成功的變體,它通過(guò)特定的能量函數(shù)定義來(lái)避免層內(nèi)連接。但是我們的mDBM不一樣,它允許層內(nèi)連接,更加靈活和強(qiáng)大。

3.并行和收斂的平均場(chǎng)

平均場(chǎng)更新通常使用坐標(biāo)上升算法在局部收斂。但是有很多研究都在嘗試并行化更新。比如Kr?henbühl和Koltun提出的方法,還有Baqué等人的方法。我們的mDBM在這方面也有自己的創(chuàng)新,它可以保證在并行更新時(shí)收斂到一個(gè)全局最優(yōu)的平均場(chǎng)固定點(diǎn)。

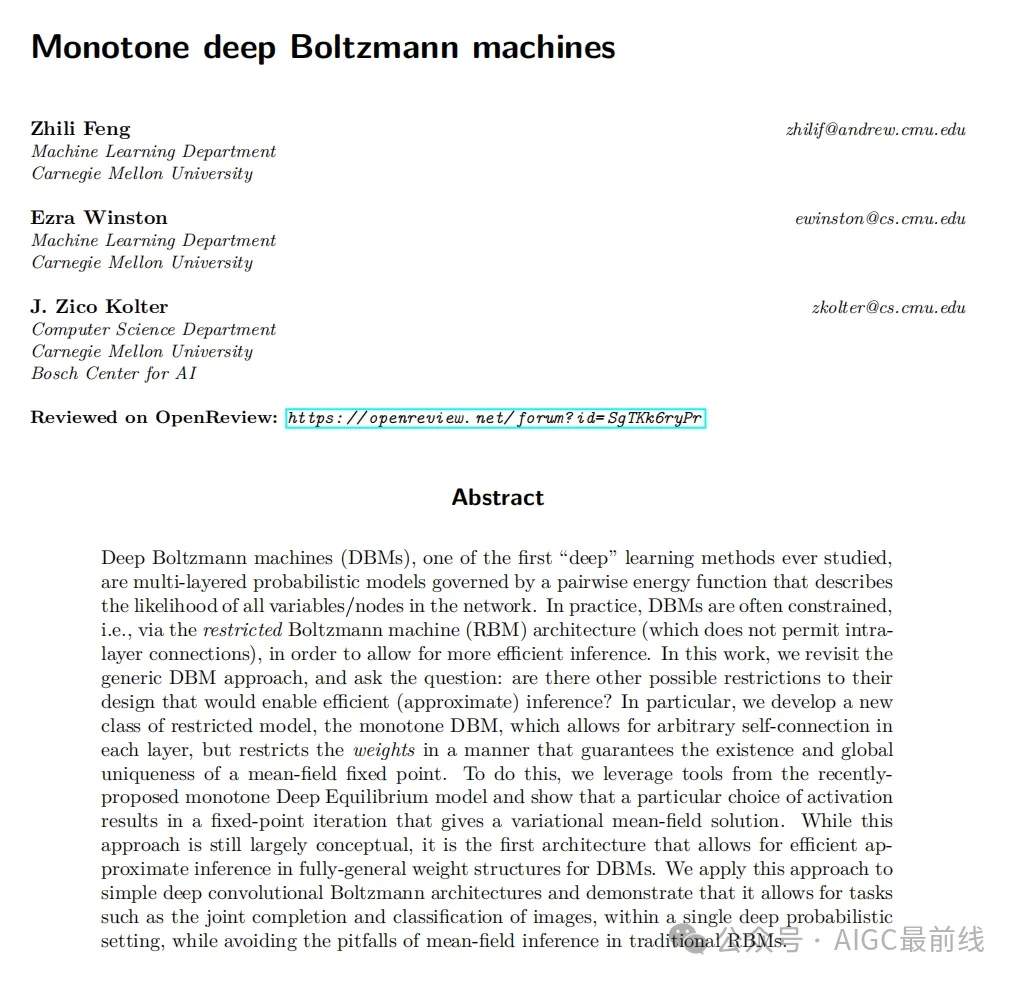

圖1:不同玻爾茲曼機(jī)的神經(jīng)網(wǎng)絡(luò)拓?fù)浣Y(jié)構(gòu)。一般情況是一個(gè)完全圖(紅色虛線是玻爾茲曼機(jī)中有但受限玻爾茲曼機(jī)中沒有的邊的子集)。

二、單調(diào)深Boltzmann機(jī)器(mDBM)的奧秘

1.單調(diào)參數(shù)化

- 我們是如何讓mDBM變得獨(dú)特的呢?首先是參數(shù)化。我們通過(guò)一種特殊的方式來(lái)定義模型中的成對(duì)勢(shì),使得它們滿足一定的單調(diào)性條件。就像給模型的各個(gè)部分設(shè)定了規(guī)則,讓它們按照我們想要的方式“行動(dòng)”。

- 具體來(lái)說(shuō),我們定義了一些矩陣和運(yùn)算,比如通過(guò)對(duì)矩陣A的處理來(lái)得到成對(duì)勢(shì)Φ。這樣的參數(shù)化既保證了Φ矩陣的空心性,又保證了單調(diào)性。

2.平均場(chǎng)推理作為單調(diào)DEQ

- 接下來(lái),我們把平均場(chǎng)推理和單調(diào)DEQ聯(lián)系起來(lái)。平均場(chǎng)推理是為了近似條件分布,我們發(fā)現(xiàn),在一定條件下,這個(gè)平均場(chǎng)固定點(diǎn)可以看作是一個(gè)類似DEQ的固定點(diǎn)。這就像找到了兩個(gè)不同領(lǐng)域之間的橋梁,讓我們可以更好地理解和處理模型。

- 而且,我們還證明了在特定條件下,對(duì)于任何輸入,都存在一個(gè)獨(dú)特的、全局最優(yōu)的平均場(chǎng)分布的固定點(diǎn)。

3.實(shí)際建模考慮

- 在實(shí)際中,當(dāng)我們用mDBM來(lái)建模時(shí),需要考慮很多細(xì)節(jié)。比如變量可能代表深度學(xué)習(xí)架構(gòu)中的隱藏單元,我們不能直接表示矩陣A,而是要找到一種方法來(lái)計(jì)算與A相關(guān)的乘法。

- 我們通常會(huì)把隱藏單元分成不同的集合,通過(guò)卷積層等方式來(lái)參數(shù)化A。這樣可以處理各種復(fù)雜的網(wǎng)絡(luò)結(jié)構(gòu),比如卷積、全連接層和跳躍連接等。

4.高效并行求解平均場(chǎng)固定點(diǎn)

- 雖然我們保證了單調(diào)性,但是簡(jiǎn)單的迭代不一定能收斂到我們想要的解。所以我們需要使用阻尼迭代。

- 這個(gè)阻尼迭代可以在網(wǎng)絡(luò)的所有變量上并行進(jìn)行,不需要像傳統(tǒng)的平均場(chǎng)推理那樣使用坐標(biāo)下降方法。但是計(jì)算這個(gè)阻尼迭代中的近鄰算子并不容易,我們通過(guò)一系列的定理和方法來(lái)解決這個(gè)問(wèn)題,包括找到一種數(shù)值穩(wěn)定的計(jì)算方法。

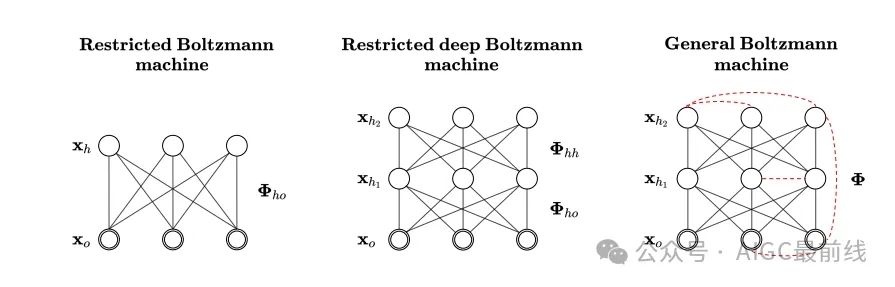

圖2:一種可能的深度卷積玻爾茲曼機(jī)的示意圖,其中單調(diào)性結(jié)構(gòu)仍然可以被強(qiáng)制實(shí)施

三、訓(xùn)練mDBM的技巧

1.損失函數(shù)的選擇

- 在訓(xùn)練mDBM時(shí),我們要選擇合適的方法。概率模型通常通過(guò)近似似然最大化來(lái)訓(xùn)練,但是對(duì)于我們的mDBM,直接使用平均場(chǎng)近似來(lái)訓(xùn)練參數(shù)可能不是最好的方法。

- 我們發(fā)現(xiàn),基于邊際的損失函數(shù)是一個(gè)更好的選擇。就像給模型一個(gè)明確的目標(biāo),讓它朝著正確的方向?qū)W習(xí)。

2.具體訓(xùn)練過(guò)程

- 給定一個(gè)樣本,我們首先要解決平均場(chǎng)推理問(wèn)題,找到隱藏狀態(tài)的估計(jì)值。然后我們可以計(jì)算預(yù)測(cè)值和真實(shí)值之間的損失函數(shù),通過(guò)這個(gè)損失函數(shù)來(lái)更新模型的參數(shù)。

- 在計(jì)算梯度時(shí),我們要注意一些細(xì)節(jié),比如通過(guò)隱函數(shù)定理來(lái)處理一些復(fù)雜的導(dǎo)數(shù)關(guān)系。而且,由于單調(diào)性約束,我們可能還需要對(duì)輸出邊際進(jìn)行一些處理,比如使用一個(gè)可學(xué)習(xí)的溫度參數(shù)來(lái)調(diào)整。

四、實(shí)驗(yàn)評(píng)估:mDBM的實(shí)力展示

1.在MNIST數(shù)據(jù)集上的表現(xiàn)

- 我們?cè)贛NIST數(shù)據(jù)集上測(cè)試了mDBM。我們進(jìn)行了聯(lián)合像素插補(bǔ)和分類任務(wù),隨機(jī)掩蓋一部分像素,然后讓模型預(yù)測(cè)缺失的像素和圖像的類別。

- 結(jié)果顯示,mDBM的測(cè)試分類準(zhǔn)確率達(dá)到了92.95%,而傳統(tǒng)的深RBM只有64.23%。而且從像素插補(bǔ)的效果來(lái)看,mDBM也遠(yuǎn)遠(yuǎn)優(yōu)于RBM。我們還比較了不同比例像素被掩蓋時(shí)的情況,mDBM在各種情況下都表現(xiàn)出了優(yōu)勢(shì)。

- 我們還測(cè)試了mDBM在一些特殊任務(wù)上的表現(xiàn),比如隨機(jī)掩蓋14X14的補(bǔ)丁,mDBM也能很好地收斂和預(yù)測(cè)。

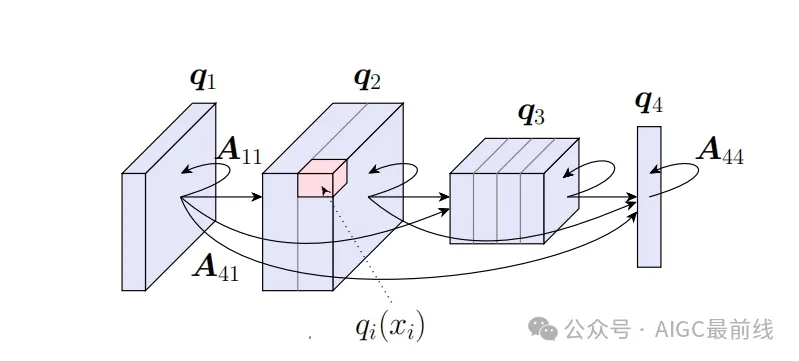

2.在CIFAR - 10數(shù)據(jù)集上的表現(xiàn)

- 在CIFAR - 10數(shù)據(jù)集上,我們同樣進(jìn)行了圖像像素插補(bǔ)和標(biāo)簽預(yù)測(cè)任務(wù)。當(dāng)50%的像素被觀察時(shí),mDBM模型獲得了58%的測(cè)試準(zhǔn)確率,并且能夠有效地插補(bǔ)缺失的像素。

- 與深RBM相比,mDBM在插補(bǔ)誤差等方面也表現(xiàn)出了優(yōu)勢(shì)。

3.與其他推理方法的比較

- 我們還比較了mDBM的平均場(chǎng)推理方法與其他一些方法,比如Kr?henbühl和Koltun以及Baqué等人提出的方法。

- 實(shí)驗(yàn)結(jié)果顯示,我們的方法在收斂速度上更快,而且能夠保證收斂到真正的平均場(chǎng)固定點(diǎn),而其他方法可能存在不收斂或者收斂到錯(cuò)誤的固定點(diǎn)的問(wèn)題。

圖3:使用mDBM和深度RBM對(duì)CIFAR - 10進(jìn)行像素填充

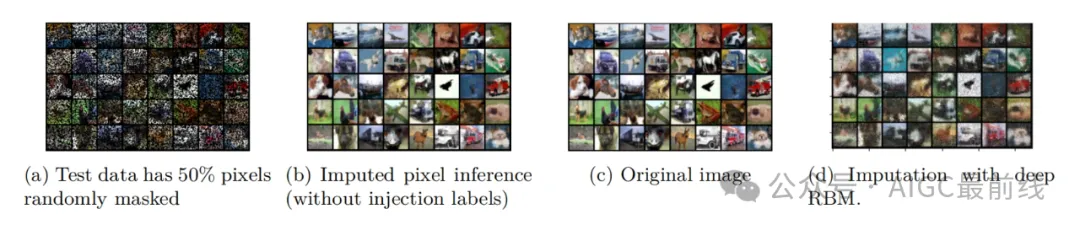

圖4:僅將上半部分展示給模型時(shí),使用mDBM對(duì)MNIST和CIFAR10進(jìn)行像素填充。左:觀測(cè)圖像;中:填充結(jié)果;右:原始圖像。

五、未來(lái)方向:探索更多可能

1.單調(diào)性條件的改進(jìn)

目前定理3.1中的單調(diào)性條件只是充分條件,不是必要條件。如果我們能改進(jìn)這個(gè)條件,可能會(huì)讓我們的模型更加靈活和強(qiáng)大。

2.模型的單調(diào)性調(diào)整

我們可以思考是否可以使用一個(gè)負(fù)的參數(shù)m來(lái)讓模型“有界非單調(diào)”,同時(shí)還能保持良好的收斂性質(zhì)。

3.聯(lián)合概率建模

我們的模型目前只學(xué)習(xí)條件概率,是否可以讓它更高效地學(xué)習(xí)聯(lián)合概率呢?這是一個(gè)值得探索的方向。

4.模型的擴(kuò)展和優(yōu)化

雖然我們已經(jīng)有了一個(gè)比較高效的實(shí)現(xiàn),但是與一些常見的非線性函數(shù)相比,還是比較慢。我們需要找到一種方法來(lái)更高效地?cái)U(kuò)展mDBM。

5.其他概率模型與DEQ框架的聯(lián)系

我們可以探索更多的概率模型是否也可以在DEQ框架內(nèi)表達(dá),就像發(fā)現(xiàn)更多的寶藏等待我們?nèi)ネ诰颉?/p>

六、結(jié)論

在這篇文章中,我們介紹了單調(diào)深Boltzmann機(jī)器(mDBM)。它是一種很有潛力的深度學(xué)習(xí)模型,通過(guò)獨(dú)特的參數(shù)化和推理方法,在處理圖像數(shù)據(jù)等任務(wù)上表現(xiàn)出了很好的性能。我們還討論了它的訓(xùn)練方法和未來(lái)的發(fā)展方向。希望這個(gè)新的模型能在深度學(xué)習(xí)的領(lǐng)域中開辟出一片新的天地,讓我們更好地理解和處理數(shù)據(jù)。

本文轉(zhuǎn)載自公眾號(hào)AIGC最前線 作者:實(shí)習(xí)小畢

原文鏈接:??https://mp.weixin.qq.com/s/RF6TeDxJIA0YXRCqz2QX-g??