ACL2024:一個開源的通用語言代理訓練框架LUMOS 原創

想象一下,擁有一個不僅能回答問題,還能瀏覽網頁、解決復雜數學問題、編寫代碼,甚至能推理圖像和基于文本的游戲的數字助手。聽起來好得難以置信?好吧,準備好迎接人工智能的未來,因為隨著LUMOS的引入,它變得更加易于獲取和透明。

在一項突破性的發展中,來自艾倫人工智能研究所、UCLA和華盛頓大學的研究人員推出了LUMOS,這是一個開源框架,有望徹底改變我們與語言代理的交互方式。與現有的閉源解決方案不同,LUMOS提供了前所未有的可負擔性、透明度和可重復性,使其成為人工智能世界的一個游戲規則改變者。

但LUMOS到底是什么,為什么它在人工智能社區引起如此轟動?系好安全帶,因為我們將深入探討這項卓越創新的細節,探索它如何工作、它能做什么,以及為什么它比你想象的更重要。

當前的語言代理通常依賴于GPT-4或ChatGPT等大型閉源語言模型作為核心組件。雖然功能強大,但這些模型價格昂貴,需要更多的透明度,并提供有限的可重復性和可控性。

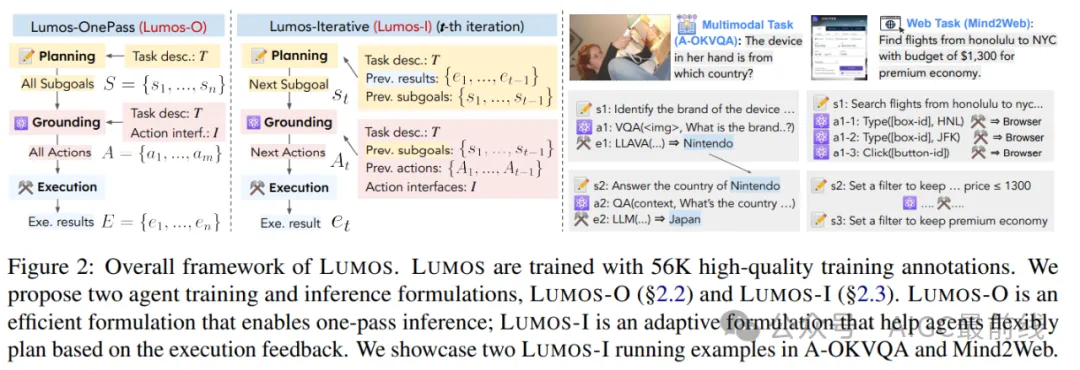

LUMOS框架采用了不同的方法,利用開源大型語言模型(LLMs)作為基礎模型。它采用了一個統一和模塊化的架構,由三個關鍵組件組成:規劃模塊、基礎模塊和執行模塊。

規劃模塊將復雜任務分解為一系列用自然語言表達的高級子目標。例如,對于"她手中的設備來自哪個國家?"這樣的多模態問題,規劃模塊可能會生成兩個子目標:"識別設備品牌"和"回答設備品牌的國家"。

然后,基礎模塊將這些高級子目標轉換為可由執行模塊中的各種工具執行的可執行低級操作。例如,第一個子目標可能會被轉化為"VQA(, 品牌是什么..?)"這樣的操作,以使用視覺問答工具從圖像中識別設備品牌。

執行模塊包含一系列現成的工具,包括API、神經模型和虛擬模擬器,可以執行基礎化的操作。這些執行操作的結果隨后被反饋到規劃和基礎模塊中,實現迭代和自適應的代理行為。

LUMOS的一個關鍵優勢是其模塊化設計,可以輕松升級并廣泛適用于各種交互任務。通過分離規劃、基礎和執行組件,研究人員可以改進或替換單個模塊而不影響其他模塊。

為了訓練LUMOS,研究人員整理了一個大規模、高質量的數據集,包含超過56,000個注釋,這些注釋源自各種復雜交互任務的多樣化真實推理理由,包括問答、數學、編碼、網頁瀏覽和多模態推理。這些注釋是通過使用GPT-4和其他先進的語言模型將現有基準轉換為與LUMOS架構兼容的統一格式獲得的。由此產生的數據集是最大的開源代理微調資源之一,使較小的語言模型能夠有效地被訓練為語言代理。

在跨九個數據集的評估中,LUMOS展現了幾個關鍵優勢。它在每種任務類型的保留數據集上超越了多個更大的開源代理,在某些情況下甚至超越了GPT代理在問答和網頁任務上的表現。LUMOS還優于其他訓練方法(如思維鏈和非模塊化集成訓練)產生的代理。值得注意的是,LUMOS展示了令人印象深刻的泛化能力,在涉及新環境和操作的未見任務上顯著優于30B規模(WizardLM-30B和Vicuna-v1.3-33B)和特定領域的代理。

憑借其開源性質、競爭性表現和強大的泛化能力,LUMOS代表了在開發用于復雜交互任務的可負擔、透明和可重復的語言代理方面的重大進步。

譯自(有刪改):https://www.marktechpost.com/2024/04/01/lumos-an-open-source-generalizable-language-agent-training-framework/

本文轉載自公眾號AIGC最前線

原文鏈接:??https://mp.weixin.qq.com/s/Hv6sECtrkTQvxS5q9XdXCw??