一次性支持 200 萬字無損上下文!Kimi智能助手玩了個大的——月之暗面「登月」最新進展!

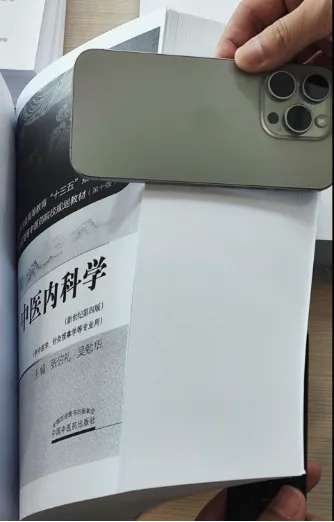

讓大模型一次性無損地「吃下」一本書已經不是什么稀奇的事了,但如果我告訴你是下面????這樣一本近百萬字的書呢?

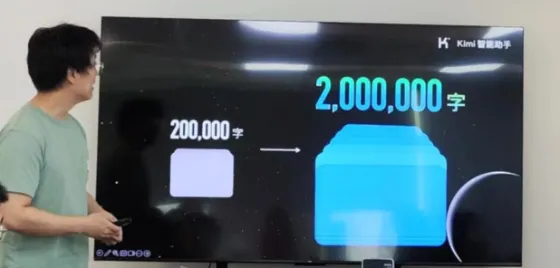

沒錯,這么瘋狂的事竟然真的發生了——就在昨天月之暗面(Moonshot AI)召集了一次媒體溝通會,宣布在大模型長上下文窗口技術上取得新的突破:不到半年,Kimi 智能助手升級十倍——從支持20萬字直接到支持 200 萬字超長無損上下文。

ps:Kimi Chat已改名為Kimi智能助手,并已在官網(kimi.ai)開啟“內測”。

超長上下文解鎖超多可能

月之暗面現場展示了一些超長無損上下文的使用場景示例。最令人印象深刻的自然是開頭提到的近百萬字的《中醫內科學》一書。當月之暗面工程副總裁許欣然抱出這本書時,引起了現場所有人的驚嘆,好家伙,Kimi還真能一下“消化掉”并給出準確的診療建議,這背后的技術就像這本書一樣“沉甸甸”。

支持超長上下文之后,Kimi在處理超多文件的業務場景時自然解鎖了更多可能。例如,公司 HR 可以快速從500 份簡歷中讓 Kimi 快速找出有某個行業從業經歷,同時從計算機類專業畢業的求職者:

圖片

圖片

Kimi十分鐘速成專家

大家肯定都聽過一萬小時專家定律,月之暗面在現場提出了「Kimi十分鐘速成專家定律」——在 200 萬字無損上下文的支持下,只需 10 分鐘,Kimi 就能接近任何一個新領域的初級專家水平。比如上傳英偉達過去幾年的完整財報,馬上就能讓 Kimi 成為英偉達財務研究專家,幫用戶分析總結英偉達歷史上的重要發展節點。

而如果將甄嬛傳全集幾十萬字的劇本傳給 Kimi,你就能成為堪比一個看了好幾十遍電視劇的“甄”學家,無論是甄嬛、果郡王的情感線以及和他們孩子的真相,借助Kimi都能秒答出來:

除了快速成為專家之外,Kimi還能讓你扮演跑團游戲主持人,體驗各種數字分身……

月之暗面「持續登月」

實現通用人工智能就像是登月,在通往AGI的路上,無損的長上下文將會是一個很關鍵的基礎技術。從 word2vec 到 RNN、LSTM,再到 Transformer,歷史上所有的模型架構演進,本質上都是在提升有效的、無損的上下文長度。”

月之暗面創始人&CEO楊植麟前不久在接受騰訊科技采訪時表示:“長文本是登月第一步,它很本質。它是新的計算機內存,它能解決很多現在的問題。比如,現在多模態架構還需要tokenizer,但當你有一個無損壓縮的long context就不需要了,可以把原始的放進去。進一步講,它是把新計算范式變成更通用的基礎……”

事實證明,月之暗面在登月的第一步上成績斐然,月之暗面將 Kimi 智能助手的無損上下文長度從20 萬字提升到200 萬字只用了不到半年時間。而在這半年時間里,由于沒有采用常規的漸進式提升路線,月之暗面團隊遇到的技術難度也是指數級增加的。為了達到更好的長窗口無損壓縮性能,月之暗面的研發和技術團隊從模型預訓練到對齊、推理環節均進行了原生的重新設計和開發,不走“滑動窗口”、“降采樣”等技術捷徑,攻克了很多底層技術難點,才取得了新的突破。

月之暗面工程副總裁許欣然在媒體溝通會上表示,“無論是內存、算力還是網絡帶寬,歷史上每一次基礎技術的升級,都會解鎖新的產品形態和應用場景。我們對 200 萬無損上下文的 Kimi 可以帶來哪些超出想象力的創新機遇充滿期待。”

楊植麟此前在接受采訪時明確表示,登月的第一步是長文本,第二步則會有兩個大的milestone。其中之一就是真正的統一各種不同模態的世界模型,即一個真正的scalable和general的architecture(可擴展、通用的系統結構)。關于影響下一步“登月”計劃的多模態模型,月之暗面在現場透露,他們早在Sora發布之前就在研發多模態大模型,預計今年就會亮相。

最后,就讓我們小小地期待下,月之暗面會不會在視頻生成時長上也在國內帶來類似長文本一樣“一騎絕塵”的突破吧。

本文轉載自夕小瑤科技說,作者:王二狗

原文鏈接:??https://mp.weixin.qq.com/s/riq8xlZNNt0m-vZtRMpeAw??