大模型本地部署的“隱形炸彈”,你的數據安全嗎?

作者 | 朱雀實驗室

隨著DeepSeek R1等開源大模型的火爆,越來越多的開發者、企業甚至開始嘗試在本地部署大語言模型,享受AI帶來的便利。

然而近期騰訊混元安全團隊-朱雀實驗室發現:這些廣受歡迎的AI工具中有不少存在安全隱患。如果使用不當,攻擊者可能竊取用戶數據、濫用算力資源,甚至控制用戶設備。

在見證行業多個AI系統因安全漏洞陷入被動后,我們選擇用工程師的方式回應:

做一把簡單趁手的"安全體檢工具箱"——AI-Infra-Guard,讓每個開發者都能快速診斷系統風險。

一、AI基礎設施存在哪些安全風險?

比如:

- 個人開發者在docker中部署ollama測試模型,卻發現GPU算力一直被占有?

- 創業公司因ComfyUI插件漏洞導致其未發布的模型泄漏被竊取?

- 工程師通宵定位推理服務卡頓問題,最終發現是Triton漏洞導致服務器被挖礦?

Ollama、OpenWebUI、ComfyUI這些名字是不是耳熟能詳?多少大模型教程里都離不開它們。然而不正確的使用會造成重大安全隱患。

1. Ollama

Ollama是一個廣泛使用的開源應用程序,可以在本地部署和操作大型語言模型,現在已成為最流行的的個人電腦跑大模型的方案,網絡上大部分本地部署大模型的文章也是推薦的此工具。

Ollama默認啟動時會開放11434端口,并在此端口上使用restful api執行核心功能。默認情況下ollama只會在本地開放端口,但是在Ollama的官方docker中,默認開放到公網上。

ollama對這些接口普遍沒有鑒權,導致攻擊者掃描到這些ollama的開放服務后可以進行一系列攻擊。

(1) 模型刪除

通過刪除接口刪除模型。

(2) 模型竊取

ollama支持自定義鏡像源,自建一個鏡像服務器,通過查看已安裝模型,再通過上傳接口即可獲得私有模型文件。

(3) 算力竊取

通過查看已安裝模型,之后用對話接口請求對話,竊取了目標機器的算力。

(4) 模型投毒

通過下載接口下載有毒的模型,接著通過刪除接口刪除正常模型,再通過模型復制接口接口遷移有毒模型到正常模型路徑,通過有毒模型污染使用者的對話。

(5) ollama遠程命令執行漏洞【CVE-2024-37032】

ollama在去年6月爆發過嚴重的遠程命令執行漏洞【CVE-2024-37032】,允許遠程代碼執行(RCE),CVSSv3評分為9.1。通過自建鏡像偽造manifest文件,實現任意文件讀寫和遠程代碼執行。漏洞影響Ollama 0.1.34之前的版本

2. OpenWebUI

openwebui是現在最流行的大模型對話webui,包含大模型聊天,上傳圖片,RAG等多種功能且方便與ollama集成。也是現在deepseek本地化部署常見的搭配。openwebui在歷史上也出現過嚴重漏洞。

【CVE-2024-6707】

用戶上傳文件時,文件會被存儲到靜態上傳目錄。上傳文件名可偽造,未進行校驗,通過構造特殊的文件名,將文件寫入至任意目錄從而導致惡意代碼或命令執行風險。

3. ComfyUI

除了文生文大模型,文生圖模型也是非常熱點的領域。ComfyUI是現在最流行的diffusion模型應用,因其豐富的插件生態和高度定制化節點聞名,常用于文生圖、文生視頻等領域。

ComfyUI和Ollama一樣,開發者最初可能只想在本地使用,沒有任何鑒權方式,目前也有大量開放到公網的ComfyUI應用。

ComfyUI因為插件生態聞名,但是插件的作者一般為個人開發者,對安全性沒有太多審查,騰訊朱雀實驗室在去年就發現多個ComfyUI及其插件漏洞。

朱雀實驗室歷史發現漏洞:

漏洞標題 | 漏洞評級 | 官方補丁狀態 |

ComfyUI 前臺未授權代碼執行漏洞 | 高危 | 修復中 |

ComfyUI Comfy_mtb插件遠程代碼執行漏洞 | 高危 | 已修復、有補丁 |

ComfyUI-Prompt-Preview插件 任意文件讀取漏洞 | 中危 | 修復中 |

ComfyUI Comfy_mtb插件遠程代碼執行漏洞 | 高危 | 修復中 |

ComfyUI-Custom-Scripts插件任意文件讀取漏洞 | 中危 | 修復中 |

ComfyUI核心反序列化漏洞 | 高危 | 已修復 |

ComfyUI MTB MathExpression插件遠程代碼執行漏洞 | 高危 | 已修復、有補丁 |

ComfyUI 核心節點反序列化遠程代碼執行 | 高危 | 修復中 |

ComfyUI Easyuse插件持續性拒絕服務漏洞 | 高危 | 修復中 |

ComfyUI ACE插件遠程代碼執行漏洞 | 高危 | 修復中 |

ComfyUI Ventrue插件SSRF漏洞 | 中危 | 修復中 |

ComfyUI Easyuse插件敏感信息泄露 | 低危 | 修復中 |

以上大部分漏洞影響ComfyUI全系列核心代碼(包含目前最新版本),部分流行插件,影響包括遠程命令執行、任意文件讀取/寫入,數據竊取等。

二、從DeepSeek看大模型基礎設施的安全挑戰

作為中國AI領域的標桿企業,DeepSeek在突破性模型研發與工程實踐上展現了卓越能力。然而,在上線初期,也因基礎設施配置和組件安全問題遭遇了大量攻擊。

如何精準識別基礎設施組件的安全配置缺陷、CVE漏洞等,是行業共性難題,也展現了AI基礎設施安全防護的復雜與挑戰。這類問題往往源于AI基礎設施的快速迭代特性——開發團隊需要同時應對模型優化、算力調度、組件集成等多重技術挑戰,疏忽了常見底層組件默認開放端口且無需認證的特性,也極易在架構設計中被簡化為『內網環境無需防護』的誤判。

AI-Infra-Guard正是為解決此類痛點而生。通過深度集成AI常用組件(不僅包含數據庫類別,也包含AI推理、部署、訓練、應用、工作流等的常見開源組件)的安全基線檢測能力,該工具可自動識別未授權訪問、歷史CVE漏洞暴露等風險。

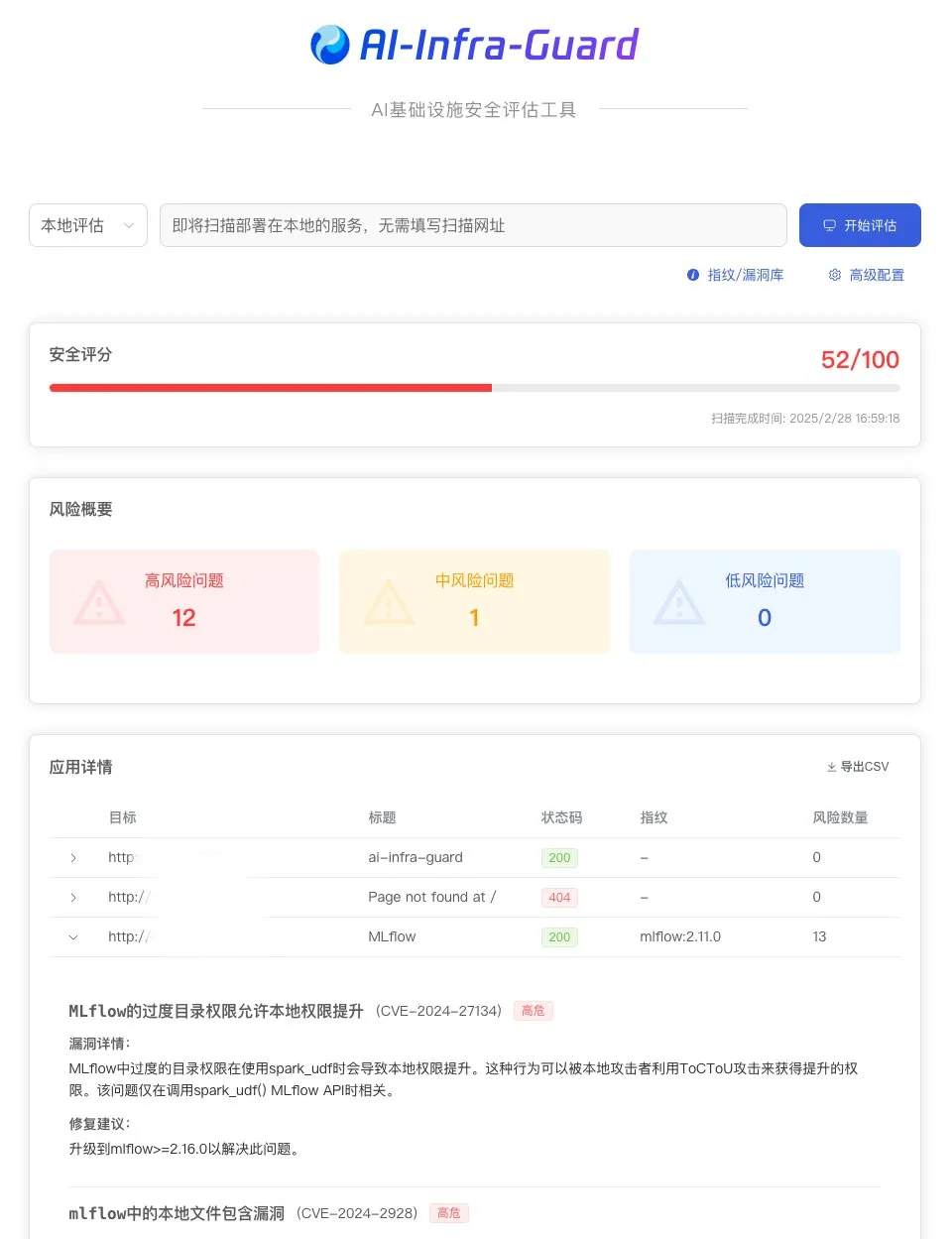

三、AI-Infra-Guard: AI風險一鍵檢測

AI Infra Guard(AI Infrastructure Guard) 是一個高效、輕量、易用的AI基礎設施安全評估工具,專為發現和檢測AI系統潛在安全風險而設計。目前已經支持檢測30種AI組件,并基于團隊對大模型供應鏈安全漏洞的研究、不僅支持常見的AI應用dify、comfyui、openwebui,也支持像ragflow、langchain、llama-factory等開發訓練框架的指紋識別以及的漏洞檢測。

支持WebUI界面,讓安全檢測更直觀。

- 對于個人用戶,可以使用本地評估功能,將對本地開放端口進行檢查,識別AI組件,并給出安全建議。

- 對于開發者/運維,可以使用遠程評估功能,檢測部署AI服務的安全性,可以直接輸入ip/域名一鍵評估。

使用友好:

- 零依賴,開箱即用,編譯后的二進制文件極小

- 內存占用<50MB,掃完千節點集群不卡頓

- 跨平臺兼容,同時支持Windows/MacOS/Linux

- WEBUI支持,點幾下鼠標就能一鍵檢測

1. AI組件漏洞覆蓋

AI-Infra-Guard目前已支持檢測主流AI框架和應用的眾多漏洞:

組件名稱 | 組件簡介 | 漏洞覆蓋數量 |

anythingllm | 用于使用任何大語言模型(LLM)與文檔對話的AI應用,確保隱私和易用性。 | 8 |

langchain | 一個靈活的開源框架,用于構建利用大語言模型與外部數據源的應用。 | 33 |

clickhouse | 一個高性能的開源列式數據庫,適合實時分析處理。 | 22 |

comfy_mtb | 一個ComfyUI擴展,提供用于AI藝術創作的動畫和圖像處理節點。 | 1 |

ComfyUI-Prompt-Preview | 一個ComfyUI擴展,用于可視化sdxl_prompt_styler的提示風格。 | 1 |

ComfyUI-Custom-Scripts | 一個集合,包含自定義腳本和節點,增強ComfyUI的用戶界面和功能。 | 1 |

comfyui | 一個基于節點的圖形界面,用于使用Stable Diffusion等擴散模型創建AI藝術。 | 1 |

fastchat | 一個開源平臺,用于訓練、服務和評估大語言模型。 | 1 |

gradio | 一個開源Python庫,用于創建共享和交互機器學習模型的網頁界面。一個基于網頁的交互式開發環境,支持創建和共享包含筆記本、代碼和數據的計算文檔。 | 42 |

jupyterlab | 一個基于網頁的交互式開發環境,支持創建和共享包含筆記本、代碼和數據的計算文檔。 | 6 |

jupyter-notebook | 為Jupyter網頁應用(如Notebook和Lab)提供核心服務和API的后端組件。 | 1 |

jupyter-server | 為Jupyter網頁應用(如Notebook和Lab)提供核心服務和API的后端組件。 | 13 |

kubeflow | 一個開源平臺,簡化在Kubernetes上部署和管理機器學習工作流,覆蓋ML生命周期各階段。 | 4 |

kubepi | 一個CLI工具,簡化在Raspberry Pi設備上設置和管理Kubeflow的環境。 | 5 |

llamafactory | 一個統一框架,用于高效微調100多個大語言模型和視覺語言模型,提供LLaMA Board網頁界面。 | 1 |

llmstudio | H2O.ai提供的框架和無代碼GUI,用于微調大型語言模型。 | 1 |

ollama | 一個開源工具,允許在本地運行大語言模型,確保數據隱私和控制。 | 8 |

open-webui | 一個開源、自托管的AI平臺,提供用戶友好的本地運行大語言模型的界面,支持Ollama等運行器。 | 8 |

pyload-ng | 一個用Python編寫的免費開源下載管理器,提供基于網頁的界面管理跨平臺下載。 | 18 |

qanything | 開源企業級本地知識庫問答系統,支持多種數據格式和數據庫的本地查詢。 | 2 |

ragflow | 一個開源RAG引擎,通過深度文檔理解增強AI能力,提供準確的、引用支持的回答。 | 2 |

ray | 一個開源框架,用于擴展AI和Python應用,提供分布式計算和機器學習工作負載的統一方式。 | 4 |

vllm | 一個高性能開源引擎,用于高效推理和服務大語言模型,優化速度和內存使用。 | 5 |

triton-inference-server | Triton 推理服務器提供優化的云和邊緣推理解決方案。 | 7 |

2. 使用說明

啟動webui可視化檢測:

ai-infra-guard -ws對于開發者/運維,也提供命令行參數,方便各功能與CI/CD等自動化系統集成:

# 本地檢測

ai-infra-guard -localscan

# 單個目標

ai-infra-guard -target [IP:PORT/域名]

# 多個目標

ai-infra-guard -target [IP:PORT/域名] -target [IP:PORT/域名]

# 掃描網段尋找AI服務

ai-infra-guard -target 192.168.1.0/24

# 從文件讀取目標掃描ai-infra-guard -file target.tx四、寫在最后

我們從不相信‘絕對安全’的傳說,但至少可以讓漏洞的發現速度,比黑客的咖啡涼得更快一些。

AI Infra Guard 是混元安全團隊-朱雀實驗室在過去一年里,圍繞混元大模型安全開展深入研究和實踐的基礎上,逐步落地的一套大模型軟件供應鏈安全解決方案。我們將AI-Infra-Guard完全開源,讓每個團隊和開發者都能免費使用,保護 AI 基礎設施免受軟件供應鏈攻擊的威脅。

還記得文章開頭提到的那些安全漏洞嗎?每個使用大模型的團隊都可能在不知不覺中面臨這些風險。不管是個人開發者還是運維團隊,我們做了一個最直觀的“安全評分”方式來展示當前系統的安全問題。

通過以下幾步,查看你AI系統的評分:

- 下載地址:(https://github.com/Tencent/AI-Infra-Guard/releases),挑個適合你系統的版本。

- 一鍵開測:運行ai-infra-guard -ws,打開瀏覽器,查看你的安全評分。

項目介紹:GitHub - Tencent/AI-Infra-Guard: AI infrastructure security assessment tool designed to discover and detect potential security risks in AI systems.

本項目已進入DeepSeek官方 Awesome DeepSeek Integrations推薦應用清單。

歡迎大家Star、體驗并反饋,特別想對參與共建的同行者說:

”你們推送的每一個commit,都在重新定義AI世界的安全水位線。”