GPT-4o數學能力跑分直掉50%,上海AI Lab開始給大模型重新出題了

新模型在MATH上(以數學競賽為主)動輒跑分80%甚至90%以上,卻一用就廢。

這合理嗎??

為了真實檢驗模型數學推理能力,上海人工智能實驗室司南OpenCompass團隊放大招了。

推出新的復雜數學評測集LiveMathBench,以全新性能指標G-Pass@16??來連續評估模型的性能潛力和穩定性。

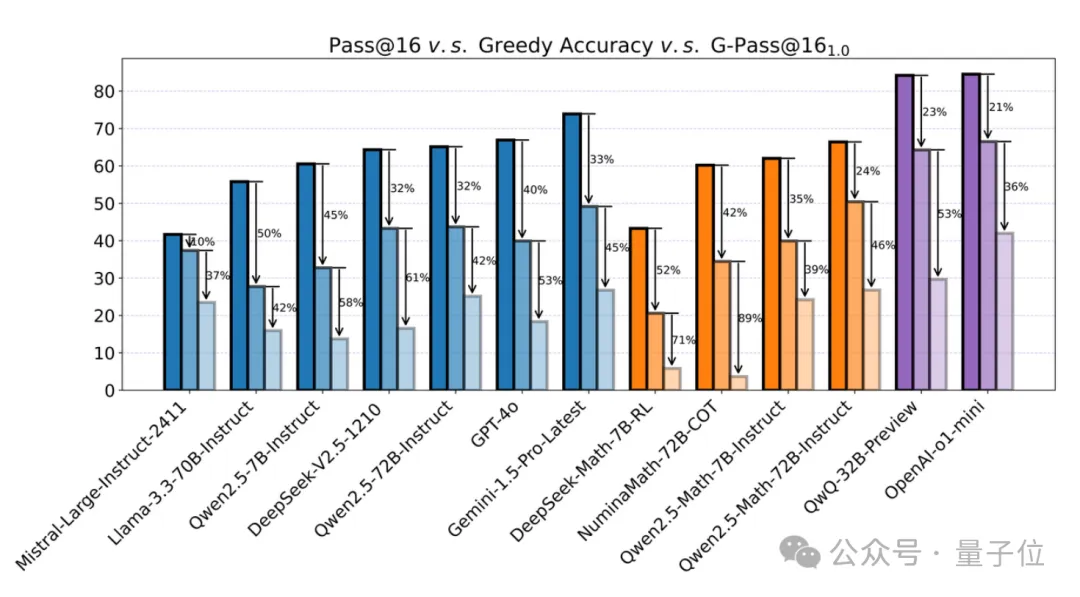

好家伙!團隊在模擬真實用戶使用采樣策略、重復多次評測大模型的數學推理能力時發現:

大部分的模型平均會有五成以上的性能下降,即使是最強推理模型o1-mini也會下降3成6,更有模型直接下降九成。

具體咋回事兒下面接著看。

全新評價指標: G-Pass@k

研究團隊重新思考了大模型評測常用的技術指標,如傳統經常采用的Pass@k, Best-of-N, Majority Voting,這些指標主要關注模型的性能潛力,缺少對模型的魯棒性的評測。

而真實場景中,為了提高回復的多樣性,模型往往使用采樣解碼的方式進行推理,這也會帶來大量的隨機性。在復雜推理任務中,這種隨機性會嚴重影響模型的性能,而用戶更預期在真實問題中,模型能又穩又好。

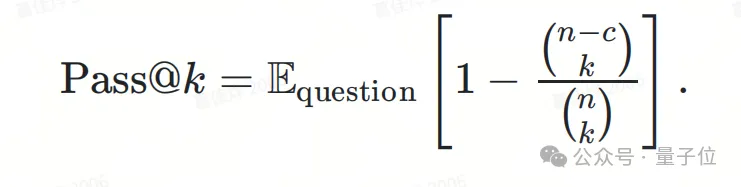

Pass@k指標回顧

經典的Pass@k指標關注模型在多次生成中至少給出一次正確答案的概率。假設模型生成次數為??,正確答案數為??,c表示其中正確解的數量,那么Pass@k的計算方式如下:

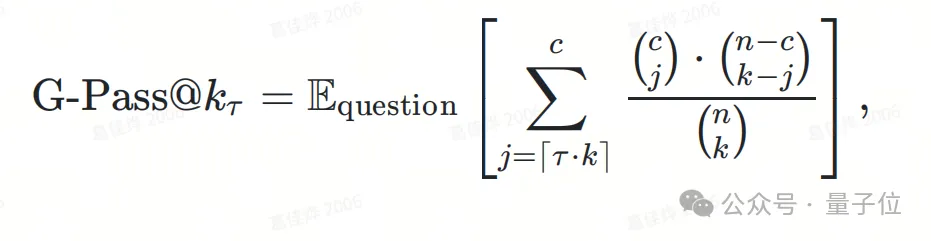

兼顧性能潛力與穩定性的評測指標G-Pass@K

Pass@k體現了模型的性能潛力,卻不能體現模型的穩定性,基于這一目的團隊將Pass@k推廣為Generalized Pass@k(以下簡稱G-Pass@k??)。

通過引入閾值??,該工作關注模型在??次生成中至少給出 ? ?? · ?? ?次正確答案的概率。

一般來說,認為模型的每次生成是i.i.d.(Independent and Identically Distributed)的,那么模型給出的正確答案數服從二項分布,這可以通過超幾何分布逼近二項分布。基于此,可以得出G-Pass@k??的定義:

在??較小時,G-Pass@k??衡量模型的性能潛力;??較大時,G-Pass@k??衡量模型的穩定性,或者說模型對于問題的掌握程度,因此研究者可以通過G-Pass@k??連續地觀察模型的性能潛力與穩定性。

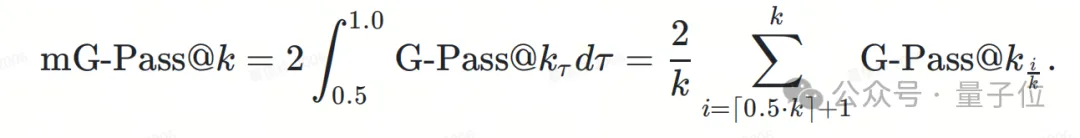

進?步地,研究團隊還定義了mG-Pass@k用于對模型的性能進行整體觀測。

具體來說,mG-Pass@k是 ??—G-Pass@k??曲線下的面積,為了更好地模擬真實場景,團隊重點考慮???[0.5,0.1 ]的情況,即:

G-Pass@K是Pass@K是泛化形式

當? ?? · ?? ?=1時,Pass@K是G-Pass@k??等價,這意味著Pass@K是G-Pass@k??的特例,讀者可以參考論文附錄提供的證明。

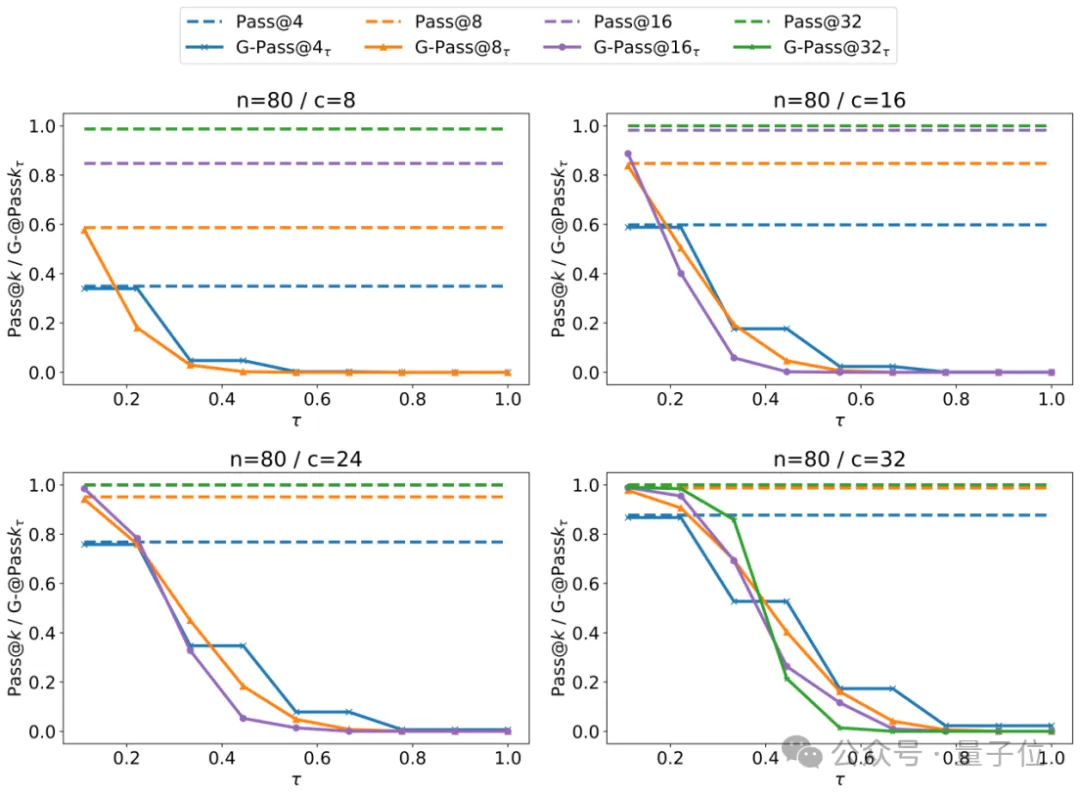

研究團隊給出了兩者關系的對比分析,如下圖所示:

圖中展示了不同的??和c下Pass@K和G-Pass@k??的值,可以看出在??較小時,兩者反映的是模型的潛力,然而這種分數可能是偏高的,在24/80的整體通過率下,Pass@K指標的值可以接近80%。

但當關注較高的??時,更能夠觀察到模型在實際生成時的真實性能。

LiveMathBench:避免數據污染的復雜數學評測集

研究團隊構建了一個新的benchmark LiveMathBench用于驗證實驗。

具體來說,他們收集了最近發布的中國數學奧林匹克,中國高考最新模擬題,美國數學競賽和美國普特南數學競賽中最新的題目,盡量減少數據污染的可能性。

整個LiveMathBench(202412版本)包括238道題目,每個題目提供中文/英文兩個版本的題目,覆蓋不同的難度。研究團隊計劃后續持續更新LiveMathBench中的題目,來持續觀測LLM的真實數學水平。

另外,研究團隊還在兩個公開Benchmark MATH500和AIME2024上進行了實驗。

對于MAH500,研究團隊選擇了難度為L5的題目,命名為MATH500-L5;對于AIME2024,研究團隊使用了Part1和Part2兩個部分全部45道題目,命名為AIME2024-45。

實驗

在實驗設置方面,對于每道題目,進行了16*3=48次生成并報告G-Pass@16??分數。研究團隊在通用模型、數學模型和類o1模型三種不同類型的大模型中選擇了具有代表性的大模型進行實驗。

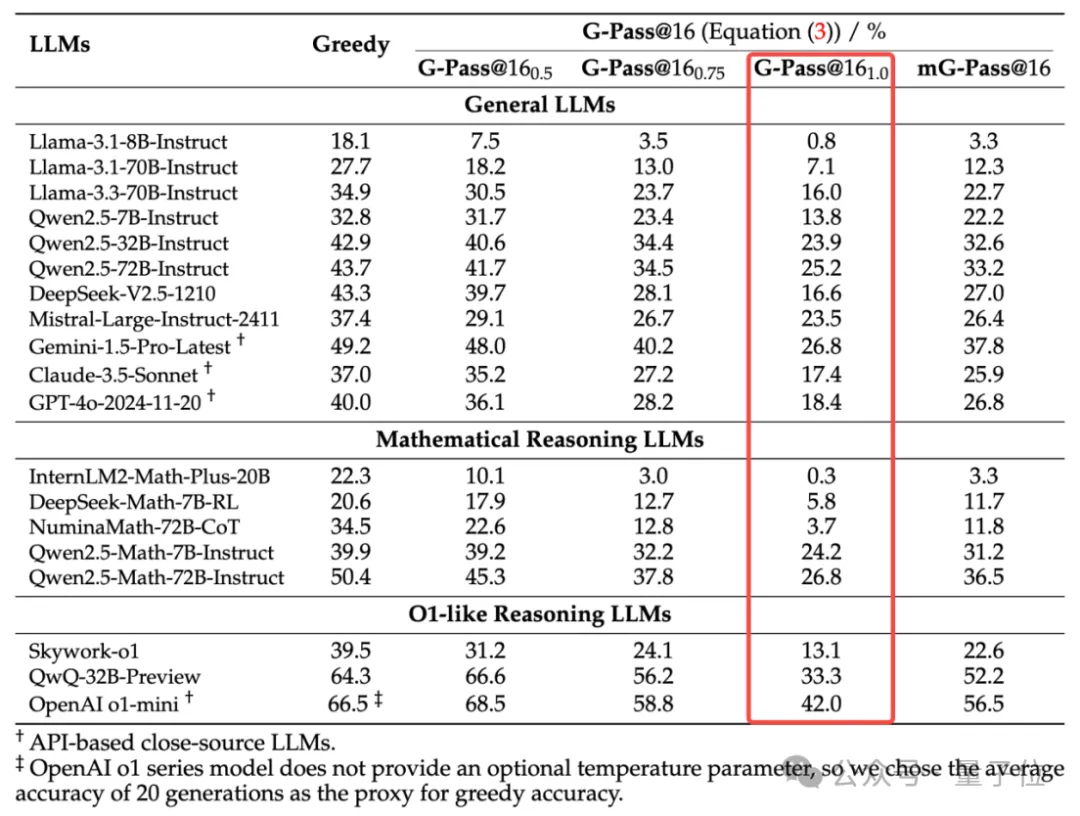

LiveMathBench性能對比如下:

根據實驗結果,可以看到:

- 大部分閉源模型和開源模型在G-Pass@161.0指標上也都不超過30分。

- 最強的o1-mini模型在G-Pass@161.0獲得了最高分42分,相對性能下降比例也是所有模型中最低的(36.9%),雖體現出相對較高的穩定性,但仍然難以忽視。

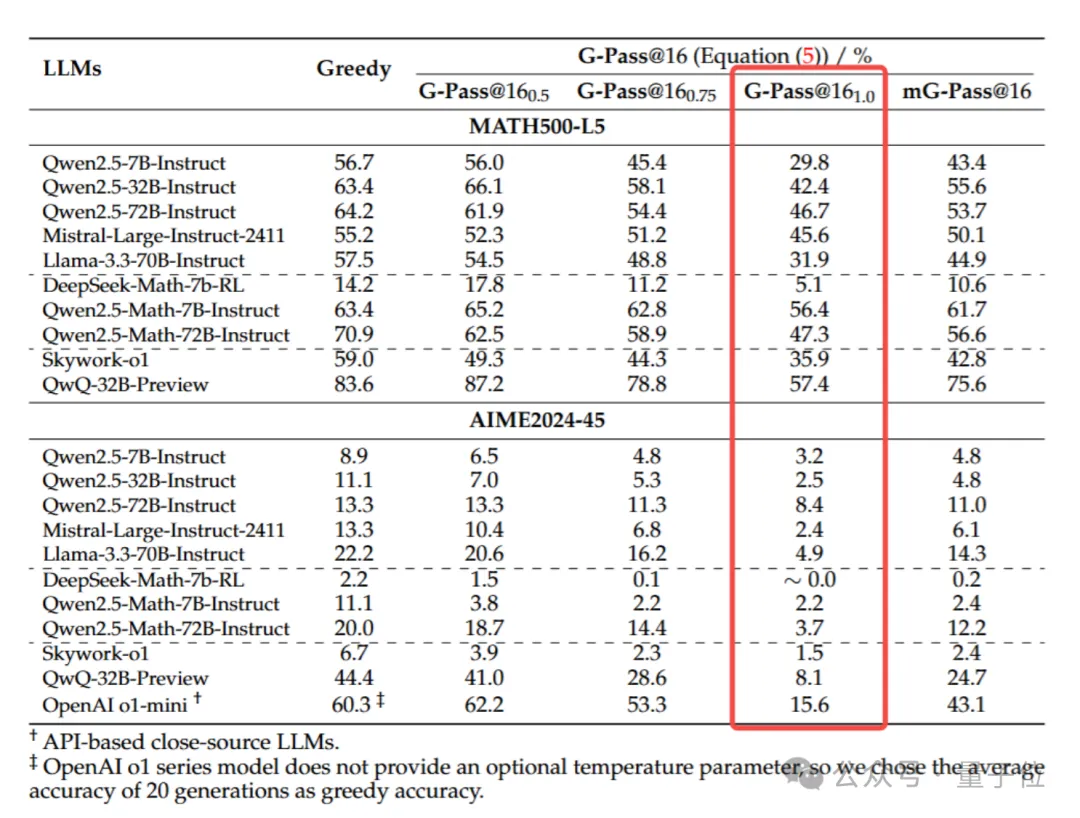

Math-500-L5/AIME2024-45性能對比如下。

對于開源數據集:

- 在常用的高中競賽級別題目MATH500-L5上,多數模型不管是貪婪解碼的表現還是穩定性G-Pass@161.0的表現都相比LiveMathBench都有所提升,而AIME2024則相反,大多數模型的G-Pass@161.0分數都只有個位數,甚至部分模型接近0分;

- 對于難度頗高的AIME2024,雖然o1-min和QwQ-32B-Preview在貪婪解碼下表現突出,但面對高難度題目下的穩定性還是難以保證,如QwQ-32B-Preview甚至跌到了不到原來的1/5,而其在MATH500-L5中卻比較穩定,達到了原分數的3/5,這也說明了最新的高難度數學題目對模型的穩定性帶來了更大的壓力。

最后,模型在不同難度題目上的能力分析如下 。

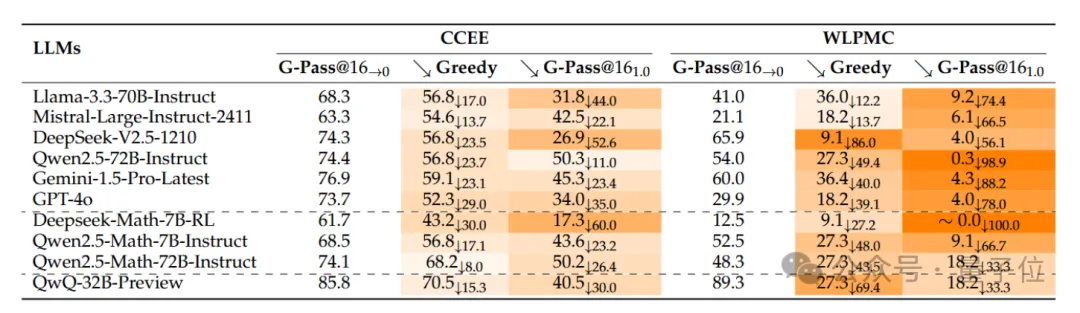

下表展示了關鍵模型在LiveMathBench兩個子集上的性能表現。

其中CCEE代表中國高考題目,主要涉及到基礎的高中數據知識;而WLPMC代表來自普特南(Putnam)競賽的題目,普特南競賽是久負盛名的美國大學生數學競賽,其題目難度要高于高考題目。

由實驗結果可以看出,先進的推理模型,例如DeepSeek-V2.5, Qwen2.5-72B-Instruct, QwQ等在Pass@16指標下在兩個子集上都有較好的性能,但大部分模型在WLPMC上的穩定性下降更為嚴重。

因此可以有如下猜想,推理模型容易學習到訓練數據中的平凡解,導致Pass@k等指標的上升,然而在困難的問題上,這種提升并不與模型真實推理性能提升相關。在強基座模型的訓練中,更應該關注推理穩定性的表現,以提升其真實推理能力。

重要觀測

觀察一:閉源和開源模型均不能穩定地進行復雜推理

研究人員對當前主流的約20個模型進行了測試,發現盡管多數模型在貪婪解碼的準確率Greedy Accuracy和Pass@16上表現相對較好,但當使用G-Pass@K指標進?評估時,性能卻顯著下降。

當??設置為1.0時,即要求模型在所有16次采樣中都提供正確答案, 幾乎所有模型的表現都急劇下降。

例如,在對LiveMathBench的測評中,Llama-3.1-8B-Instruct模型的準確率從18.1%下降到0.8%(G-Pass@16??=1.0),降幅高達95.7%。即使是較大的模型,如NuminaMath-72B-CoT,其準確率也從34.45%下降到3.7%,減少了89.3%。

在大約20個測試模型中,平均性能下降了60%。即便是表現最為穩定的OpenAI o1-mini,其準確率也從66.5%下降到42.0%,降幅為36.9%。

即使將??放寬到0.5,即只要求一半的樣本正確即可通過,通用模型、數學推理模型和o1-like模型仍分別經歷了14.0%、22.5%和4.8%的平均性能下降。

這表明,在復雜條件下,多數模型難以在多次采樣中保持一致的推理能力。

不過目前的評估指標通常依賴單次貪婪解碼,可能無法充分反映這些模型在實際應用中的魯棒性和穩定性。

因此,研究團隊指出,需要對模型的推理能力進行更嚴格的評估,尤其是在那些需要在多次采樣中保持一致性和可靠性的重要應用中。

觀察二:增大模型規模對推理能力的提升有限

研究人員觀察到,以同系列模型Qwen2.5-32B-Instruct與Qwen2.5-72B-Instruct為例,雖然它們的模型規模相差一倍以上,但無論指標采用G-Pass@K還是Greedy Accuracy,無論評測數據集是最新的LiveMathBench還是現有開源數據集,兩者的表現均相似。

另外,在更大體量的模型Mistral-Large-Instruct-2411(123B)上,盡管模型規模繼續增大,但其性能和穩定性相比 Qwen2.5-72B-Instruct 卻出現下滑。

這表明,對于需要深度理解和邏輯推理的任務,簡單增大參數并不能顯著提升性能或穩定性。

這可能是因為這些任務不僅需要模型具備記憶和模式識別能力,更需要強大的推理和上下文理解能力。

觀察三:模型的性能潛力和實際表現之間的巨大差距

研究團隊在評估模型性能時發現,理論最大能力G-Pass@16??→0、實際表現能力Greedy Accuracy和多次采樣下的穩定能力G-Pass@16??=1.0之間存在顯著差距。

盡管模型在理論上具備相當高的潛在性能,但在實際應用中未能充分展現這一水平,尤其是在輸出穩定性方面。一些模型在單次貪婪解碼中表現出高準確率,顯示出處理特定任務的潛力,但在保持一致高準確率方面卻不穩定,遠未達到最佳性能。

這反映了現有模型在推理穩定性和一致性上的不足,這在訓練和評估中常被忽略。

模型在單次推理表現中易受輸入數據變化、初始化狀態或隨機采樣的影響,導致不同采樣解碼的結果不一致。

研究人員指出,在高可靠性和一致性要求的實際應用中,如何在保持接近最佳性能的同時確保輸出的穩定性,是一個亟待解決的問題。

總結

本研究深入分析了當前大型模型的數學推理能力,提出了全新的性能指標G-Pass@16?? ,用于連續評估模型的性能潛力和穩定性。

此外,還設計了避免數據污染的LiveMathBench數據集。

實驗結果顯示,目前的大型模型在推理性能方面未達到預期,尤其在多次重復采樣時,性能出現顯著下降。研究團隊期望學術界和工業界能夠在推理能力的魯棒性研究上持續探索與推進。

論文鏈接:https://arxiv.org/abs/2412.13147

項目地址:https://github.com/open-compass/GPassK