編輯 | 言征

出品 | 51CTO技術棧(微信號:blog51cto)

12月13日晚,國內開源模型玩家深度求索發(fā)布了視覺模型 DeepSeek-VL2。這次DeepSeek視覺模型給這一領域帶來了不少看新看點:

1、模型層面,視覺模型也可以使用 MoE 架構,而且可以配合動態(tài)切圖

2、新增了不少生成玩法,如:視覺定位,模型可以根據提示識別出物體的邊界范圍,再比如梗圖理解和解析。

3、圖表理解:可以根據plot圖逆向生成代碼。

4、從OCR到故事生成:可以N張圖一期喂給模型,模型直接生成強相關的故事。

先上一張圖,讓大家品一品,一句提示,讓大模型明白圖中的人物:誰是淡定姐。

圖片

圖片

當然,DeepSeek-VL2 肯定是開源的了,具體型號有3B、16B 、 27B。模型和論文均已發(fā)布:

模型下載:https://huggingface.co/deepseek-ai

GitHub主頁:https://github.com/deepseek-ai/DeepSeek-VL2

1.模型新升級

首先看數據方面,VL2 比上一代 DeepSeek-VL 多一倍優(yōu)質訓練數據,引入梗圖理解、視覺定位、視覺故事生成等新能力。

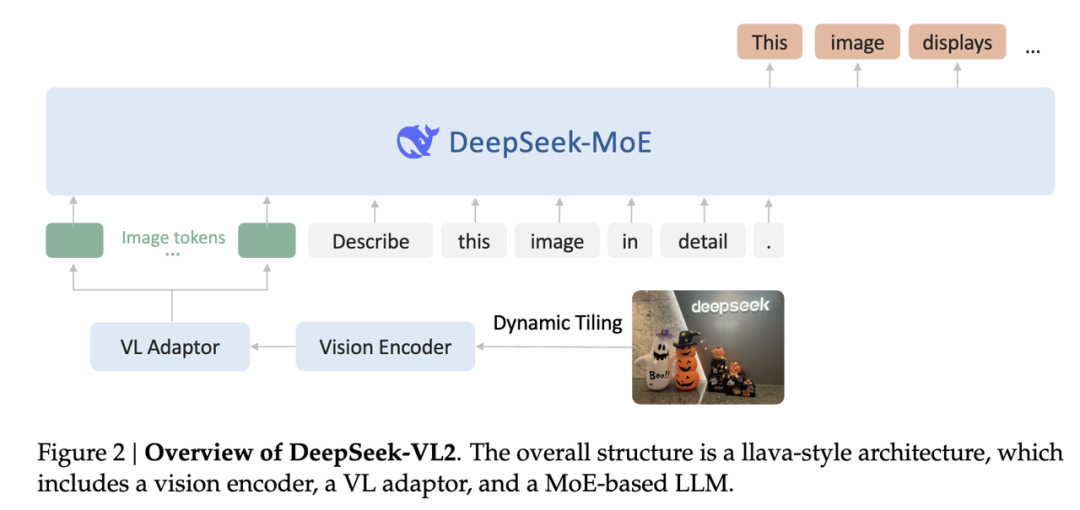

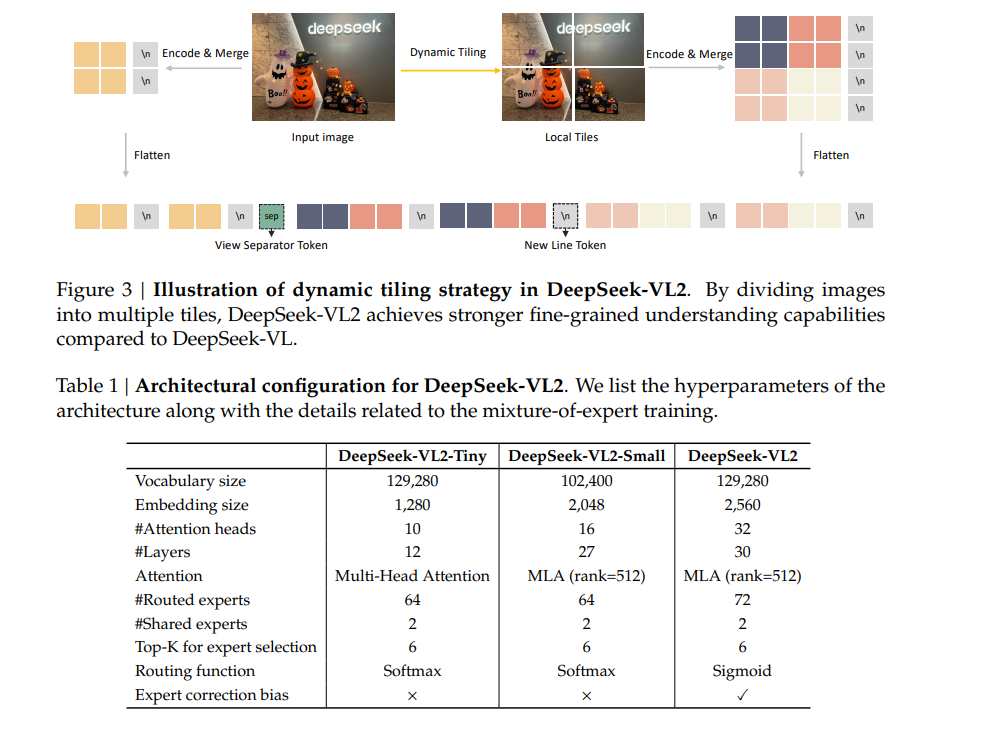

在模型架構上,視覺部分使用切圖策略支持動態(tài)分辨率圖像,語言部分采用 MoE 架構低成本高性能。

圖片

圖片

在訓練方法上,繼承 DeepSeek-VL 的三階段訓練流程,同時通過負載均衡適配圖像切片數量不定的困難,對圖像和文本數據使用不同流水并行策略,對 MoE 語言模型引入專家并行,實現高效訓練。

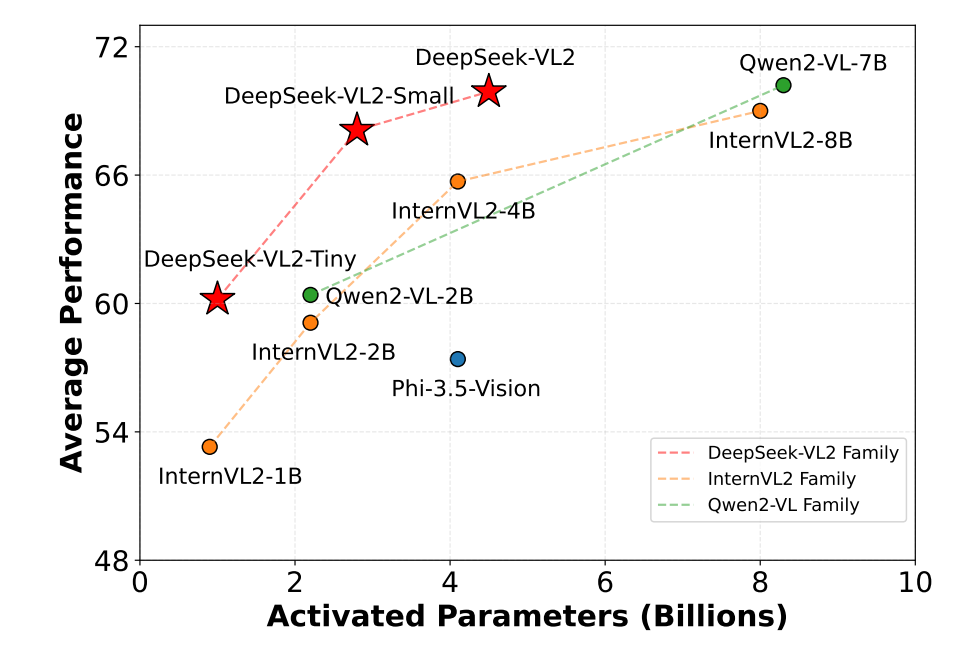

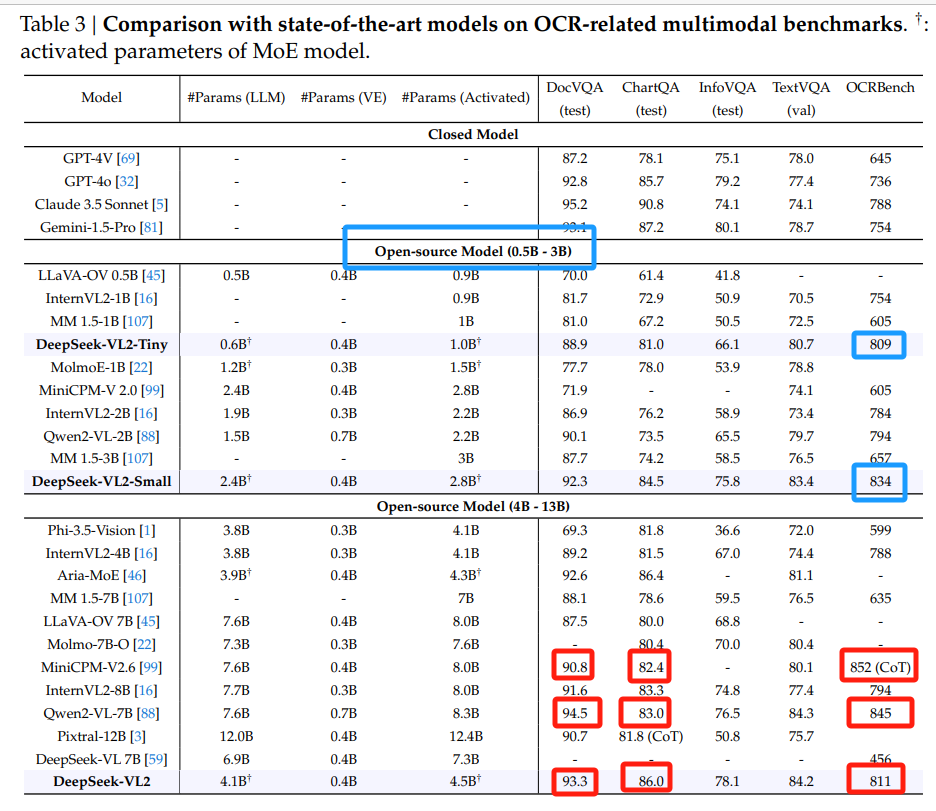

在不少視覺理解測試中,評分結果跟GPT4o、Qwen打平,甚至更好,關鍵是VL2可以用更少的參數量就能達到極好的效果。DeepSeek-VL2 模型展現出了強大能力,在各項評測指標上均取得了極具優(yōu)勢的成績:

圖片

圖片

具體的測評結果如下:

圖片

圖片

2.動態(tài)分辨率支持

據介紹,DeepSeek-VL2 僅使用一個 SigLIP-SO400M 作為圖像編碼器,通過將圖像切分為多張子圖和一張全局縮略圖來實現動態(tài)分辨率圖像支持。這一策略使得 DeepSeek-VL2 最多支持 1152x1152 的分辨率和 1:9 或 9:1 的極端長寬比,這樣就可以適配更多應用場景。

圖片

圖片

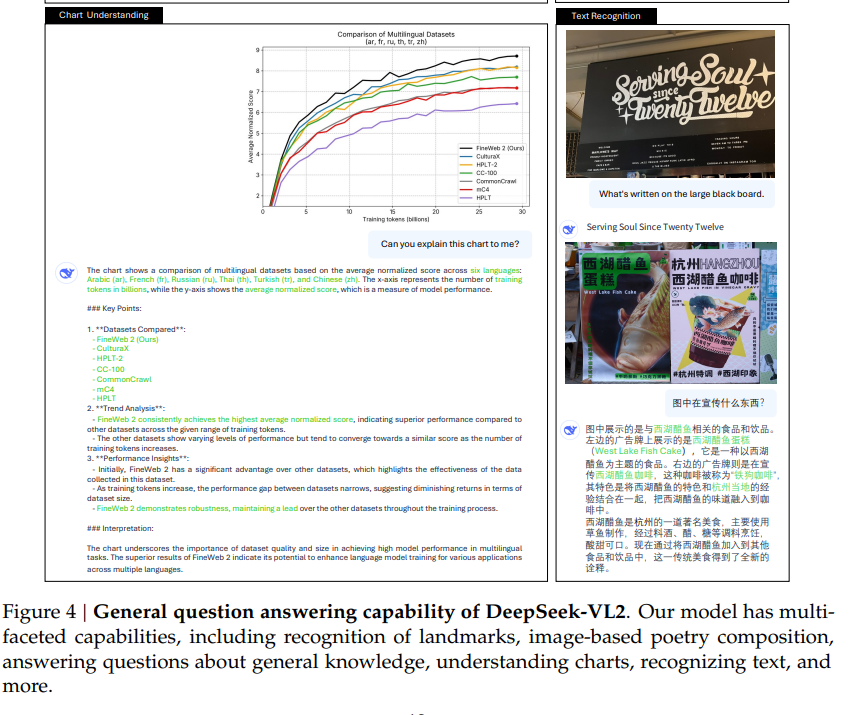

3.圖表理解

更多科研文檔數據的學習使得 DeepSeek-VL2 可以輕易理解各種科研圖表。

圖片

圖片

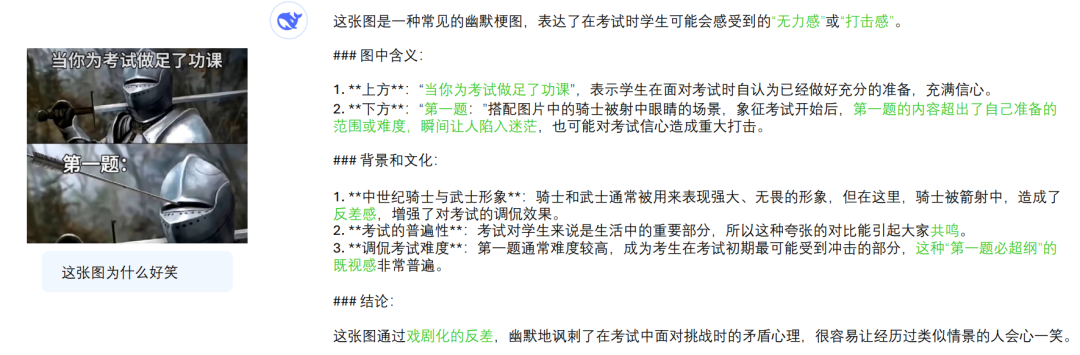

甚至連內涵的梗圖大模型也可以理解到位,由于DeeSeek-VL2用了更大規(guī)模的優(yōu)質數據,使得模型可以解析各種迷之能力,內涵什么的,大模型簡直小菜一碟。

一道調侃考試難度的梗圖,讓他解釋下為什么好笑——

圖片

圖片

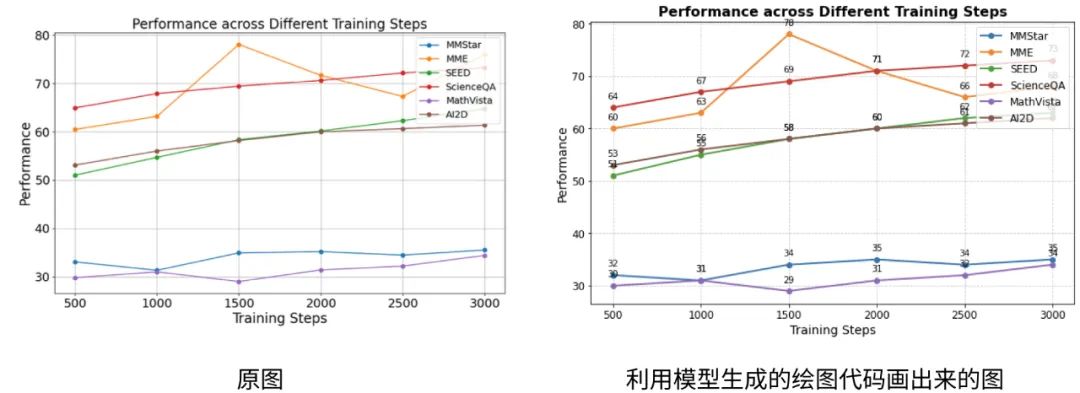

4.Plot2Code(逆向:圖生代碼)

DeepSeek-VL2 同時具備圖像理解和代碼生成的功能,可以作為你逆向畫圖的好幫手。

圖片

圖片

Prompt: Draw a plot similar to the image in Python.

5.視覺定位:視覺感知+語言推理

DS-VL2這次的一大看點就是視覺定位。用戶可以用一句話描述下物體,然后讓 DeepSeek-VL2 幫在圖像里找到符合描述的部分(注:模型本身只是輸出相應物體的邊界框)。

視覺模型進入MoE時代!DeepSeek開源全新視覺模型VL2,逆向由圖生成代碼、梗圖解析、幾張圖生成一篇童話!-AI.x社區(qū)

視覺模型進入MoE時代!DeepSeek開源全新視覺模型VL2,逆向由圖生成代碼、梗圖解析、幾張圖生成一篇童話!-AI.x社區(qū)

有了這項功能,就可以讓大模型做很多事情,比如higlight一下孫猴子、葫蘆娃什么的,甚至有幾個葫蘆娃也都可以標出來!

圖片

圖片

此外,視覺感知+語言推理,強強聯(lián)手還可以讓模型具備視覺語義的對話能力。

這就是我們之前在GPT-4o發(fā)布視覺對話中的功能,你跟模型視頻,問他哪款甜品適合自己,他能很懂你的需求做出推薦。

圖片

圖片

6.故事生成

你也可以輸入多張圖像,讓模型把它們串聯(lián)起來,小老鼠、話多、魔法師、發(fā)光樹,四張圖片一上傳,讓VL2用這些圖片講一個故事,它也不會怵,秒懂圖里的角色,快速講出一篇《雪夜的奇遇》的童話來。

圖片

圖片

童話出版物機構可以用上一用!

7.寫在最后:如何理解和用好多模態(tài)?

多模態(tài)可以說是今年以來大模型向前演進的一個趨勢,從語言到視覺、聽覺等深入研究,既可以進一步解鎖大模型的通用能力,同時也會讓未來的AI應用更加繁榮和落地。

DeepSeek團隊提到,視覺是人類獲取外界信息的主要來源,占據所有信息量的約 80%。然而在大模型時代,視覺方面的進展卻遠遠落后于語言模型。

“我們堅信,提升模型視覺能力的意義不僅在于支持更多的輸入模態(tài),更在于全方位提升模型的感知和認知能力。”