反轉!Claude 3.5超大杯沒有訓練失敗,最新爆料:內部自留,用于合成數據和RL訓練

傳聞反轉了,Claude 3.5 Opus沒有訓練失敗。

只是Anthropic訓練好了,暗中壓住不公開。

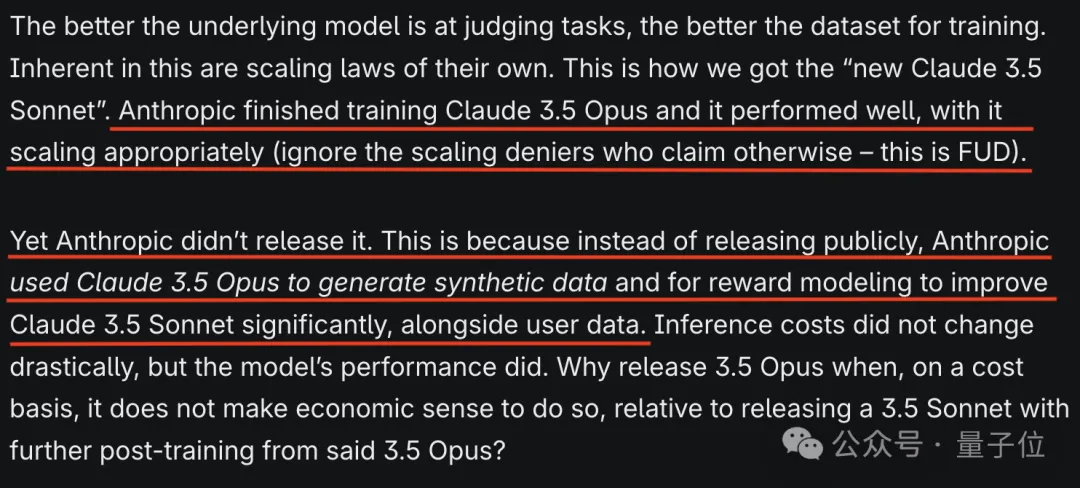

semianalysis分析師爆料,Claude 3.5超大杯被藏起來,只用于內部數據合成以及強化學習獎勵建模。

Claude 3.5 Sonnet就是如此訓練而來。

使用這種方法,推理成本沒有明顯提升,但是模型性能更好了。

這么好用的模型,為啥不發布?

不劃算。

semianalysis分析,相較于直接發布,Anthropic更傾向于用最好的模型來做內部訓練,發布Claude 3.5 Sonnet就夠了。

這多少讓人不敢相信。

但是文章作者之一Dylan Patel也曾是最早揭秘GPT-4架構的人。

除此之外,文章還分析了最新發布的o1 Pro、神秘Orion的架構以及這些先進模型中蘊藏的新規律。

比如它還指出,搜索是Scaling的另一維度,o1沒有利用這個維度,但是o1 Pro用了。

網友:它暗示了o1和o1 Pro之間的區別,這也是之前沒有被披露過的。

新舊范式交迭,大模型還在加速

總體來看,semianalysis的最新文章分析了當前大模型開發在算力、數據、算法上面臨的挑戰與現狀。

核心觀點簡單粗暴總結,就是新范式還在不斷涌現,AI進程沒有減速。

文章開篇即點明,Scaling law依舊有效。

盡管有諸多聲音認為,隨著新模型在基準測試上的提升不夠明顯,現有訓練數據幾乎用盡以及摩爾定律放緩,大模型的Scaling Law要失效了。

但是頂尖AI實驗室、計算公司還在加速建設數據中心,并向底層硬件砸更多錢。

比如AWS斥巨資自研了Trainium2芯片,花費65億美元為Anthropic準備40萬塊芯片。

Meta也計劃在2026年建成耗電功率200萬千瓦的數據中心。

很明顯,最能深刻影響AI進程的人們,依舊相信Scaling Law。

為什么呢?

因為新范式在不斷形成,并且有效。這使得AI開發還在繼續加速。

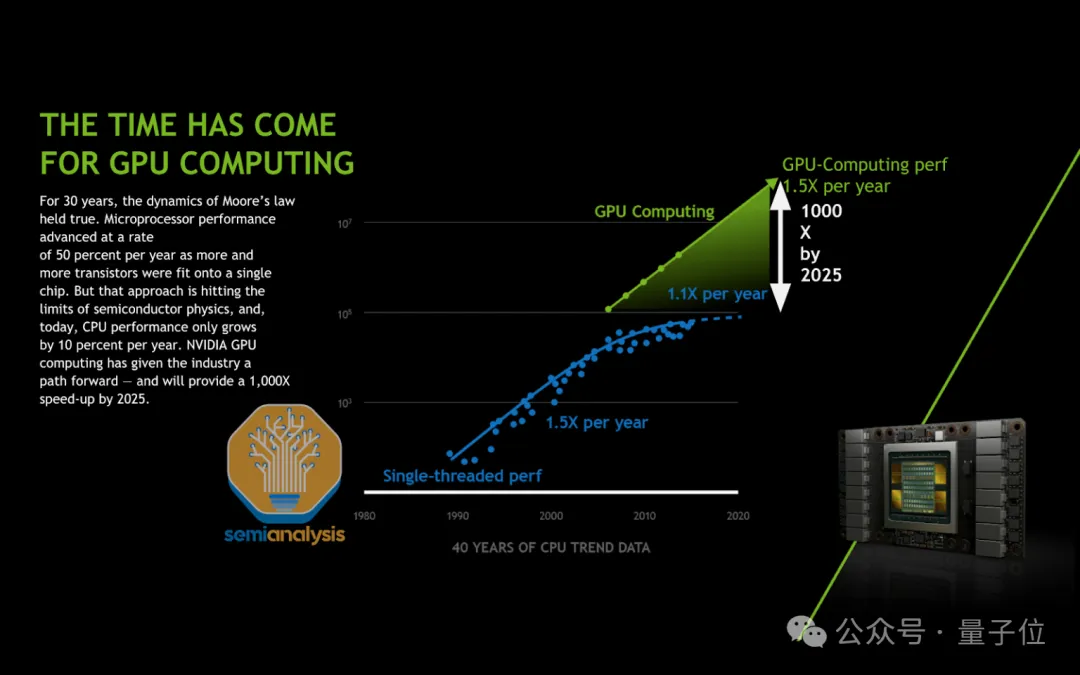

首先在底層計算硬件上,摩爾定律的確在放緩,但是英偉達正在引領新的計算定律。

8年時間,英偉達的AI芯片計算性能已經提升了1000倍。

同時,通過芯片內部和芯片之間的并行計算,以及構建更大規模的高帶寬網絡域可以使得芯片更好在網絡集群內協同工作,特別是推理方面。

其次在數據方面也出現了新的范式。

已有公開數據消耗殆盡后,合成數據提供了新的解決途徑。

比如用GPT-4合成數據訓練其他模型是很多實驗團隊都在使用的技術方案。

而且模型越好,合成數據質量就越高。

也就是在這里,Claude 3.5 Opus不發布的內幕被曝光。

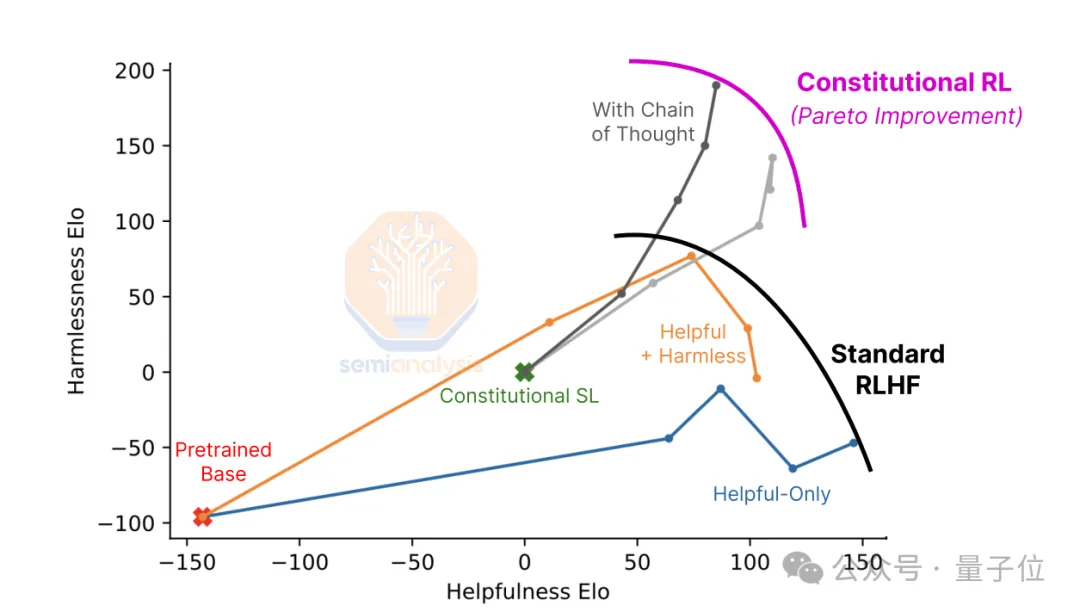

它承擔了為Claude 3.5 Sonnet合成訓練數據、替代人類反饋的工作。

事實證明,合成數據越多,模型就越好。更好的模型能提供更好的合成數據,也能提供更好的偏好反饋,這能推動人類開發出更好的模型。

具體來看,semianalysisi還舉了更多使用綜合數據的例子。

包括拒絕采樣、模式判斷、長上下文數據集幾種情況。

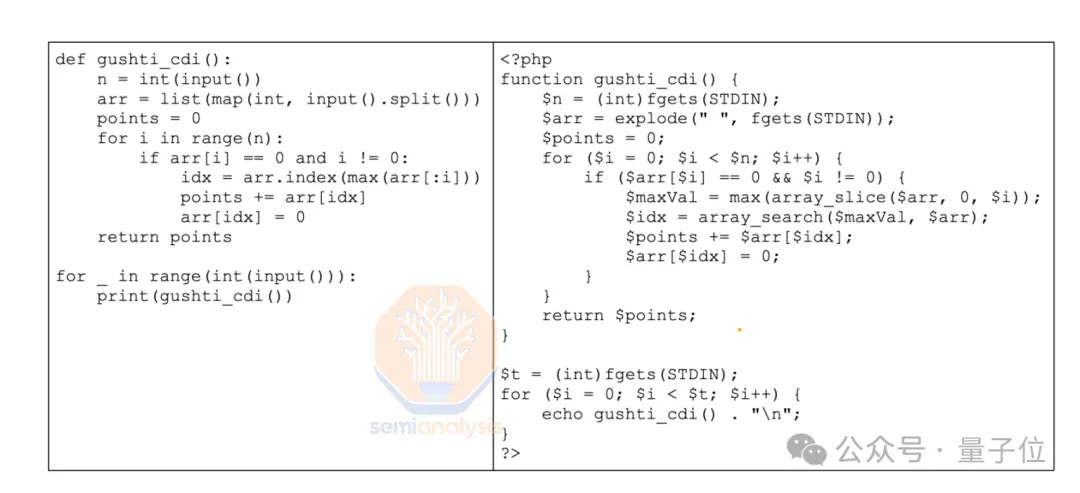

比如Meta將Python代碼翻譯成PHP,并通過語法解析和執行來確保數據質量,將這些額外的數據輸入SFT數據集,解釋為何缺少公共PHP代碼。

比如Meta還使用Llama 3作為拒絕采樣器,判斷偽代碼,并給代碼進行評級。一些時候,拒絕抽樣和模式判斷一起使用。這種方式成本更低,不過很難實現完全自動化。

在所有拒絕抽樣方法中,“判官”模型越好,得到數據集的質量就越高。

這種模式,Meta今年剛剛開始用,而OpenAI、Anthropic已經用了一兩年。

在長上下文方面,人類很難提供高質量的注釋,AI處理成為一種更有效的方法。

然后在RLHF方面,專門收集大量的偏好數據難且貴。

對于Llama 3,DPO(直接偏好優化)比PPO(最近策略優化)更有效且穩定,使用的計算也少。但是使用DPO就意味著偏好數據集是非常關鍵的。

如OpenAI等大型公司想到的一種辦法是從用戶側收集,有時ChatGPT會給出2個回答并要求用戶選出更喜歡的一個,因此免費收集了很多反饋。

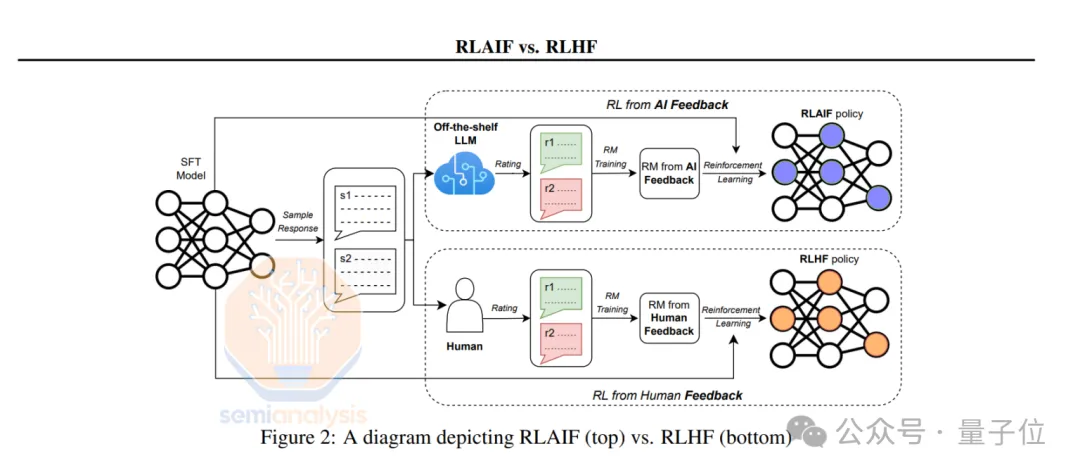

還有一種新的范式是讓AI替人類進行反饋——RLAIF。

它主要分為兩個階段。第一階段模型先根據人類編寫的標準對自己的輸出進行修改,然后創建出一個修訂-提示對的數據集,使用這些數據集通過SFT進行微調。

第二階段類似于RLHF,但是這一步完全沒有人類偏好數據。

這種方法最值得關注的一點是,它可以在許多不同領域擴展。

最后,值得重點關注的一個新范式是通過搜索來擴展推理計算。

文章中表明,搜索是擴展的另一個維度。OpenAI o1沒有利用這個維度,但是o1 Pro用了。

o1在測試時階段不評估多條推理路徑,也不進行任何搜索。

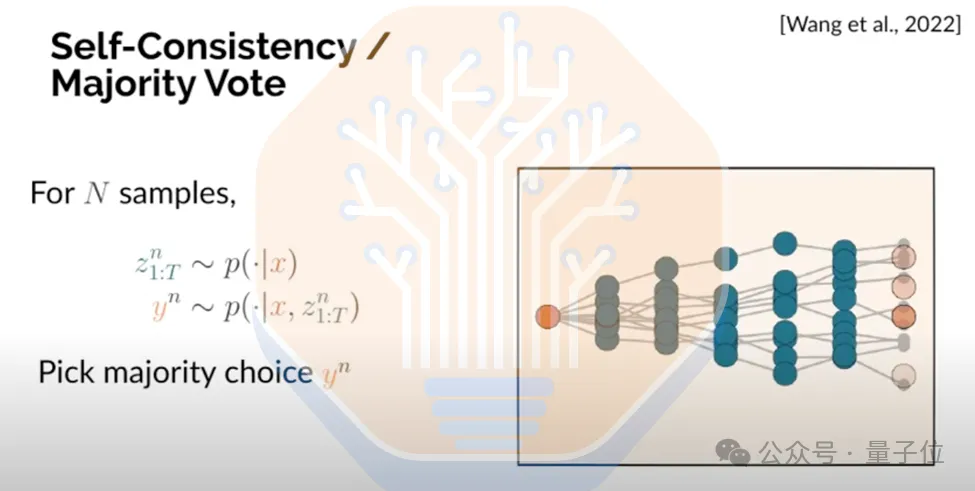

Self-Consistency / Majority Vote就是一種搜索方法。

這種方法中,只需在模型中多次運行提示詞,產生多個相應,根據給定的樣本數量,從相應中選出出現頻率最高的來作為正確答案。

除此之外,文章還進一步分析了為什么說OpenAI的Orion訓練失敗也是不準確的。