NeurIPS 2024 | 無(wú)需訓(xùn)練,一個(gè)框架搞定開放式目標(biāo)檢測(cè)、實(shí)例分割

本文介紹了來(lái)自北京大學(xué)王選計(jì)算機(jī)研究所的王勇濤團(tuán)隊(duì)的最新研究成果 VL-SAM。針對(duì)開放場(chǎng)景,該篇工作提出了一個(gè)基于注意力圖提示的免訓(xùn)練開放式目標(biāo)檢測(cè)和分割框架 VL-SAM,在無(wú)需訓(xùn)練的情況下,取得了良好的開放式 (Open-ended) 目標(biāo)檢測(cè)和實(shí)例分割結(jié)果,論文已被 NeurIPS 2024 錄用。

- 論文標(biāo)題:Training-Free Open-Ended Object Detection and Segmentation via Attention as Prompts

- 論文鏈接:https://arxiv.org/abs/2410.05963

論文概述

本文提出了一個(gè)無(wú)需訓(xùn)練的開放式目標(biāo)檢測(cè)和分割框架,結(jié)合了現(xiàn)有的泛化物體識(shí)別模型(如視覺語(yǔ)言大模型 VLM)與泛化物體定位模型(如分割基礎(chǔ)模型 SAM),并使用注意力圖作為提示進(jìn)行兩者的連接。在長(zhǎng)尾數(shù)據(jù)集 LVIS 上,該框架超過了之前需要訓(xùn)練的開放式方法,同時(shí)能夠提供額外的實(shí)例分割結(jié)果。在自動(dòng)駕駛 corner case 數(shù)據(jù)集 CODA 上,VL-SAM 也表現(xiàn)出了不錯(cuò)的結(jié)果,證明了其在真實(shí)應(yīng)用場(chǎng)景下的能力。此外,VL-SAM 展現(xiàn)了強(qiáng)大的模型泛化能力,能夠結(jié)合當(dāng)前各種 VLM 和 SAM 模型。

研究背景

深度學(xué)習(xí)在感知任務(wù)方面取得了顯著成功,其中,自動(dòng)駕駛是一個(gè)典型的成功案例。現(xiàn)有的基于深度學(xué)習(xí)的感知模型依賴于廣泛的標(biāo)記訓(xùn)練數(shù)據(jù)來(lái)學(xué)習(xí)識(shí)別和定位對(duì)象。然而,訓(xùn)練數(shù)據(jù)不能完全覆蓋真實(shí)世界場(chǎng)景中所有類型的物體。當(dāng)面對(duì)分布外的物體時(shí),現(xiàn)有的感知模型可能無(wú)法進(jìn)行識(shí)別和定位,從而可能會(huì)發(fā)生嚴(yán)重的安全問題。

為了解決這個(gè)問題,研究者們提出了許多開放世界感知方法。這些方法大致可以分為兩類:開集感知(open-set)和開放式感知(open-ended)。開集感知方法通常使用預(yù)訓(xùn)練的 CLIP 模型來(lái)計(jì)算圖像區(qū)域和類別名稱之間的相似性。因此,在推理過程中,這類方法需要預(yù)定義的對(duì)象類別名稱作為 CLIP 文本編碼器的輸入。然而,在許多現(xiàn)實(shí)世界的應(yīng)用場(chǎng)景中,并不會(huì)提供確切的對(duì)象類別名稱。例如,在自動(dòng)駕駛場(chǎng)景中,自動(dòng)駕駛車輛可能會(huì)遇到各種意想不到的物體,包括起火或側(cè)翻的事故車和各種各樣的建筑車輛。相比之下,開放式感知方法更具通用性和實(shí)用性,因?yàn)檫@些可以同時(shí)預(yù)測(cè)對(duì)象類別和位置,而不需要給定確切的對(duì)象類別名稱。

與此同時(shí),在最近的研究中,大型視覺語(yǔ)言模型(VLM)顯示出強(qiáng)大的物體識(shí)別泛化能力,例如,它可以在自動(dòng)駕駛場(chǎng)景中的長(zhǎng)尾數(shù)據(jù)上(corner case)識(shí)別非常見的物體,并給出準(zhǔn)確的描述。然而,VLM 的定位能力相比于特定感知模型較弱,經(jīng)常會(huì)漏檢物體或給出錯(cuò)誤的定位結(jié)果。另一方面,作為一個(gè)純視覺基礎(chǔ)模型,SAM 對(duì)來(lái)自許多不同領(lǐng)域的圖像表現(xiàn)出良好的分割泛化能力。然而,SAM 無(wú)法為分割的對(duì)象提供類別。基于此,本文提出了一個(gè)無(wú)需訓(xùn)練的開放式目標(biāo)檢測(cè)和分割框架 VL-SAM,將現(xiàn)有的泛化物體識(shí)別模型 VLM 與泛化物體定位模型 SAM 相結(jié)合,利用注意力圖作為中間提示進(jìn)行連接,以解決開放式感知任務(wù)。

方法部分

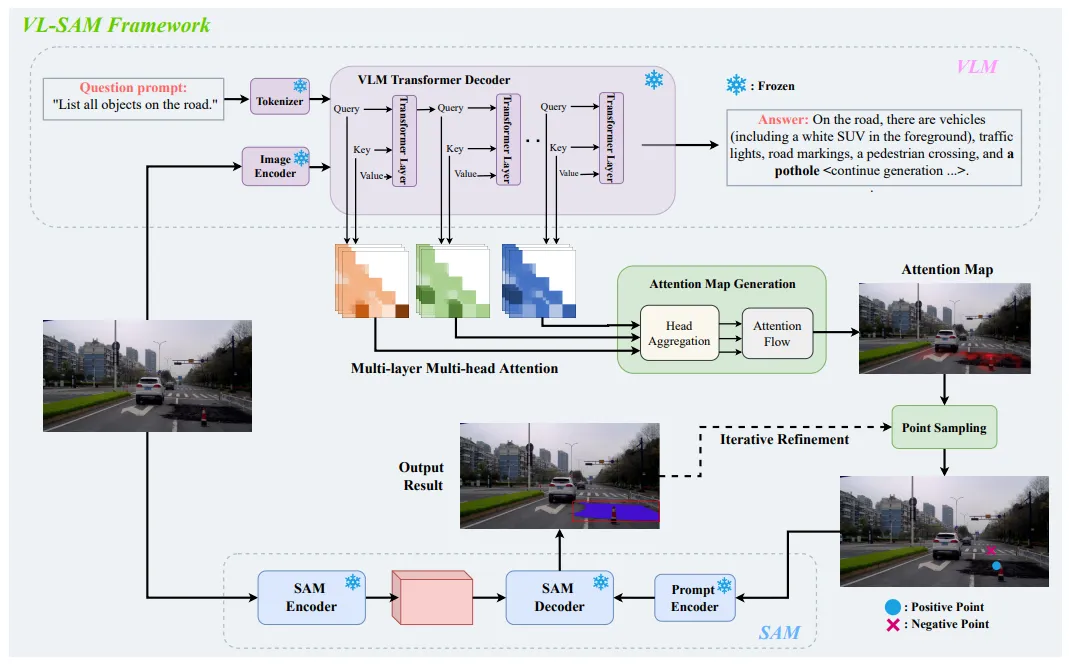

作者提出了 VL-SAM,一個(gè)無(wú)需訓(xùn)練的開放式目標(biāo)檢測(cè)和分割框架。具體框架如下圖所示:

圖 1 VL-SAM 框架圖

具體而言,作者設(shè)計(jì)了注意力圖生成模塊,采用頭聚合和注意力流的方式對(duì)多層多頭注意力圖進(jìn)行傳播,從而生成高質(zhì)量的注意力圖。之后,作者使用迭代式正負(fù)樣本點(diǎn)采樣的方式,從生成的注意力圖中進(jìn)行采樣,得到 SAM 的點(diǎn)提示作為輸入,最終得到物體的分割結(jié)果。

1、注意力圖生成模塊(Attention Map Generation Module)

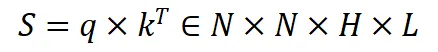

給定一張輸入圖片,使用 VLM 給出圖片中所有的物體類別。在這個(gè)過程中存儲(chǔ) VLM 生成的所有 query 和 key,并使用 query 和 key 構(gòu)建多層多頭注意力圖:

其中 N 表示 token 的數(shù)量,H 表示多頭注意力的數(shù)量,L 表示 VLM 的層數(shù)。

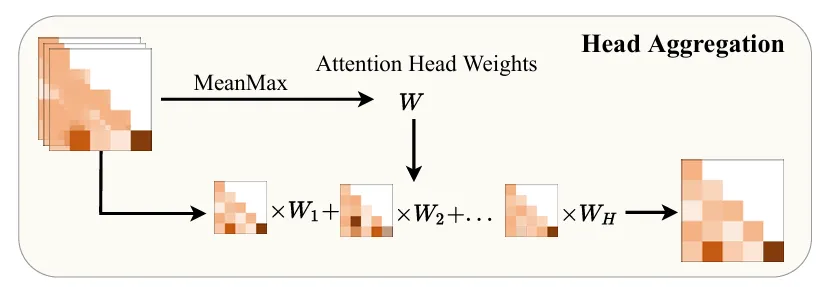

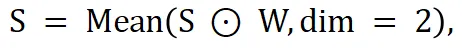

之后,采用 Mean-max 的方式對(duì)多頭注意力圖進(jìn)行聚合,如圖 2 所示:

圖 2 多頭注意力聚合

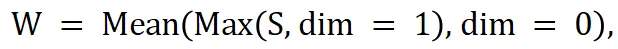

首先計(jì)算每個(gè)頭的注意力的權(quán)重:

之后采用基于權(quán)重的多頭注意力加權(quán)進(jìn)行信息聚合:

其中 表示矩陣點(diǎn)乘。

表示矩陣點(diǎn)乘。

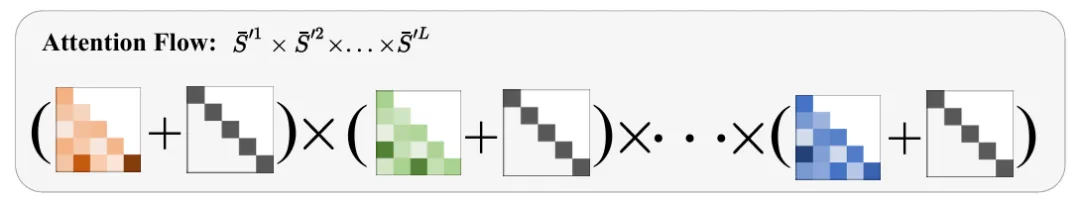

在聚合多頭注意力圖之后,采用注意力流的方式進(jìn)一步聚合多層注意力圖,如圖 3 所示

圖 3 注意力流

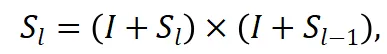

具體而言,采用 attention rollout 的方式,計(jì)算第 層到第

層到第 層的注意力圖傳播:

層的注意力圖傳播:

其中 表示單位矩陣。最后,作者僅使用傳播后的最后一層注意力圖作為最終的注意力圖。

表示單位矩陣。最后,作者僅使用傳播后的最后一層注意力圖作為最終的注意力圖。

2、SAM 提示生成

生成的注意力圖中可能會(huì)存在不穩(wěn)定的假陽(yáng)性峰值。為了過濾這部分假陽(yáng)性,作者首先采用閾值過濾的方式進(jìn)行初步過濾,并找到剩余激活部分的最大聯(lián)通區(qū)域作為正樣本區(qū)域,其余的部分作為負(fù)樣本區(qū)域。之后,采用峰值檢測(cè)的方式分別從正負(fù)樣本區(qū)域進(jìn)行采樣,得到正負(fù)樣本點(diǎn),作為 SAM 的點(diǎn)提示輸入。

3、迭代式分割優(yōu)化

從 SAM 得到分割結(jié)果可能會(huì)存在粗糙的邊界或者背景噪聲,作者采用兩種迭代式方式進(jìn)一步對(duì)分割結(jié)果進(jìn)行優(yōu)化。在第一種迭代方式中,作者借鑒 PerSAM 使用 cascaded post-refinement 的方式,將初始的分割結(jié)果作為額外的提示輸入到 SAM 中。對(duì)于第二種迭代方式,作者使用初始的分割結(jié)果對(duì)注意力圖進(jìn)行掩碼,之后在掩碼的區(qū)域進(jìn)行正負(fù)樣本點(diǎn)采樣。

4、多尺度聚合和問題提示聚合

作者還采用兩種聚合(Ensemble)的方式進(jìn)一步改良結(jié)果。對(duì)于 VLM 的低分率問題,作者使用多尺度聚合,將圖片切成 4 塊進(jìn)行輸入。此外,由于 VLM 對(duì)問題輸入較為敏感,作者采用問題提示聚合,使得 VLM 能夠盡量多得輸出物體類別。最后,采用 NMS 對(duì)這些聚合結(jié)果進(jìn)行過濾。

實(shí)驗(yàn)結(jié)果

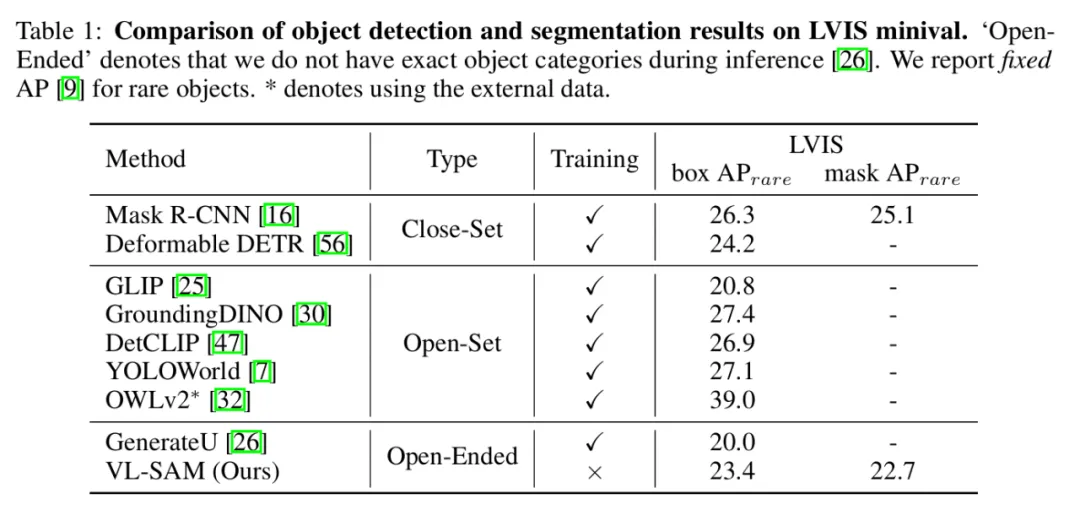

在包含 1203 類物體類別的長(zhǎng)尾數(shù)據(jù)集 LVIS 驗(yàn)證集上,相比于之前的開放式方法,VL-SAM 取得了更高的包圍框 AP 值。同時(shí),VL-SAM 還能夠獲取物體分割結(jié)果。此外,相比于開集檢測(cè)方法,VL-SAM 也取得了具有競(jìng)爭(zhēng)力的性能。

表 1 LVIS 結(jié)果

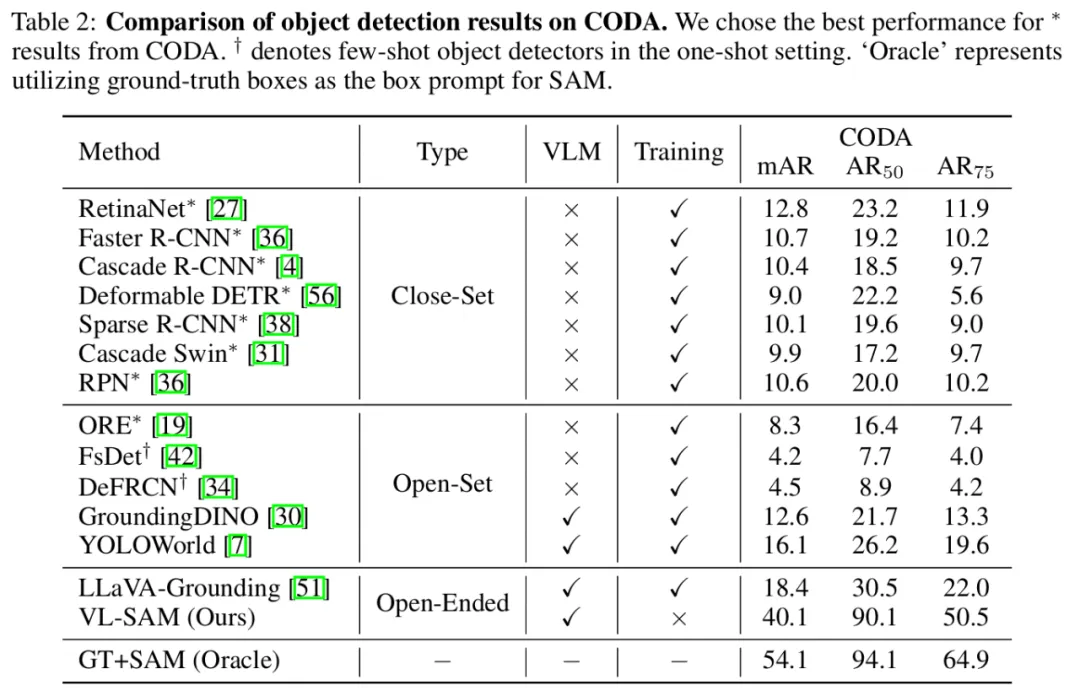

在自動(dòng)駕駛場(chǎng)景 corner case 數(shù)據(jù)集 CODA 上,VL-SAM 也取得了不錯(cuò)的結(jié)果,超過了開集檢測(cè)和開放式檢測(cè)的方法。

表 2 CODA 結(jié)果

結(jié)論

本文提出了 VL-SAM,一個(gè)基于注意力圖提示的免訓(xùn)練開放式目標(biāo)檢測(cè)和分割框架 VL-SAM,在無(wú)需訓(xùn)練的情況下,取得了良好的開放式 (Open-ended) 目標(biāo)檢測(cè)和實(shí)例分割結(jié)果。