YOLO-S:小目標(biāo)檢測(cè)的輕量級(jí)、精確的類YOLO網(wǎng)絡(luò)

本文經(jīng)計(jì)算機(jī)視覺(jué)研究院公眾號(hào)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

01 簡(jiǎn)介

小目標(biāo)檢測(cè)仍然是一項(xiàng)具有挑戰(zhàn)性的任務(wù),尤其是在為移動(dòng)或邊緣應(yīng)用尋找快速準(zhǔn)確的解決方案時(shí)。在下次分享中,有研究者提出了YOLO-S,一個(gè)簡(jiǎn)單、快速、高效的網(wǎng)絡(luò)。它利用了一個(gè)小的特征提取器,以及通過(guò)旁路和級(jí)聯(lián)的跳過(guò)連接,以及一個(gè)重塑直通層來(lái)促進(jìn)跨網(wǎng)絡(luò)的特征重用,并將低級(jí)位置信息與更有意義的高級(jí)信息相結(jié)合。

02 背景介紹

航空?qǐng)D像中的小目標(biāo)檢測(cè)已經(jīng)成為當(dāng)今研究的熱點(diǎn)。事實(shí)上,最近出現(xiàn)的無(wú)人機(jī)等數(shù)據(jù)賦能技術(shù)為廣泛的客戶群提供了一種具有成本效益的解決方案,根據(jù)相機(jī)軸、飛行器高度和使用的膠片類型,滿足了廣泛且?guī)缀鯚o(wú)限的用戶需求。

此外,來(lái)自衛(wèi)星或無(wú)人機(jī)傳感器的公開(kāi)可用車(chē)輛數(shù)據(jù)的日益可用性推動(dòng)了該領(lǐng)域的研究。然而,圖像中車(chē)輛的低分辨率、微小目標(biāo)的較差特征、車(chē)輛類型、尺寸和顏色的可變性,以及雜亂背景或干擾大氣因素的存在,仍然對(duì)卷積神經(jīng)網(wǎng)絡(luò)的車(chē)輛檢測(cè)率提出了挑戰(zhàn)。

此外,集裝箱、建筑物或路標(biāo)等令人困惑的物體的出現(xiàn)可能會(huì)增加誤報(bào)的可能性。此外,在準(zhǔn)確性和延遲時(shí)間之間進(jìn)行合理的權(quán)衡是必要的。主流的目標(biāo)檢測(cè)器需要大量?jī)?nèi)存,通常只能在集中式高性能平臺(tái)中執(zhí)行。特別地,two-stage檢測(cè)器不適合實(shí)時(shí)檢測(cè),而單級(jí)檢測(cè)器僅在強(qiáng)大的資源上提供實(shí)時(shí)性能。它們中沒(méi)有一個(gè)是為小目標(biāo)檢測(cè)而充分定制的。此外,由于數(shù)據(jù)處理成本更低、速度更快、與遠(yuǎn)程服務(wù)器的數(shù)據(jù)交換不可靠或存在安全和隱私問(wèn)題,許多工業(yè)應(yīng)用程序要求在靠近數(shù)據(jù)源的邊緣設(shè)備上本地部署CNNs,然而這種設(shè)備的特征通常是在性能、成本等方面硬件資源有限,并且不包括GPU。因此,快速和輕量級(jí)的CNNs是強(qiáng)制性的,同時(shí)即使在小目標(biāo)上也能保持令人滿意的準(zhǔn)確性。Tiny-YOLOv3不能保證足夠的性能,因?yàn)槠渲鞲商崛〉奶卣骱懿睿⑶移漭敵龀叨群艽植凇?/span>

其他研究工作則以準(zhǔn)確性換取速度。在[Research on Airplane and Ship Detection of Aerial Remote Sensing Images Based on Convolutional Neural Network]中,第四個(gè)輸出尺寸104×104被添加到Y(jié)OLOv3中,以減少感受野,在DOTA(航空?qǐng)D像中對(duì)象設(shè)計(jì)的數(shù)據(jù)集)的基礎(chǔ)上獲得了3%的mAP改進(jìn),盡管推理較慢。由于YOLOv3主要檢測(cè)規(guī)模為52×52的小目標(biāo)。[.In Proceedings of the International Conference on AI and Big Data Application]提出了基于兩個(gè)輸出52×52和104×104的YOLO-E,并實(shí)現(xiàn)了一個(gè)雙向殘差子模塊,以減少網(wǎng)絡(luò)深度。它們還通過(guò)用GIoU取代并集交集(IoU)度量,并在YOLOv3損失函數(shù)中添加新的項(xiàng)1-GIoU,提高了對(duì)目標(biāo)位置的敏感性。在VEDAI上,它獲得了91.2%的mAP,幾乎比YOLOv3準(zhǔn)確五分之一,慢6.7%。在[Robust Vehicle Detection in Aerial Images Based on Cascaded Convolutional Neural Networks]中,提出了一種基于VGG16架構(gòu)的級(jí)聯(lián)檢測(cè)器,其在VEDAI和Munich數(shù)據(jù)集上的性能優(yōu)于Faster R-CNN,但推理速度要慢20-30%。此外,低分辨率航空?qǐng)D像由于其外觀模糊性和與背景的相似性,使從車(chē)輛中提取有意義的特征變得更加困難。在[Joint-SRVDNet: Joint Super Resolution and Vehicle Detection Network]中,證明了兩個(gè)超分辨率和檢測(cè)網(wǎng)絡(luò)的聯(lián)合學(xué)習(xí)可以在超分辨率圖像中實(shí)現(xiàn)更有意義的目標(biāo)和更高的感知質(zhì)量,這又導(dǎo)致檢測(cè)任務(wù)的精度提高,并且在低分辨率航空?qǐng)D像上的性能接近于用相應(yīng)的高分辨率圖像饋送的現(xiàn)有技術(shù)方法。為了解決這個(gè)問(wèn)題,其提出了一種聯(lián)合超分辨率和車(chē)輛檢測(cè)網(wǎng)絡(luò)(Joint SRVDNet),該網(wǎng)絡(luò)利用了兩個(gè)相互關(guān)聯(lián)的超分辨率和檢測(cè)任務(wù)的互補(bǔ)信息。聯(lián)合SRVDNet由兩個(gè)主要模塊組成:用于4×上采樣因子的圖像超分辨率的多尺度MsGAN和用于車(chē)輛檢測(cè)的YOLOv3。具體而言,作者證明了兩個(gè)網(wǎng)絡(luò)的聯(lián)合學(xué)習(xí)允許在超分辨率圖像中獲得更有意義的目標(biāo)和更高的感知質(zhì)量,這反過(guò)來(lái)又提高了探測(cè)任務(wù)的準(zhǔn)確性,并提高了低分辨率航空?qǐng)D像的性能,接近于用相應(yīng)的高分辨率航空?qǐng)D像提供的現(xiàn)有最先進(jìn)的方法。

03 新框架詳細(xì)分析

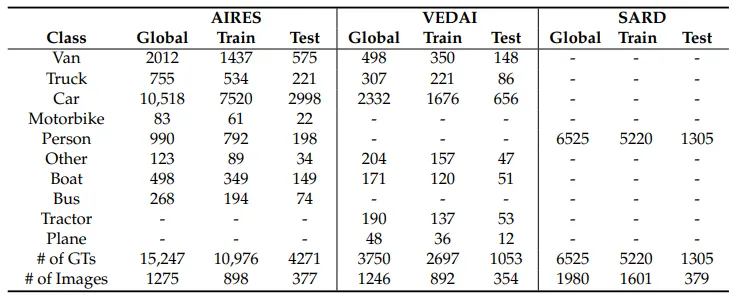

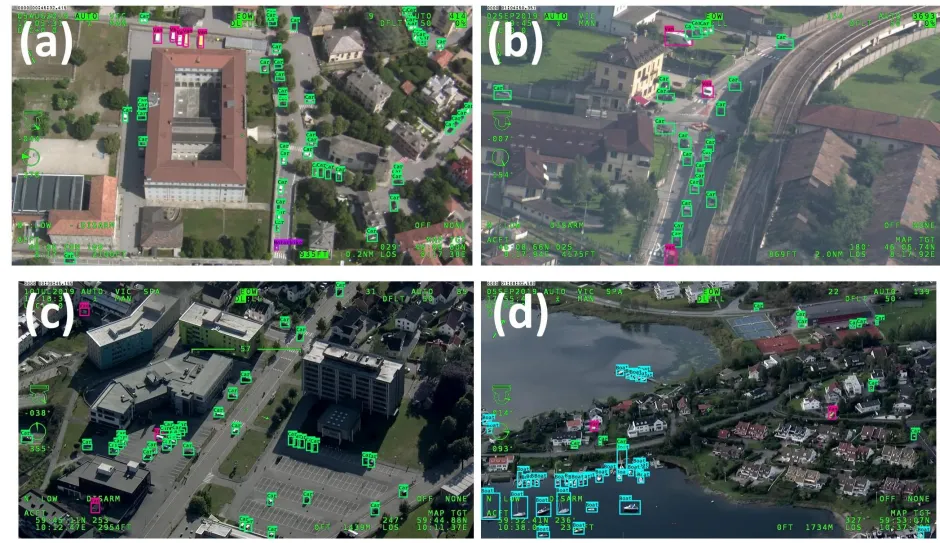

研究者介紹了AIRES(cAr detectIon fRom-hElicopter imagesS),這是一個(gè)新的車(chē)輛數(shù)據(jù)庫(kù),由1920×1080分辨率的航空全高清(FHD)圖像組成,由WESCAM MX-15 EO/IR成像系統(tǒng)傳輸,該系統(tǒng)放置在多傳感器四軸陀螺穩(wěn)定炮塔系統(tǒng)中,安裝在載人警用直升機(jī)AW169的前端。直升機(jī)在近300米至1000米的不同高度飛行,不同的攝像機(jī)角度從約5°至80°不等。這些圖像是2019年6月至9月在兩個(gè)不同的地理區(qū)域拍攝的:意大利北部的倫巴第大區(qū)和挪威的奧斯陸市。該數(shù)據(jù)集由1275張用LabelImg軟件[36]注釋的圖像組成,包含15247個(gè)注釋的地面實(shí)況(GT)對(duì)象,分為八類:面包車(chē)、卡車(chē)、汽車(chē)、摩托車(chē)、人、其他、船和公共汽車(chē)。統(tǒng)計(jì)數(shù)據(jù)匯總在表1中:大多數(shù)類別是汽車(chē),而人口較少的類別是摩托車(chē),占0.5%,其他類別占0.8%,后者包括推土機(jī)和建筑工地使用的其他地面移動(dòng)車(chē)輛。

Some images of the AIRES dataset

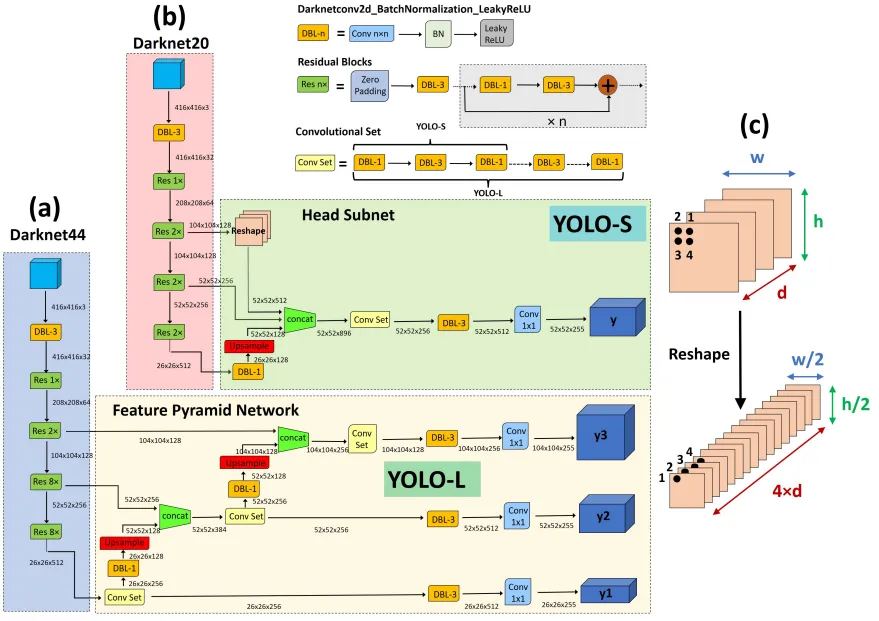

在這項(xiàng)工作中,提出了兩種新的類YOLO架構(gòu):YOLO-L和YOLO-S,其架構(gòu)如下圖所示。

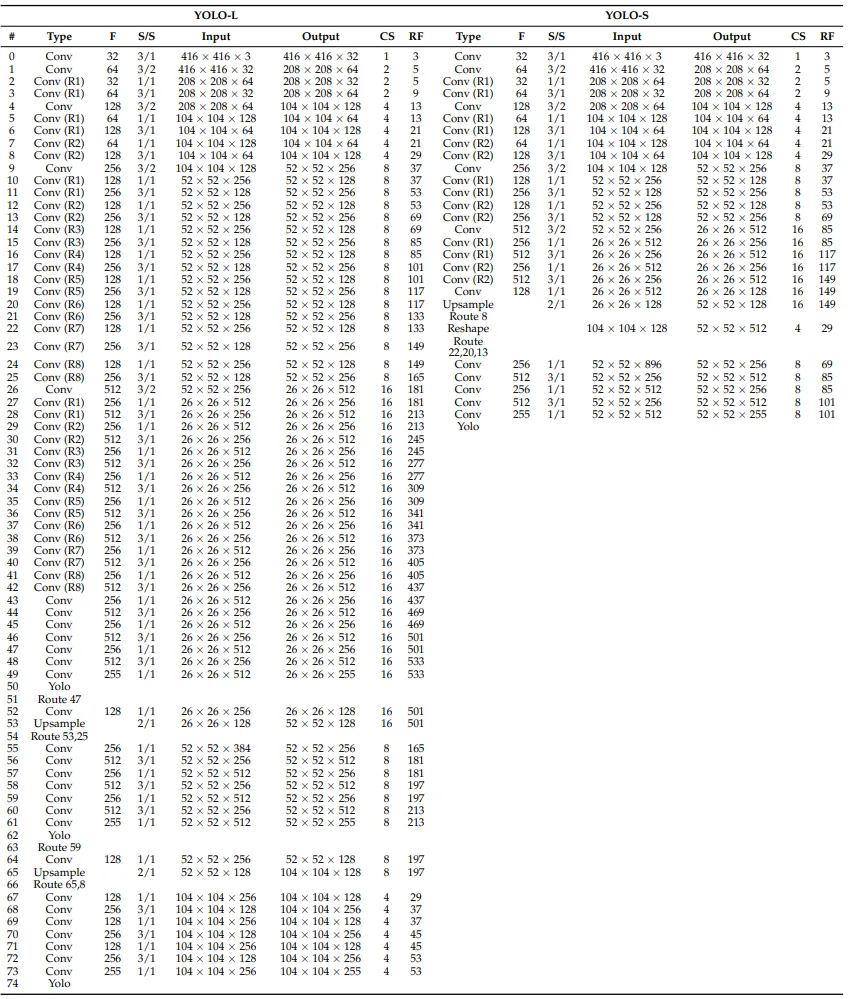

關(guān)于所提出的CNN的全部細(xì)節(jié)見(jiàn)下表,其中還報(bào)告了每層的感受野和累積步幅。假設(shè)輸入圖像的大小調(diào)整為默認(rèn)大小416×416。YOLO-L由于推理速度有限,僅適用于高功率硬件上的離線處理,因此主要用于基準(zhǔn)測(cè)試。YOLO-S,或YOLO-small,是為在邊緣設(shè)備上部署高效、輕量級(jí)和精確的網(wǎng)絡(luò)而提出的。

下表提供了進(jìn)一步的細(xì)節(jié),其中將所提出的網(wǎng)絡(luò)與其他最先進(jìn)的檢測(cè)器在參數(shù)數(shù)量、體積、BFLOP和架構(gòu)特性方面進(jìn)行了比較。

我們以YOLO-S為例,如上圖b所示,是一個(gè)微小而快速的網(wǎng)絡(luò),它利用圖c所示的特征融合和重塑穿透層的概念,將早期細(xì)粒度特征圖的精確位置信息與分辨率較低的深層特征圖的有意義語(yǔ)義信息相結(jié)合。基本上,它基于Darknet20主干,在特征提取階段用交錯(cuò)卷積層和殘差單元取代Tiny-YOLOv3的最大池化層,以減少下采樣期間的信息損失,并有效地增加感受野。由七個(gè)殘差塊組成的輕量級(jí)主干還可以避免對(duì)小規(guī)模檢測(cè)到的目標(biāo)進(jìn)行無(wú)用的卷積操作,否則在更深的架構(gòu)中,這可能會(huì)導(dǎo)致在多次下采樣后只剩下幾個(gè)像素的最終特征此外,YOLO-S采用了一個(gè)具有單個(gè)輸出規(guī)模52×52的head subnet和一個(gè)僅由4個(gè)交替卷積層1×1和3×3組成的較小卷積集,而不是YOLO-L和YOLOv3中的6個(gè),以加快推理。這導(dǎo)致輸出的感受野大到101×101,一旦源圖像被重新縮放到網(wǎng)絡(luò)預(yù)期的大小,就足以獲得目標(biāo)周?chē)幸饬x的上下文信息。

最后,通過(guò)橫向連接主干的第八層、第十三層和第十九層,分別對(duì)應(yīng)于4×、8×和16×下采樣的特征圖,實(shí)現(xiàn)了跳躍連接,以提取更穩(wěn)健的定位特征。由于這種特征圖表現(xiàn)出不同的分辨率,因此將上采樣應(yīng)用于第十九層,并將整形應(yīng)用于第八層,以在級(jí)聯(lián)之前將每個(gè)尺寸與形狀52×52相匹配。

總體而言,YOLO-S的模型體積比YOLOv3縮小了87%(YOLO-S尺寸僅為YOLOv3的7.9%),并且包含了近7.853M的可訓(xùn)練參數(shù),因此甚至比Tiny-YOLOv3輕10%。此外,它需要34.59個(gè)BFLOP,接近SlimYOLOv3-SPP3-50,幾乎是YOLOv3的一半,如上表所示。然而,在實(shí)驗(yàn)中,所提出的模型YOLO-S在準(zhǔn)確性方面優(yōu)于YOLOv3。

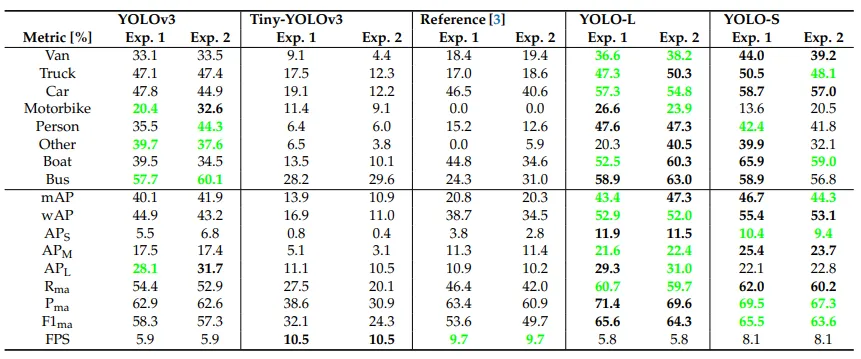

04 實(shí)驗(yàn)及可視化

首先,通過(guò)對(duì)每個(gè)類別進(jìn)行分層抽樣,在訓(xùn)練(70%)和測(cè)試(30%)中對(duì)數(shù)據(jù)集進(jìn)行隨機(jī)分割。然后,為了豐富模型學(xué)習(xí)過(guò)程中可用的統(tǒng)計(jì)信息,啟用了標(biāo)準(zhǔn)的數(shù)據(jù)增強(qiáng)技術(shù),包括水平翻轉(zhuǎn)、調(diào)整大小、裁剪和亮度、對(duì)比度、飽和度和色調(diào)的隨機(jī)失真。然而,由于缺乏數(shù)據(jù)而導(dǎo)致的過(guò)度擬合問(wèn)題往往無(wú)法通過(guò)數(shù)據(jù)擴(kuò)充方法得到有效解決,尤其是對(duì)于少數(shù)類。

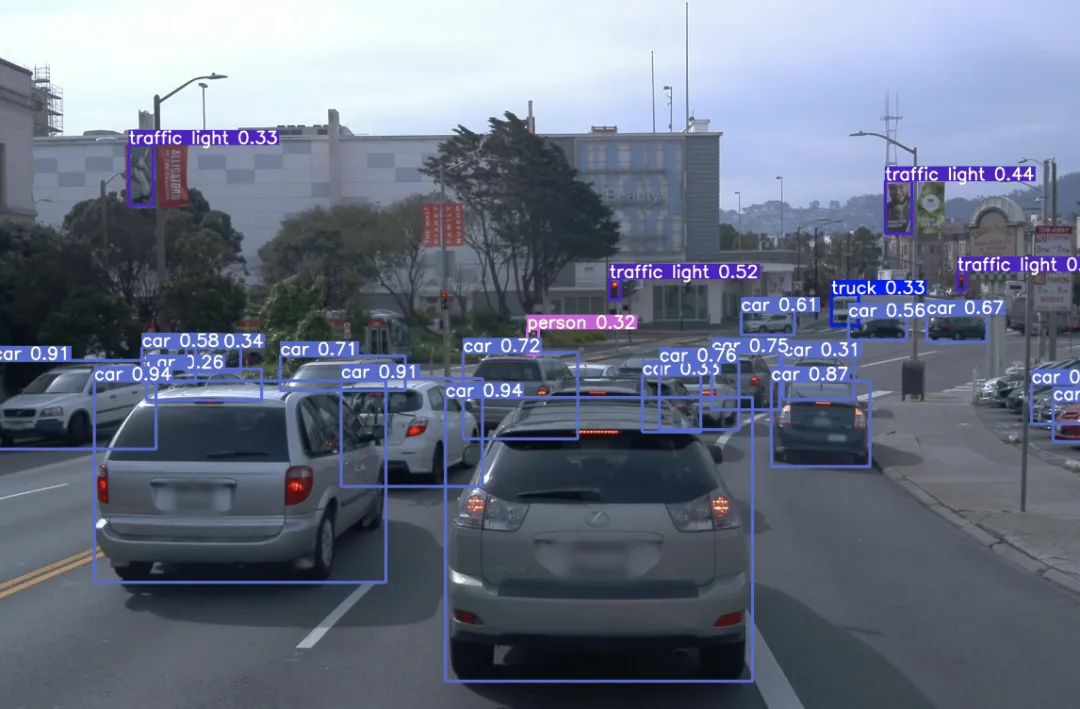

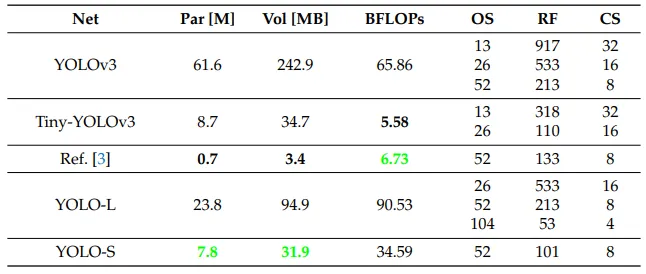

因此,采用了所謂的“遷移學(xué)習(xí)”技術(shù),以便利用可在公開(kāi)數(shù)據(jù)庫(kù)上獲得的知識(shí)。這對(duì)準(zhǔn)確性尤其有利:提取初步特征的基礎(chǔ)任務(wù)與感興趣的目標(biāo)任務(wù)越相似,可達(dá)到的準(zhǔn)確性就越高。具體如下圖:

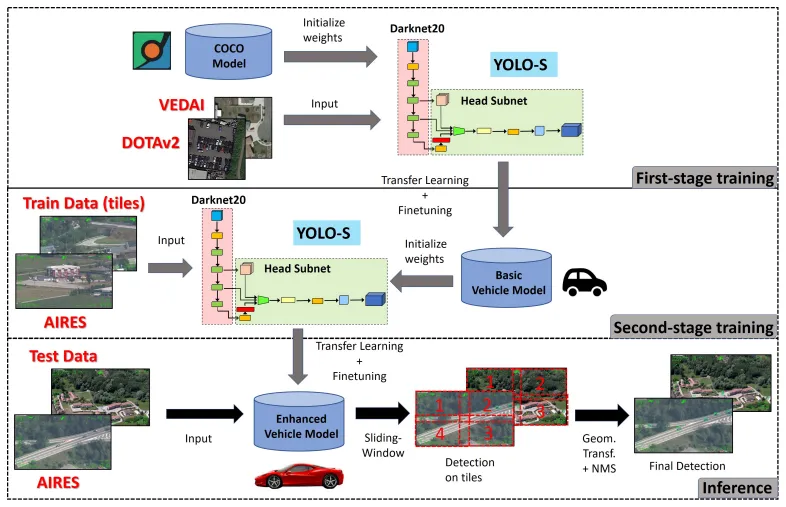

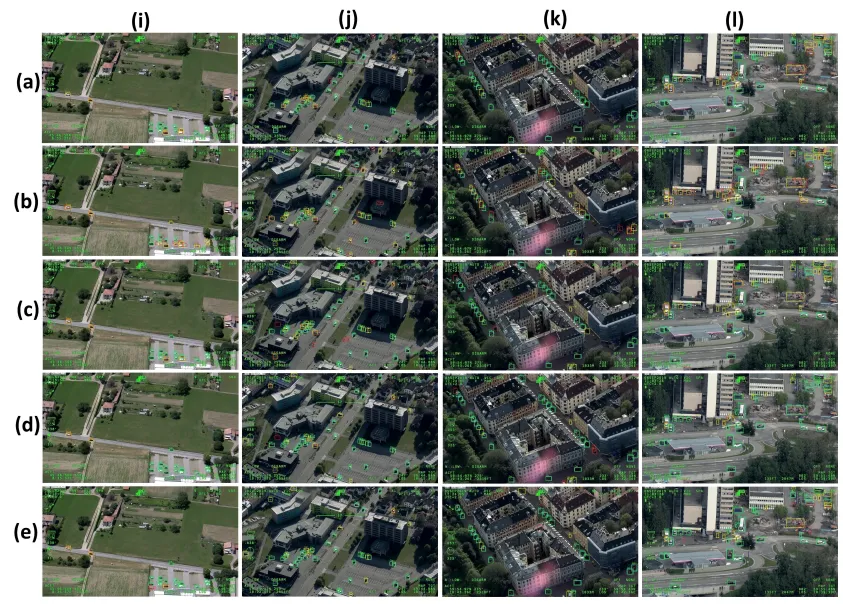

Comparative results of experiments 1 and 2 on AIRES dataset

(a) YOLOv3; (b) Tiny-YOLOv3; (c) [ A Simple and Efficient Network for Small Target Detection], (d) YOLO-L; (e) YOLO-S