深度解析RAG大模型知識沖突,清華西湖大學(xué)港中文聯(lián)合發(fā)布

本文章的作者為清華大學(xué)交叉信息院二年級碩士生許融武和一年級博士生祁澤涵,他們也是本篇綜述的的主要作者。

隨著人工智能和大型模型技術(shù)的迅猛發(fā)展,檢索增強生成(Retrieval-Augmented Generation, RAG)已成為大型語言模型生成文本的一種主要范式。這種技術(shù)的代表 —— 檢索增強的大型語言模型(Retrieval-Augmented Large Language Model, RALM)—— 能夠直接利用檢索得到的文檔信息進行內(nèi)容生成,無需進行額外的訓(xùn)練,這一優(yōu)勢使其在工業(yè)界得到了廣泛應(yīng)用,例如 New Bing 搜索引擎。

然而,自 2023 年起,RALM 在處理知識沖突方面面臨的問題逐漸成為研究的焦點。知識沖突不僅嚴(yán)重影響了模型在知識密集型任務(wù)上的性能,也暴露了其在面對錯誤信息時的脆弱性,進而對模型的安全性構(gòu)成威脅,尤其是在那些對事實準(zhǔn)確性有著嚴(yán)格要求的應(yīng)用場景中。知識沖突主要表現(xiàn)在模型內(nèi)部的參數(shù)化知識與外部上下文信息之間,以及外部上下文信息內(nèi)部的不一致性。此外,研究者還觀察到模型內(nèi)部參數(shù)化知識之間存在沖突,即出現(xiàn)自相矛盾的現(xiàn)象,這可能源于模型在預(yù)訓(xùn)練階段學(xué)習(xí)到了相互矛盾的信息。

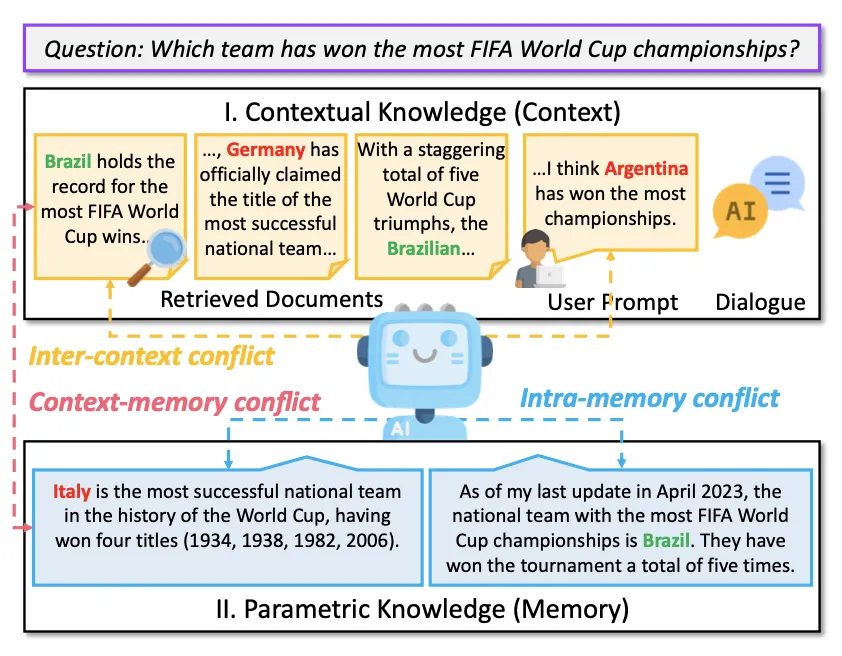

我們來看一個具體的例子:

在上面這個例子中,大模型接受了一個事實性問題:哪只隊伍在世界杯中獲得了最多次的冠軍?對于這個問題,一個 RALM 可能會檢索網(wǎng)絡(luò)上、向量數(shù)據(jù)庫內(nèi)的文檔,同時加上用戶之前的提示語組成的歷史對話記錄,共同形成了上下文知識(Contextual Knowledge, Context,在上圖用黃色予以標(biāo)出);與此同時,大模型在預(yù)訓(xùn)練中也看到了關(guān)于解答這個問題的信息,這些信息構(gòu)成了其參數(shù)化知識,又稱模型的 “記憶”(Parametric Knowledge,Memory,在上圖用藍色標(biāo)出)。根據(jù)沖突兩方信息的來源,我們便可 “兩兩(可重)組合” 劃分為以下三個類別:

- Context-Memory Conflict 即上下文和參數(shù)知識之間的沖突。例子 1:模型通過 Web 檢索獲取的知識是即時的,但學(xué)到的知識已經(jīng) “過氣”;例子 2:模型獲得了錯誤的假信息,與參數(shù)知識發(fā)生了沖突。

- Inter-Context Conflict 即上下文知識內(nèi)部的沖突。例子:通過 Web 檢索,獲得的信息因為發(fā)布的時間不同,或是混入了惡意的有誤信息而自相沖突。

- Intra-Memory Conflict 即參數(shù)化知識內(nèi)部的沖突。例子:對于事實性問答,模型在語義相同的提示一下被激發(fā)出不同結(jié)果的答案,產(chǎn)生出自相矛盾的效果。

知識沖突最早的文獻可以追溯到 Longpre 等人在 EMNLP 2021 的文章:Entity-based knowledge conflicts in question answering。這篇文章通過命名實體替換的方法在開放域問答(Open-Domain Question Answering)構(gòu)造了沖突的知識,并對當(dāng)時的語言模型進行了評測。隨著 2023 年大型語言模型的興起和 RAG 范式在工業(yè)界廣泛應(yīng)用,知識沖突的研究熱度逐漸升高,因其很大程度上降低了模型在關(guān)鍵任務(wù)上的表現(xiàn),特別是對真實性有要求的任務(wù)。

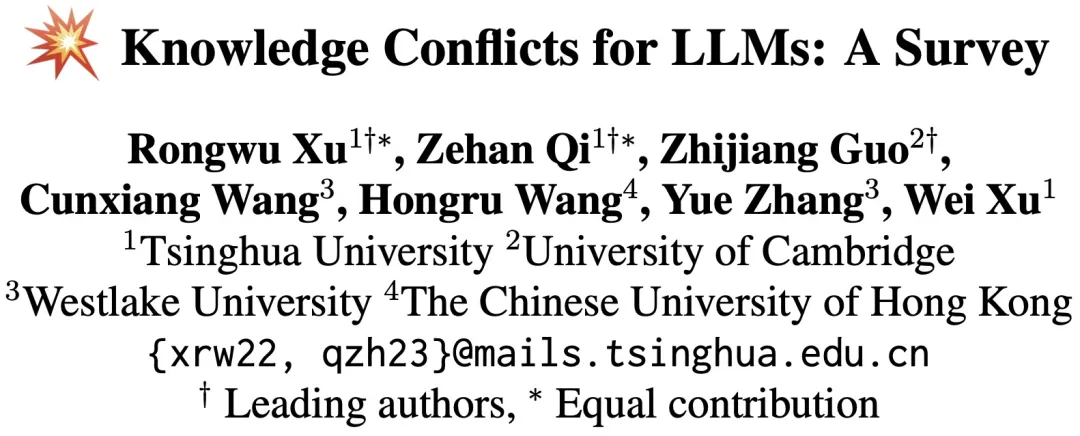

近期,來自清華大學(xué)、劍橋大學(xué)、西湖大學(xué)、香港中文大學(xué)的研究者聯(lián)合發(fā)布了一篇綜述,從起因、表現(xiàn)以及解決方案三個方面,對三種不同的知識沖突類型進行詳細探討,幫助讀者更好地理解和應(yīng)對這一挑戰(zhàn)。在我們看來,知識沖突既是導(dǎo)致各種模型下游表現(xiàn)的原因,也是從知識自身和模型知識學(xué)習(xí)中天然復(fù)雜性中呈現(xiàn)出的效果。

- 論文地址:https://arxiv.org/abs/2403.08319

- 項目地址:https://github.com/pillowsofwind/Knowledge-Conflicts-Survey

這篇綜述:

1. 首次系統(tǒng)性地總結(jié)了知識沖突領(lǐng)域的研究工作;

2. 全面分析了三種大模型可能遭遇的沖突類型,特別是對參數(shù)化知識沖突進行討論;

3. 我們不僅探討了每種沖突的分析,還從其 “生命周期” 的視角出發(fā),審視了沖突的起因、表現(xiàn)以及可能的解決策略。

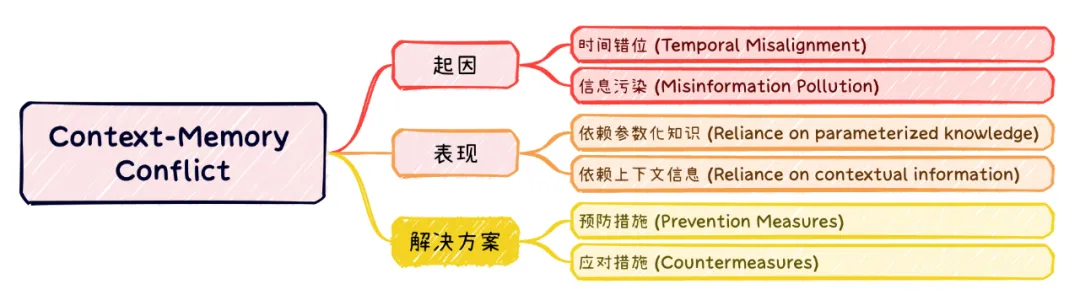

探索 Context-memory conflict:起因、表現(xiàn)與解決方案

起因

Context-Memory Conflict 的核心在于上下文信息與參數(shù)化知識之間的差異。這種沖突的起因主要分為兩個方面:時間錯位(Temporal Misalignment)和信息污染(Misinformation Pollution)。

1. 時間錯位(Temporal Misalignment)

時間錯位是指模型在訓(xùn)練過程中使用的歷史數(shù)據(jù)無法準(zhǔn)確反映當(dāng)前或未來的現(xiàn)實。這種現(xiàn)象在大語言模型中尤為明顯,因為這些模型通常在大量靜態(tài)數(shù)據(jù)上進行預(yù)訓(xùn)練,而這些數(shù)據(jù)可能在現(xiàn)實中已經(jīng)過時。例如,一篇關(guān)于 2020 年奧運會的文章在 2024 年可能已經(jīng)不再準(zhǔn)確,然而,模型可能依然依賴這些過時的信息進行預(yù)測和回答問題。研究表明,語言模型的性能會隨著時間的推移而下降,語言的使用方式、文化變化以及知識更新等都會影響模型對當(dāng)前信息的處理能力。

2. 信息污染(Misinformation Pollution)

信息污染是指外部信息中夾雜著錯誤或誤導(dǎo)性的信息,這些不準(zhǔn)確的數(shù)據(jù)會影響模型的判斷和決策能力。這種情況在互聯(lián)網(wǎng)時代尤為普遍,網(wǎng)絡(luò)上充斥著各種虛假信息、謠言以及故意編造的假新聞。惡意用戶可能通過在網(wǎng)絡(luò)上發(fā)布虛假信息,干擾模型的判斷。例如,惡意攻擊者可以在社交媒體上發(fā)布虛假的醫(yī)療信息,從而誤導(dǎo)依賴這些信息進行判斷的模型。信息污染不僅會影響模型的準(zhǔn)確性,還會破壞用戶對模型的信任。研究表明惡意的虛假信息會顯著削弱自動化事實核查系統(tǒng)和開放域問答系統(tǒng)的準(zhǔn)確性。

表現(xiàn)

當(dāng)面對 Context-Memory Conflict 時,模型的行為表現(xiàn)出顯著的復(fù)雜性和多樣性。以下是兩種表現(xiàn)形式:

1. 依賴參數(shù)化知識

一些模型在處理上下文與內(nèi)存矛盾時,往往會過度依賴其內(nèi)部的參數(shù)知識,而忽視外部提供的上下文信息。這種行為在早期的開放域問答(ODQA)研究中得到了驗證。Longpre 等人(2021)發(fā)現(xiàn) QA 模型在面對上下文信息與其內(nèi)部知識沖突時,傾向于依賴內(nèi)存知識。

2. 依賴上下文信息

另一方面,某些模型在面對外部證據(jù)時,即使這些證據(jù)與其內(nèi)部記憶相矛盾,也會傾向于采信外部證據(jù)。Chen 等人(2022)在 QA 模型上的實驗表明模型傾向于依賴上下文知識,與 Longpre 等人的發(fā)現(xiàn)形成對比,其解釋為 Longpre 構(gòu)造的沖突信息過于簡單。最近,Xie 等人(2023)通過操控大模型生成 “更符合邏輯” 的沖突上下文,發(fā)現(xiàn)大模型在面對外部證據(jù)時,即使這些證據(jù)與其參數(shù)知識相矛盾,也更傾向于信任外部證據(jù)。

解決方案

為了有效應(yīng)對 Context-Memory Conflict,研究人員提出了多種解決方案,這些方案主要分為在沖突發(fā)生前的預(yù)防措施(pre-hoc strategies)和沖突發(fā)生后的應(yīng)對措施(post-hoc strategies)。以下是幾種主要的解決方案:

1. 預(yù)防措施

- 持續(xù)學(xué)習(xí)(Continue Learning):通過持續(xù)預(yù)訓(xùn)練模型以納入新的和更新的數(shù)據(jù),從而減少時間錯位帶來的影響。例如,Lazaridou 等人(2021)建議通過持續(xù)預(yù)訓(xùn)練來更新模型的內(nèi)部知識,以跟上最新的信息。

- 知識編輯(Knowledge Editing):直接更新已訓(xùn)練模型的參數(shù)知識,以反映最新的信息。例如,De Cao 等人(2021)提出了一種知識編輯方法,旨在直接修改模型的內(nèi)部知識,以糾正錯誤或過時的信息。但是知識編輯的一個弊端是可能會導(dǎo)致模型出現(xiàn)內(nèi)在沖突的知識,即誘發(fā)后面我們提到的 intra-memory conflict。

2. 應(yīng)對措施

- 微調(diào)模型(Fine-Tuning):通過引入反事實和無關(guān)上下文等方法,加強模型對上下文的控制能力和魯棒性。例如,Li 等人(2022)提出的知識感知細調(diào)(KAFT)方法,通過在標(biāo)準(zhǔn)訓(xùn)練數(shù)據(jù)集中引入反事實和無關(guān)上下文,增強了模型在面對沖突信息時的魯棒性。

- 提示語技術(shù)(Prompting):通過專門設(shè)計的提示語策略,增強模型對上下文的依賴。例如,Zhou 等人(2023)提出了簡潔的 context-faithful prompting 的技術(shù),顯著提升了模型在上下文敏感任務(wù)中的表現(xiàn)。

- 知識插入(Knowledge Plug-in):通過插件模塊存儲更新的知識,確保原始模型不受影響。例如,Lee 等人(2022)提出的持續(xù)更新 QA(CuQA)方法,通過知識插件增強模型的知識更新能力,而不影響其原有參數(shù)。

- 解碼技術(shù)(Decoding):通過調(diào)整解碼策略,減少模型在知識沖突情況下生成幻覺的概率。例如,Shi 等人(2023)提出的上下文感知解碼(CAD)方法,通過放大輸出概率的差異,優(yōu)先考慮上下文信息,從而減少模型在沖突信息下的誤導(dǎo)。

通過結(jié)合這些預(yù)防和應(yīng)對措施,可以從不同角度提高模型在處理 Context-Memory Conflict 時的準(zhǔn)確性和魯棒性,從而提升模型在實際應(yīng)用中的表現(xiàn)和用戶體驗。

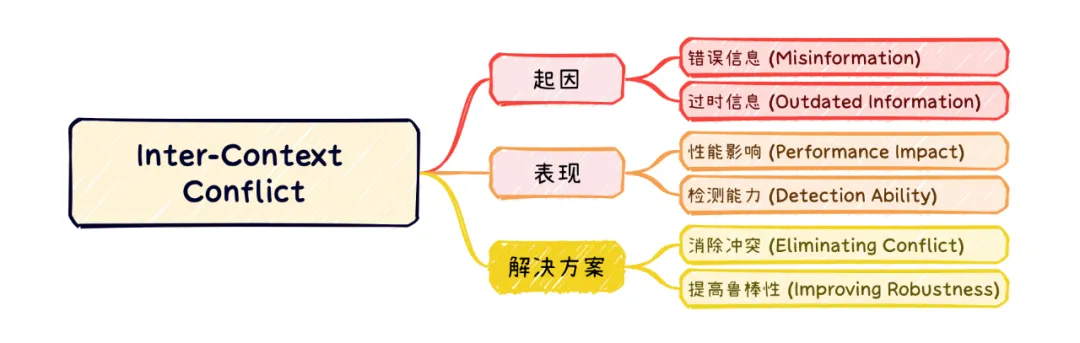

探索 Inter-Context Conflict:起因、表現(xiàn)與解決方案

起因

Inter-Context 沖突是指在不同外部信息整合過程中出現(xiàn)的矛盾,盡管這些外部信息能豐富大模型的回答,但也可能導(dǎo)致上下文之間的信息沖突。這種沖突的發(fā)生主要是因為外部信息中可能包含錯誤信息(Misinformation)和過時信息(Outdated Information)。

1. 錯誤信息(Misinformation)

檢索增強生成技術(shù)(RAG)通過整合外部信息來提升大模型的響應(yīng)質(zhì)量,然而這些外部信息可能含有虛假內(nèi)容。例如,可能會混入偽造新聞或由 AI 生成的誤導(dǎo)性內(nèi)容,導(dǎo)致檢索到的信息之間產(chǎn)生沖突。面對這些沖突,模型如何處理是一個重要挑戰(zhàn)。若不能有效解決這些沖突,可能導(dǎo)致模型生成的內(nèi)容不準(zhǔn)確,進而加劇虛假信息的傳播,進一步混淆信息。

2. 過時信息(Outdated Information)

隨著時間推移,事實會發(fā)生變化。大模型在檢索外部文件時,可能會遇到同時包含最新和過時信息的文檔。這種信息的時間差異會導(dǎo)致上下文之間的沖突。例如,關(guān)于某個事件的最新發(fā)展與過時的信息之間的矛盾,會影響模型的響應(yīng)準(zhǔn)確性。過時的信息不僅會使模型的回答變得不準(zhǔn)確,還可能導(dǎo)致用戶對模型失去信任。

表現(xiàn)

在面對 Inter-Context Conflict 時,大模型在被動和主動兩種角度下都表現(xiàn)出了特定的行為特征:

1. 性能影響(Performance Impact)

錯誤或過時信息會顯著影響大模型的性能。例如,Chen 等(2022)的研究也指出,當(dāng)模型在遇到矛盾的信息時,但它們更傾向于信任與問題直接相關(guān)的信息和模型內(nèi)部的參數(shù)知識。Pan 等(2023a)通過將偽造的維基百科文章插入真實的維基百科語料庫,發(fā)現(xiàn)現(xiàn)有語言模型在面對虛假信息攻擊時表現(xiàn)不佳。Xie 等(2023)的研究進一步揭示,大模型對與模型參數(shù)記憶一致的證據(jù)存在顯著偏好,尤其是當(dāng)這些證據(jù)涉及常見實體或得到大量文檔支持時。

2. 檢測能力(Detection Ability)

檢測上下文中的矛盾信息也是一項重要任務(wù)。Li 等(2023a)分析了 GPT-4、PaLM-2 和 Llama 2 在新聞、故事和維基百科文章中檢測矛盾文件的能力,結(jié)果顯示平均檢測準(zhǔn)確率較低。Wan 等(2024)的研究則揭示,現(xiàn)有模型在評估文檔可信度時,往往高度依賴與查詢相關(guān)的文檔內(nèi)容,但忽略了人類認為重要的文體特征,如科學(xué)引用或中立的語氣。Jin 等人(2024a)發(fā)現(xiàn)大模型偏愛在上下文中出現(xiàn)頻率最高的證據(jù),并對與其內(nèi)部記憶一致的外部信息表現(xiàn)出明顯傾向。

解決方案

為了有效應(yīng)對 Inter-Context Conflict,研究人員從多種角度提出了解決方案,這些方案主要分為消除沖突(Eliminating Conflict)和提高魯棒性(Improving Robustness)兩個方面,從主動和被動兩個角度解決 Inter-Context Conflict。

1. 消除沖突(Eliminating Conflict)

- 專用模型(Specialized Models):專門訓(xùn)練一個模型來更好地處理特定類型的沖突。如 Pielka 等(2022)建議在學(xué)習(xí)過程中加入語言學(xué)知識,通過引入語法和語義特征來增強對矛盾信息的識別,以提高模型對矛盾檢測的能力。

- 通用模型(General Models):使用通用模型來完成沖突消除。Chern 等(2023)提出了一個整合了多種工具(如 Google Search、Google Scholar 等)的事實核查框架,用于檢測文本中的事實錯誤。這種方法不僅依賴于模型的內(nèi)部知識,還結(jié)合了外部檢索到的信息,提供更為全面的事實驗證。

2. 提高魯棒性(Improving Robustness)

- 訓(xùn)練方法(Training Approach):從訓(xùn)練算法上提升模型在面臨沖突上下文時的魯棒性。Hong 等(2023)提出了一種新的微調(diào)方法,通過同時訓(xùn)練判別器和解碼器來提高模型的魯棒性。這種方法不僅可以提高模型在面對沖突信息時的穩(wěn)定性,還能增強其處理復(fù)雜信息的能力。

- 查詢增強(Query Augmentation):在推理階段通過進一步引入外界知識來提升模型的魯棒性。Weller 等(2022)提出了一種查詢增強技術(shù),提示 GPT-3 從原始查詢中提取新的問題,通過生成多個與原始問題相關(guān)的查詢,模型可以從多個角度驗證答案的正確性,從而減少由于單一信息源導(dǎo)致的錯誤。這種方法不僅提高了模型應(yīng)對沖突信息的能力,還增加了其回答的準(zhǔn)確性和可靠性。

Inter-Context Conflict 是知識沖突中的重要一環(huán)。大模型如何處理相互沖突的信息是一個關(guān)鍵任務(wù)。通過上述方法,可以從不同角度提高模型在處理 Inter-Context Conflict 時的準(zhǔn)確性和魯棒性。

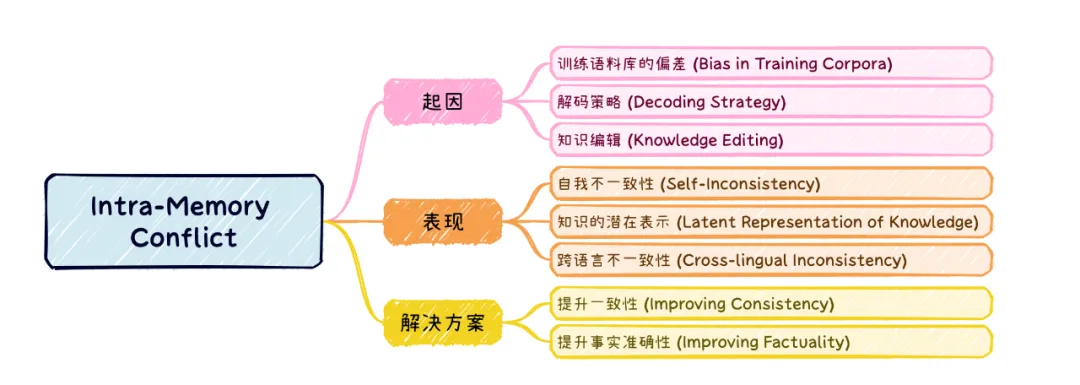

探索 Intra-Memory Conflict:起因、表現(xiàn)與解決方案

起因

Intra-Memory Conflict 是指模型在面對語義相同但句法不同的輸入時,表現(xiàn)出不一致的行為。這種沖突的主要原因可以分為以下幾個方面:

1. 訓(xùn)練語料庫的偏差(Bias in Training Corpora)

LLMs 的主要知識獲取階段是在預(yù)訓(xùn)練期間完成的,而這些預(yù)訓(xùn)練數(shù)據(jù)通常是從互聯(lián)網(wǎng)上抓取的。這些數(shù)據(jù)來源廣泛,包括社交媒體、新聞文章、百科全書等,其質(zhì)量參差不齊,可能包含不準(zhǔn)確或誤導(dǎo)性的信息。這些錯誤信息會被模型記住并在推理時放大,導(dǎo)致模型內(nèi)的知識出現(xiàn)沖突,這會導(dǎo)致模型在回答相關(guān)問題時出現(xiàn)多種相互矛盾的答案。同時,大模型存在對訓(xùn)練數(shù)據(jù)的表面關(guān)聯(lián)進行編碼的情況,這會導(dǎo)致模型依據(jù)表面的虛假相關(guān)性進行判斷。由于對虛假相關(guān)性的依賴,當(dāng)遇到句法結(jié)構(gòu)不同但語義相同的提示時,模型可能會給出不同的答案。

2. 解碼策略(Decoding Strategy)

大模型的輸出是通過對可能的下一個詞進行概率分布采樣而得出的。不同的采樣方法(如貪心采樣、top-p 采樣、top-k 采樣等)會導(dǎo)致生成內(nèi)容的隨機性。例如,在使用 top-k 采樣時,模型會從概率最高的 k 個候選詞中隨機選擇下一個詞,這種隨機性增加了輸出的不確定性,使得相同的輸入在不同次推理中可能得到不同的結(jié)果。

3. 知識編輯(Knowledge Editing)

為了高效地修改大模型中的知識,研究人員提出了知識編輯技術(shù)。這些技術(shù)旨在高效地修改模型中小范圍的知識,而不需要重新訓(xùn)練整個模型。然而,這些編輯方法可能導(dǎo)致知識的一致性難以保證。例如,通過知識編輯修改某一事實(如某一科學(xué)發(fā)現(xiàn)的具體細節(jié)),但未能同步更新與之相關(guān)的所有知識,可能導(dǎo)致模型在面對不同問題時產(chǎn)生不一致的響應(yīng)。同時,修改后的知識可能無法有效地在不同情境下應(yīng)用,從而導(dǎo)致模型在處理同一知識的不同表達時產(chǎn)生不一致的回答。

表現(xiàn)

Intra-Memory Conflict 會對大模型的表現(xiàn)產(chǎn)生顯著影響,主要體現(xiàn)在以下幾個方面:

1. 自我不一致性(Self-Inconsistency)

自我不一致性是指模型在面對語義等價但句法不同的問題時,生成的回答不一致。例如,研究表明,即便是 GPT-4 這樣的先進模型,在處理常識性問題時,仍然有 13% 的回答存在不一致性。這意味著用戶提出同樣的問題,但換種說法時,可能會得到不同的回答。另一方面,模型在回憶知識時,可能更多依賴于訓(xùn)練數(shù)據(jù)中詞語的表面關(guān)聯(lián),而不是對知識的真正理解。例如,一個模型可能會錯誤地關(guān)聯(lián)某些高頻共現(xiàn)的詞語,導(dǎo)致生成的回答偏離預(yù)期。這種錯誤關(guān)聯(lián)進一步加劇了模型回答的自我不一致性。

2. 知識的潛在表示(Latent Representation of Knowledge)

大模型內(nèi)部的多層 Transformer 架構(gòu)導(dǎo)致不同層次存儲著不同的知識表示。這種分散的知識表示會導(dǎo)致模型在生成過程中無法準(zhǔn)確表達已經(jīng)存儲的知識。例如,淺層次可能存儲的是低級信息,而深層次存儲的是語義信息。這種多層表示的分散導(dǎo)致模型在面對不同問題時,可能無法協(xié)調(diào)不同層次的知識,進而產(chǎn)生不一致的回答。

3. 跨語言不一致性(Cross-lingual Inconsistency)

由于大模型在不同語言中維護著不同的知識集合,這導(dǎo)致了跨語言的一致性問題。例如,同一個事實在不同語言中可能會得到不同的回答,這種現(xiàn)象在跨語言知識問答中尤為明顯。例如,一個在英語中訓(xùn)練的模型可能會對某個事實有準(zhǔn)確的回答,但在西班牙語中卻給出不同的答案。

解決方案

針對內(nèi)部記憶沖突,研究人員提出了多種解決方案,主要可以分為以下幾類:

1. 提升一致性(Improving Consistency)

- 微調(diào)(Fine-tuning):通過引入一致性損失函數(shù),并結(jié)合標(biāo)準(zhǔn)的語言模型訓(xùn)練損失,進行微調(diào),提升模型的知識一致性。例如,Li 等人(2023)則利用模型生成的回答對其進行驗證,篩選出一致性較高的回答對進行微調(diào),進一步提升生成的答案的一致性。

- 插件(Plug-in):通過模塊插入的整合方法提高模型的一致性。例如,Jang 和 Lukasiewicz(2023)提出通過利用字典中的詞義對模型進行訓(xùn)練,增強其對符號意義的理解。然后將這些增強的參數(shù)與現(xiàn)有語言模型的參數(shù)合并從而提高模型的一致性。

- 輸出集成(Output Ensemble):通過對多次輸出進行綜合,從而獲得一個最正確的答案。Mitchell 等人(2022)提出了這種雙模型架構(gòu),通過評估答案間的邏輯一致性來選擇最可信的最終答案,減少模型生成的不一致性。

2. 提升事實準(zhǔn)確性(Improving Factuality)

提升模型響應(yīng)的真實性,從而減少模型自身不一致的發(fā)生。例如,Li 等人(2023)提出了一種知識探測方法,通過識別模型參數(shù)中包含的真實知識,并在推理階段沿著這些真實知識相關(guān)的方向調(diào)整激活,從而減少生成過程中的事實錯誤。

內(nèi)部記憶沖突是 LLMs 研究中的一個重要挑戰(zhàn),解決這一問題需要從訓(xùn)練、生成和后處理等多個階段入手。雖然目前的解決方案已經(jīng)在一定程度上緩解了這一問題,但仍有許多挑戰(zhàn)需要克服。

討論 1:模型應(yīng)當(dāng)如何響應(yīng)沖突?

理想情況下,模型在遇到知識沖突時應(yīng)能夠識別沖突并提供明確的答案。然而,研究發(fā)現(xiàn)現(xiàn)有模型在識別沖突存在方面表現(xiàn)較好,但在確定具體沖突段落并生成有區(qū)分的答案方面仍存在挑戰(zhàn)。另一方面,有些研究者認為我們不應(yīng)該將 “處理沖突” 的任務(wù)完全丟給大模型代表的 AI,而是應(yīng)該將這個權(quán)力掌握在人類手中。

討論 2:當(dāng)前挑戰(zhàn)和后續(xù)研究方向

1. 實際環(huán)境中的知識沖突:

研究應(yīng)關(guān)注知識沖突在現(xiàn)實世界中自然發(fā)生的情況,如在從網(wǎng)絡(luò)直接檢索文檔的檢索增強語言模型(RALMs)中。應(yīng)盡量減少人為創(chuàng)造知識沖突,以更好地反映實際應(yīng)用。

2. 更精細的解決方案:

需要更細致的解決方案,考慮用戶查詢的性質(zhì)、沖突信息的來源和用戶期望。解決方案應(yīng)針對不同類型的沖突(如錯誤信息、過時信息或主觀問題)進行定制,認識到問題和潛在解決方案的廣泛性。

3. 下游任務(wù)評估:

未來的研究應(yīng)超越常見的問答數(shù)據(jù)集,評估知識沖突對更廣泛應(yīng)用的影響。這包括需要高準(zhǔn)確性和一致性的領(lǐng)域,如法律文檔分析、醫(yī)療診斷、財務(wù)分析和教育工具。

4. 沖突之間的相互作用:

研究不同類型沖突(如內(nèi)部記憶沖突和上下文記憶沖突)之間的相互作用是至關(guān)重要的。理解這些關(guān)系可能揭示大模型中知識表示和處理的機制,從而開發(fā)更強大的模型。

5. 可解釋性:

需要對大模型內(nèi)部機制(如沖突期間的注意力頭或神經(jīng)元激活)進行更微觀的檢查。這將有助于理解模型在遇到?jīng)_突時如何做出決策,并開發(fā)如路徑修補剪枝的沖突解決方法。

6. 多語言性:

研究應(yīng)探索非英語提示和跨語言的知識沖突。這包括非英語中的知識沖突,以及不同語言的多個文檔的上下文沖突。

7. 多模態(tài)性:

隨著大模型處理多種格式(文本、圖像、視頻、音頻)的發(fā)展,未來研究應(yīng)關(guān)注多模態(tài)環(huán)境中的沖突。開發(fā)能夠跨多種數(shù)據(jù)類型進行跨模態(tài)推理和沖突解決的先進 LLMs 是必要的。