打通智能體「自我進化」全流程!復旦推出通用智能體平臺AgentGym

AI通用智能體的自我進化能力,并非遙不可及。

LLM-based Agent,已經不再需要人類監督者的幫助,開始實現「自我進化」!

這個智能體在學習了專家軌跡以后,獲得了基礎的通用能力,能夠在更廣泛、更真實的未知環境與任務上進行探索和學習,在外部的反饋下不斷提升自己。

最近,復旦大學語言與視覺團隊推出的 AgentGym 平臺,打通了大語言模型智能體「數據采樣、訓練微調、自我進化、能力評測」全流程。基于該平臺提出的 AgentEvol 算法,首次探索了通用智能體的自我進化能力,并在多項智能體任務上表現非凡,與 GPT-4、Claude 等 SOTA 模型比肩。

- 論文鏈接:https://arxiv.org/abs/2406.04151

- AgentGym代碼倉庫:https://github.com/WooooDyy/AgentGym

研究背景

開發一個能夠解決和適應復雜工作的多任務通用智能體,一直是人工智能社區長久以來的重要目標。

類似于人類的學習過程,通用智能體首先通過模仿,開始學習最基礎的知識和技能。

隨著基礎能力的掌握,我們不僅期望智能體可以通過與不同環境的交互,持續學習和適應許多先前未見的任務,還能從自身經驗以及外部反饋中汲取豐富的智慧,發展出一定程度的泛化能力(圖1)。

圖1:基礎通用智能體實現「自我進化」的示意圖。該智能體首先在人類監督下進行行為克隆,隨后在不同的外部環境和任務中進行探索和學習,以實現自我進化。

大語言模型憑借其卓越的通用能力,被視為構建此類智能體的重要基礎之一。目前的研究領域正沿著兩個主要方向進行探索,以推動智能體技術的進一步發展。

- 依賴于人類監督的行為克隆(Behavior Cloning)方法,需要智能體逐步模仿專家提供的軌跡數據。這種方法雖然有效,但由于標注資源的限制,難以擴展。對環境的探索也較為有限,容易遇到性能或泛化性的瓶頸。

- 允許智能體根據環境反饋,不斷提高能力的自我改進(Self Improving)方法,減少了對人類監督的依賴,同時豐富對環境的探索深度。然而,它們通常在特定任務的孤立環境中進行訓練,得到一批無法有效泛化的專家智能體。

面對上述挑戰,作者首次探討了一個具備基礎能力的通用智能體——在多種環境和任務中——自我進化的潛力。

為了實現這一研究目標,作者確定了推動智能體自我進化的「三大關鍵支柱」,這些支柱是研究的核心要素。

- 多樣化的環境和任務,允許智能體動態且全面地進行交互、訓練,而不是被局限于某個孤立的環境。

- 一個適當大小的軌跡數據集,幫助智能體配備基本的指令遵循能力和基礎任務知識。

- 一種有效且可擴展的進化算法,激發智能體在不同難度環境中的泛化能力。

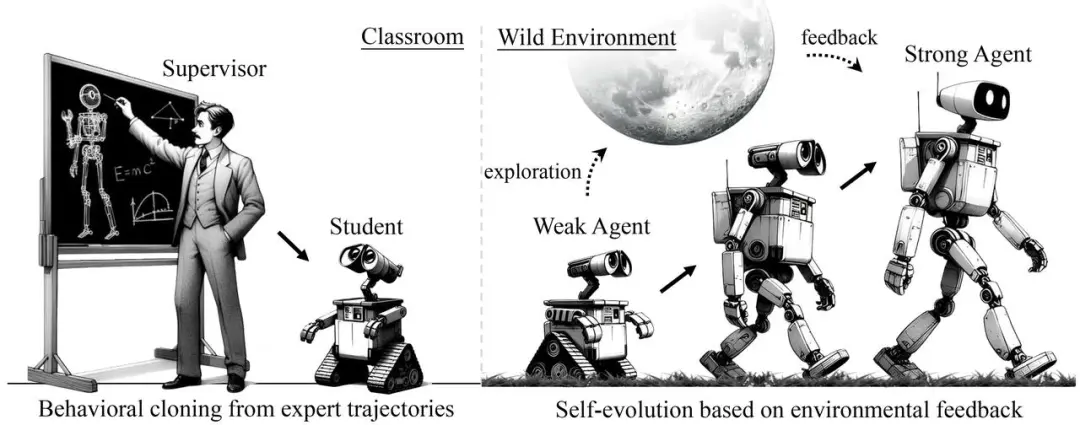

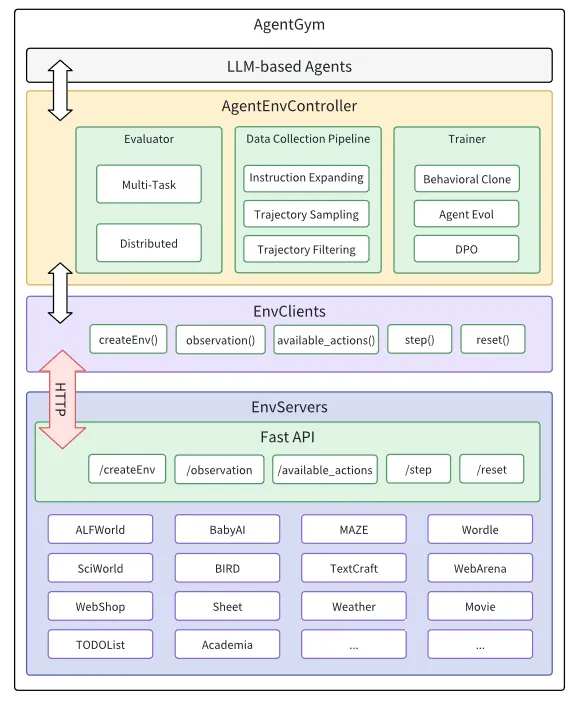

圖2:AgentGym 平臺示意圖。平臺共涵蓋了 14 個跨越不同類別的環境,每個環境都作為 HTTP 服務部署。客戶端為智能體提供封裝好的統一接口,便于與環境互動。通過 AgentEvol 方法,作者探索了智能體在不同環境和任務中的自我進化。此外,平臺提供了測試集 AgentEval 對智能體進行全面的能力評估。

圍繞這三大支柱,作者的研究工作體現在以下幾個方面:

- 「AgentGym」,一個包含 14 種具體環境,89 種具體任務類型的交互平臺(圖2),為大語言模型智能體訓練提供支持。該平臺基于 HTTP 服務,為不同環境提供了一個統一的 API 接口,支持軌跡采樣、多輪交互、在線評估和實時反饋。

- 「AgentEval」,一個具有挑戰性的智能體測試基準。「AgentTraj」和「AgentTraj-L」,通過指令增強和眾包 / SOTA 模型標注構建的專家軌跡數據集。經過格式統一和數據過濾,幫助智能體學習基本的復雜任務解決能力。

- 「AgentEvol」,一種激發智能體跨環境自我進化的全新算法。該算法的動機在于,期望智能體在面對先前未見的任務和指令時進行自主探索,從新的經驗中進行學習與優化。

AgentGym 平臺,是一個全新的,支持大語言模型智能體軌跡采樣、自我進化、能力評測的框架,特點是提供多樣、實時、并發和統一格式的反饋。旨在幫助人工智能社區更便利地探索具備通用能力的 LLM-based 智能體。

AgentGym——交互式訓練與評測一體化的智能體平臺

AgentGym 集成了多種環境、豐富的軌跡數據和全面的基準測試。它通過統一的環境操作接口,簡化了環境配置過程。具體而言,AgentGym 擁有以下特點:

多樣化的環境:

AgentGym 包含 14 種環境和 89 項任務,涵蓋了網頁導航、文字游戲、具身控制、工具使用和代碼等類別。無論是致力于構建 Task-specific Agent,還是通用型的 Generally-capable Agent,AgentGym 框架均能提供對應的支持。

其中,每個環境獨立部署,避免了不同環境間的依賴沖突,確保了平臺的可擴展性。例如,WebShop 環境,一個用于網絡購物任務的交互式平臺,僅通過一行命令,即可輕松完成部署。

數據驅動:

AgentGym 的軌跡數據采用了統一的 ReAct 格式,該格式通過「Thought-Action」對將推理步驟和行動序列結合,圖 2左上方提供了一個軌跡數據的示例。

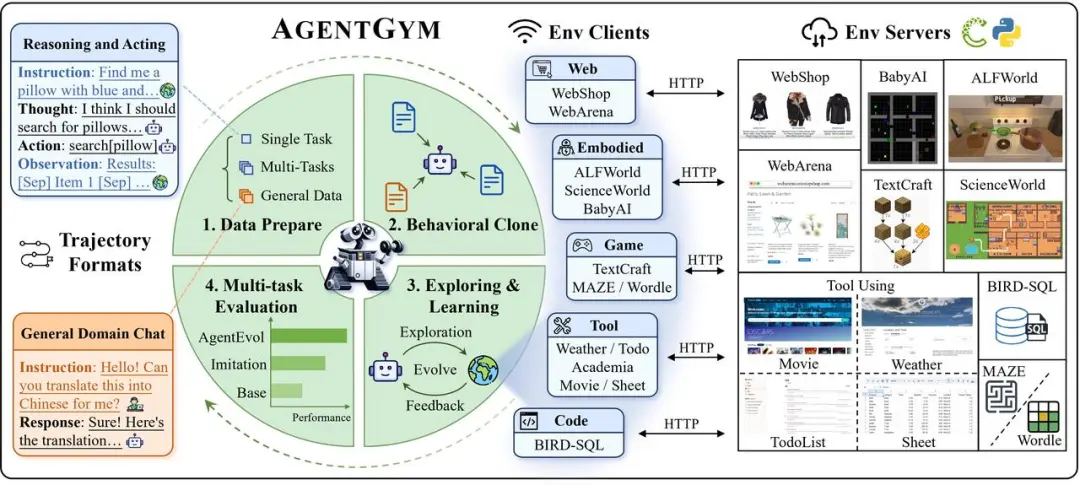

平臺通過廣泛收集和增強指令,構建了具有 20509 條指令的集合,并從中挑選出 1160 條具有多樣性的指令,構建了基準測試集 AgentEval,用于全面評估基于 LLM 的智能體。

同時,作者使用 GPT-4-Turbo 和眾包標注收集軌跡數據,并基于獎勵或正確性嚴格篩選,構建了 6130 條高質量軌跡的集合 AgentTraj。為了展現行為克隆方法的性能潛力,研究者進一步擴展,得到包含 14485 條軌跡的 AgentTraj-L。

圖3:AgentGym 平臺 14 種環境的統計數據(涵蓋任務類型數量、指令集規模、評估集規模、軌跡集規模及平均交互輪數)。

模塊化的架構與高效的 Pipeline:

AgentGym 平臺采用模塊化設計,開發者可以輕松添加或更改環境。環境被部署在不同的服務器(EnvServers)上,通過 HTTP 服務實現靈活、高效的交互。客戶端(EnvClients)封裝了與環境交互所需的函數,提供了相應的操作接口。

而核心組件 AgentController 作為智能體和環境的中間媒介,提供了優化智能體策略的訓練器(Trainer),以及支持多環境的性能評估器(Evaluator)。統一的操作接口簡化了智能體與環境的交互,使用戶能夠專注于算法優化和智能體訓練。

圖4:AgentGym 平臺架構概覽。

獨特優勢:

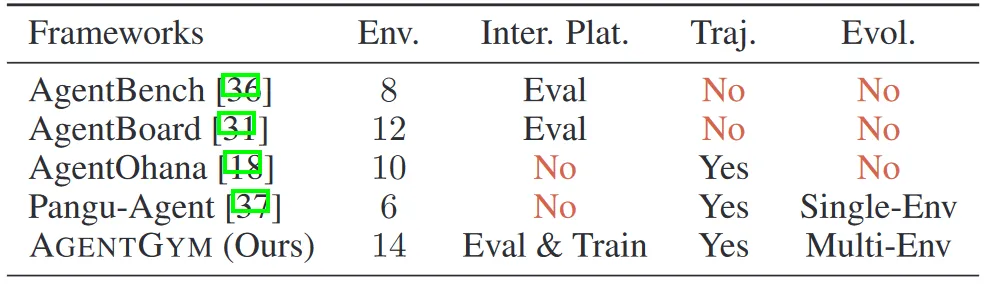

與其他框架相比,AgentGym 的優勢在于它不僅提供了廣泛的環境集合,還通過交互平臺為智能體提供實時的環境反饋,支持智能體的訓練與評估。同時,AgentGym 支持在多個環境中實現智能體的「全面進化」,這極大地增強了智能體的泛化能力,使其在不同任務和環境中都能表現出色。

圖5:AgentGym 與其他代理框架的比較。

AgentEvol——通用智能體進化算法

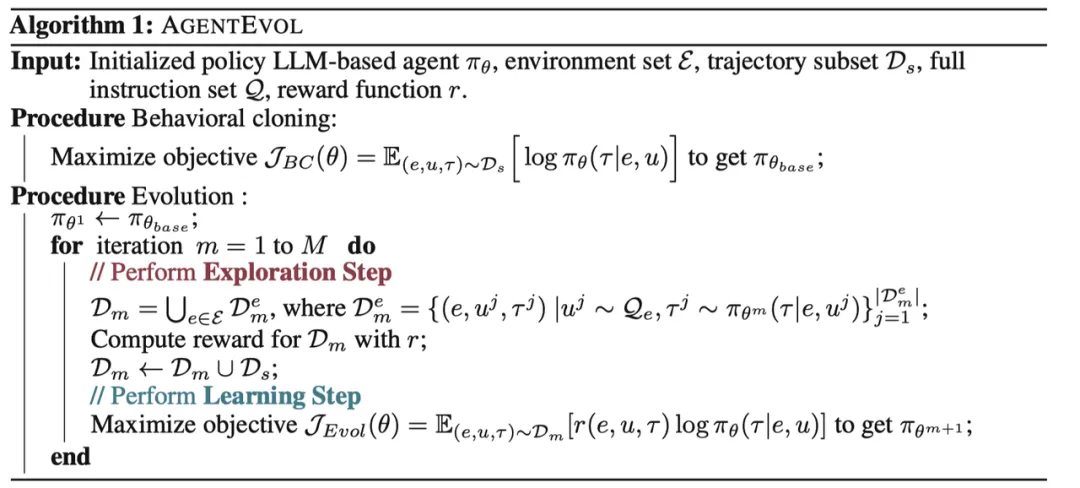

基于 AgentGym 套件,研究者們可以容易地對智能體進行采樣、訓練與評測。而復旦語言與視覺團隊為了探究具有通用智能體的在「自我進化」的潛力,提出了 AgentEvol 算法(圖6),幫助智能體在多環境、多任務下實現了各項能力的提升。這一算法的核心思想是讓智能體通過探索和學習來提升自己的性能,特別是在面對之前未見過的任務和指令時。

圖6:AgentEvol 算法框架

AgentEvol 首先基于收集到的 AgentTraj 軌跡數據集,通過「行為克隆(behavioral cloning)」的形式訓練一個「基礎通用智能體(base generally-capable agent)」,使其具備基本的指令遵循能力和必要的先驗知識。在這個過程中,智能體一步一步地模仿專家的軌跡,包括思考過程(thought)和行動(action)。

接著,這一基礎通用智能體與不同的環境交互,完成自我進化。它面對來自不同環境的、更多樣化的指令與查詢(Instructions and queries),逐漸提升自己完成各項任務的能力。

這一過程受到機器學習中 RL as Inference 方法的啟發,它將交互強化學習視為一個概率推斷問題(具體推導與解釋見原文)。這種方法與傳統的強化學習方法不同,它不是直接尋找最大化期望回報的軌跡,而是首先定義一個關于軌跡的最優策略分布,然后通過迭代過程來優化這個分布。

具體而言,該過程包括兩個交替進行的步驟:

- 「探索步驟(Exploration Step)」:在這一步驟中,智能體在當前策略下與環境進行交互,生成新的軌跡并評估其獎勵,形成一個估計的最優策略分布。具體而言,智能體與多個環境進行交互,生成一系列的行為軌跡。每條軌跡都是智能體根據當前策略與環境互動的產物,包括智能體的思考,智能體的行為,以及環境的觀測。然后,環境端會根據軌跡與任務目標的匹配程度,為每條軌跡給出獎勵信號。

- 「學習步驟(Learning Step)」:在這一步驟中,智能體根據估計的最優策略分布更新參數,使其更加接近于最優策略。具體而言,智能體利用在探索步驟中收集到的軌跡與獎勵數據,通過一個基于軌跡獎勵加權的優化目標函數來優化自己。注意,在學習步驟中,為了減少過擬合,作者優化的總是「基礎通用智能體」,而不是上一輪優化得到的智能體。

通過交替探索和學習步驟,AgentEvol 算法逐步優化智能體,顯著提升其在多環境下的能力,實現「自我進化」的目標。

實驗介紹

任務概述:

本研究通過 AgentGym 框架對智能體進行了一系列的跨環境探索和進化實驗。實驗旨在評估基礎智能體在多樣化環境中進行自我探索和進化的能力。為此,作者采用更廣泛的指令集來擴展智能體的探索空間。

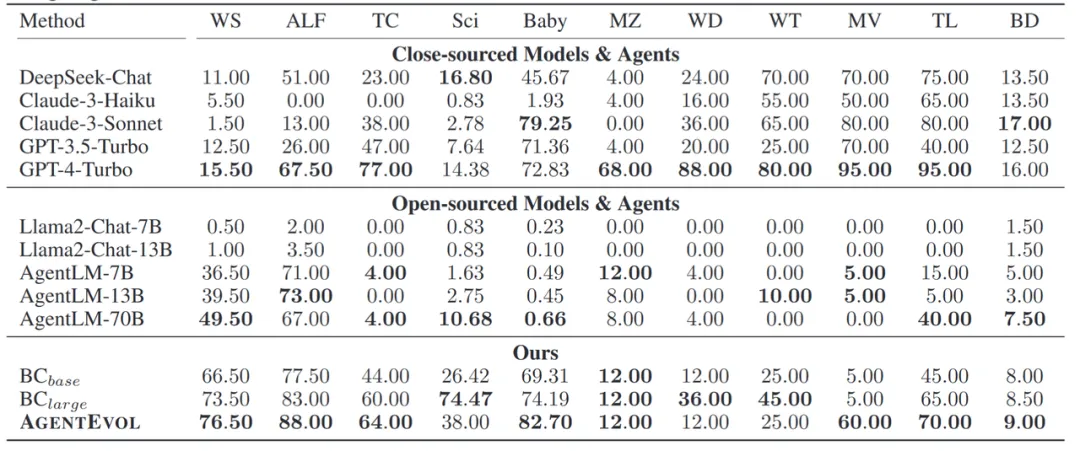

主要結果:

在 11 個不同環境中,使用 AgentTraj 數據集訓練的智能體 展示了良好的基礎交互能力。

展示了良好的基礎交互能力。

進一步,通過在更大的AgentTraj-L 數據集上實施行為克隆,智能體  實現了顯著的性能提升。

實現了顯著的性能提升。

而本文提出的 AgentEvol 方法,盡管在初始階段僅基于有限的專家數據,但通過交替的探索和學習步驟,智能體能夠在未見過的探索集上做出正確決策,實現自我進化。在多個智能體任務上,AgentEvol 方法超越了  和其他 SOTA 模型。

和其他 SOTA 模型。

這一發現揭示了智能體具有適應和解決更復雜任務的潛力,為開發更高級的通用智能體提供了堅實的基礎。

圖7:多任務環境下各種模型和智能體的性能對比

分析實驗:

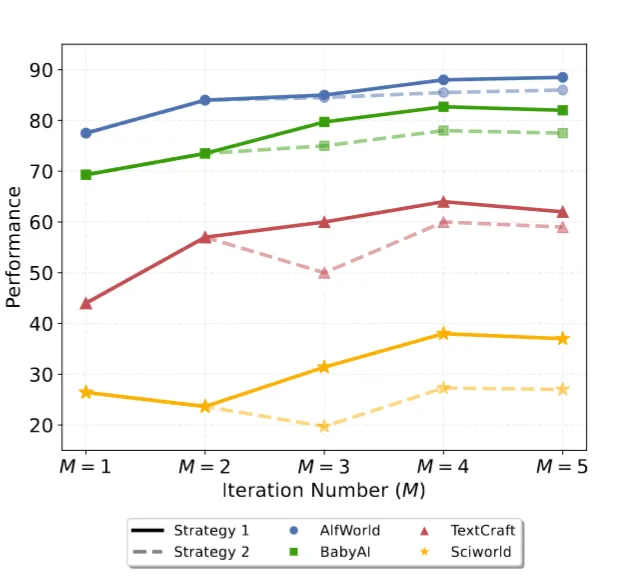

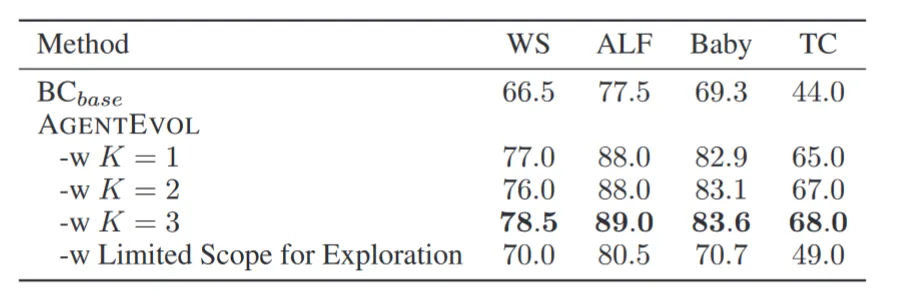

該團隊還從四個角度展開了一系列的消融實驗:(1) 數據合并策略;(2) 進化迭代次數;(3) 探索范圍;(4) 采樣次數。

實驗發現,將智能體當前生成的軌跡與初始專家軌跡集合并,能帶來更穩定的性能提升。相應地,利用前一迭代的探索軌跡,可能導致過擬合,出現性能的波動。

隨著進化過程中迭代次數 M 增加,性能提升,但最終會趨于穩定和收斂。

圖8:數據合并策略和迭代次數的消融實驗

在 AgentEvol 探索過程中,通過對每個指令執行采樣,生成多樣化的軌跡促進了智能體的學習。

而將智能體的探索范圍限制在已知的指令集內,也就是進行有限空間的探索,可能會限制 AgentEvol 的性能進一步提升。

圖9:采樣數目與探索范圍的消融實驗

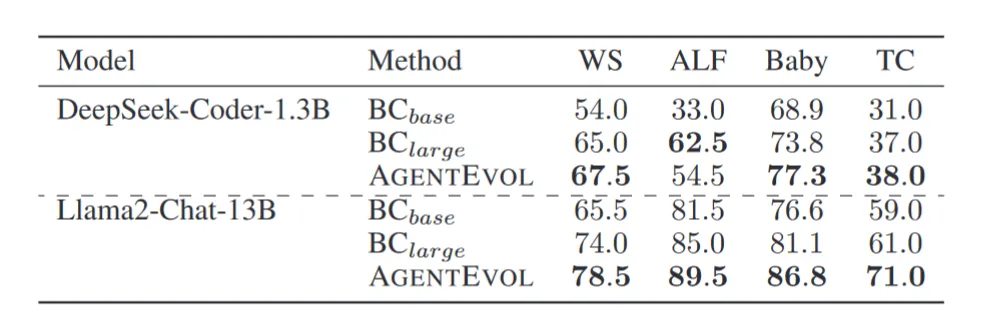

此外,研究者還在不同的基座模型上進行實驗。結果表明, AgentEvol 方法在不同規模的模型上均表現出色。

圖10:不同基座模型上的性能比較

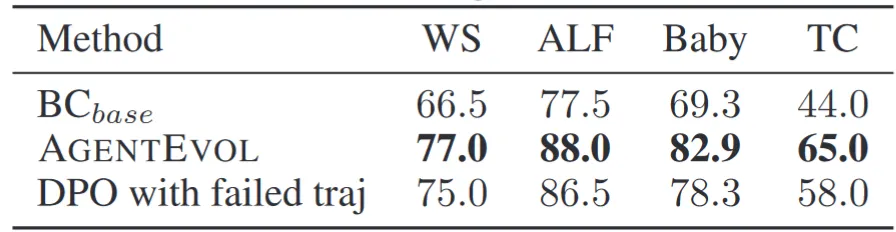

文章還探討了在通用智能體的進化過程中,成功與失敗的經驗軌跡是否都能發揮作用。

實驗采用直接偏好優化 DPO (Direct Preference Optimization) 方法,基于探索過程中的「成功-失敗」軌跡進行訓練。結果表明,智能體能夠在多任務的場景下,從錯誤經驗中學習,但其整體性能仍然不如 AgentEvol 方法。

圖11:基于成功和失敗軌跡的 DPO 訓練

復旦大學自然語言處理實驗室,是由復旦大學首席教授吳立德先生創建,是我國最早開展自然語言處理和信息檢索研究的實驗室之一。在國家自然科學基金、國家863/973/重點研發計劃、省部委基金的支持下,發表了大量高水平國際期刊和會議論文。實驗室在學術帶頭人黃萱菁教授的帶領下,圍繞大模型前沿方向,在語言大模型、多模態大模型、大模型對齊、智能體等方面開展系統深入的研究,產生了MOSS、眸思等一系列有較大學術影響的工作,并與國內外科技領軍企業建立密切的合作關系。

復旦大學視覺與學習實驗室由姜育剛教授創立,現有教師7人,在讀碩博士研究生80余人,已畢業研究生30余人。實驗室主要從事計算機視覺和多模態人工智能理論與應用的研究,旨在研發準確、快速、可擴展和值得信賴的 AI 算法,讓機器具備像人一樣的學習、感知和推理的能力。實驗室承擔了科技創新2030—“新一代人工智能”重大項目、國家自然科學基金重點基金、國家重點研發計劃課題、上海市科技創新行動計劃等國家和地方的重要科研項目,以及華為、騰訊、百度等企業的技術攻關需求。