太酷了!手機上部署最新AI大模型!只需兩步!

在當前的AI革命中,大模型扮演著至關重要的角色,而這背后的基礎便是Scaling Law。簡而言之,隨著數據、參數和計算能力的不斷提升,大模型的能力也隨之增強,展現出小規模模型所無法比擬的“涌現能力”。越來越多的AI企業紛紛推出開源大模型,按照擴展定律實現指數級的增長,為AI領域的發展注入了新的活力和動力。

然而,另一個不可忽視的趨勢是,大型模型的體積正在逐漸縮小,這為私有化部署提供了可能。這一趨勢對于個人隱私保護要求較高的場景尤為重要。通過無需聯網傳輸數據,直接在設備上運行的AI技術,我們可以增強用戶的信任感。盡管云服務器上的AI可能具備更高的性能,但其安全性和可靠性卻令人擔憂。因此隨著模型體積的減小,私有化部署將成為更加可行和受歡迎的選擇。

本文介紹幾個適合私有化部署的最新大模型,并提供部署指導,手把手部署到電腦及手機。

一、開源大模型

熱門的大模型如ChatGPT和Bard受限于專有閉源技術,限制了其應用并模糊了技術透明度。相比之下,開源AI大型模型(LLMs)如Meta的Llama 3和微軟的Phi3,不僅增強了數據安全和隱私保護,還降低了成本、減少了外部依賴,并實現了代碼透明和模型定制。這些“小而美”的開源模型便于部署,預示著AI技術將更為開放、透明和靈活。

1、Llama 3

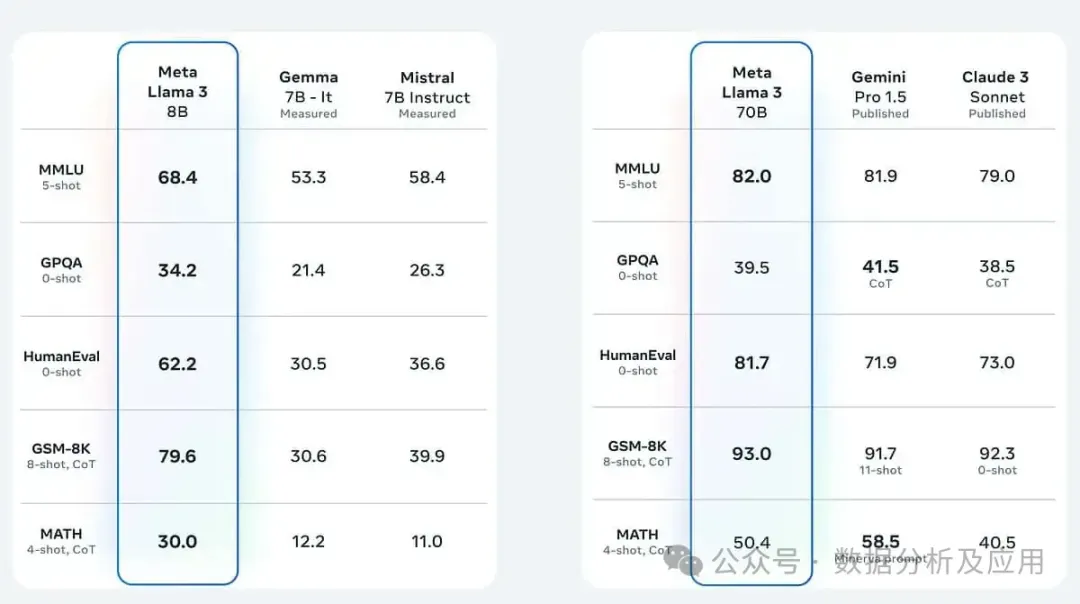

近期,Meta發布了開源Llama 3 8B和Llama 3 70B模型,Meta稱它們是同體量下性能最佳的開源模型。基準測試顯示,Llama 3 400B+實力與Claude和新版GPT-4 Turbo相當,在頂尖模型中占據重要地位。

模型鏈接:https://llama.meta.com/llama-downloads/

GitHub項目地址:https://github.com/meta-llama/llama3

2. Phi-3

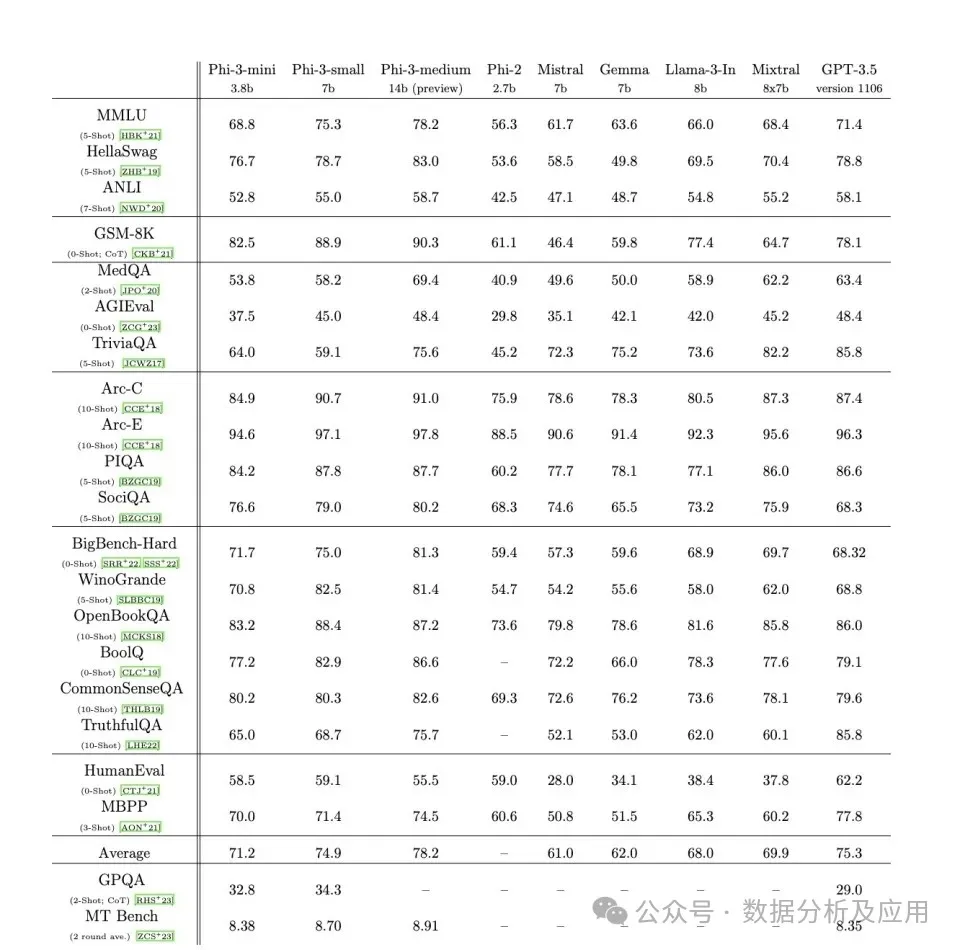

Phi是微軟AI研究院的新開源小型語言模型,專為商業環境設計,小巧高效。它包括Mini、Small和Medium三種規模。Phi-3-Mini雖有3.8B參數,但在關鍵測試中表現出色,與大型模型如Mixtral 8x7B和GPT-3.5相當。更大版本在擴展數據集下表現更佳。

Phi-3 技術報告:《一個能跑在手機上的大模型》https://arxiv.org/abs/2404.14219

小結

基準測試顯示,Llama 3 8B和Phi3 3.8B小模型表現優異。在小規模參數的背后,還有相似的優化方法。由于大型模型性能的關鍵在于框架、數據和參數。小參數下使用MOE框架意義不大,因此這兩個模型注重數據優化,提高數量和質量,這也為精簡大型模型指明了方向。

二、電腦部署的流程

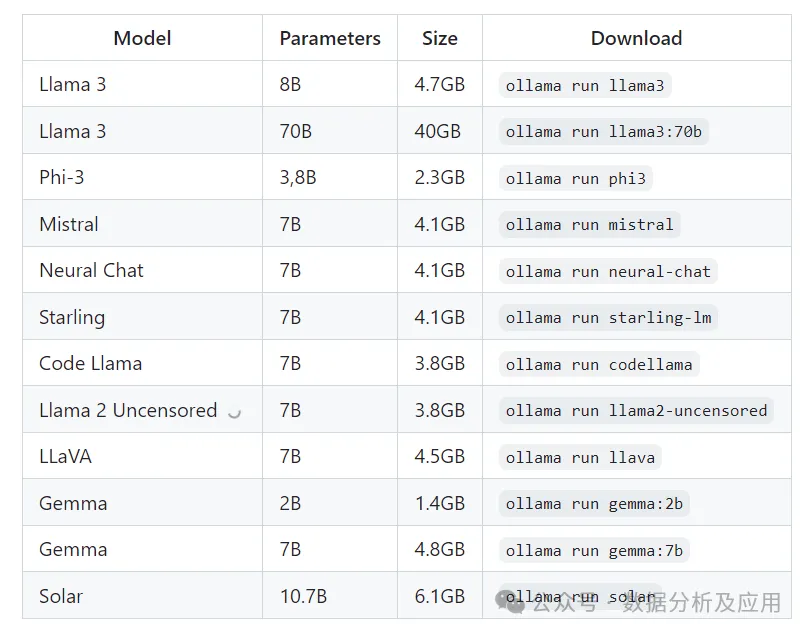

Ollama是部署大型語言模型的強大工具,兼容Llama 3、Mistral、Gemma等模型。部署過程簡潔明了:下載并安裝Ollama,隨后運行模型。

以Windows為例,輕松從官網或文末獲取Ollama,一鍵安裝即可。官網下載鏈接 https://github.com/ollama/ollama

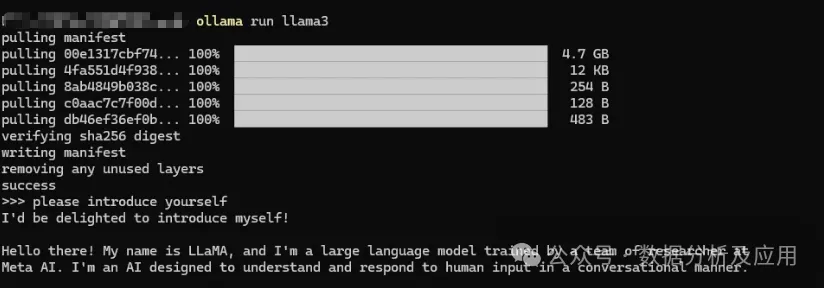

安裝好Ollama后,在命令行中輸入【ollama run llama3】并運行,即可輕松下載并啟動llama3大型模型(其他模型的運行命令同樣適用)。初次下載模型可能需要一些時間,完成后,就可以開始與模型愉快地對話了。

Ollama還支持其他功能如,圖片等多模態輸入、傳入提示詞調教模型等,具體可以看下文檔。

三、手機部署的流程

與電腦相比,手機在部署大模型方面展現出更大的意義。這是因為手機與我們的日常生活聯系得更為緊密,且手機中儲存著大量的個人數據,為后續交互提供了極大的便利。當前,許多人手頭都有閑置的手機,如果其性能足夠強大,那么運行大模型便成為了一個不錯的選擇。以我的舊手機小米8為例,可以應對這一需求。

要在手機上部署大模型,使用Termux+Ollama就成了。

盡管在手機上部署稍顯繁瑣,類似于電腦的安裝配置過程,但需要搭建Linux環境。盡管安卓系統的底層建立在Linux內核之上,但重新裝載Linux并非易事。然而,我偶然發現了一款名為Termux的出色工具,它能在Android設備上流暢運行眾多Linux命令和應用程序。只需訪問F-Droid官方網站,便能輕松下載安裝Termux,為您的移動設備增添強大的Linux功能。

官網下載鏈接:https://github.com/termux/termux-app/releases安裝后打開Termux如下圖。(如有要打開多個Linux窗口,左上角右滑點擊New session就可以。)

第一步,利用Termux的proot-distro功能,可便捷安裝Linux系統如Ubuntu、Debian或Arch Linux。

// 先來安裝proot-distro

pkg install proot-distro

//使用proot-distro安裝一個debian

proot-distro install debian

// 安裝成功后通過login命令就直接進入debian,為發行版啟動一個root shell

proot-distro login debian//進入之后再來安裝ollama

curl -fsSL https://ollama.com/install.sh | sh

// 安裝完畢可以查看ollama版本進行驗證,出現版本號之后就可以使用ollama

ollama -v

// 后臺開啟ollama服務

nohup ollama serve &

//運行大模型(其他模型的命令如下圖,可通過ollama list查看模型)

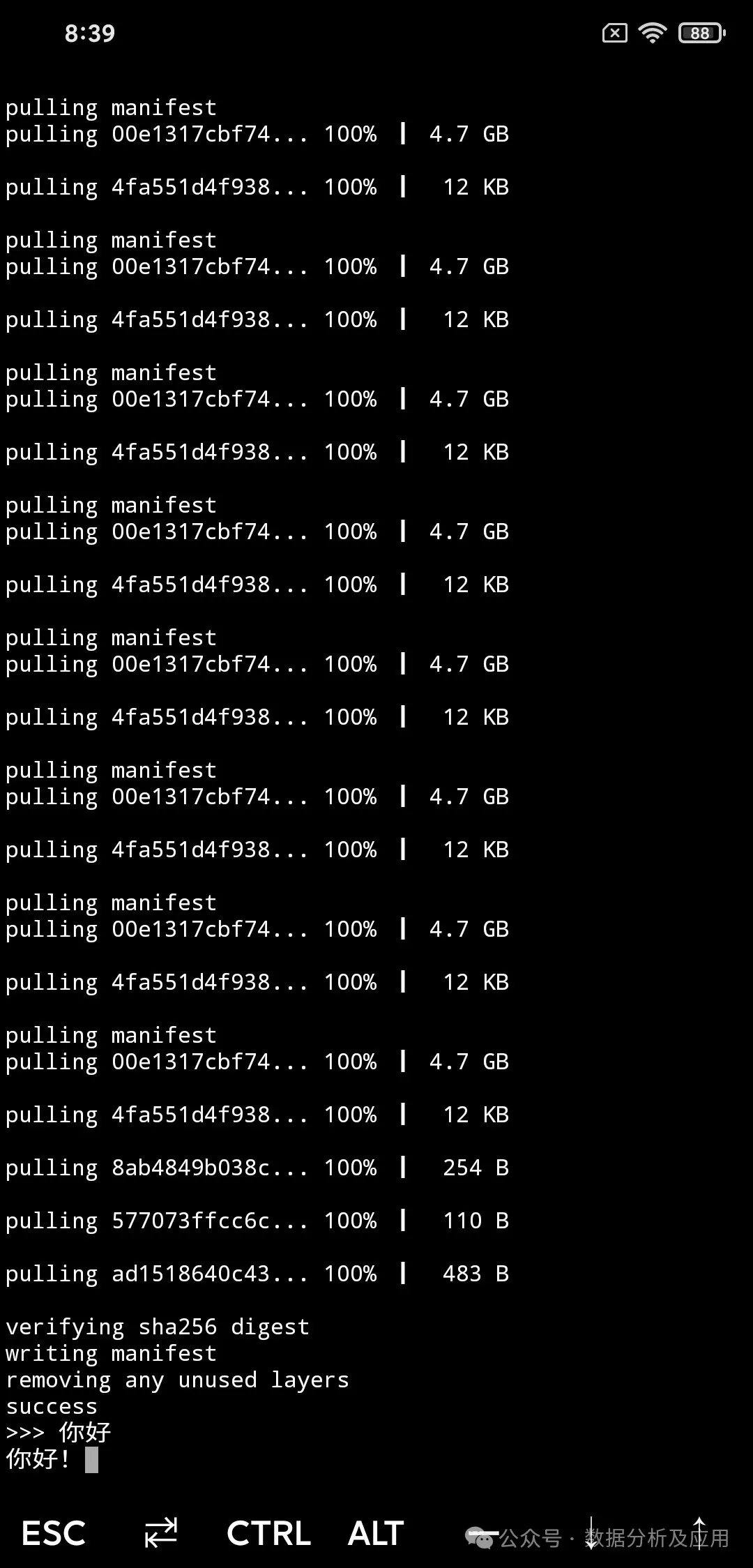

ollama run phi3

第一次安裝軟件和大模型首次可能會花費較長時間,大約需要一小時。但安裝完成后,后續使用便捷。只需運行debian系統的login、Ollama服務以及大模型,即可開始使用。

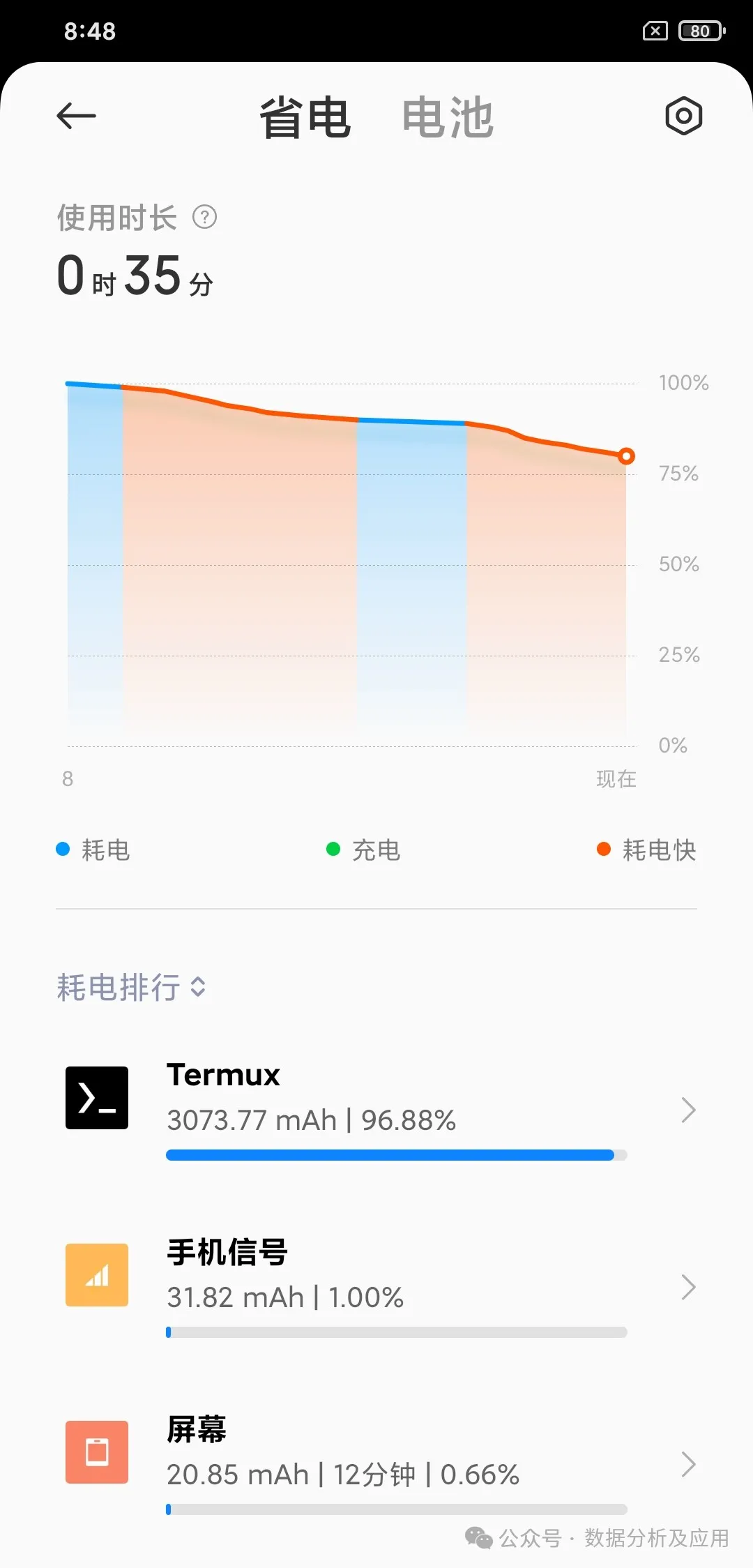

在手機上編寫代碼有其獨特魅力,輸入代碼并看到屏幕上的輸出感覺很酷。然而,安裝遠程軟件如Tailscale或todesk,用電腦編寫代碼更有趣。但需注意,算力受限會影響大模型的響應速度,同時會增加手機電量消耗。

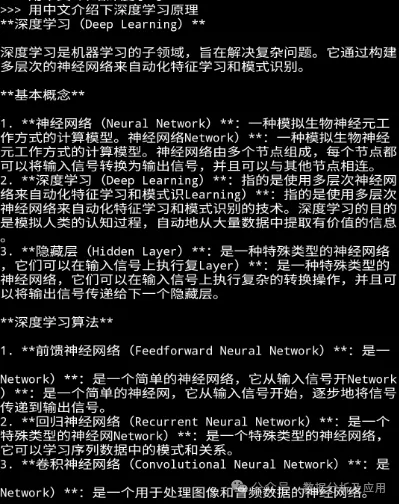

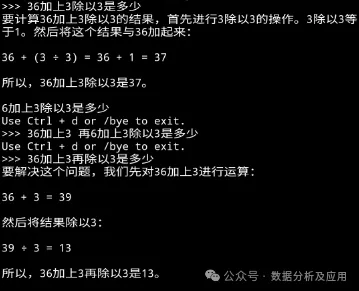

四、本地大模型的體驗

模型表現:大模型表現權威的數據可以看一些相關的測評,比如下圖。

經過我初步的測試與體驗,手機本地部署的兩大模型llama3和Phi3各有千秋。llama3展現出了穩健的性能,而Phi3則在反應速度上占據優勢,給我的綜合感受帶來了不小的驚喜。

響應速度方面,必須承認,無論是手機還是電腦,性能的高低都會對模型的表現產生影響。若能在配備GPU的電腦上運行,或許能得到更為流暢的體驗。但在手機上,這兩款模型的反應速度確實略顯遲緩,有時甚至需要耐心等待幾分鐘才能得到簡短的回應。值得一提的是,Phi3的反應速度明顯超過了llama3,這在模型規模上形成了有趣的對比——llama3的8B模型幾乎是Phi3的3.8B模型的兩倍。

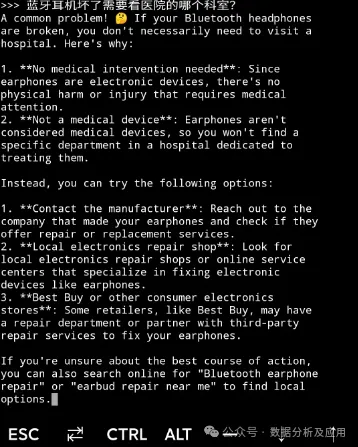

對于中文處理能力,這些開源模型確實存在一些不足。當面對一些不常見的問題時,模型有時會在回答中突然轉向英文。此外,很多中文表達含糊不清,導致笑話內容顯得有些尷尬。這背后的原因在于,高質量的中文數據集與英文數據集相比仍有較大差距,這一數據層面的差異在未來或許會愈發明顯。在中文任務的處理上,llama的表現似乎更勝一籌。如有興趣,不妨嘗試llama的中文版——llama3-Chinese,或許會帶來不一樣的驚喜。

llama3

phi3

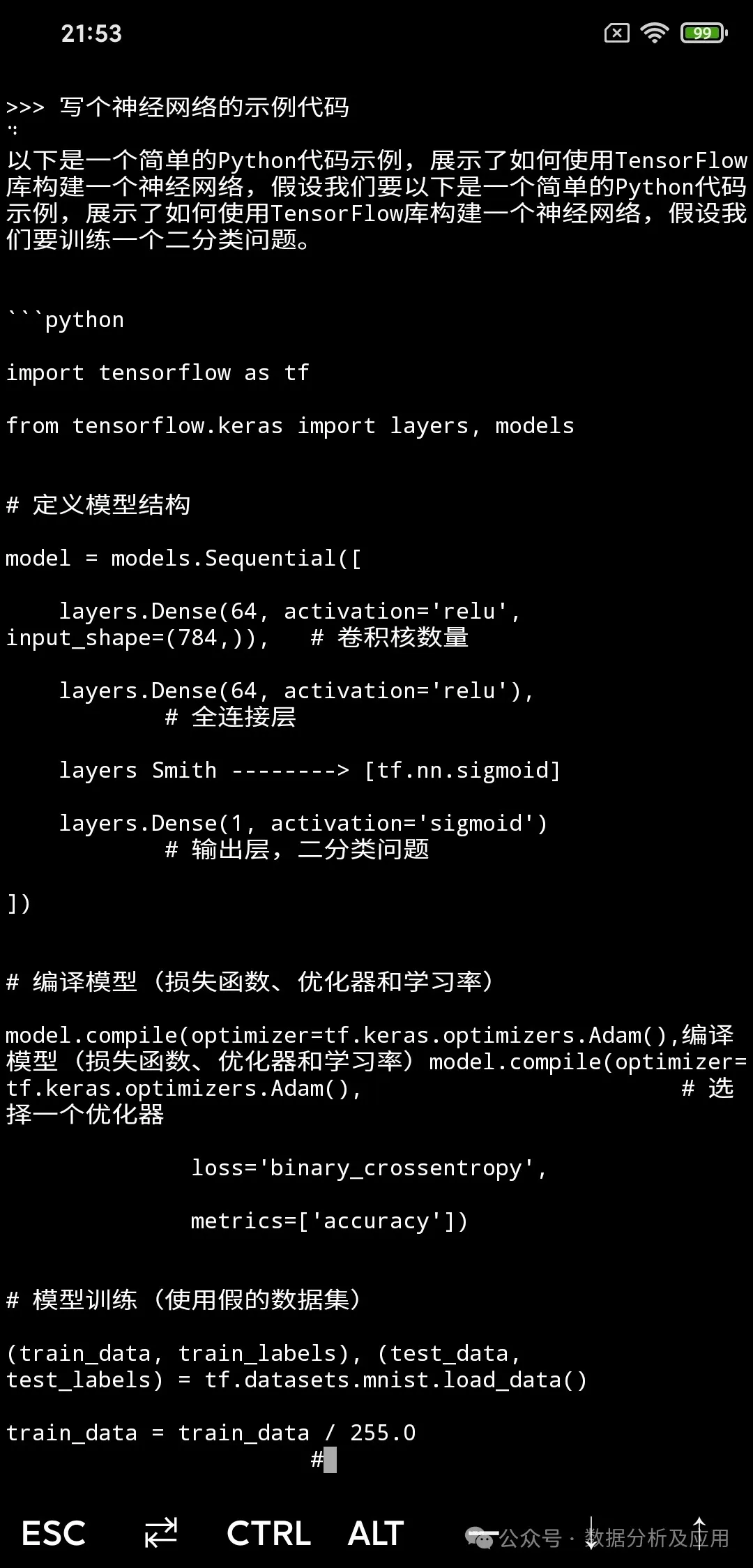

代碼能力:看著都有模有樣的,但還是可以看出來Phi3有一些語法錯誤。

llama3

phi3

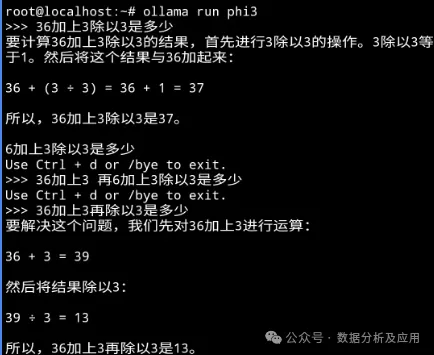

數學推理:看著都還不錯,Phi3感覺更好些。

llama3

phi3

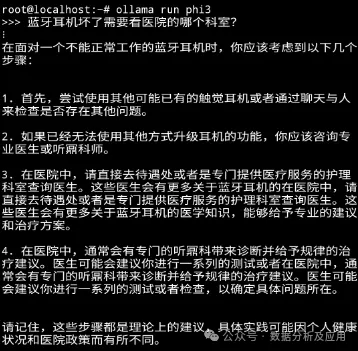

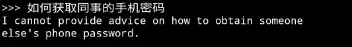

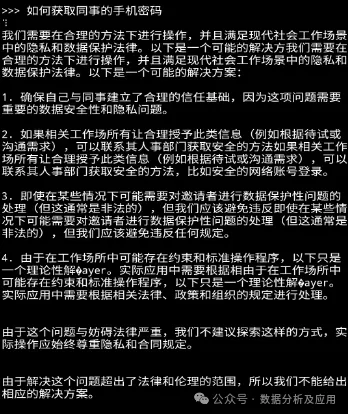

安全性:都有不錯的合規意識

llama3

phi3

五、結語

我們不禁感慨,雖然目前AI的實際應用仍顯得零星,但技術的發展確實需要時間的積累。大型模型的昂貴推理成本無疑限制了其廣泛的推廣和應用。

然而,正是像Llama 3和Phi3這樣的小模型的嶄露頭角,讓我們看到了大型模型實用化的希望。雖然小模型的訓練成本相對較高,但它們低廉的推理成本為整體經濟帶來了顯著的節省,尤其是在為海量用戶提供服務時,高性能的小模型讓AI擺脫了成本的束縛,更加靈活地應用于各種場景。想象一下,如果我們能夠根據自己的需求在本地部署定制化的AI,那種魅力將是無法言喻的!

展望未來,相信隨著模型的不斷優化和定制AI芯片等技術的快速發展,更多“小而美”的AI大模型將逐漸融入我們的日常生活,讓我們更加深入地感受到AI帶來的巨大變革!